TensorFlow中文社区和极客学院的教程已经写得非常好了,我就不照搬了,这里仅将代码和运行结果放在这里。

import tensorflow as tf

import input_data #可以自己下载这个py文件放在当前目录下

import os

import time

import matplotlib.pyplot as plt

os.environ['TF_CPP_MIN_LOG_LEVEL']='2' #不加这个,macOS系统会有好几个警告,但是不影响程序运行

start_time = time.time()

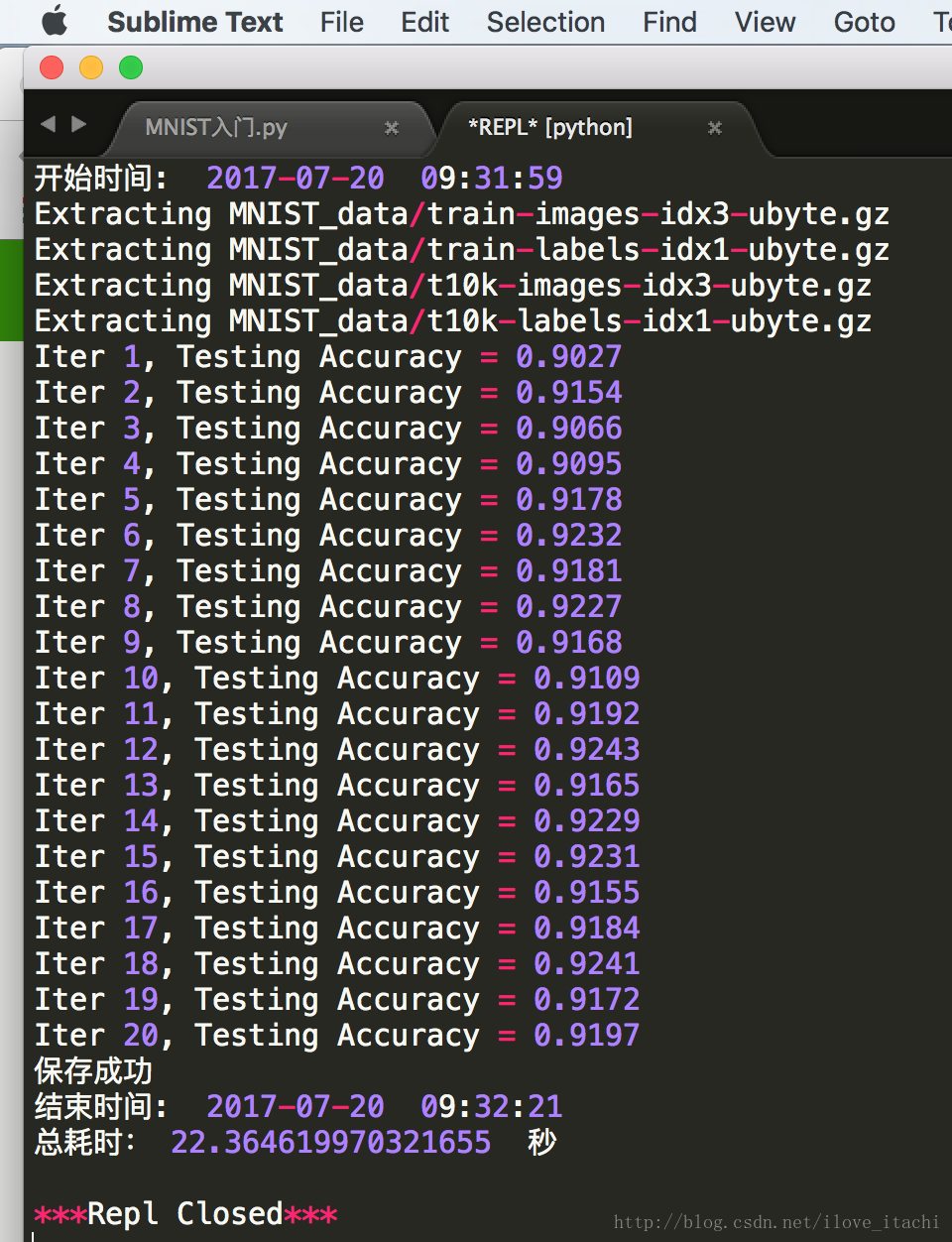

print('开始时间: ',time.strftime("%Y-%m-%d %H:%M:%S",time.localtime()))

mnist = input_data.read_data_sets('MNIST_data',one_hot=True)

batch_size = 100 #可以自己定义此值

n_batch = 55000//batch_size #train文件有55000张图片

x = tf.placeholder(tf.float32,[None,784])

y = tf.placeholder(tf.float32,[None,10])

#这里并没有用到隐藏层,直接784个输入神经元,10个输出神经元

W = tf.Variable(tf.truncated_normal(shape=[784,10],mean=0,stddev=0.1))

b = tf.Variable(tf.zeros([10]))

#softmax将输出结果转换为概率的形式

prediction = tf.nn.softmax(tf.matmul(x,W) + b)

#交叉熵代价函数

cross_entropy = -tf.reduce_sum(y*tf.log(prediction))

optimizer = tf.train.GradientDescentOptimizer(0.01)

train = optimizer.minimize(cross_entropy)

correct_prediction = tf.equal(tf.argmax(y,axis=1),tf.argmax(prediction,axis=1))#argmax返回一维张量中最大的值所在的位置

accuracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))#cast是进行数据格式转换,把布尔型转为float32类型

# 定义模型保存对象

saver = tf.train.Saver()

init = tf.global_variables_initializer()

accuracys = []

with tf.Session() as sess:

sess.run(init) #初始化

for epoch in range(1,21): #迭代20轮,因为这里的神经网络结构很简单,容易过拟合,并不用迭代很多轮

for batch in range(n_batch):

x_data,y_label = mnist.train.next_batch(batch_size)

sess.run(train,feed_dict={x:x_data,y:y_label})

acc = sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels})

accuracys.append(acc)

print("Iter " + str(epoch) + ", Testing Accuracy = " + str(acc))

saver.save(sess,'mnist_model.ckpt')

print('保存成功')

end_time = time.time()

print('结束时间: ',time.strftime("%Y-%m-%d %H:%M:%S",time.localtime()))

print('总耗时:',end_time - start_time,' 秒')

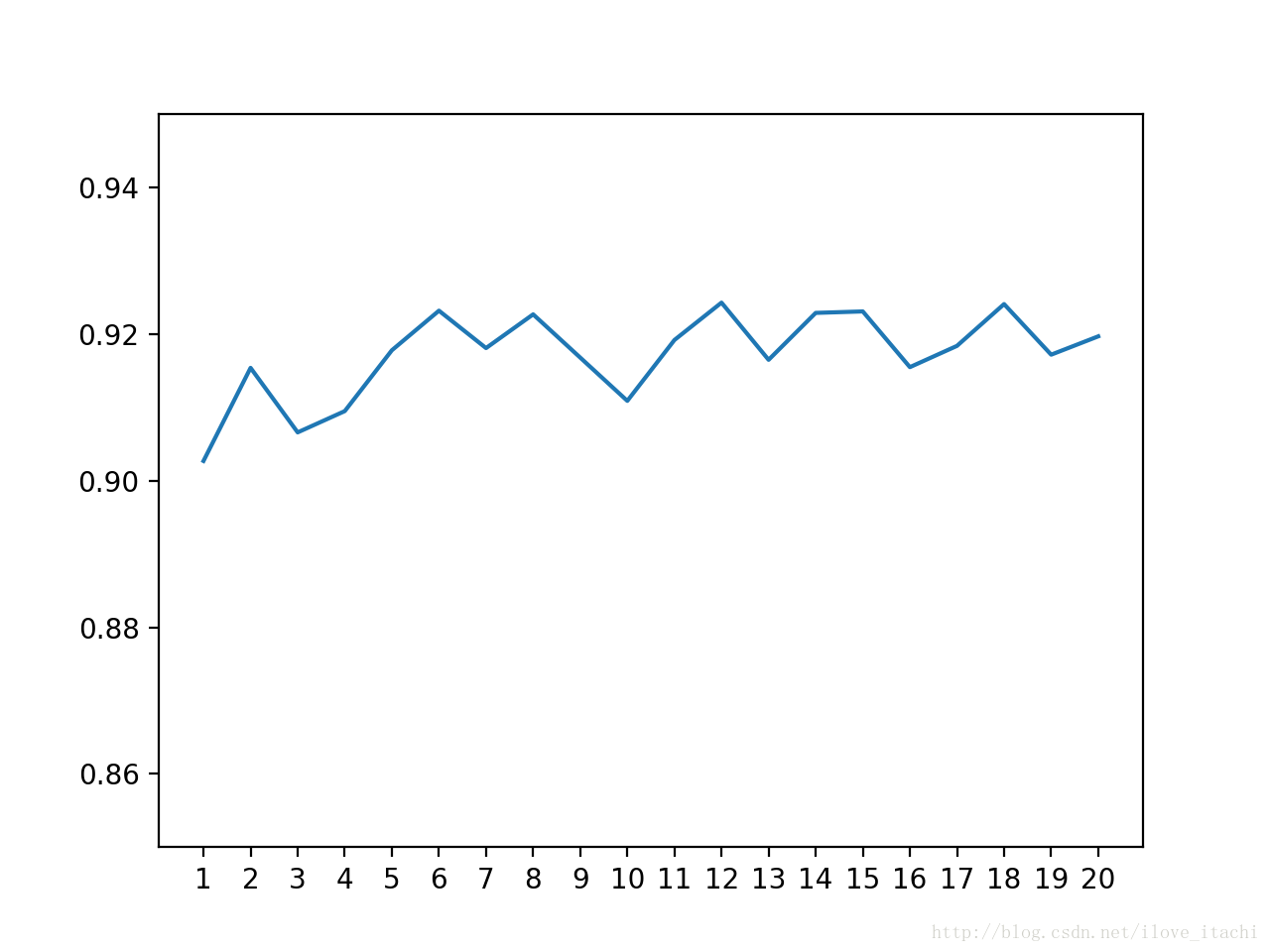

x = [x for x in range(1,21)]

plt.plot(x,accuracys)

plt.ylim(0.85,0.95) #设置y轴范围

plt.xticks(x) #设置x坐标轴

plt.show()

可以看到,简单的神经网络结构运行起来还是挺快的,虽然结过并不稳定可靠,但是仅仅一个输入层和一个输出层的两层神经网络就可以达到91%左右的准确率,可见神经网络的强大。

146

146

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?