Main Contributions

-

本文提出了一种基于方差调整迭代梯度的方法来增强生成对抗样本的可迁移性。具体来说,在梯度计算的每一次迭代中,不再直接使用当前梯度进行动量积累,而是进一步考虑前一次迭代的梯度方差来调整当前梯度。关键思想在于每次迭代中减小梯度的方差,从而稳定更新方向,这样才能避免局部最优。

-

本文将方差调整与几个基于梯度的集成模型攻击相结合,并将这些攻击与各种输入转换相结合,实验证明,提高了攻击的迁移性

Background

本文的背景,文章从两个地方入手

- Gradient-based Attack

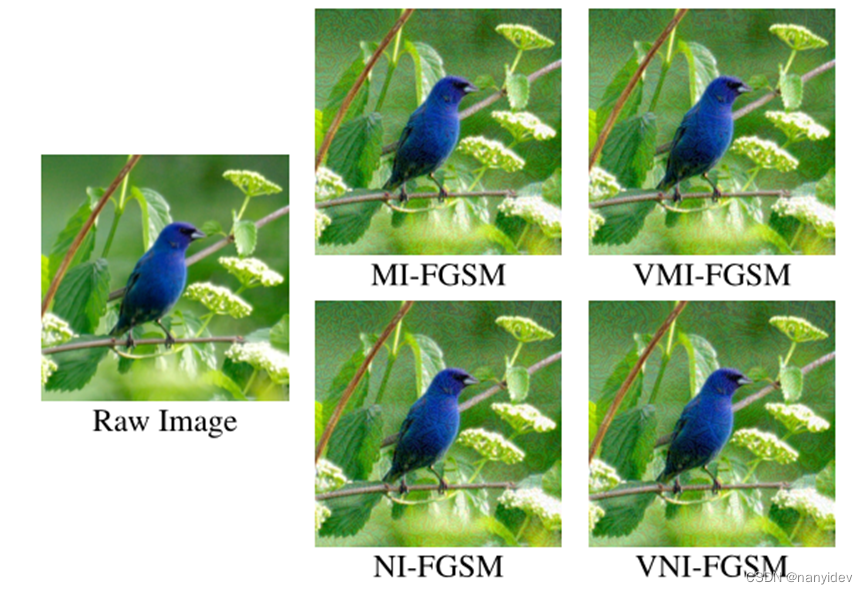

介绍了FGSM,I-FGSM,MI-FGSM,NI-FGSM - Input Transformations

介绍了DIM,TIM,SIM

Motivation

基于以上背景,总结一下本文的motivation,我们知道,对抗性样本生成过程和神经网络训练过程很相似,其中输入x可被视为待训练的参数,而目标模型可被视为训练集。从这个角度来看,对抗性例子的可迁移性相当于对正常训练模型的泛化。

因此,现有的工作主要集中在更好的优化算法(如MI-FGSM,NI-FGSM)或数据增强(如对多模型或输入变换的集成攻击),来提高攻击的可迁移性。

另一方面,本文将基于迭代梯度的对抗攻击看作一个随机梯度下降(SGD)的优化过程,在每次迭代中,攻击者总是选择目标模型进行更新。但SGD由于随机性引入了较大的方差,导致收敛速度较慢。

所以本文尝试通过梯度方差调整策略来增强对抗迁移能力,基于方差调整的方法旨在提高基于梯度的攻击(如MI-FGSM、NIFGSM)的可迁移性,并可与各种输入变换相结合来进一步提高攻击的迁移性。

Method

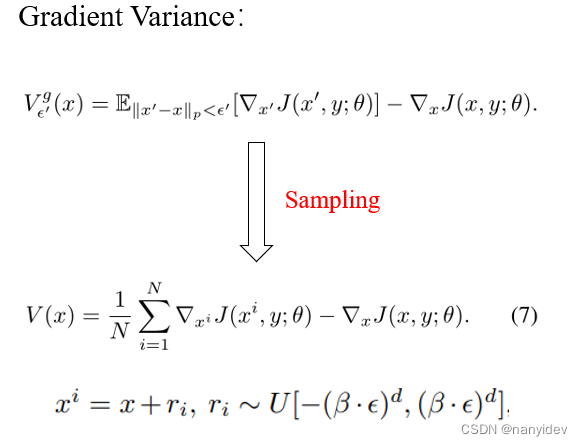

为了避免过度拟合,在每次迭代时,本文采用先前数据点附近的梯度信息来调整当前数据点的梯度。具体来说,本文定义了梯度方差如这个公式:

也就是说是邻域的平均梯度与其自身梯度之间的差值

然后因为前面这个式子的连续性,我们不能够直接计算,所以通过采样N个样本来计算V(x),也就是公式7,其中 x i = x + r i , r i − U [ − ( β ⋅ ϵ ) d , ( β ⋅ ϵ ) d ] x^i=x+r_i,r_i-U[-(\beta \cdot \epsilon)^d,(\beta \cdot \epsilon)^d] xi=x+ri,ri−U[−(β⋅ϵ)d,(β⋅ϵ)d],(均匀分布),就是通常往x上加随机扰动,其中 ϵ \epsilon ϵ 是扰动的上界, β \beta β 是领域上限因子,可以看成一个超参。

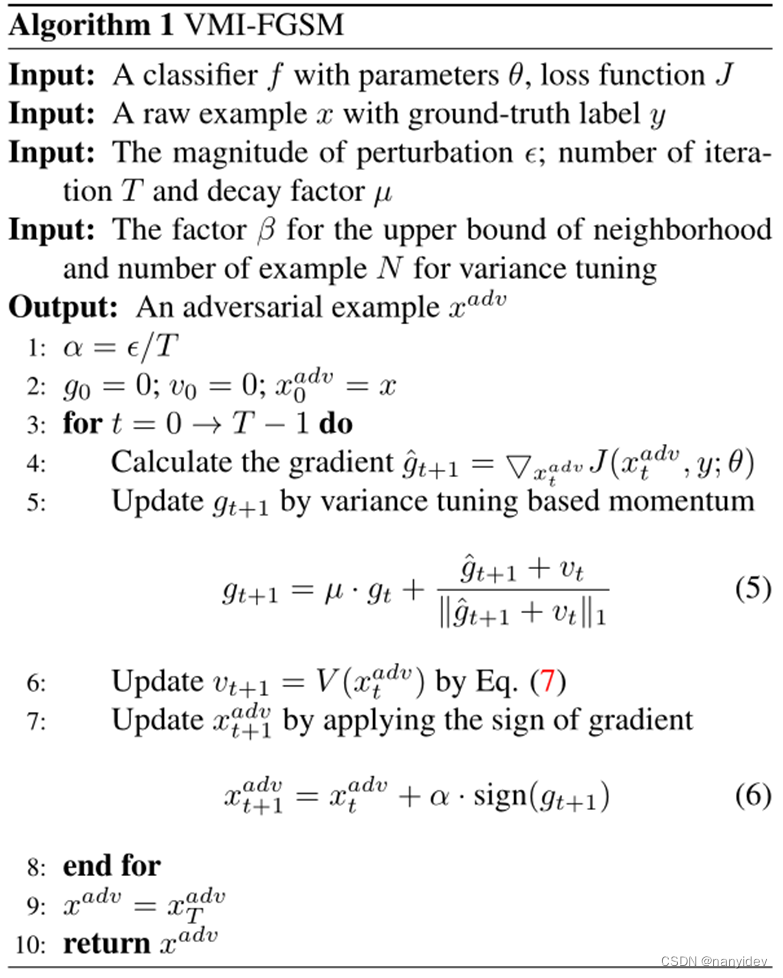

在获得梯度方差之后,然后可以利用第(t−1)次迭代的梯度方差 V ( x t − 1 a d v ) V(x_{t-1}^{adv}) V(xt−1adv)来调整第t次迭代的 x t a d v x_t^{adv} xtadv 的梯度,以稳定更新方向。右边这个算法1总结了方差调整MI-FGSM算法,称之为VMI-FGSM。

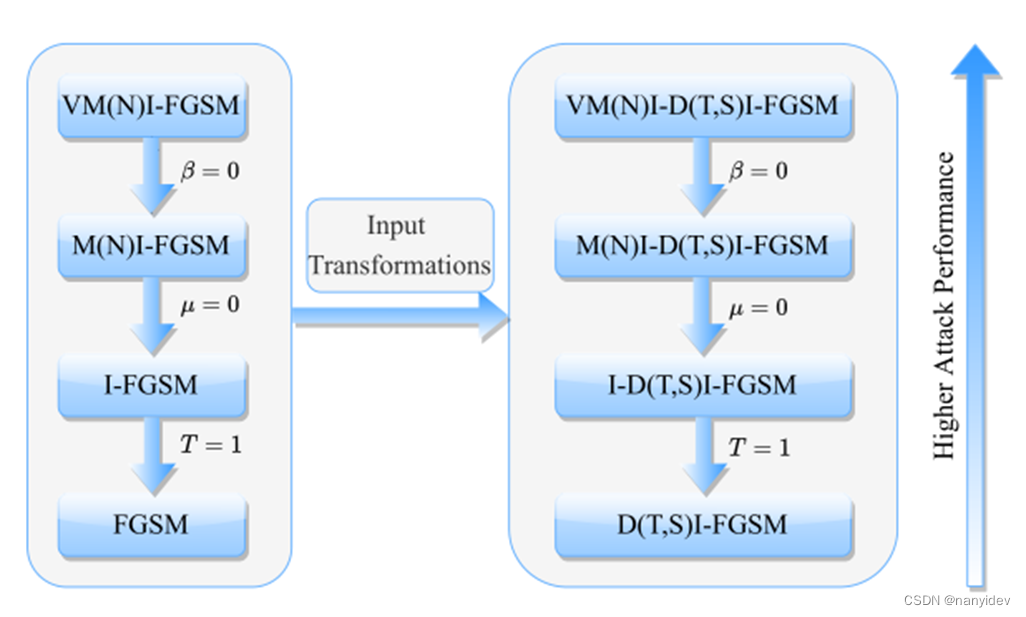

然后再来看一下本文与其他攻击方法的联系,本文主要研究了基于FGSM的对抗性攻击的可迁移性,如下图所示。

- 如果领域的上界因子β设置为0,则VMI-FGSM和VNI-FGSM分别退化为MI-FGSM和NI-FGSM。

- 如果衰减因数µ=0,则MI-FGSM和NI-FGSM均退化为I-FGSM。

- 如果迭代次数T=1,则I-FGSM退化为FGSM。

另外呢,还可以将上述攻击与DIM、TIM、SIM等各种输入变换相结合,以获得更强大的攻击

Experiments

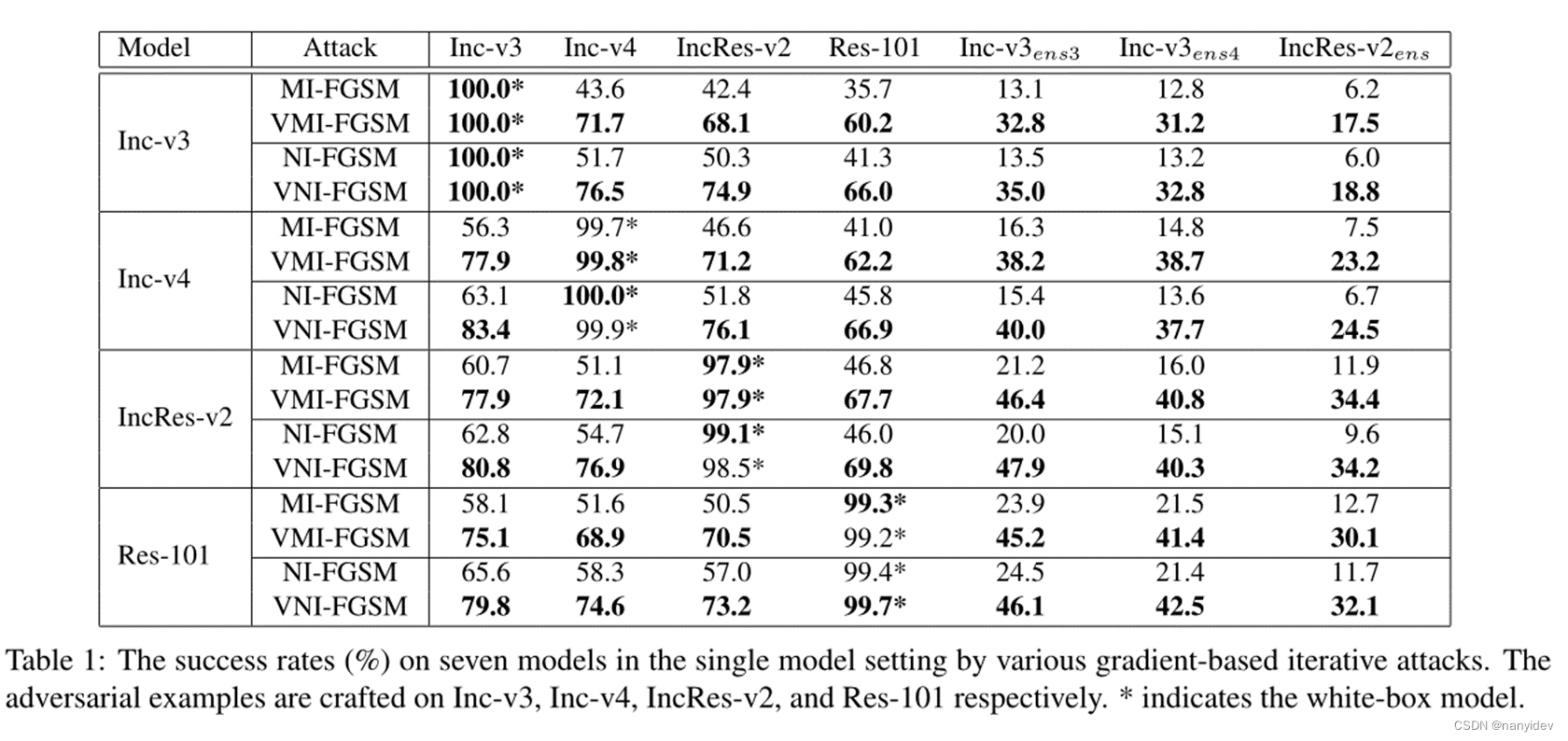

首先在单个神经网络上执行四种对抗攻击,即MIFGSM、NI-FGSM、VMI-FGSM和VNI-FGSM。正常训练的网络上制作对抗样本,并在七个神经网络上测试它们。表1显示了攻击的成功率,带星号的表示白盒攻击

比如说,以第一行为例,如果我们在 Inc-v3 模型上制作对抗样本,其中所有攻击在白盒设置中都可以达到 100% 的成功率,然后从黑盒迁移来看VMI-FGSM和VNI-FGSM都超过了MI和NI

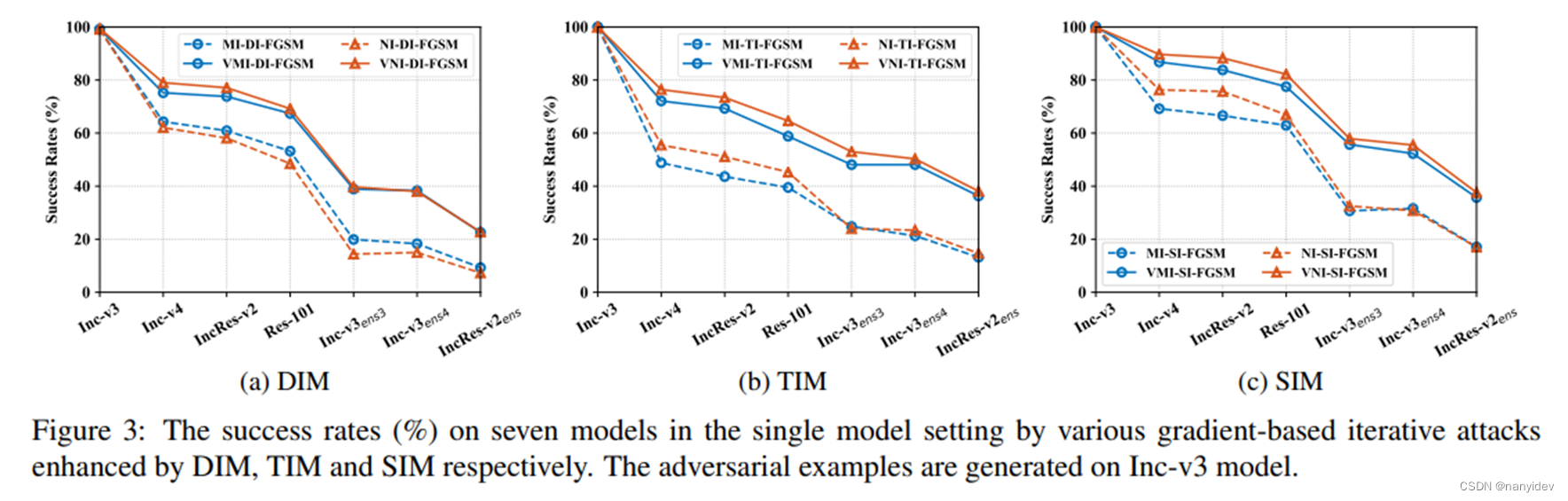

然后是Attck with Input Transformations,具体说就是DIM、TIM和SIM等几种输入变换被引入到基于梯度的对抗性攻击中。在这里,我们将本文方法集成到这些输入变换中,并证明了所提出的方差调整策略可以进一步增强可迁移性。从图中可以看出,使用方差调整策略都可以大幅提高针对黑盒模型的成功率, 一般来说,始终优于baseline 10% - 30%。

509

509

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?