**

详细搭建Hadoop集群

**

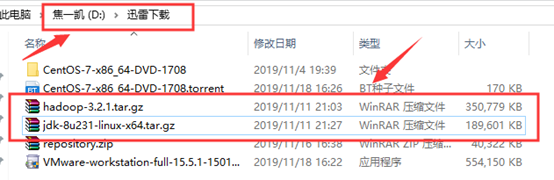

1. 下载Hadoop和java

去官网下载Hadoop和Java 复制链接到迅雷下载:

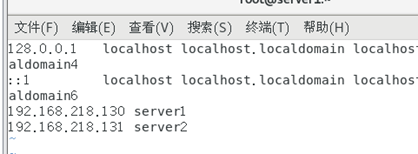

2.修改虚拟机的用户名以及对应IP

vi /etc/hostname/

改为server1

vi /etc/hosts

另外的一个server2也做相同的设置

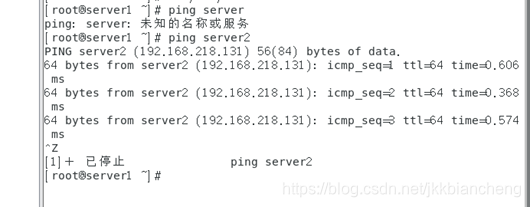

检查是否可以ping的通 ping server2

server2 也ping一下server1 试一下是否可以ping的通

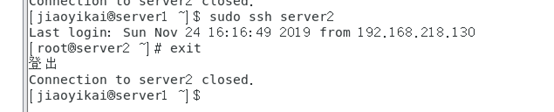

3.ssh免密登录

在管理员权限下执行 ssh-keygen -t dsa

然后在/root/.ssh文件夹下生成一个id_dsa.pub文件

在该文件下建立一个authorized_keys文件,将id_dsa.pub文件内容拷贝到authorized_keys文件中

在将server2里也执行相同的操作,在将server2里生成的id_dsa.pub文件也拷贝到server1里新建的authorized_keys文件中

最后将server1里的authorized_keys文件拷贝到server2的/root/.ssh文件夹下;

在server1中执行ssh server2 试一下是否可以免密登录,exit退出;

4.安装Java环境

将Windows下下载的Java包使用U盘倒到虚拟机下,并将其解压缩。

修改/etc/profile/文件,在该文件下添加

export JAVA_HOME=/home/jiaoyikai/公共/jdk1.8.0_231

export

CLASSPATH=

:

C

L

A

S

S

P

A

T

H

:

:CLASSPATH:

:CLASSPATH:JAVA_HOME/lib/

export PATH= P A T H : PATH: PATH:JAVA_HOME/bin

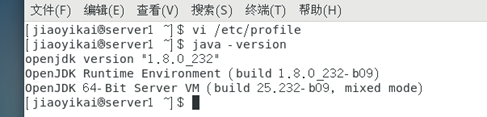

测试是否安装成功java -version

5.搭建Hadoop环境

1、在/root目录新建几个新的目录

mkdir /root/hadoop

mkdir /root/hadoop/tmp

mkdir /root/hadoop/var

mkdir /root/hadoop/dfs

mkdir /root/hadoop/dfs/name

mkdir /root/hadoop/dfs/data

2、修改配置etc/hadoop中的一系列配置文件文件

在core-site.xml中的节点内加入配置:

注:由于报告页数限制,具体配置信息可以参考:https://blog.csdn.net/u013457387/article/details/87856770#commentBox

3、修改hadoop-env.sh文件

加入export JAVA_HOME=/home/jiaoyikai/公共/jdk1.8.0_231

具体的位置应该为java的解压缩位置

4、修改hdfs-site.xml文件

在节点内加入配置:

5、修改mapred-site.xml

在节点内加入配置:

6、修改workers文件

将里面的localhost删除,添加server1 server2 在server2中的workers文件添加server2文件

7、修改yarn-site.xml文件

在节点内加入配置:

另一台虚拟机也要相同的配置

6.启动Hadoop

1、先进入到server2这台虚拟机的hadoop/bin文件夹下执行初始化脚本:

./hadoop namenode -format

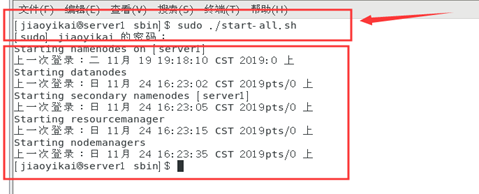

2、然后在server1上执行启动命令

./start-all.sh

我在启动过程中出现大量报错解决办法为

在start-dfs.sh 、stop-dfs.sh两个文件开头位置添加如下配置:

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=root

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

在start-yarn.sh 、stop-yarn.sh两个文件开头位置添加如下配置:

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=root

YARN_NODEMANAGER_USER=root

正常启动的截屏:

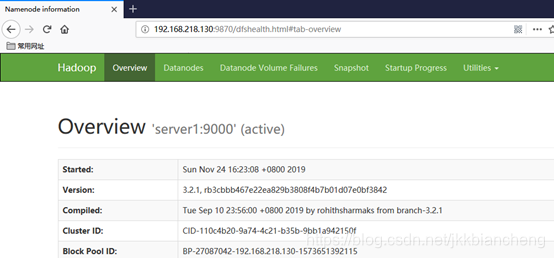

在本机电脑下输入端口namenode的ip地址后面加上:9870访问Hadoop的端口地址

本namenode的ip为192.168.218.130,访问成功界面:

**

码字不易,只求一个小小的赞或者评论,有不清楚的可以私信作者

**

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?