参考:https://blog.csdn.net/qq_42363032/article/details/124651978

Attention思想:

在大量信息中把注意力用在更重要的信息上。

Q:query#随意线索->主观想法#我想要看报纸

K:key#不随意线索->客观存在#有一份报纸在桌子上

V:value#key-value成对出现

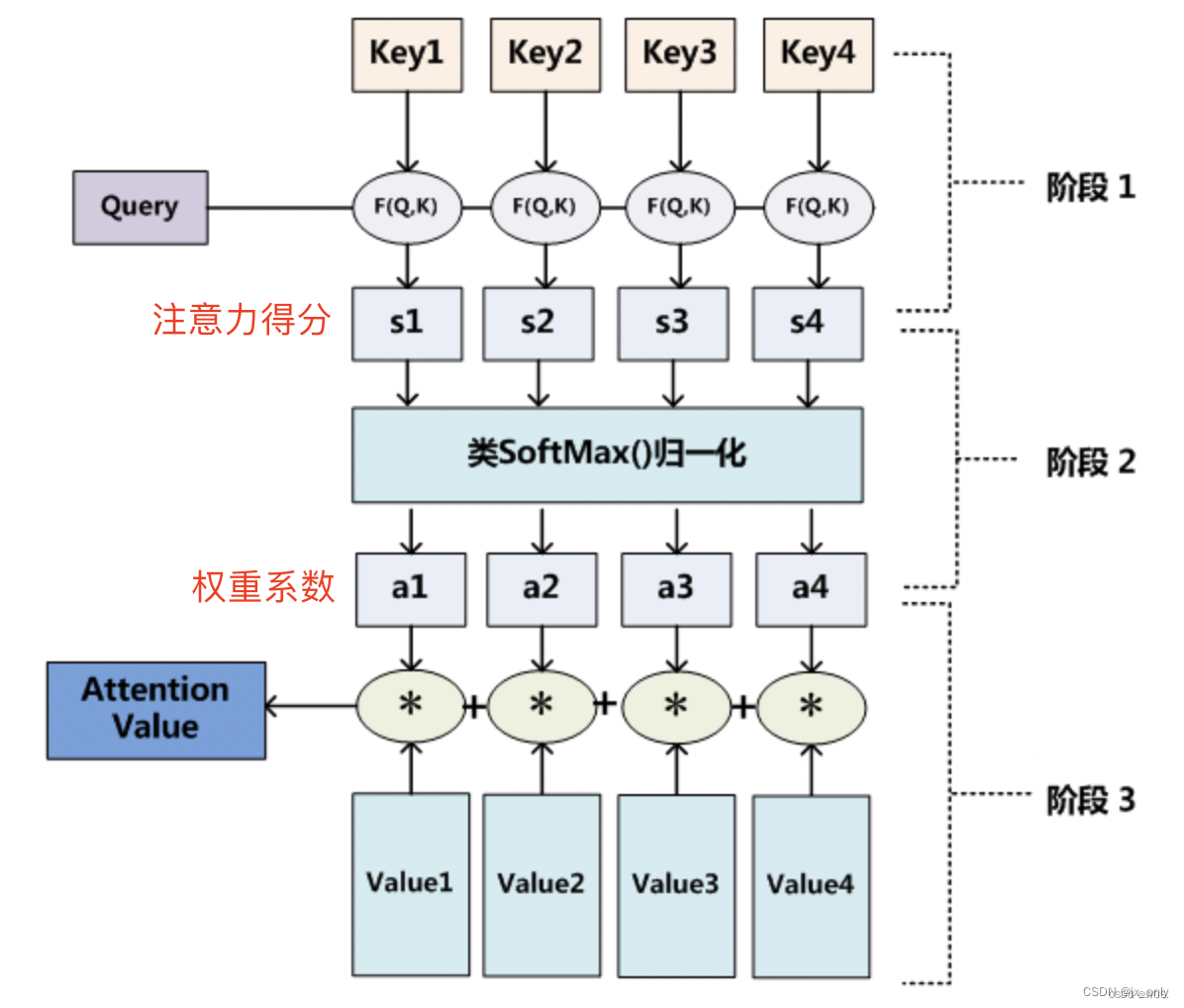

计算attention值:

1.计算Q对每个K的相似性,F(Q,K)

–求两者的向量点积:Q·K

–求余弦相似度

–引入额外神经网络求值:MLP(Q,K)

2.对相似性分数进行归一化得到权重系数α

–α=类softmax(F(Q,K))

3.根据权重系数进行加权求和,得到针对Q的Attention值

–Attention(α,v) = sum(α×v)

Attention机制

最新推荐文章于 2024-06-15 16:30:09 发布

1321

1321

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?