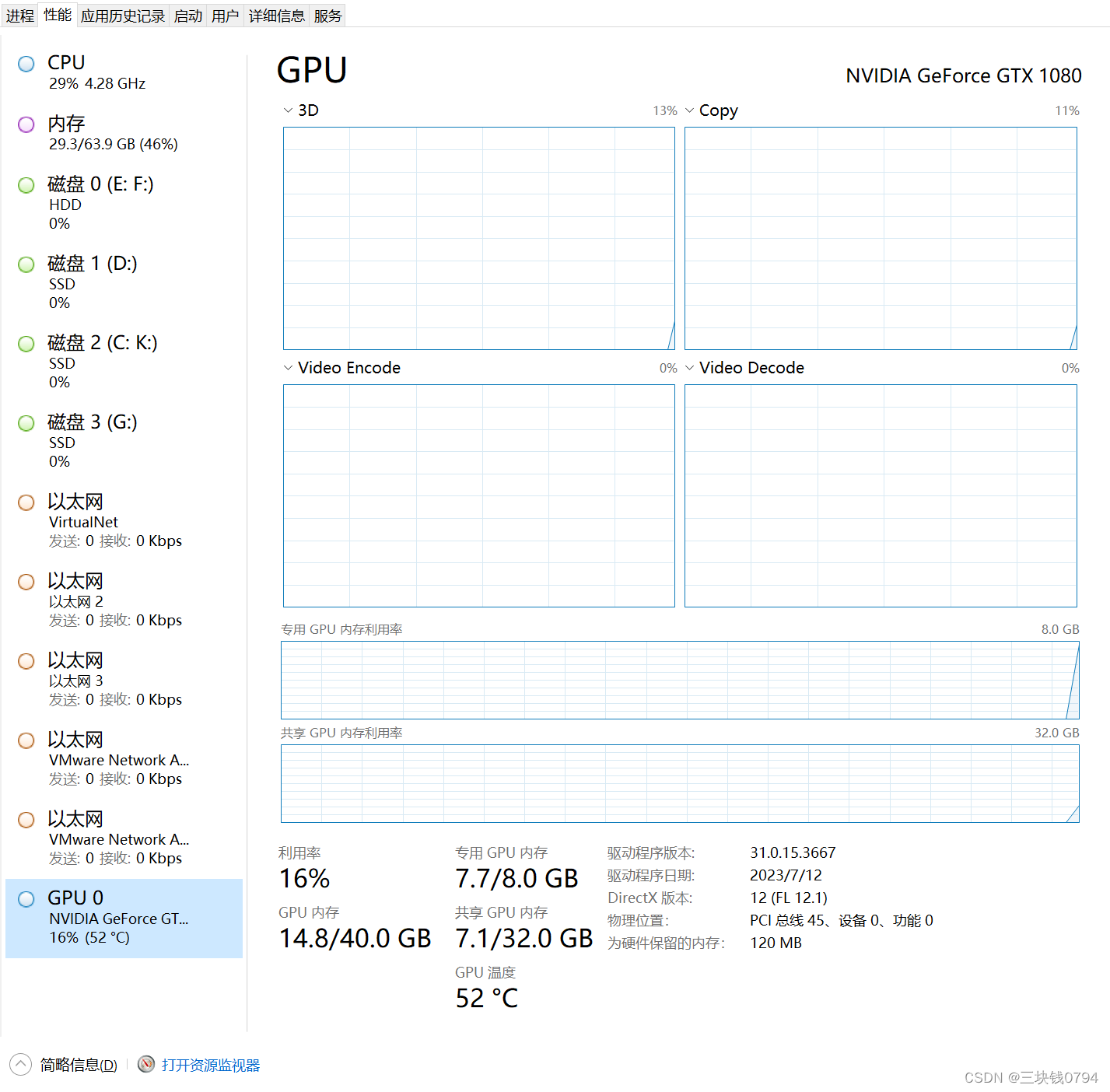

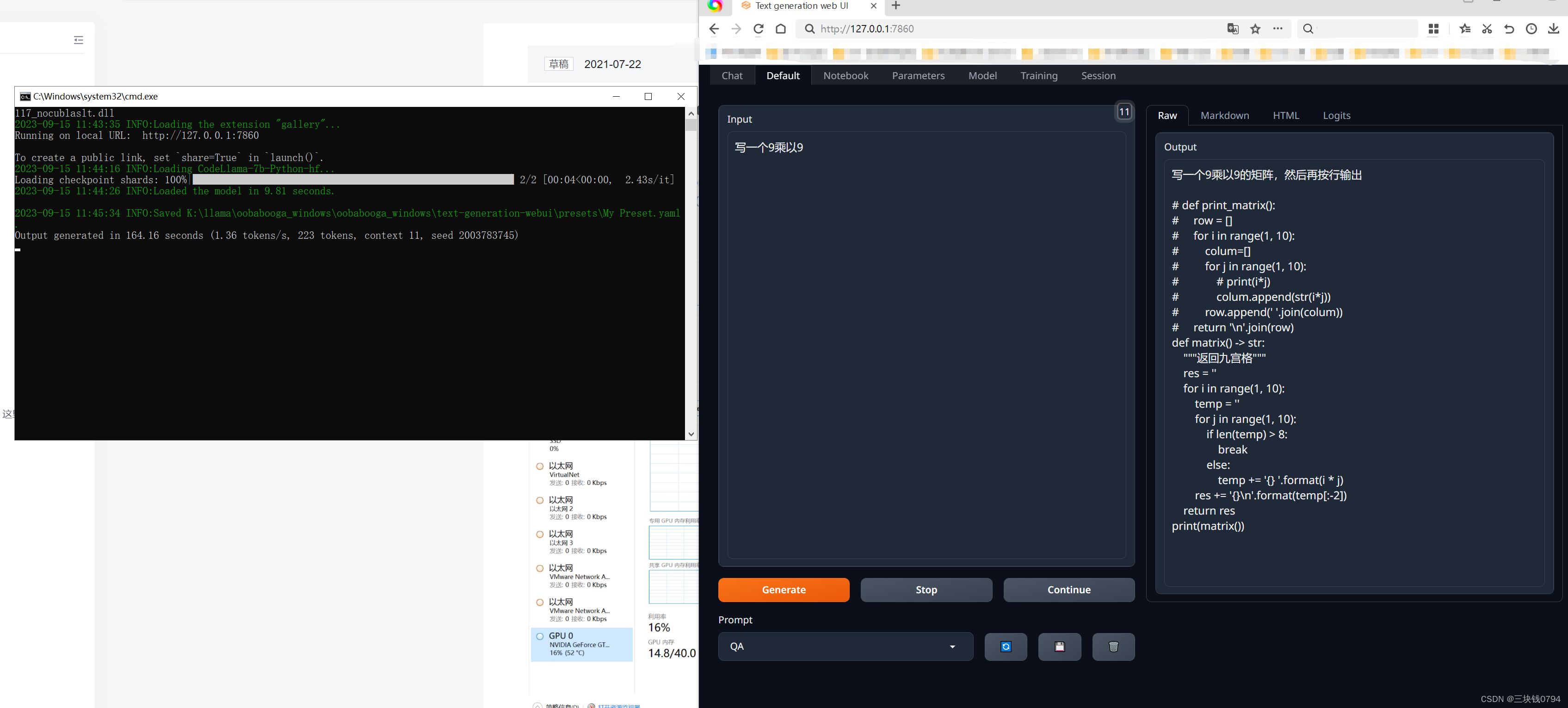

1.效果展示

"Code Llama" 是一个大型代码语言模型的系列,基于 "Llama 2" 构建,为编程任务提供了无监督指导能力,并在开放模型中表现出了最先进的性能。它为各种应用提供了多种版本,包括基础模型(Code Llama)、Python专门化版本(Code Llama - Python)以及指导模型(Code Llama - Instr

1.效果展示

"Code Llama" 是一个大型代码语言模型的系列,基于 "Llama 2" 构建,为编程任务提供了无监督指导能力,并在开放模型中表现出了最先进的性能。它为各种应用提供了多种版本,包括基础模型(Code Llama)、Python专门化版本(Code Llama - Python)以及指导模型(Code Llama - Instr

1156

1156

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?