先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

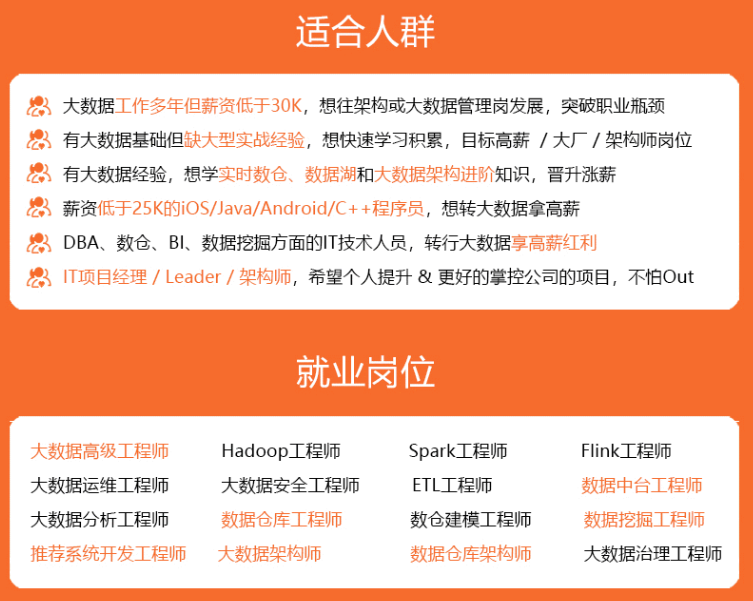

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

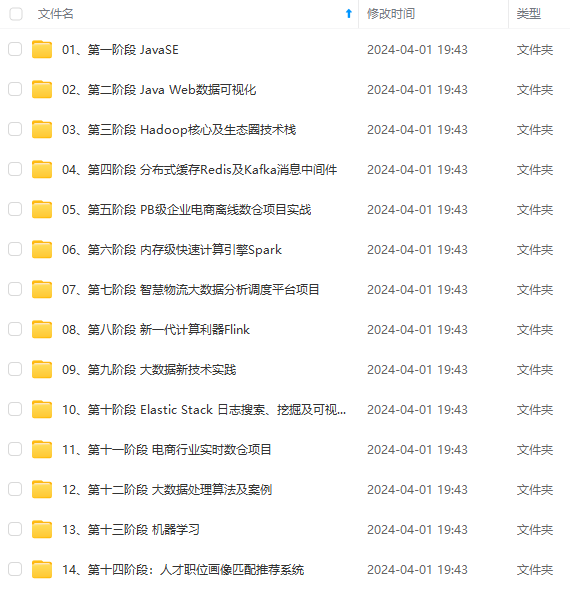

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

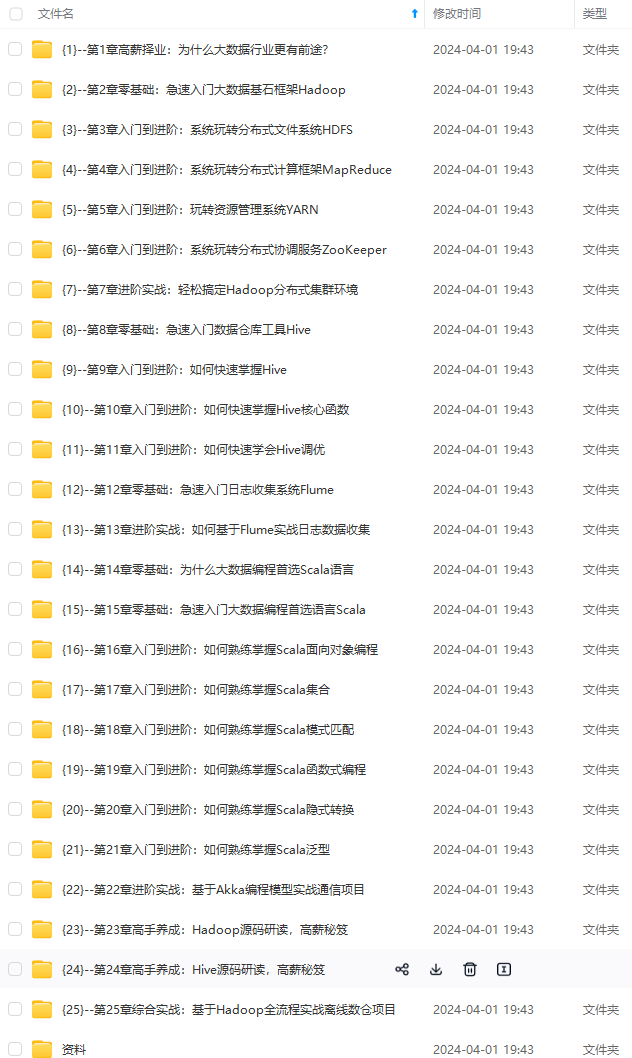

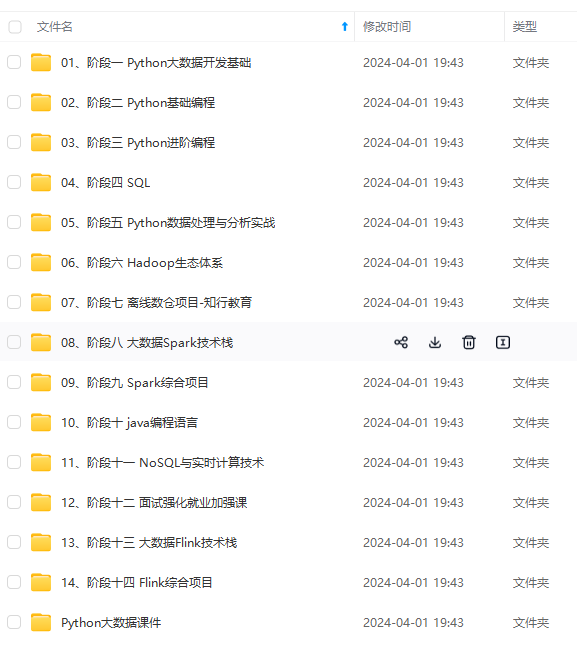

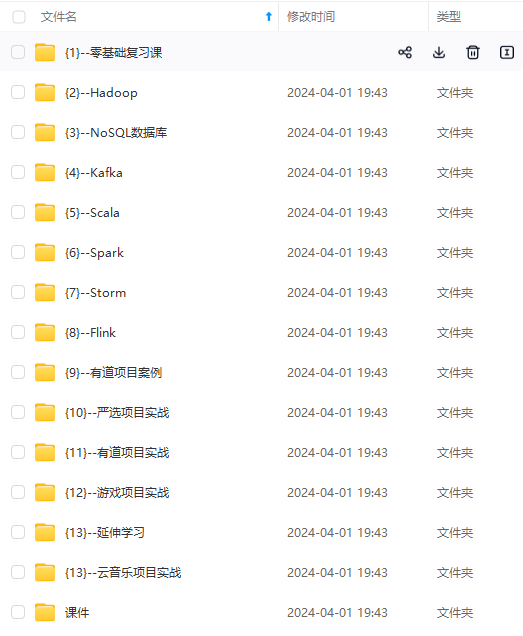

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

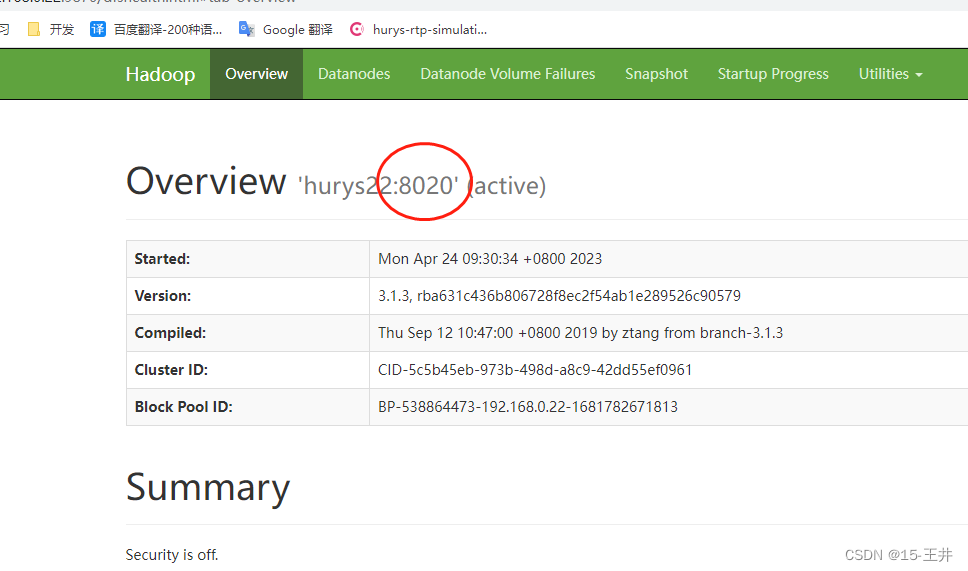

第一步,在hive中创建spark配置文件 (注意:端口号8020必须和namenode的端口号一致)

[root@hurys22 ~]# cd /opt/soft/hive312/conf/

[root@hurys22 conf]# vi spark-defaults.conf

spark.master yarn

spark.eventLog.enabled true

spark.eventLog.dir hdfs://192.168.0.22:8020/spark-history

spark.executor.memory 1g

spark.driver.memory 1g

第二步,在HDFS创建文件夹spark-history,用于存储历史日志

[root@hurys22 conf]# hdfs dfs -mkdir /spark-history

第三步,解压并向HDFS上传Spark纯净版jar包spark-3.0.0-bin-without-hadoop.tgz

1.解压spark纯净版安装包

[root@hurys22 install]# tar -zxf /opt/install/spark-3.0.0-bin-without-hadoop.tgz -C /opt/soft/

[root@hurys22 install]# cd /opt/soft/

[root@hurys22 soft]# ls

flume190 hadoop313 hbase205 hive312 kafka213 scala211 spark300 spark-3.0.0-bin-without-hadoop zepplin090

2.重命名安装目录

[root@hurys22 soft]# mv spark-3.0.0-bin-without-hadoop/ spark300without

[root@hurys22 soft]# ls

flume190 hadoop313 hbase205 hive312 kafka213 scala211 spark300 spark300without zepplin090

3.在HDFS创建文件夹spark-jars,用于存放纯净版spark安装目录里的jar包

[root@hurys22 soft]# hdfs dfs -mkdir /spark-jars

4.上传Spark纯净版安装目录里的jar包到HDFS的spark-jars文件夹中

[root@hurys22 soft]# hdfs dfs -put spark300without/jars/* /spark-jars

第四步,修改hive-site.xml文件

[root@hurys22 soft]# cd /opt/soft/hive312/conf/

[root@hurys22 conf]# ls

beeline-log4j2.properties.template hive-exec-log4j2.properties.template ivysettings.xml nohup.out

hive-default.xml.template hive-log4j2.propertie llap-cli-log4j2.properties.template parquet-logging.properties

hive-env.sh hive-site.xml llap-daemon-log4j2.properties.template spark-defaults.conf

[root@hurys22 conf]# vi hive-site.xml

第五步,Hive on Spark测试

1.登录hive

[root@hurys22 conf]# hive

2.建测试库

hive> create database test2;

OK

Time taken: 0.149 seconds

hive> show databases;

OK

default

test

test2

hive> use test2;

OK

3.建测试表

hive> create table student(id int, name string);

OK

4.插入数据

hive> insert into table student values(1,‘zhangsan’);

5.查看数据

hive> select * from student;

OK

1 zhangsa

6.查看目前hive使用的计算引擎

hive> set hive.execution.engine;

hive.execution.engine=spark

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1713367622948)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

4067

4067

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?