1、解压:tar -zxvf spark-2.1.0-bin-hadoop2.4.tgz -C ~/training/

conf/目录下:

cp spark-env.sh.template spark-env.sh #重命名

cp slaves.template slaves #重命名

2、配置参数文件:

(1) conf/spark-env.sh

export JAVA_HOME=/usr/java/jdk1.8.0_11

export SPARK_MASTER_HOST=master

export SPARK_MASTER_PORT=7077

(2) conf/slaves —->配置从节点的主机信息

localhost ->master

3、启动Spark伪分布环境

sbin/start-all.sh

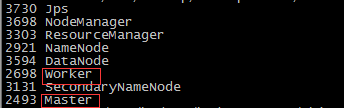

检验:jps

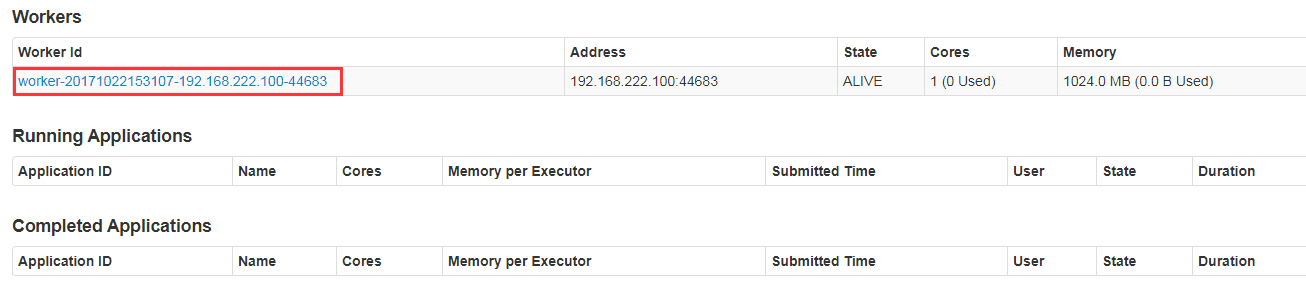

Spark Web Console: http://192.168.222.100:8080

702

702

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?