上一章的内容 深度学习从入门到不想放弃-6 (qq.com)

今天讲的也算基础(这个系列后来我一寻思,全是基础

),但是可能要着重说下,今天讲前向计算和反向传播,在哪儿它都永远是核心,不管面对什么模型

前向计算:

有的叫也叫正向传播,正向计算的,有的直接把前向的方法梯度下降当成前向计算的名字。熟悉我的读者也了解,我一般不太care概念叫什么名,不重要,大家自己喜欢叫什么都行,只要理解是干啥的就行

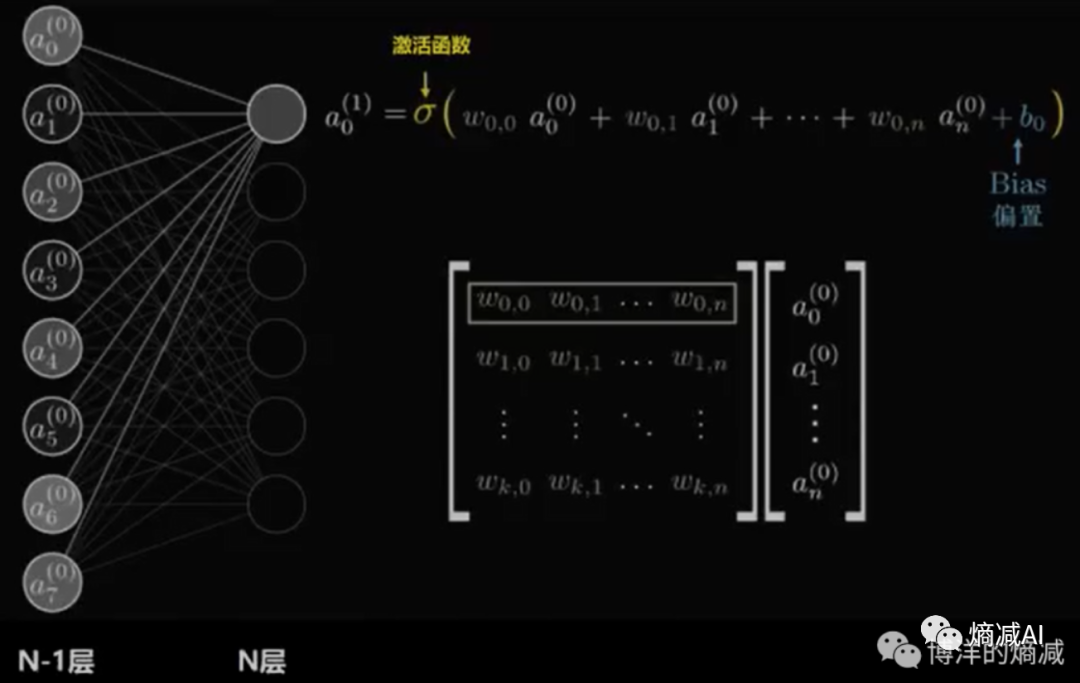

我们先看一张老图(我用了10多遍了),神经网络说白了,就是矩阵的乘法和加法,矩阵运算起来容易些

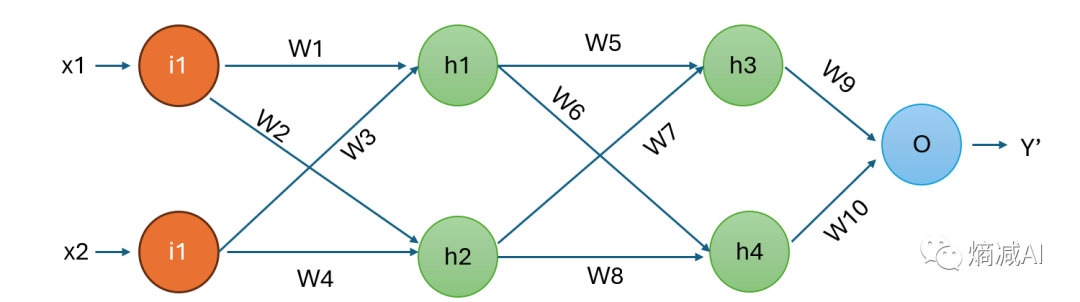

我们再把这个图抽象成几个神经元的网络,如下图

设我们的原始函数为Y=F(x)=wix1+wi'

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1718

1718

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?