本次作业分两个部分:

一、在茴香豆的web端创建自己领域的知识问答助手

二、在开发机上部署茴香豆技术助手

作业完成情况:

一、在茴香豆的web端创建自己领域的知识问答助手

我在豆哥上想创建一个关于星座相关的知识库的问答,导入了2篇相关的文档,分别尝试了pdf和word,测试下来,word文档豆哥理解力更强一些;同时也尝试了繁体字的文档,豆哥的识别度不高,很多问题没法回答,当然也有可能是竖排版的原因。但是,能通过输入的内容,能马上搭建起环境,回答与上传文档相关的问题,并形成互动,非常的厉害了。有些回答的不好,可能和我的提问方式也有关系,建议可以开设一门如何向豆哥提问的课程,帮助大家可以更好的跟豆哥进行互动。

以下是web端操作的具体步骤:

有些问题还是报错的,无法回答,简单的概括大意,名称解释是能够做到的,理解的深度还是需要再加强的,当然也有可能是我提问的方式不规范~

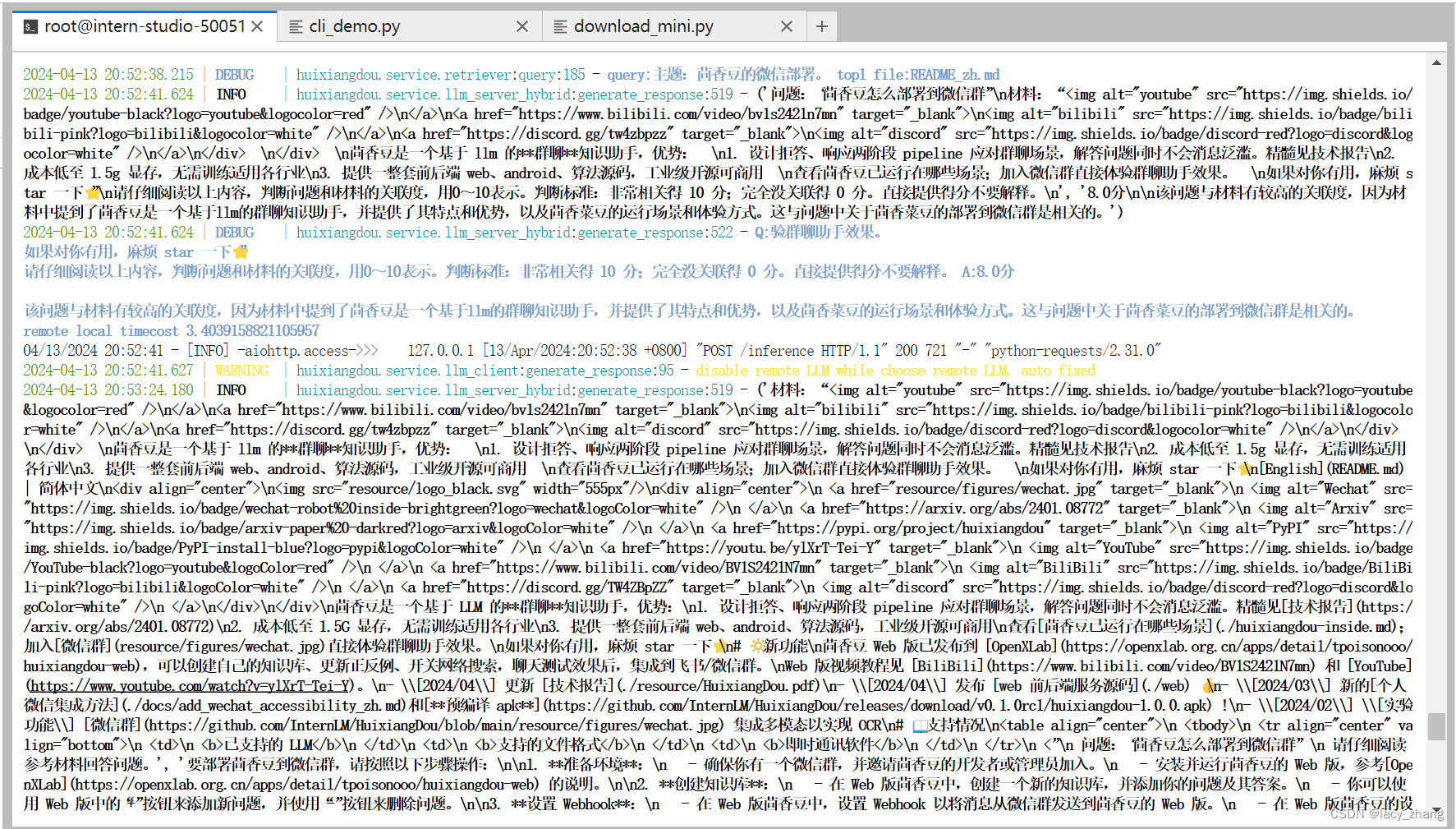

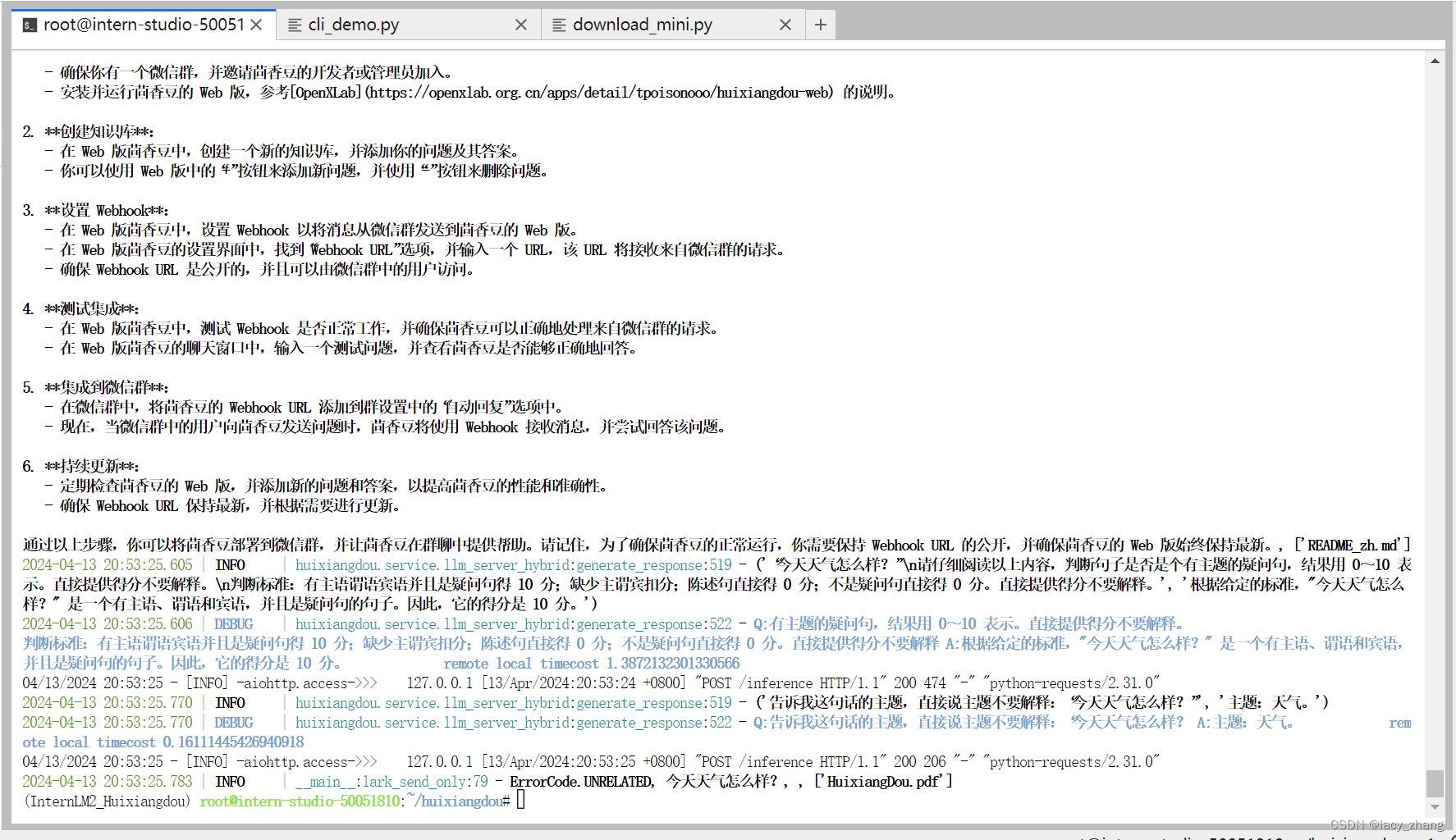

二、在开发机上部署茴香豆技术助手

RAG(Retrieval Augmented Generation)技术,通过检索与用户输入相关的信息片段,并结合外部知识库来生成更准确、更丰富的回答。解决 LLMs 在处理知识密集型任务时可能遇到的挑战, 如幻觉、知识过时和缺乏透明、可追溯的推理过程等。提供更准确的回答、降低推理成本、实现外部记忆。

RAG 能够让基础模型实现非参数知识更新,无需训练就可以掌握新领域的知识。本次课程选用的茴香豆应用,就应用了 RAG 技术,可以快速、高效的搭建自己的知识领域助手。

检索过程中,茴香豆会将输入问题与两个列表中的问题在向量空间进行相似性比较,判断该问题是否应该回答,避免群聊过程中的问答泛滥。确定的回答的问题会利用基础模型提取关键词,在知识库中检索 top K 相似的 chunk,综合问题和检索到的 chunk 生成答案。

RAG 技术的优势就是非参数化的模型调优,这里使用的仍然是基础模型 InternLM2-Chat-7B, 没有任何额外数据的训练。面对同样的问题,我们的茴香豆技术助理能够根据我们提供的数据库生成准确的答案。

1304

1304

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?