前一阵子发现用户提交的hive query和hadoop job会导致集群的load非常高,经查看配置,发现很多用户擅自将mapred.child.java.opts设置的非常大,比如-Xmx4096m(我们默认设置是-Xmx1024m), 导致了tasktracker上内存资源耗尽,进而开始不断swap磁盘上数据,load飙升

TaskTracker在spawn一个map/reduce task jvm的时候,会根据用户JobConf里面的值设定jvm的参数,然后写入一个taskjvm.sh文件中,然后调用linux命令"bin/bash -c taskjvm.sh"来执行task,

mapred.child.java.opts就是设定jvm的参数之一,在新版本中已经标注Deprecateded,取而代之的是区分Map task和Reduce task的jvm opts,mapred.map.child.java.opts和mapred.reduce.child.java.opts(默认值为-Xmx200m)

当用户在不设该值情况下,会以最大1G jvm heap size启动task,有可能导致OutOfMemory,所以最简单的做法就是设大参数,并且由于这个值不是final,所以用户在自己的mapred-site.xml中可以覆盖默认值。但是如果很多用户都无限度设置的话,high load问题就来了。

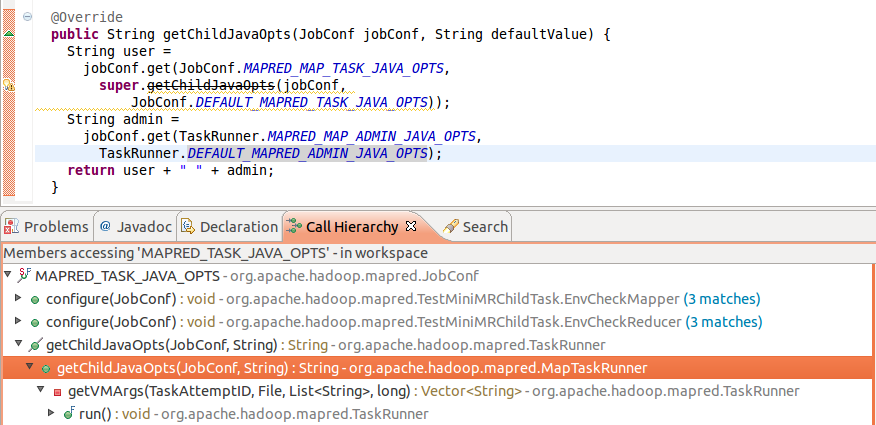

其实在构造JVM Args的过程中,是有另外一个admin参数可以覆盖用户端设置的mapreduce.admin.map.child.java.opts, mapreduce.admin.reduce.child.java.opts

经测试,如果相同的jvm arg如果写在后面,比如"-Xmx4000m -Xmx1000m",后面的会覆盖前面的,“-Xmx1000m”会最终生效,通过这种方式,我们就可以有限度的控制heap size了

最终在mapred-site.xml中加上

<property>

<name>mapreduce.admin.map.child.java.opts</name>

<value>-Xmx1024m</value>

</property>

<property>

<name>mapreduce.admin.reduce.child.java.opts</name>

<value>-Xmx1536m</value>

</property>

构造child java opts的call stack:

不过这种方式只是限定了task的jvm heap最大限制,如果用户hive query优化不够好还是会抛出OOM,其实是把问题抛给了用户,

接下来还要和用户一起看下到底是哪些query会占用如此大memory,看看有没有进一步优化的空间

本文链接http://blog.csdn.net/lalaguozhe/article/details/9076895,转载请注明

269

269

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?