参考自

简介

EM算法,即期望极大算法,用于含有隐变量的概率模型的极大似然估计或极大后验概率估计,它一般分为两步:第一步求期望(E),第二步求极大(M)。

如果概率模型的变量都是观测变量,那么给定数据之后就可以直接使用极大似然法或者贝叶斯估计模型参数。

但是当模型含有隐含变量的时候就不能简单的用这些方法来估计,EM就是一种含有隐含变量的概率模型参数的极大似然估计法。

应用到的地方:混合高斯模型、混合朴素贝叶斯模型、因子分析模型。

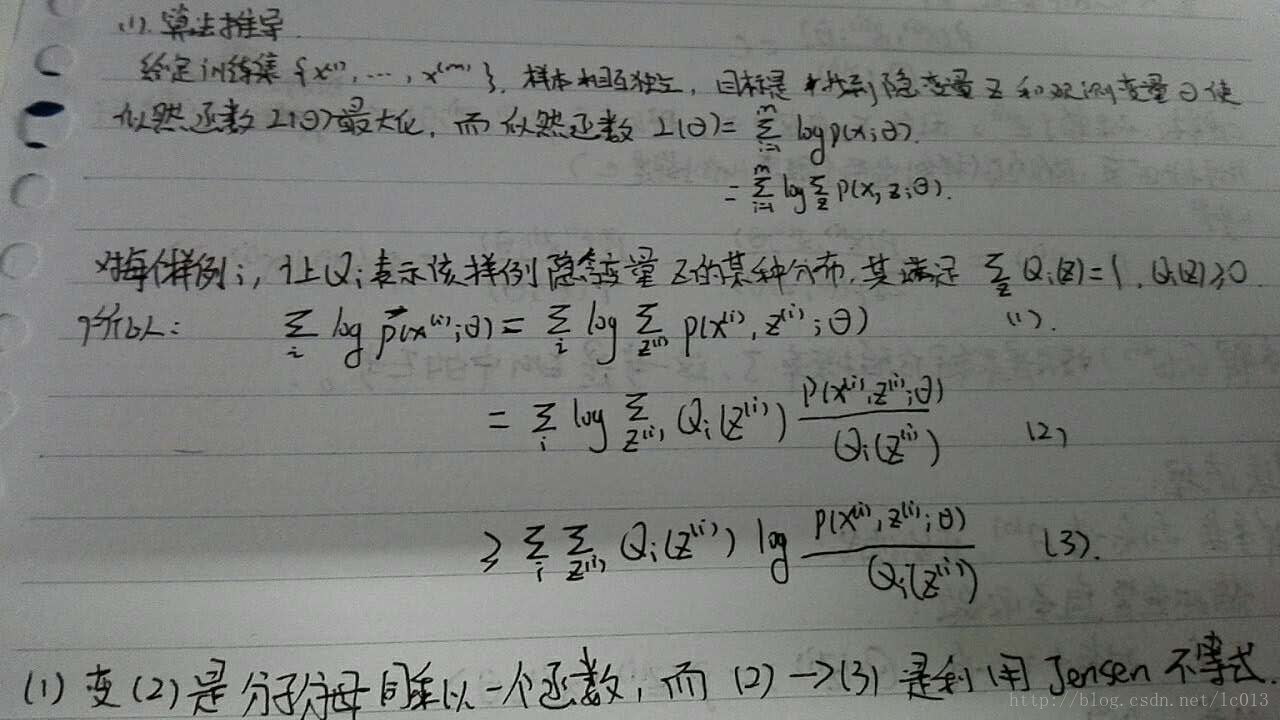

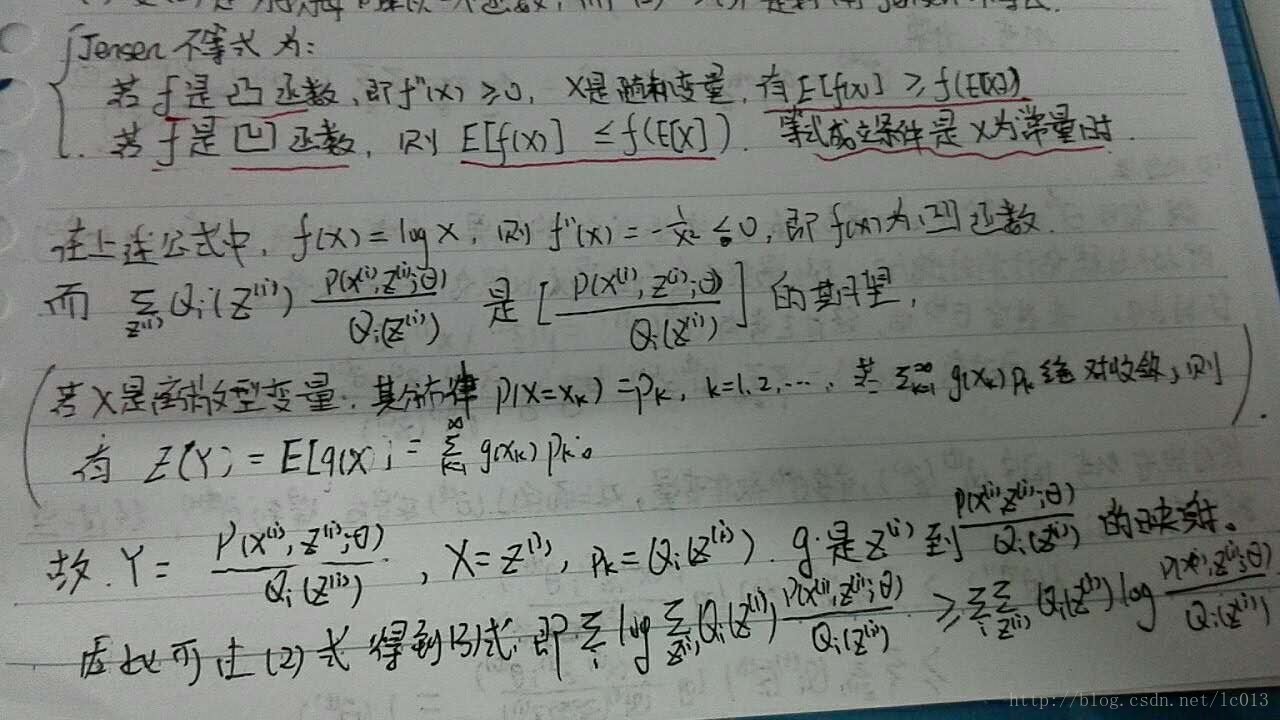

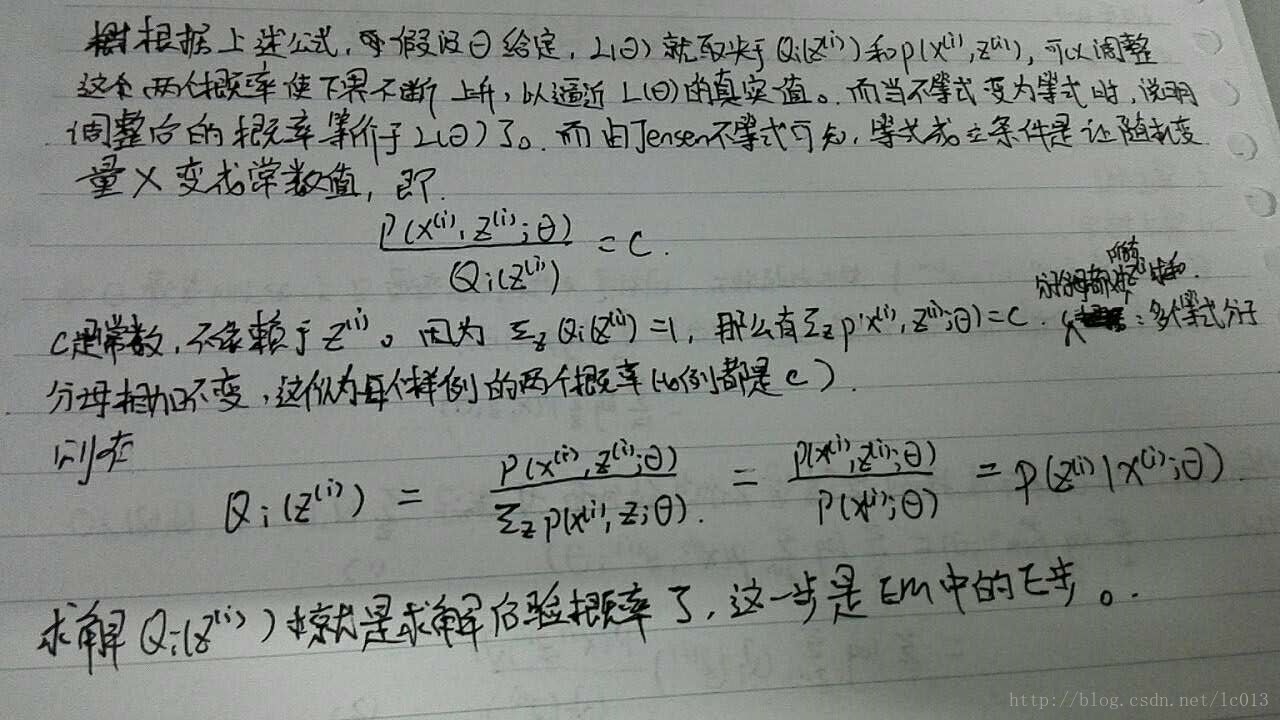

算法推导

上述公式相当于决定了 L(θ) 的下界,而EM算法实际上就是通过不断求解下界的极大化来逼近对数似然函数极大化的算法。

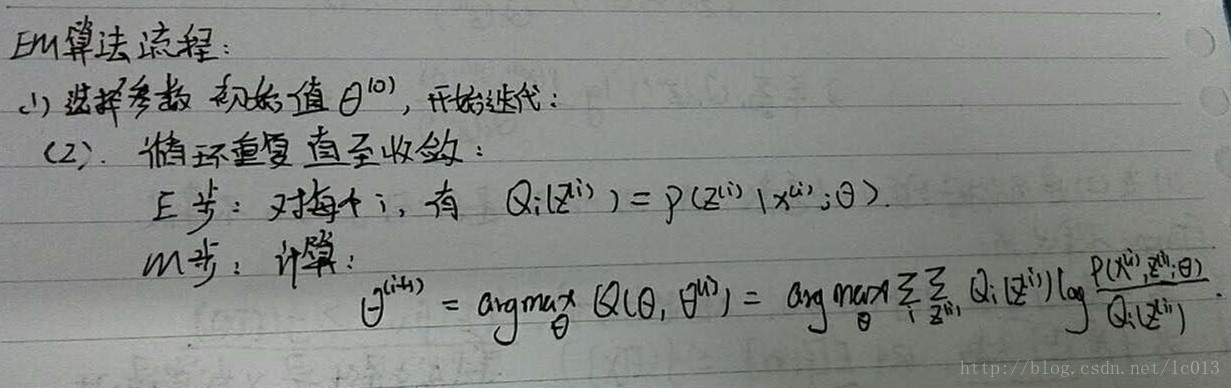

算法流程

算法流程如下所示:

收敛性

收敛性部分可以主要看(EM算法)The EM Algorithm的推导,最终可以推导得到如下公式:

L(θ(t+1))≥∑i∑ziQ(t)i(z(i))logp(x(i),z(i);

EM算法,全称期望极大算法,主要用于含有隐变量的概率模型的极大似然估计。当模型包含隐变量时,EM算法能有效地估计参数。算法流程包括E步和M步,虽然可能不保证找到全局最优解,但因其简单性和普适性被广泛应用,如在混合高斯模型中的应用。对初值敏感,常需多次迭代比较选择最佳结果。

EM算法,全称期望极大算法,主要用于含有隐变量的概率模型的极大似然估计。当模型包含隐变量时,EM算法能有效地估计参数。算法流程包括E步和M步,虽然可能不保证找到全局最优解,但因其简单性和普适性被广泛应用,如在混合高斯模型中的应用。对初值敏感,常需多次迭代比较选择最佳结果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2576

2576

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?