又是一个神器,小伙伴们搬好小板凳,准备好我要开始了。

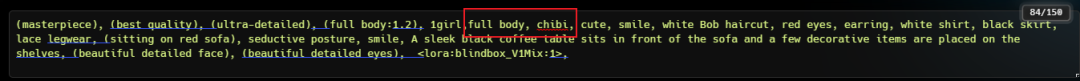

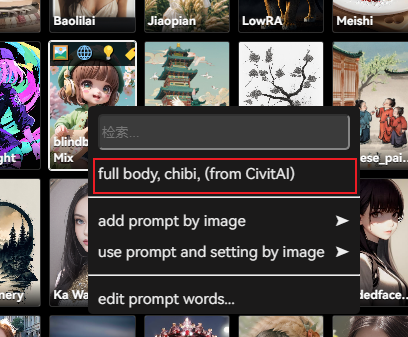

我们知道,在很多模型和lora使用的时候,是需要填写触发词的。比如这个盲盒lora,提示词就是“full body, chibi”,需要把这些触发词放到正向提示词里面才能达到想要的效果。

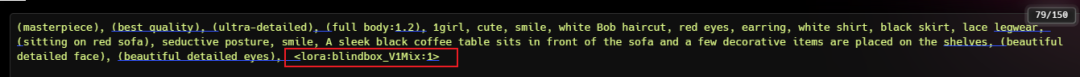

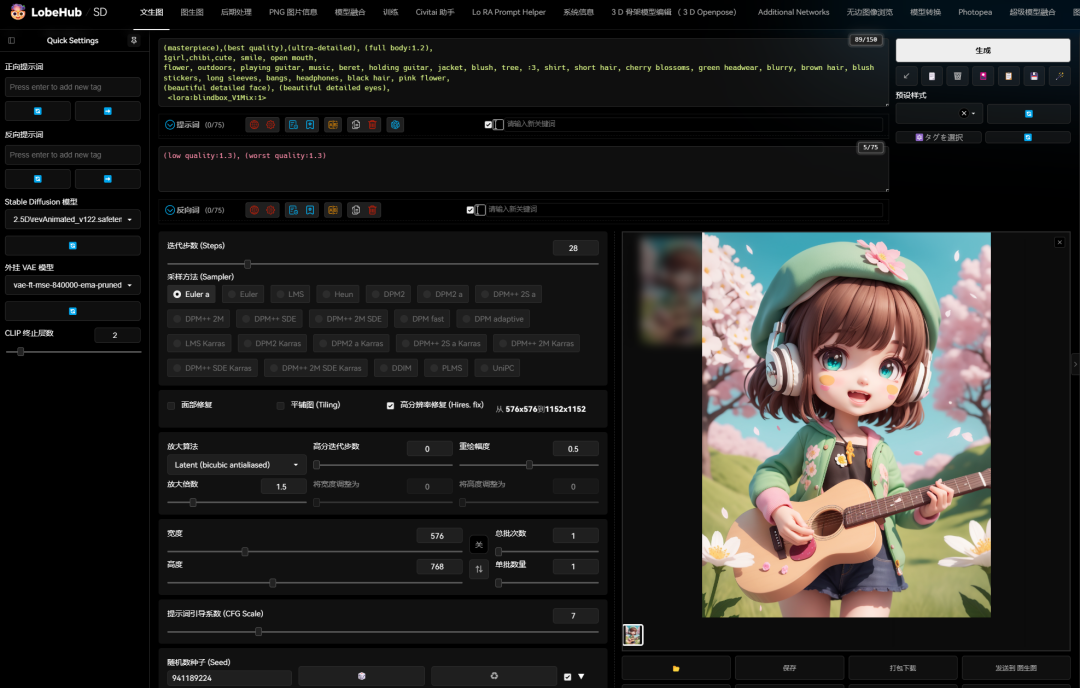

举个例子,当我们只引用lora,而不填入触发词的时候是这样的。

当我们填入特定的触发词之后,就达到了这个lora该有的效果。所以,有的时候你的成图效果不理想,有可能是因为你没有填写模型或lora的触发词。

但是,当你的模型和lora越来越多的时候,你还能记得它们的触发词吗?那肯定是不可能的。

这时候就需要我们的插件登场了,它就是——lora-prompt-tool

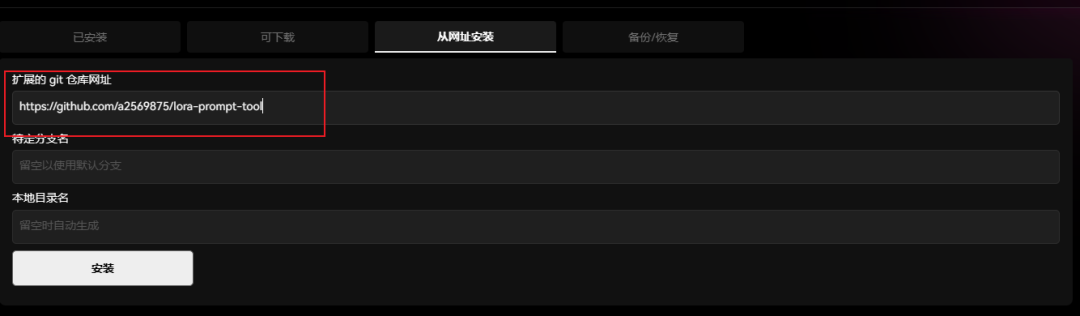

安装方式就是在扩展面板中点击“从网址安装”,然后输入以下地址https://github.com/a2569875/lora-prompt-tool,可以直接安装。

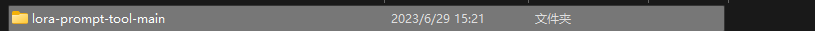

或者将我提供的插件文件夹复制到这个目录下“……\sd-webui-aki-v4\extensions”。

安装完成后,重启webUI,就装好了。

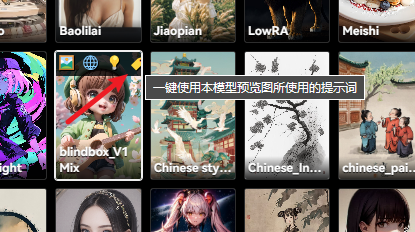

接下来,在你想要使用的lora上面点击右键,就可以看到它的触发词了,直接点击就能加载到正向提示词当中。

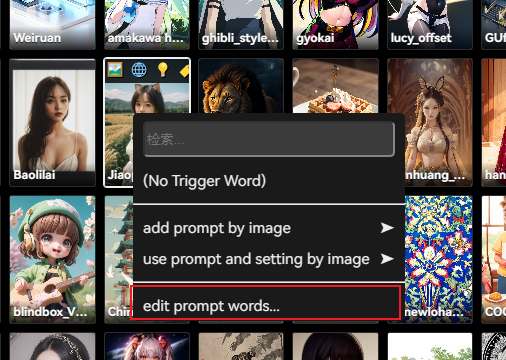

当然,并不是所有的模型或者lora都有触发词,这个时候你也可以手动编辑,给它加上你自定义的触发词。

不过,这些还不是这个插件最厉害的功能。

当我们浏览C站上这个模型/lora的主页的时候,是可以看到很多官方图的。

我们之前安装的C站助手插件,是可以将这张封面图的提示词一键导入到SD里面,这样可以帮助我们快速得到这个官方图片的效果。

而当我们安装了这个插件之后,我们就可以直接从这里看到官方的其他例图,并且可以一键将这张图所有的提示词和设置参数全部拷贝到SD中。

这样就能生成和官方图片差不多的效果了,大模型需要你自己选择好。当然这个操作的目的不是让你抄袭别人的图片,而是可以更好的学习到一些关键的提示词写法,达到事半功倍的效果。

以上就是关于大模型/Lora触发词插件lora-prompt-tool的介绍,有了它之后,我们就能更轻松的使用模型和lora了。

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

对于0基础小白入门:

如果你是零基础小白,想快速入门AI绘画是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以找到适合自己的学习方案

包括:stable diffusion安装包、stable diffusion0基础入门全套PDF,视频学习教程。带你从零基础系统性的学好AI绘画!

需要的可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1.stable diffusion安装包 (全套教程文末领取哈)

随着技术的迭代,目前 Stable Diffusion 已经能够生成非常艺术化的图片了,完全有赶超人类的架势,已经有不少工作被这类服务替代,比如制作一个 logo 图片,画一张虚拟老婆照片,画质堪比相机。

最新 Stable Diffusion 除了有win多个版本,就算说底端的显卡也能玩了哦!此外还带来了Mac版本,仅支持macOS 12.3或更高版本。

2.stable diffusion视频合集

我们在学习的时候,往往书籍代码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,一步步带你入门stable diffusion,科学有趣才能更方便的学习下去。

3.stable diffusion模型下载

stable diffusion往往一开始使用时图片等无法达到理想的生成效果,这时则需要通过使用大量训练数据,调整模型的超参数(如学习率、训练轮数、模型大小等),可以使得模型更好地适应数据集,并生成更加真实、准确、高质量的图像。

4.stable diffusion提示词

提示词是构建由文本到图像模型解释和理解的单词的过程。可以把它理解为你告诉 AI 模型要画什么而需要说的语言,整个SD学习过程中都离不开这本提示词手册。

5.AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

这份完整版的学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

3647

3647

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?