作者: July、pluskid ; 致谢:白石、J erryLead

支持向量机通俗导论(理解SVM的三层境界)

出处:结构之法算法之道 blog 。

前言

第一层、了解SVM

1.0、什么是支持向量机SVM

1.1、线性分类

1.1.1、分类标准

1.1.2、1或-1分类标准的起源:logistic回归

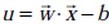

的图像是

的图像是

,发现

,发现

只和

只和

有关,

有关,

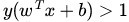

>0,那么

>0,那么

,g(z)只不过是用来映射,真实的类别决定权还在

,g(z)只不过是用来映射,真实的类别决定权还在

。还有当

。还有当

,

,

=1,反之

=1,反之

。Logistic回归就是要学习得到

。Logistic回归就是要学习得到

,使得正例的特征远大于0,负例的特征远小于0,强调在全部训练实例上达到这个目标。

,使得正例的特征远大于0,负例的特征远小于0,强调在全部训练实例上达到这个目标。

1.1.3、形式化标示

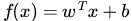

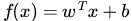

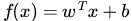

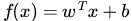

替换成w和b。以前的

替换成w和b。以前的

,其中认为

,其中认为

。现在我们替换

。现在我们替换

为

为

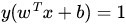

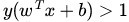

)。这样,我们让

)。这样,我们让

,进一步

,进一步

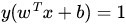

的正负问题,而不用关心g(z),因此我们这里将g(z)做一个简化,将其简单映射到y=-1和y=1上。映射关系如下:

的正负问题,而不用关心g(z),因此我们这里将g(z)做一个简化,将其简单映射到y=-1和y=1上。映射关系如下:

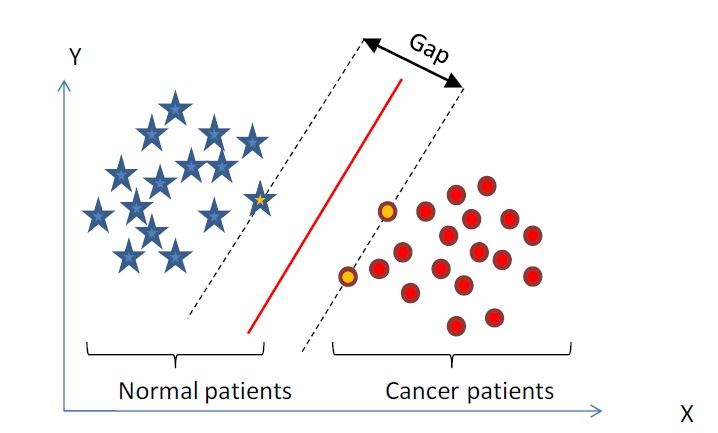

1.2、线性分类的一个例子

,与我们之前定义的

,与我们之前定义的 实质是一样的。为什么?因为无论是

实质是一样的。为什么?因为无论是 ,还是

,还是 ,不影响最终优化结果。下文你将看到,当我们转化到优化

,不影响最终优化结果。下文你将看到,当我们转化到优化

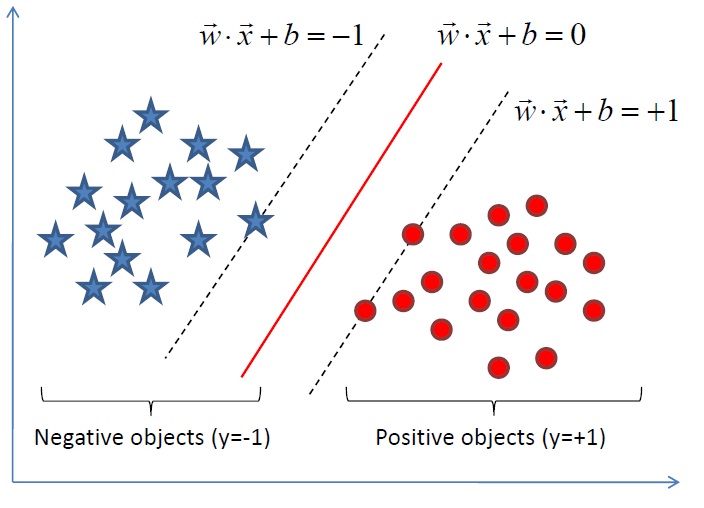

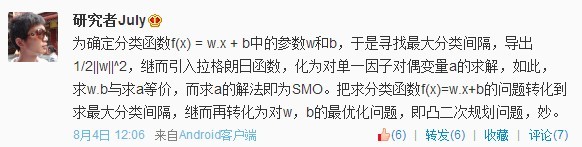

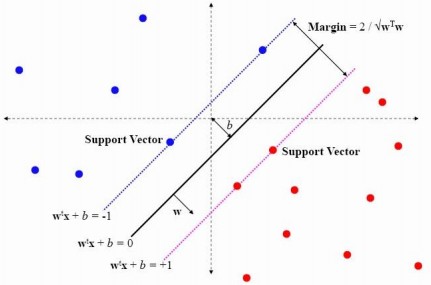

- 咱们就要确定上述分类函数f(x) = w.x + b(w.x表示w与x的内积)中的两个参数w和b,通俗理解的话w是法向量,b是截距(再次说明:定义特征到结果的输出函数

,与我们最开始定义的

实质是一样的);

- 那如何确定w和b呢?答案是寻找两条边界端或极端划分直线中间的最大间隔(之所以要寻最大间隔是为了能更好的划分不同类的点,下文你将看到:为寻最大间隔,导出1/2||w||^2,继而引入拉格朗日函数和对偶变量a,化为对单一因数对偶变量a的求解,当然,这是后话),从而确定最终的最大间隔分类超平面hyper plane和分类函数;

- 进而把寻求分类函数f(x) = w.x + b的问题转化为对w,b的最优化问题,最终化为对偶因子的求解。

1.3、函数间隔Functional margin与几何间隔Geometrical margin

- 在超平面w*x+b=0确定的情况下,|w*x+b|能够相对的表示点x到距离超平面的远近,而w*x+b的符号与类标记y的符号是否一致表示分类是否正确,所以,可以用量y*(w*x+b)的正负性来判定或表示分类的正确性和确信度。

1.3.1、函数间隔Functional margin

=

min i

(i=1,...n)

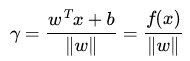

1.3.2、点到超平面的距离定义:几何间隔Geometrical margin

γ

(有的书上会写成把||w||分开相除的形式,如本文参考文献及推荐阅读条目11,其中,||w||为w的二阶泛数)

1.4、最大间隔分类器Maximum Margin Classifier的定义

1、functional margin 明显是不太适合用来最大化的一个量,因为在 hyper plane 固定以后,我们可以等比例地缩放

2、而 geometrical margin 则没有这个问题,因为除上了

1.5、到底什么是Support Vector

第二层、深入SVM

2.1、从线性可分到线性不可分

2.1.1、从原始问题到对偶问题的求解

的最大值相当于求

的最大值相当于求

的最小值,所以上述问题等价于(w由分母变成分子,从而也有原来的max问题变为min问题,很明显,两者问题等价):

的最小值,所以上述问题等价于(w由分母变成分子,从而也有原来的max问题变为min问题,很明显,两者问题等价):

- 转化到这个形式后,我们的问题成为了一个凸优化问题,或者更具体的说,因为现在的目标函数是二次的,约束条件是线性的,所以它是一个凸二次规划问题。这个问题可以用任何现成的

QP (Quadratic Programming) 的优化包进行求解,归结为一句话即是:在一定的约束条件下,目标最优,损失最小; - 但虽然这个问题确实是一个标准的 QP 问题,但是它也有它的特殊结构,通过

Lagrange Duality 变换到对偶变量 (dual variable) 的优化问题之后,可以找到一种更加有效的方法来进行求解,而且通常情况下这种方法比直接使用通用的 QP 优化包进行优化要高效得多。

,亦即我们最初要最小化的量。因此,在要求约束条件得到满足的情况下最小化

,实际上等价于直接最小化

2.1.2、KKT条件

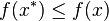

- 凸优化的概念:

为一凸集,

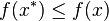

为一凸函数。凸优化就是要找出一点

,使得每一

满足

。 - KKT条件的意义:它是一个非线性规划(Nonlinear Programming)问题能有最优化解法的必要和充分条件。

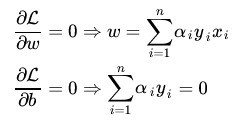

2.1.3、对偶问题求解的3个步骤

,根据

,

,即可求出w。然后通过

,即可求出b

,即可求出b

和

和

的具体由来请查看下文第2.3节)。

的具体由来请查看下文第2.3节)。

2.1.5、线性不可分的情况

作者: July、pluskid ; 致谢:白石、J erryLead

支持向量机通俗导论(理解SVM的三层境界)

出处:结构之法算法之道 blog 。

前言

第一层、了解SVM

1.0、什么是支持向量机SVM

1.1、线性分类

1.1.1、分类标准

1.1.2、1或-1分类标准的起源:logistic回归

的图像是

的图像是

,发现

,发现

只和

只和

有关,

有关,

>0,那么

>0,那么

,g(z)只不过是用来映射,真实的类别决定权还在

,g(z)只不过是用来映射,真实的类别决定权还在

。还有当

。还有当

,

,

=1,反之

=1,反之

。Logistic回归就是要学习得到

。Logistic回归就是要学习得到

,使得正例的特征远大于0,负例的特征远小于0,强调在全部训练实例上达到这个目标。

,使得正例的特征远大于0,负例的特征远小于0,强调在全部训练实例上达到这个目标。

1.1.3、形式化标示

替换成w和b。以前的

替换成w和b。以前的

,其中认为

,其中认为

。现在我们替换

。现在我们替换

为

为

)。这样,我们让

)。这样,我们让

,进一步

,进一步

的正负问题,而不用关心g(z),因此我们这里将g(z)做一个简化,将其简单映射到y=-1和y=1上。映射关系如下:

的正负问题,而不用关心g(z),因此我们这里将g(z)做一个简化,将其简单映射到y=-1和y=1上。映射关系如下:

1.2、线性分类的一个例子

,与我们之前定义的

,与我们之前定义的 实质是一样的。为什么?因为无论是

实质是一样的。为什么?因为无论是 ,还是

,还是 ,不影响最终优化结果。下文你将看到,当我们转化到优化

,不影响最终优化结果。下文你将看到,当我们转化到优化

- 咱们就要确定上述分类函数f(x) = w.x + b(w.x表示w与x的内积)中的两个参数w和b,通俗理解的话w是法向量,b是截距(再次说明:定义特征到结果的输出函数

,与我们最开始定义的

实质是一样的);

- 那如何确定w和b呢?答案是寻找两条边界端或极端划分直线中间的最大间隔(之所以要寻最大间隔是为了能更好的划分不同类的点,下文你将看到:为寻最大间隔,导出1/2||w||^2,继而引入拉格朗日函数和对偶变量a,化为对单一因数对偶变量a的求解,当然,这是后话),从而确定最终的最大间隔分类超平面hyper plane和分类函数;

- 进而把寻求分类函数f(x) = w.x + b的问题转化为对w,b的最优化问题,最终化为对偶因子的求解。

1.3、函数间隔Functional margin与几何间隔Geometrical margin

- 在超平面w*x+b=0确定的情况下,|w*x+b|能够相对的表示点x到距离超平面的远近,而w*x+b的符号与类标记y的符号是否一致表示分类是否正确,所以,可以用量y*(w*x+b)的正负性来判定或表示分类的正确性和确信度。

1.3.1、函数间隔Functional margin

=

min i

(i=1,...n)

1.3.2、点到超平面的距离定义:几何间隔Geometrical margin

γ

(有的书上会写成把||w||分开相除的形式,如本文参考文献及推荐阅读条目11,其中,||w||为w的二阶泛数)

1.4、最大间隔分类器Maximum Margin Classifier的定义

1、functional margin 明显是不太适合用来最大化的一个量,因为在 hyper plane 固定以后,我们可以等比例地缩放

2、而 geometrical margin 则没有这个问题,因为除上了

1.5、到底什么是Support Vector

第二层、深入SVM

2.1、从线性可分到线性不可分

2.1.1、从原始问题到对偶问题的求解

的最大值相当于求

的最大值相当于求

的最小值,所以上述问题等价于(w由分母变成分子,从而也有原来的max问题变为min问题,很明显,两者问题等价):

的最小值,所以上述问题等价于(w由分母变成分子,从而也有原来的max问题变为min问题,很明显,两者问题等价):

- 转化到这个形式后,我们的问题成为了一个凸优化问题,或者更具体的说,因为现在的目标函数是二次的,约束条件是线性的,所以它是一个凸二次规划问题。这个问题可以用任何现成的

QP (Quadratic Programming) 的优化包进行求解,归结为一句话即是:在一定的约束条件下,目标最优,损失最小; - 但虽然这个问题确实是一个标准的 QP 问题,但是它也有它的特殊结构,通过

Lagrange Duality 变换到对偶变量 (dual variable) 的优化问题之后,可以找到一种更加有效的方法来进行求解,而且通常情况下这种方法比直接使用通用的 QP 优化包进行优化要高效得多。

,亦即我们最初要最小化的量。因此,在要求约束条件得到满足的情况下最小化

,实际上等价于直接最小化

2.1.2、KKT条件

- 凸优化的概念:

为一凸集,

为一凸函数。凸优化就是要找出一点

,使得每一

满足

。 - KKT条件的意义:它是一个非线性规划(Nonlinear Programming)问题能有最优化解法的必要和充分条件。

2.1.3、对偶问题求解的3个步骤

,根据

,

,即可求出w。然后通过

,即可求出b

,即可求出b

和

和

的具体由来请查看下文第2.3节)。

的具体由来请查看下文第2.3节)。

2.1.5、线性不可分的情况

1279

1279

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?