1、flume写入hdfs报错后自动恢复

如果并发量 x 128M(blocksize)x 2 > 磁盘剩余空间,会导致flume写入失败。

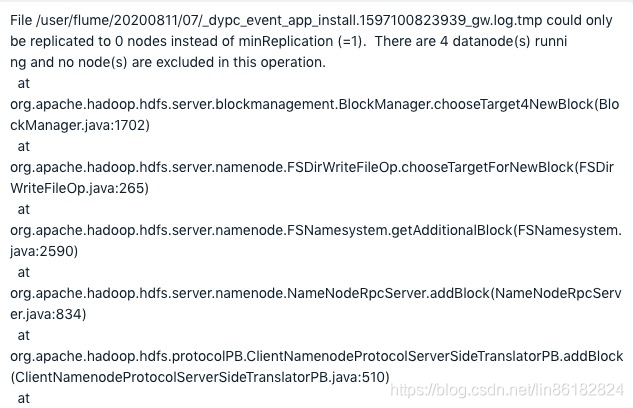

从DataNode的日志里看到从06:50 - 07:10这20分钟内写入了超过一万个block,一个block需要的空间是128M,所以会申请超过1TB的存储空间。从发的dfs report来看 emr-worker-1节点只有 368GB剩余空间,所以会导致空间不足(结果是 There are 4 datanode(s) running and no node(s) are excluded in this operation.)。

小文件写完了就不用占128M,但是在写入过程中会以128M 预留空间,如果同时并发写入(但不关闭文件)就会产生这个问题。如果1万个文件是顺序写入,就没问题。

解决方案:一个是扩容,另外一个是降低业务的并发写入量。

【FLUME】问题汇总(持续更新)

最新推荐文章于 2023-06-15 17:43:39 发布

当并发写入HDFS的文件数量过大,导致磁盘空间不足时,Flume会遇到写入失败的问题。日志显示在短时间内写入大量block,超过了节点的剩余空间。解决方案包括扩容磁盘和降低并发写入量。

当并发写入HDFS的文件数量过大,导致磁盘空间不足时,Flume会遇到写入失败的问题。日志显示在短时间内写入大量block,超过了节点的剩余空间。解决方案包括扩容磁盘和降低并发写入量。

447

447

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?