k-近邻算法(kNN)采用测量不同特征值之间的距离对数据集进行分类,数据范围主要为数值型和标称型,基本工作原理如下:

存在一个样本数据集合,也称训练样本集,并且样本集中每个数据都存在标签,即我们知道样本集中每一数据与所属分类的对应关系(属于监督学习,因为我们知道了样本数据对应的结果)。一个算法通过对这些训练样本集训练基本稳定后,就可以使用它了,我们输入没有标签的新数据后,将新数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本集中特征最相似数据(最近邻)的分类标签,一般只选择样本数据集中前k(k通常为不大于20的整数)个最相似的数据,然后,选择k个最相似数据中出现次数最多的分类,作为该次输入新数据的分类。

优点:

精度高、对异常值不敏感、无数据输入假定

缺点:

计算复杂度高、空间复杂度高

背景准备

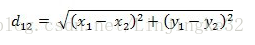

二维平面上两点距离的计算公式:

简单kNN分类器示例

#!/usr/bin/env python3

# -*- coding: utf-8 -*-

"""

Created on Tue Oct 17 20:00:41 2017

kNN算法测试

@author: LinJK

"""

from numpy import *

import operator

# 生成简易测试数据

def createDataSet():

group = array([[1.0, 1.1],

[1.0, 1.0],

[0, 0],

[0, 0.1]])

labels = ['A', 'A', 'B', 'B']

return group, labels

# inX: 用于分类的输入向量

# dataSet: 训练样本集

# labels: 标签向量(元素数与dataSet行数一样!)

# k: 选择最近邻居的数目

def classify0(inX, dataSet, labels, k):

# Step1: 距离计算

dataSetSize = dataSet.shape[0] # dataSet的行数

tmp = tile(inX, (dataSetSize, 1)) # 把输入向量inX扩展成与group一样的维度

diffMat = tmp - dataSet # 对应元素相减,即每个元素间距离

sqDiffMat = diffMat**2 # 矩阵点乘(每个元素计算平方值)

sqDistances = sqDiffMat.sum(axis=1) # 矩阵每行两个元素相加的值组成的行向量

distances = sqDistances**0.5 # 平方根计算,得到每个距离组成的行向量

print('distances: ', distances)

# Step2: 选择距离最小的k个点

sortedDistIndicies = distances.argsort() # 元素从小到大排列,提取对应索引到sortedDistIndicies

print('sortedDistIndicies: ', sortedDistIndicies)

classCount={}

for i in range(k):

voteILabel = labels[sortedDistIndicies[i]]

print('voteILabel: ', voteILabel)

classCount[voteILabel] = classCount.get(voteILabel,0) + 1

print('classCount[voteILabel]: ', classCount[voteILabel])

print('classCount.items(): ', classCount.items())

sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True)

return sortedClassCount[0][0]

group,labels = createDataSet()

print( classify0([1,2], group, labels, 3) )

543

543

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?