一、信息论

克劳德·香农(Claude Shannon),美国数学家、电子工程师和密码学家,被誉为信息论的创始人。

信息论是在信息可以量度的基础上,研究有效和可靠的传递信息的科学,它涉及信息量度、信息特性、信息传输速率、信道容量、干扰对信息传输的影响等方面的知识。

二、信息量

信息量是对信息的度量。

多少信息用信息量来衡量,我们接受到的信息量跟具体发生的事件有关。

信息的大小跟随机事件的概率有关。越小概率的事情发生了产生的信息量越大,如湖南产生的地震了;越大概率的事情发生了产生的信息量越小,如太阳从东边升起来了(肯定发生嘛,没什么信息量)。

信息量的公式如下:

三、信息熵

熵是表示随机变量不确定性的度量。

信息熵是衡量随机变量分布的混乱程度,是随机分布各事件发生的信息量的期望值,随机变量的取值个数越多,状态数也就越多,信息熵就越大,混乱程度就越大。当随机分布为均匀分布时,熵最大;信息熵推广到多维领域,则可得到联合信息熵。

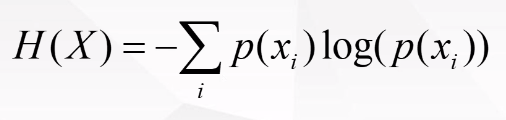

信息量度量的是一个具体事件发生了所带来的信息,而熵则是在结果出来之前对可能产生的信息量的期望,考虑该随机变量的所有可能取值,即所有可能发生事件所带来的信息量的期望。即为下面的公式:

(P(xi)代表随机事件X为 xi的概率.)

下图为概率和熵之间的关系:

信息熵还可以作为一个系统复杂程度的度量,如果系统越复杂,出现不同情况的种类越多,那么他的信息熵是比较大的。

如果一个系统越简单,出现情况种类很少(极端情况为1种情况,那么对应概率为1,那么对应的信息熵为0),此时的信息熵较小。

熵越大,随机变量的不确定越大。

四:条件熵

条件熵:定义为X给定条件下,Y的条件概率分布的熵对X的数学期望。

条件熵H(Y|X)表示在已知随机变量X的条件下随机变量Y的不确定性。随机变量X给定的条件下随机变量Y的条件熵H(Y|X)。

其中公式推导如下:

这个条件熵,是指在给定某个数(某个变量为某个值)的情况下,另一个变量的熵是多少,变量的不确定性是多少。 因为条件熵中X也是一个变量,意思是在一个变量X的条件下(变量X的每个值都会取),另一个变量Y熵对X的期望。

五:相对熵(KL散度)

设 p(x)、q(x) 是 离散随机变量 X 中取值的两个概率分布,则 p 对 q 的相对熵是:

KL散度的性质如下:

- 如果 p(x) 和 q(x) 两个分布相同,那么相对熵等于0。

- DKL(p||q)≠DKL(q||p) ,相对熵具有不对称性。

- DKL(p||q)≥0

KL散度公式推导:

(左半部分为信息熵H(x),右半部分为交叉熵js)

KL散度的作用是衡量两个分布之间的差异性。相对熵可以用来衡量两个概率分布之间的差异,上面公式的意义就是求 p 与 q 之间的对数差在 p 上的期望值。

六、交叉熵

如果使用非真实分布 q(x) 表示来自真实分布 p(x) 的平均编码长度,则是:H(p,q)=∑p(x)log1/q(x)。(因为用 q(x) 来编码的样本来自于分布 q(x) ,所以 H(p,q) 中的概率是 p(x))。此时就将 H(p,q) 称之为交叉熵。

交叉熵的公式:

(在类别确定的情况下,衡量两个分布之间的差异。)

交叉熵可以来衡量在给定的真实分布下,使用非真实分布所指定的策略消除系统的不确定性所需要付出的努力的大小。(衡量两堆真实数据分布之间的距离,是离散值,标签是稀疏的one-hot)。

七、互信息

互信息的公式如下:

互信息I (X; Y) 是在知道了Y 的值后X 的不确定性的减少量。即Y 的值透露了多少关于X 的信息量.

举个例子,假设H(X)用一块糖来表示,Y代表一杯水,H(X|Y)也就是将这杯水倒在糖上,H(X)还剩多少,那么溶于水的那部分糖就是Y给H(X)带来的损失,即就是互信息。

八、联合熵

联合熵就是度量一个联合分布的随机系统的不确定度。

联合熵的物理意义:观察一个多个随机变量的随机系统获得的信息量。

九、互信息、联合熵、条件熵的关系

从图中可以看出,条件熵可以通过联合熵( H(X|Y) = H(X, Y) - H(Y) )表示,也可以通过熵 - 互信息( H(X|Y) = H(X) - I(X; Y) )表示。

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?