学习心得:神经网络模型训练实践

摘要

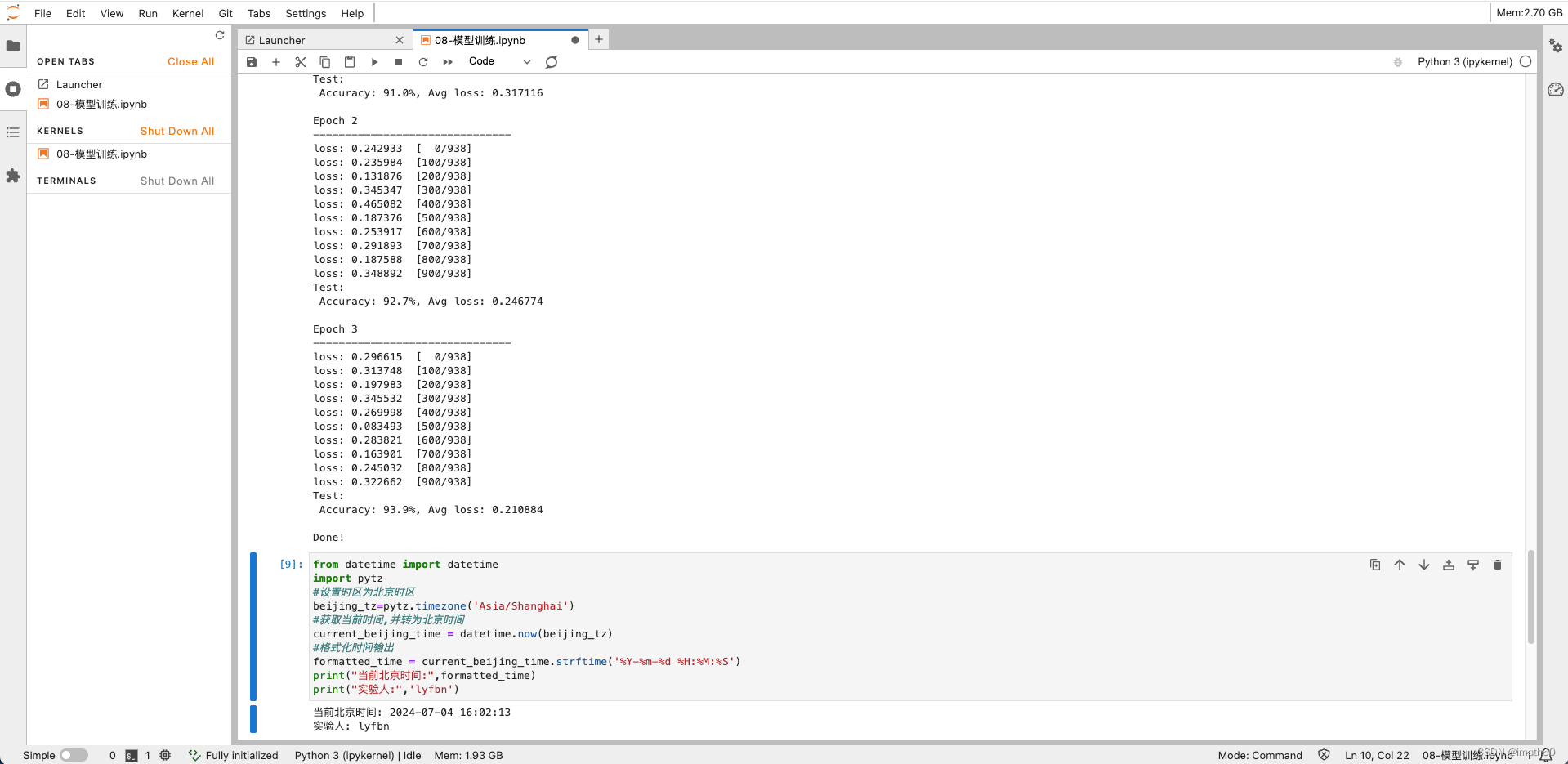

本文通过MindSpore框架,介绍了如何进行神经网络模型的训练和评估。从数据集的构建到模型定义,再到超参数设置、损失函数和优化器的选择,最后通过训练和测试循环来优化和评估模型性能。通过三轮训练,模型的准确率从91.0%提升至93.9%,平均损失从0.317116降低到0.210884,展示了模型训练过程中性能的显著提升。

文章大纲

-

模型训练概述

- 构建数据集

- 定义神经网络模型

- 超参数、损失函数和优化器的定义

- 训练与评估流程

-

构建数据集

- 使用MnistDataset和相关transforms进行数据预处理

- 数据集划分为训练集和测试集

-

定义神经网络模型

- 构建一个简单的多层全连接网络

- 使用

nn.SequentialCell组织网络层

-

超参数、损失函数和优化器

- 训练轮次、批次大小和学习率的设定

- 选择

nn.CrossEntropyLoss作为损失函数 - 使用SGD优化器进行参数更新

-

训练与评估

- 定义

train_step和test_loop函数 - 循环迭代进行模型训练和性能评估

- 定义

-

训练过程与结果

- 展示三轮训练过程中的损失和准确率变化

- 分析模型性能的提升

总结

本文通过具体的代码示例,详细阐述了使用MindSpore进行神经网络训练的步骤。从数据准备到模型构建,再到超参数调整和训练循环,每一步都对最终模型性能有着重要影响。通过迭代训练,模型的准确率和损失得到了显著优化,验证了训练流程的有效性。此外,本文还提供了对训练过程中关键参数调整的见解,为读者在进行类似任务时提供了宝贵的参考。

767

767

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?