目录

1.部署所需环境

- JDK

- zookeeper

- hadoop

2.解压,配置环境变量

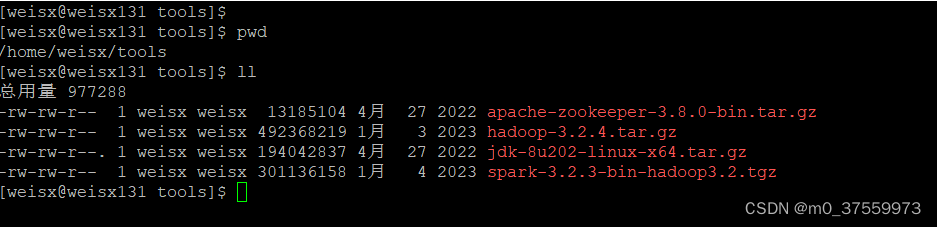

1 )拷贝Spark安装包到01节点~/tools/目录

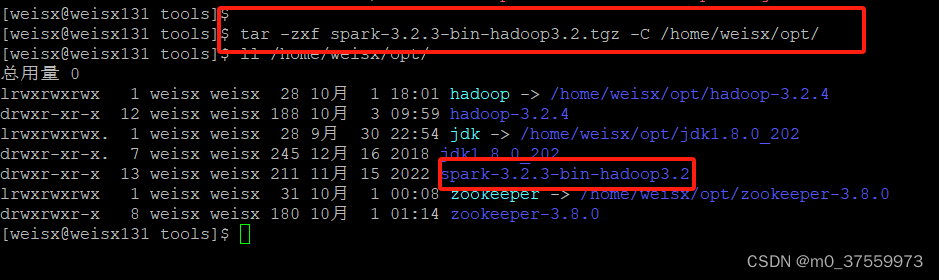

2)解压到~/opt/目录

tar -zxf spark-3.2.3-bin-hadoop3.2.tgz -C /home/weisx/opt/

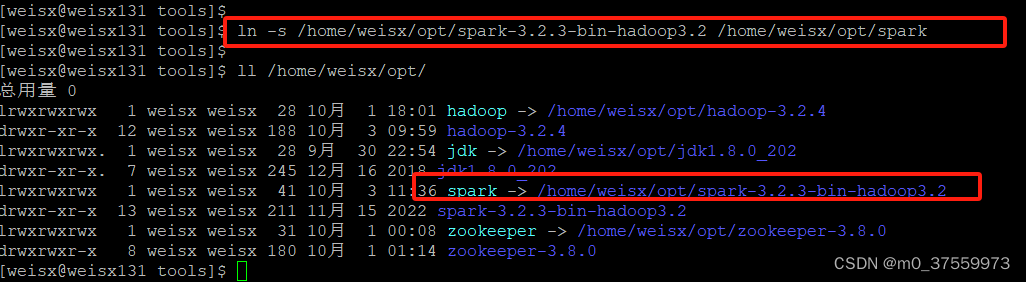

3)创建Spark软链接

ln -s /home/weisx/opt/spark-3.2.3-bin-hadoop3.2 /home/weisx/opt/spark

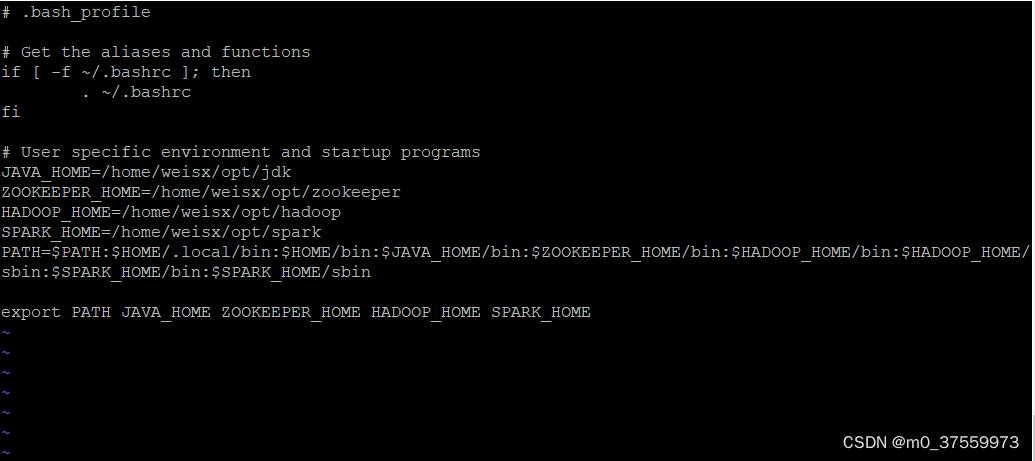

4 )配置环境变量

vi ~/.base_profile

#使环境变量生效: source ~/.bash_profile

3.配置YARN信息

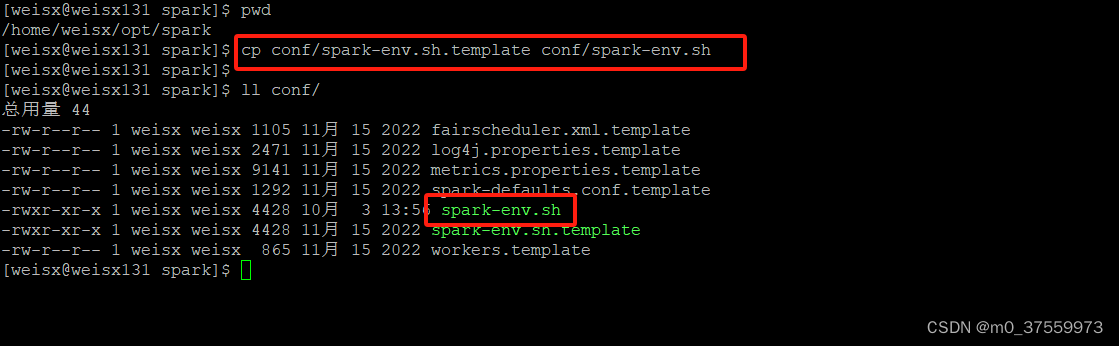

1) 将spark-env.sh.template 文件复制一份并命名为 spark-env.sh

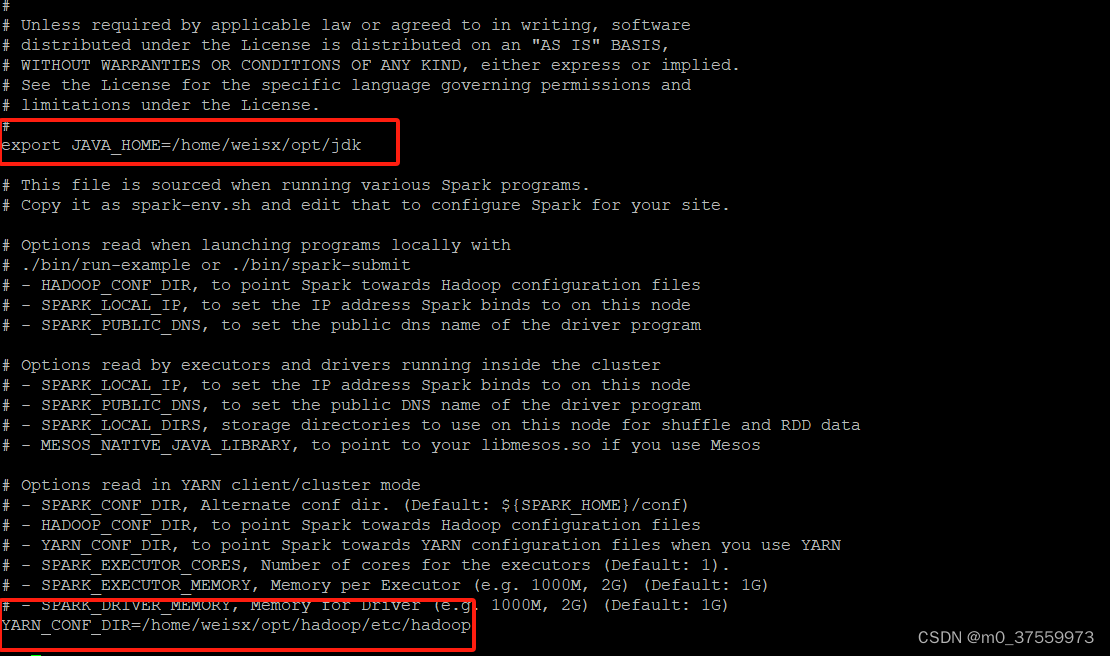

2)配置JAVA_HOME环境变量及YRAN信息

4.配置历史服务

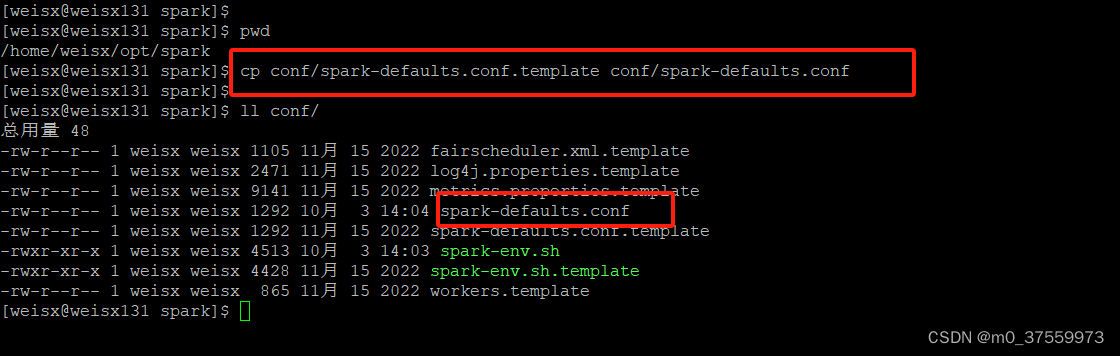

1)将spark-defaults.conf.template 文件复制一份并命名为spark-defaults.conf

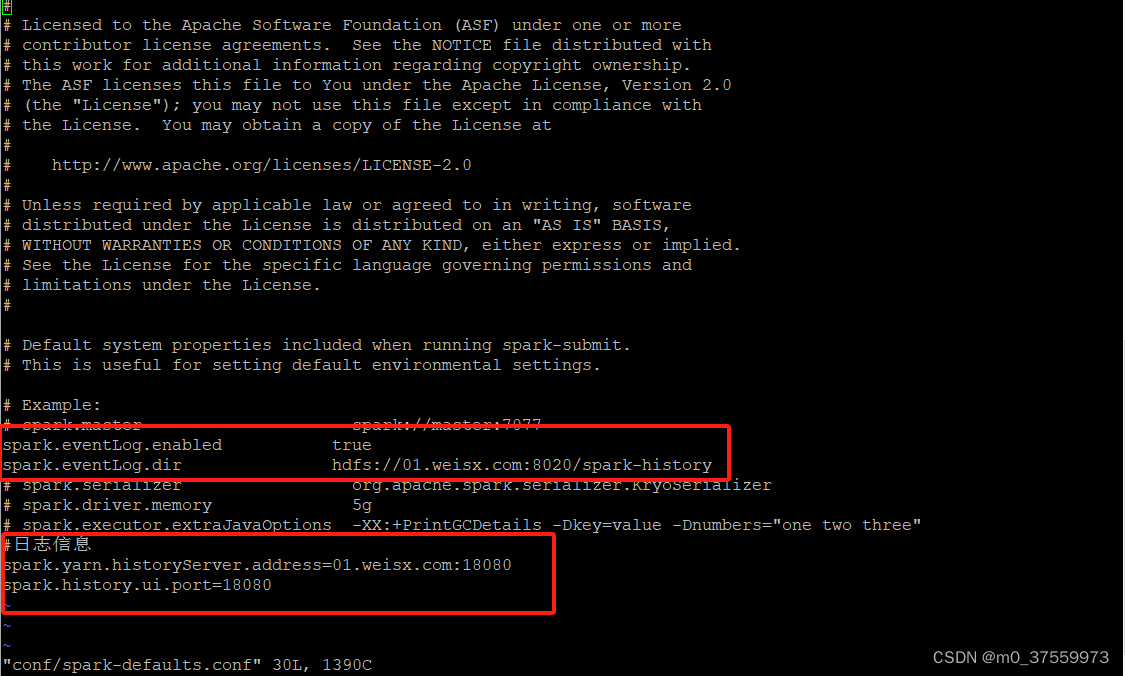

2) 修改spark-defaults.conf文件,配置日志信息

注意:hadoop的 spark-history目录需要提前创建

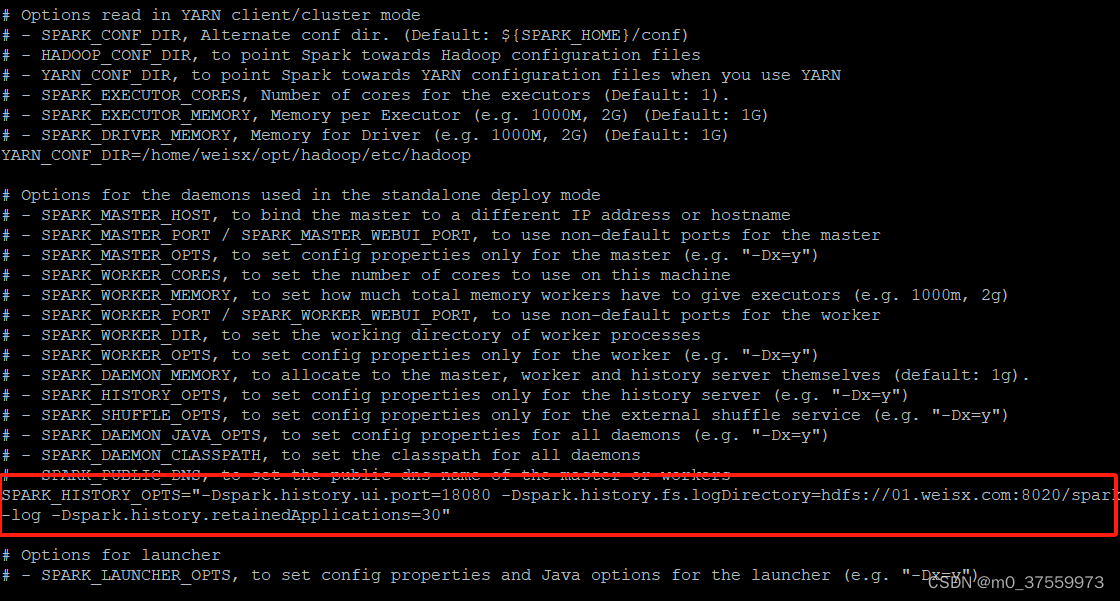

3)修改 spark-env.sh 文件, 添加日志配置

参数1:WEB UI 访问的端口号为 18080

参数2:指定历史服务器日志存储路径

参数3:指定保存 Application 历史记录的个数,如果超过这个值,旧的应用程序信息将被删除,这个是内存中的应用数,而不是页面上显示的应用数

5.测试Spark YARN集群

1)启动zookeeper和hadoop

如果已经启动跳过这一步。

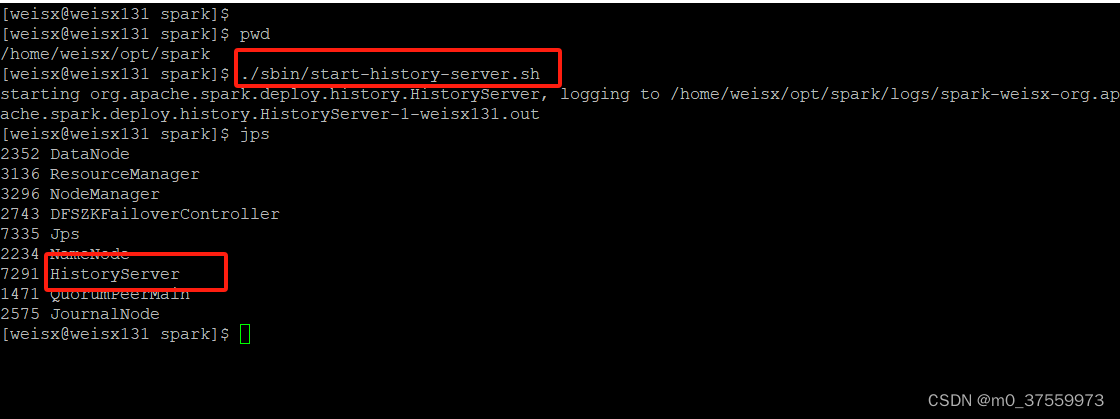

2)启动历史服务

./sbin/start-history-server.sh

3)yarn提交测试任务

./bin/spark-submit --class org.apache.spark.examples.SparkPi --master yarn --deploy-mode cluster ./examples/jars/spark-examples_2.12-3.2.3.jar 10

4)Web 端查看 Spark的 历史信息

367

367

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?