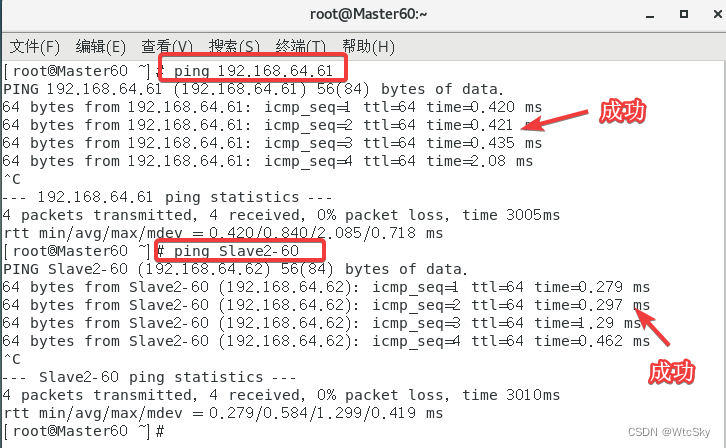

5.2 互相ping验证连通性

首先确保三台虚拟机都已经完成了/etc/hosts的修改。

以Master(主机)为例,使用指令ping 192.168.64.61(IP以自己的从机IP为准),或者使用ping Slave2-60来检验是否连通(IP和主机名有映射关系了,所以ping IP和ping 主机名都可以)。

再分别从从机1和从机2去ping其他的两台机器,验证是否连通,过程是一样的只是把ip改一下,不再做演示。

5.3 ★解决IP失效(之前能联网现在不行了)

如果之前已经设置成功并且显示,后续打开发现失效可能是网卡出现问题了。

依次使用以下指令:

systemctl stop NetworkManagersystemctl disable NetworkManagersystemctl restart network

然后再通过ip addr查看是否成功(ens33显示IP)。

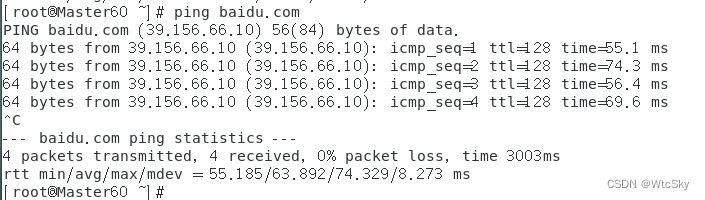

6. 虚拟机访问外网

该操作需要重复三次(实验需要一个Master两个Slave……)

6.1 方法一:ping百度

在终端通过ping baidu.com验证是否成功。

下面以主机为例:

从机也需要验证,如果哪台机器ping不通请查看3.3以及5.3的解决方法或自行百度。

6.2 方法二:通过FireFox访问百度

这种方法需要再安装CentOS的时候选择了GUI界面(参考2.3)

然后输入www.baidu.com,看是否能成功访问,以下是成功界面:

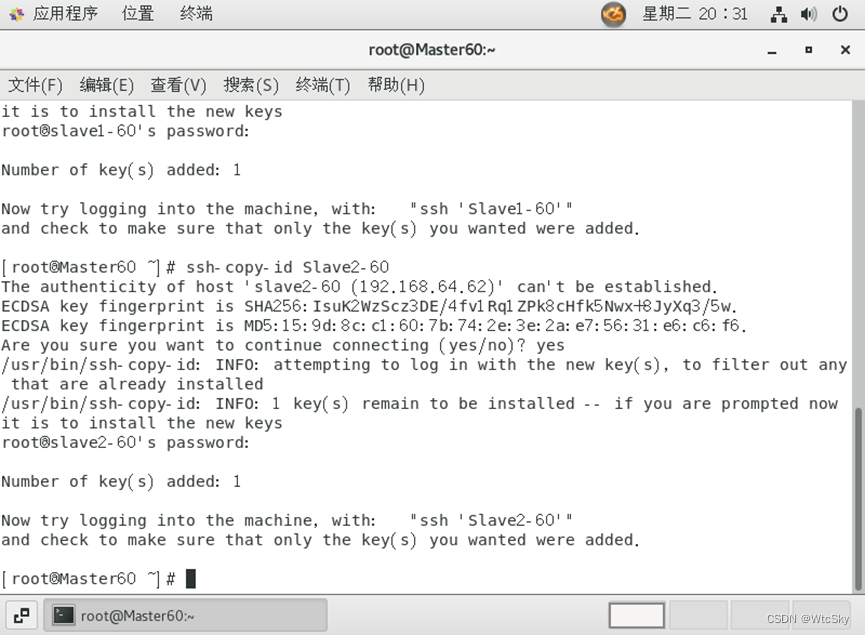

7. 免密安全登录

7.1 生成秘钥及分享秘钥

该操作需要重复三次(实验需要一个Master两个Slave……)

以主机为例,在终端依次使用以下指令生成秘钥然后分享给除了自己以外的另外两台机器:

ssh-keygen -t rsa(然后一直回车)ssh-copy-id Slave1-60(Slave1-60修改为你的从机1的主机名或IP)ssh-copy-id Slave2-60(Slave1-60修改为你的从机2的主机名或IP)

步骤2、3需要输入yes,然后再输入密码(123456),密码不会显示(Linux特性)。

两个从机重复以上操作。

之后在**主机(Master)**进行如下操作(这一步从机不需要):

cd .ssh(目前所在路径是~)touch authorized_keyschmod 600 authorized_keyscat id_rsa.pub >> authorized_keys

这一步是为了之后做准备的……

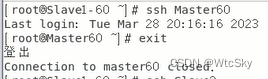

7.2 测试是否成功

以从机1为例,在终端使用指令ssh Master60(改为自己主机的主机名)或者`ssh 192.168.64.610(改为自己主机的IP)。

可以发现此时不需要键入密码就可以登录。

8. Hadoop集群设计与部署

OK,这一步的难度大于前面七步的和,尽量说的详细一点。

该操作需要重复三次(实验需要一个Master两个Slave……)

8.1 下载Hadoop-3.3.1

我用的是Hadoop-3.3.1,下面的操作只要是Hadoop-3.x应该都是适用的,但是Hadoop-2.x可能有细枝末节的地方不太相同,建议看一下PushyTao学长的博客。

建议是在自己的电脑上而不是虚拟机上下载,因为每台虚拟机都需要一份,所以直接下在自己电脑桌面上然后拖到虚拟机里就可以了。

下面给出两个镜像站地址,哪个快下哪个吧(3.3.1可能已经不能用了大概3.x就可以):

以阿里云镜像站为例,要下载的是hadoop-3.3.1.tar.gz。

8.2 创建目录解压Hadoop

首先mkdir /user(现在的路径是~)

然后直接复制以下指令到终端(鼠标中键粘贴)

mkdir /user/hadoop

mkdir /user/hadoop/tmp

mkdir /user/hadoop/var

mkdir /user/hadoop/dfs

mkdir /user/hadoop/dfs/name

mkdir /user/hadoop/dfs/data

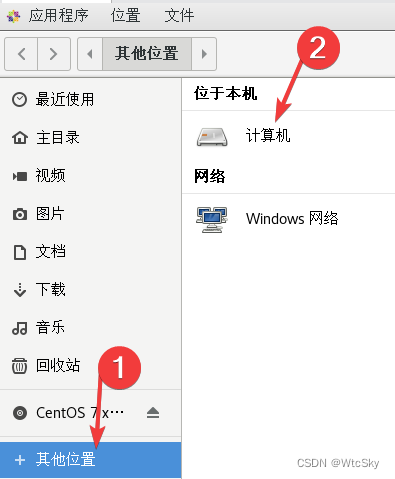

方便起见,后面的操作用GUI进行,点击应用程序,选择文件。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-zA2pArY5-1680265800507)(C:\Users\dell\Documents\ShareX\Screenshots\2023-03\vmware_mXMFpi9xHu.png)]](https://img-blog.csdnimg.cn/04e437eb5d7b4f11b1fb8f2e306d4f1b.png)

点击其他位置,然后选择计算机。

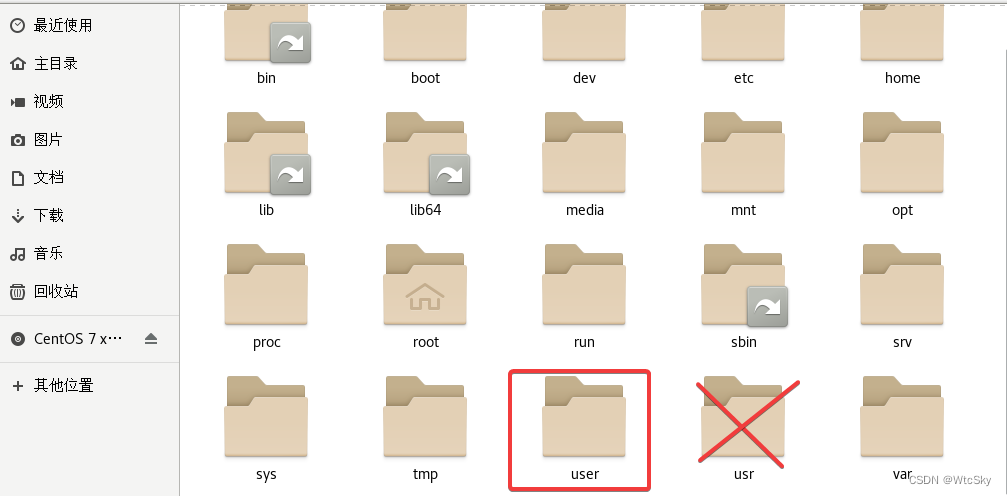

找到user文件夹点击进入,注意是user不是usr。

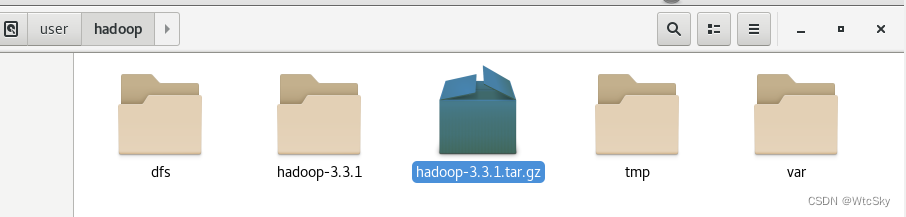

进入里面的hadoop目录,然后把电脑上的压缩包拖进来(下面的图是解压完成的)

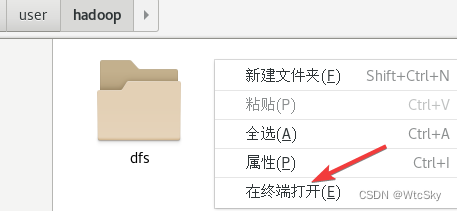

然后在这个界面右键选择在终端打开。

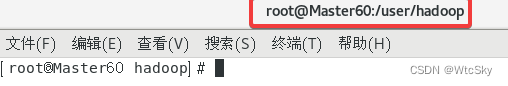

这时候我终端的位置是这个目录:

然后输入指令tar -zxvf hadoop-3.3.1.tar.gz进行解压。

8.3 配置环境变量

在终端使用指令vi ~/.bashrc。

在最后键入i进行插入,需要修改的只有第一行HADOOP_INSTALL,把它改成自己Hadoop的位置就好了(含有bin、etc、……的目录)。

export HADOOP_INSTALL=/user/hadoop/hadoop-3.3.1

export PATH=$PATH:$HADOOP_INSTALL/bin

export PATH=$PATH:$HADOOP_INSTALL/sbin

export HADOOP_MAPRED_HOME=$HADOOP_INSTALL

export HADOOP_COMMON_HOME=$HADOOP_INSTALL

export HADOOP_HDFS_HOME=$HADOOP_INSTALL

export YARN_HOME=$HADOOP_INSTALL

export HADOOP_HOME=$HADOOP_INSTALL

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

986

986

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?