HQL:行转列、列转行

可回答:Hive中怎么实现列转行,行转列?

问过的一些公司:Shopee(2021.07),美团(2021.08)x2 参考答案:

1、行转列:UDF聚合函数

- 相关函数

concat:返回输入字符串连接后的结果,支持任意个输入字符串;

concat_ws(separator, str1, str2,…):它是一个特殊形式的 concat()。第一个参数剩余参数间的分隔符。分隔符可以是与剩余参数一样的字符串。如果分隔符是 NULL,返回值也将为 NULL。这个函数会跳过分隔符参数后的任何 NULL 和空字符串。分隔符将被加到被连接的字符串之间;

collect_set(col):函数只接受基本数据类型,它的主要作用是将某字段的值进行去重汇总,产生array类 型字段。 - 数据准备

name constellation blood_type

孙悟空 白羊座 A

大海 射手座 A

宋宋 白羊座 B

猪八戒 白羊座 A

凤姐 射手座 A

-

创建hive表并导入数据

-

create table person_info(

-

name string,

-

constellation string,

-

blood_type string)

-

row format delimited fields terminated by “t”;

-

load data local inpath “/opt/module/datas/constellation.txt” into table person_info;

7 -

需求

把星座和血型一样的人归类到一起。结果如下:

射手座,A 大海|凤姐

白羊座,A 孙悟空|猪八戒

白羊座,B 宋宋

1 select name,concat(constellation, “,”,blood_type) as base from person_info; 2

- select t1.base concat_ws(‘|’,collect_set(t1.name)) name

- from(

- select

- name,

- concat(constellation, “,”,blood_type) as base

- from

- person_info;

8 ) t1

9 group by t1.base; 10

2、列转行:UDTF爆炸函数

-

相关函数

explode(col):将hive一列中复杂的array或者map结构拆分成多行。

lateral view

用法:lateral view udtf(expression) tableAlias AS columnAlias

解释:用于和split, explode等UDTF一起使用,它能够将一列数据拆成多行数据,在此基础上可以对拆分后的数据进行聚合。 -

数据准备

movie category

《疑犯追踪》 悬疑,动作,科幻,剧情

《Lie to me》 悬疑,警匪,动作,心里,剧情

《战狼2》 战争,动作,灾难

-

创建hive表并导入数据

-

create table movie_info(

-

movie string,

-

category array)

-

row format delimited fields terminated by “t”

-

collection items terminated by “,”; 6

1 load data local inpath “/opt/module/datas/movie.txt” into table movie_info; 2 -

需求

将电影分类中的数组数据展开

1 select movie,category_name from movie_info lateral view explode(category) table_category as category_name;

2

一条HQL从代码到执行的过程

问过的一些公司:Shopee(2021.08),兴业数金(2021.09) 参考答案:

Hive在执行一条HQL的时候,会经过以下步骤:

- 语法解析:Antlr定义SQL的语法规则,完成SQL词法,语法解析,将SQL转化为抽象 语法树AST Tree;

- 语义解析:遍历AST Tree,抽象出查询的基本组成单元QueryBlock; 3)生成逻辑执行计划:遍历QueryBlock,翻译为执行操作树OperatorTree;

- 优化逻辑执行计划:逻辑层优化器进行OperatorTree变换,合并不必要的ReduceSinkOperator,减少shuffle数据量;

- 生成物理执行计划:遍历OperatorTree,翻译为MapReduce任务; 6)优化物理执行计划:物理层优化器进行MapReduce任务的变换,生成最终的执行计划; 另一种说法:

1)输入一条HQL查询语句(select * from tab) 2)解析器对这条HQL语句进行语法分析。 - 编译器对这条HQL语句生成HQL的执行计划。

- 优化器生成最佳的HQL的执行计划。

- 执行这条最佳HQL语句。

了解Hive SQL吗?讲讲分析函数?

问过的一些公司: 参考答案:

1、Hive SQL

Hive是一个数据仓库基础的应用工具,在Hadoop中用来处理结构化数据,它架构在Hadoop之上,通过 SQL来对数据进行操作。Hive将用户的Hive SQL语句通过解释器转换为MapReduce作业提交到Hadoop集群上,Hadoop 监控作业执行过程,然后返回执行结果给用户。

Hive SQL跟SQL是有区别的:

HQL不支持行级别的增、改、删,所有数据在加载时就已经确定,不可更改。 不支持事务。

支持分区存储。

Hive下的SQL特点:

不支持等值连接,一般使用leh join、right join 或者inner join替代。不能智能识别concat(‘;’,key),只会将‘;’当做SQL结束符号。

不支持INSERT INTO 表Values(), UPDATE, DELETE等操作

Hive SQL中String类型的字段若是空(empty)字符串, 即长度为0, 那么对它进行IS NULL的判断结果是False,使用leh join可以进行筛选行。

不支持‘< dt <’这种格式的范围查找,可以用dt in(”,”)或者between替代。

2、分析函数

窗口函数又叫OLAP函数/分析函数,窗口函数兼具分组和排序功能。

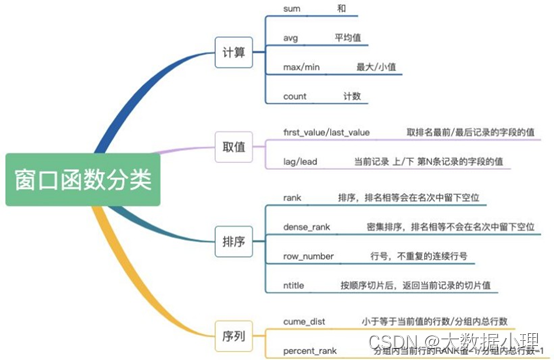

按照窗口函数的功能分为:计算、取值、排序、序列四种,前三种的使用场景比较常见,容易理解,最 后一种(序列)的使用场景比较少。

分析函数中加Order By和不加Order By的区别?

问过的一些公司:虎牙(2021.08) 参考答案:

over()开窗函数前分排序函数和聚合函数两种

当为排序函数,如row_number(),rank()等时,over中的order by只起到窗口内排序作用。

当为聚合函数,如max,min,count等时,over中的order by不仅起到窗口内排序,还起到窗口内从当前行到之前所有行的聚合(多了一个范围)。

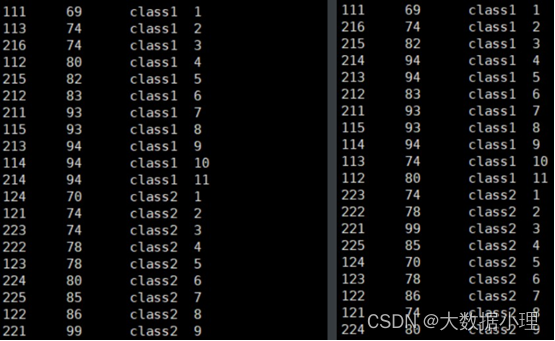

1)以聚合函数sum举例,下面的结果中,左图为不加order by的结果,右图为加上order by的结果

发现不加order by score的话,就是针对一整个分区进行sum求和。加上order by score后,就是根据当前行到之前所有行聚合。

- select *,sum(score) over (partition by clazz) as num from windowtest;

- select *,sum(score) over (partition by clazz order by score) as num from windowtest;

3

查询结果:

也就是说上面的select *,sum(score) over (partition by clazz order by score) as num from windowtest;其实

等价于下面这句

1 select *,sum(score) over (partition by clazz order by score range between unbounded preceding and current row) as num from windowtest;

2

测试后,发现结果一致,说明聚合函数加上order by,就等同于加上从当前行到之前所有行的窗口帧。2)以排序函数为例,下面的排序函数结果中,左图为加上order by的结果,右图为不加order by的结果

-

select *,row_number() over (partition by clazz order by score) from windowtest;

-

select *,row_number() over (partition by clazz) from windowtest;

Hive优化方法

Hive优化方法

问过的一些公司:字节(2021.08) 参考答案:

1、列裁剪和分区裁剪

最基本的操作。所谓列裁剪就是在查询时只读取需要的列,分区裁剪就是只读取需要的分区。 案例: -

select uid,event_type,record_data

-

from calendar_record_log

3 where pt_date >= 20190201 and pt_date <= 20190224

4 and status = 0; 5

当列很多或者数据量很大时,如果select *或者不指定分区,全列扫描和全表扫描效率都很低。Hive中与列裁剪优化相关的配置项是 hive.optimize.cp ,与分区裁剪优化相关的则是

hive.optimize.pruner ,默认都是true。在HiveQL解析阶段对应的则是ColumnPruner逻辑优化器。

2、谓词下推

在关系型数据库如MySQL中,也有谓词下推(Predicate Pushdown,PPD)的概念。它就是将SQL语句中的where谓词逻辑都尽可能提前执行,减少下游处理的数据量。

例如以下HQL语句: -

select a.uid,a.event_type,b.topic_id,b.title

-

from calendar_record_log a

-

left outer join (

-

select uid,topic_id,title from forum_topic

-

where pt_date = 20190224 and length(content) >= 100

-

) b on a.uid = b.uid

-

where a.pt_date = 20190224 and status = 0; 8

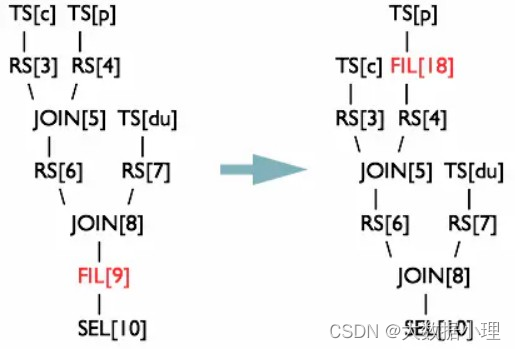

对forum_topic做过滤的where语句写在子查询内部,而不是外部。Hive中有谓词下推优化的配置项hive.optimize.ppd ,默认值true,与它对应的逻辑优化器是PredicatePushDown。该优化器就是将OperatorTree中的FilterOperator向上提,见下图。

3、sort by代替order by

HQL中的order by与其他SQL方言中的功能一样,就是将结果按某字段全局排序,这会导致所有map端数据都进入一个reducer中,在数据量大时可能会长时间计算不完。

如果使用sort by,那么还是会视情况启动多个reducer进行排序,并且保证每个reducer内局部有序。为了控制map端数据分配到reducer的key,往往还要配合distribute by一同使用。如果不加distribute by的话,map端数据就会随机分配到reducer。

举个例子,假如要以UID为key,以上传时间倒序、记录类型倒序输出记录数据: -

select uid,upload_time,event_type,record_data

-

from calendar_record_log

3 where pt_date >= 20190201 and pt_date <= 20190224 -

distribute by uid

-

sort by upload_time desc,event_type desc; 6

4、group by代替distinct

当要统计某一列的去重数时,如果数据量很大,count(distinct)就会非常慢,原因与order by类似, count(distinct)逻辑只会有很少的reducer来处理。这时可以用group by来改写: -

select count(1) from (

-

select uid from calendar_record_log 3 where pt_date >= 20190101

4 group by uid

5 ) t;

6

但是这样写会启动两个MR job(单纯distinct只会启动一个),所以要确保数据量大到启动job的overhead 远小于计算耗时,才考虑这种方法。当数据集很小或者key的倾斜比较明显时,group by还可能会比distinct慢。

那么如何用group by方式同时统计多个列?下面是解决方法: -

select t.a,sum(t.b),count(t.c),count(t.d) from (

-

select a,b,null c,null d from some_table

-

union all

-

select a,0 b,c,null d from some_table group by a,c

-

union all

-

select a,0 b,null c,d from some_table group by a,d 7 ) t;

8

5、group by配置调整 -

map端预聚合

group by时,如果先起一个combiner在map端做部分预聚合,可以有效减少shuffle数据量。预聚合的配置项是 hive.map.aggr ,默认值true,对应的优化器为GroupByOptimizer,简单方便。

通过 hive.groupby.mapaggr.checkinterval 参数也可以设置map端预聚合的行数阈值,超过该值就会分拆job,默认值100000。 -

倾斜均衡配置项

group by时如果某些key对应的数据量过大,就会发生数据倾斜。Hive自带了一个均衡数据倾斜的配置项 hive.groupby.skewindata ,默认值false。

其实现方法是在group by时启动两个MR job。第一个job会将map端数据随机输入reducer,每个reducer 做部分聚合,相同的key就会分布在不同的reducer中。第二个job再将前面预处理过的数据按key聚合并 输出结果,这样就起到了均衡的效果。

但是,配置项毕竟是死的,单纯靠它有时不能根本上解决问题,因此还是建议自行了解数据倾斜的细 节,并优化查询语句。

6、join基础优化

join优化是一个复杂的话题,下面先说5点最基本的注意事项。1)build table(小表)前置

在最常见的hash join方法中,一般总有一张相对小的表和一张相对大的表,小表叫build table,大表叫probe table。如下图所示。

Hive在解析带join的SQL语句时,会默认将最后一个表作为probe table,将前面的表作为build table并试图将它们读进内存。如果表顺序写反,probe table在前面,引发OOM的风险就高了。

在维度建模数据仓库中,事实表就是probe table,维度表就是build table。假设现在要将日历记录事实表和记录项编码维度表来join:

-

select a.event_type,a.event_code,a.event_desc,b.upload_time

-

from calendar_event_code a

-

inner join (

-

select event_type,upload_time from calendar_record_log

-

where pt_date = 20190225

-

) b on a.event_type = b.event_type; 7

-

多表join时key相同

这种情况会将多个join合并为一个MR job来处理,例如: -

select a.event_type,a.event_code,a.event_desc,b.upload_time

-

from calendar_event_code a

-

inner join (

-

select event_type,upload_time from calendar_record_log

-

where pt_date = 20190225

-

) b on a.event_type = b.event_type

-

inner join (

-

select event_type,upload_time from calendar_record_log_2

-

where pt_date = 20190225

-

) c on a.event_type = c.event_type; 11

如果上面两个join的条件不相同,比如改成 a.event_code = c.event_code ,就会拆成两个MR job计算。 -

利用map join特性

map join特别适合大小表join的情况。Hive会将build table和probe table在map端直接完成join过程,消灭了reduce,效率很高。 -

select /+mapjoin(a)/ a.event_type,b.upload_time

-

from calendar_event_code a

-

inner join (

-

select event_type,upload_time from calendar_record_log

-

where pt_date = 20190225

-

) b on a.event_type < b.event_type; 7

上面的语句中加了一条map join hint,以显式启用map join特性。早在Hive 0.8版本之后,就不需要写这条hint了。map join还支持不等值连接,应用更加灵活。

map join的配置项是 hive.auto.convert.join ,默认值true,对应逻辑优化器是MapJoinProcessor。还有一些参数用来控制map join的行为,比如 hive.mapjoin.smalltable.filesize ,当build table

大小小于该值就会启用map join,默认值25000000(25MB)。还有 hive.mapjoin.cache. numrows ,表示缓存build table的多少行数据到内存,默认值25000。 -

分桶表map join

map join对分桶表还有特别的优化。由于分桶表是基于一列进行hash存储的,因此非常适合抽样(按桶或按块抽样)。

它对应的配置项是 hive.optimize.bucketmapjoin ,优化器是BucketMapJoinOptimizer。

-

倾斜均衡配置项

这个配置与上面group by的倾斜均衡配置项异曲同工,通过 hive.optimize.skewjoin 来配置,默认

false。

如果开启了,在join过程中Hive会将计数超过阈值 hive.skewjoin.key (默认100000)的倾斜key对应的行临时写进文件中,然后再启动另一个job做map join生成结果。通过 hive.skewjoin. mapjoin.map.tasks 参数还可以控制第二个job的mapper数量,默认10000。

再重复一遍,通过自带的配置项经常不能解决数据倾斜问题。join是数据倾斜的重灾区,后面还要介绍 在SQL层面处理倾斜的各种方法。

7、优化SQL处理join数据倾斜 -

空值或无意义值

这种情况很常见,比如当事实表是日志类数据时,往往会有一些项没有记录到,我们视情况会将它置为

null,或者空字符串、-1等。如果缺失的项很多,在做join时这些空值就会非常集中,拖累进度。

因此,若不需要空值数据,就提前写where语句过滤掉。需要保留的话,将空值key用随机方式打散,例 如将用户ID为null的记录随机改为负值: -

select a.uid,a.event_type,b.nickname,b.age

-

from (

-

select

-

(case when uid is null then cast(rand()*-10240 as int) else uid end) as uid,

-

event_type from calendar_record_log 6 where pt_date >= 20190201

-

) a left outer join (

-

select uid,nickname,age from user_info where status = 4

-

) b on a.uid = b.uid; 10

-

单独处理倾斜key

这其实是上面处理空值方法的拓展,不过倾斜的key变成了有意义的。一般来讲倾斜的key都很少,我们 可以将它们抽样出来,对应的行单独存入临时表中,然后打上一个较小的随机数前缀(比如0~9),最 后再进行聚合。SQL语句与上面的相仿。 -

不同数据类型

这种情况不太常见,主要出现在相同业务含义的列发生过逻辑上的变化时。

举个例子,假如我们有一旧一新两张日历记录表,旧表的记录类型字段是(event_type int),新表的是(event_type string)。为了兼容旧版记录,新表的event_type也会以字符串形式存储旧版的值,比如’17’。当这两张表join时,经常要耗费很长时间。其原因就是如果不转换类型,计算key的hash值时默认是以int 型做的,这就导致所有“真正的”string型key都分配到一个reducer上。所以要注意类型转换: -

select a.uid,a.event_type,b.record_data

-

from calendar_record_log a

-

left outer join (

-

select uid,event_type from calendar_record_log_2

-

where pt_date = 20190228

-

) b on a.uid = b.uid and b.event_type = cast(a.event_type as string) 7 where a.pt_date = 20190228;

8 -

build table过大

有时,build table会大到无法直接使用map join的地步,比如全量用户维度表,而使用普通join又有数据分布不均的问题。这时就要充分利用probe table的限制条件,削减build table的数据量,再使用map join 解决。代价就是需要进行两次join。举个例子: -

select /+mapjoin(b)/ a.uid,a.event_type,b.status,b.extra_info

-

from calendar_record_log a

-

left outer join (

-

select /+mapjoin(s)/ t.uid,t.status,t.extra_info

-

from (select distinct uid from calendar_record_log where pt_date = 20190228) s

-

inner join user_info t on s.uid = t.uid

-

) b on a.uid = b.uid

-

where a.pt_date = 20190228;

9

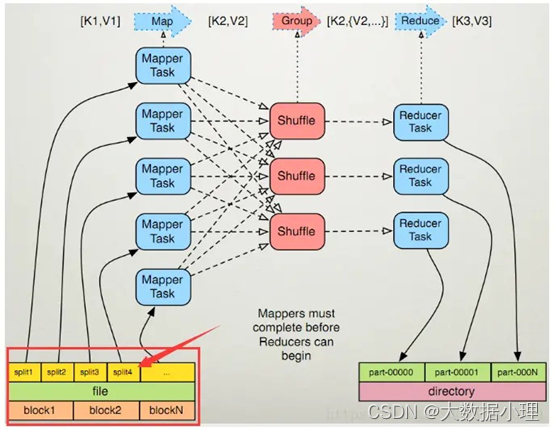

8、MapReduce优化

-

调整mapper数

mapper数量与输入文件的split数息息相关,在Hadoop源码org.apache.hadoop.mapreduce.lib.input.FileInputFormat 类中可以看到split划分的具体逻辑。这里不贴代码,直接叙述mapper数是如何确定的。

可以直接通过参数 mapred.map.tasks (默认值2)来设定mapper数的期望值,但它不一定会生效,下面会提到。

设输入文件的总大小为 total_input_size 。HDFS中,一个块的大小由参数 dfs.block.size

指定,默认值64MB或128MB。在默认情况下,mapper数就是:

(默认值64MB)分别

default_mapper_num = total_input_size / dfs.block.size 。

参数 mapred.min.split.size (默认值1B)和 mapred.max.split.size

用来指定split的最小和最大大小。split大小和split数计算规则是:

split_size = MAX(mapred.min.split.size, MIN(mapred.max.split.size,

dfs.block.size)) ;

split_num = total_input_size / split_size 。

得出mapper数:

mapper_num = MIN(split_num, MAX(default_num, mapred.map.tasks)) 。

可见,如果想减少mapper数,就适当调高 mapred.min.split.size ,split数就减少了。如果想增大

mapper数,除了降低 mapred.min.split.size 之外,也可以调高 mapred.map.tasks 。

一般来讲,如果输入文件是少量大文件,就减少mapper数;如果输入文件是大量非小文件,就增大

mapper数;至于大量小文件的情况,参考下面“合并小文件”的方法处理。

- 调整reducer数

reducer数量的确定方法比mapper简单得多。使用参数 mapred.reduce.tasks 可以直接设定reducer数量,不像mapper一样是期望值。但如果不设这个参数的话,Hive就会自行推测,逻辑如下:

参数 hive.exec.reducers.bytes.per.reducer 用来设定每个reducer能够处理的最大数据量, 默认值1G(1.2版本之前)或256M(1.2版本之后)。

参数 hive.exec.reducers.max 用来设定每个job的最大reducer数量,默认值999(1.2版本之前)或1009(1.2版本之后)。

得出reducer数:

reducer_num = MIN(total_input_size / reducers.bytes.per.reducer,

reducers.max) 。

reducer数量与输出文件的数量相关。如果reducer数太多,会产生大量小文件,对HDFS造成压力。如果reducer数太少,每个reducer要处理很多数据,容易拖慢运行时间或者造成OOM。

- 合并小文件输入阶段合并

需要更改Hive的输入文件格式,即参数 hive.input.format ,默认值是org.apache.hadoop.hive.ql.io.HiveInputFormat ,我们改成org.apache.hadoop.hive.ql.io.CombineHiveInputFormat 。

这样比起上面调整mapper数时,又会多出两个参数,分别是

mapred.min.split.size.per.node 和 mapred.min.split.size.per.rack ,含义是单节点和单机架上的最小split大小。如果发现有split大小小于这两个值(默认都是100MB),则会进行合 并。具体逻辑可以参看Hive源码中的对应类。

输出阶段合并

直接将 hive.merge.mapfiles 和 hive.merge.mapredfiles 都设为true即可,前者表示将map- only任务的输出合并,后者表示将map-reduce任务的输出合并。

hive.merge.size.per.task 可 以 指 定 每 个 task 输 出 后 合 并 文 件 大 小 的 期 望 值 , hive.merge.size.smallfiles.avgsize 可以指定所有输出文件大小的均值阈值,默认值都是1GB。如果平均大小不足的话,就会另外启动一个任务来进行合并。 - 启用压缩

压缩job的中间结果数据和输出数据,可以用少量CPU时间节省很多空间。压缩方式一般选择Snappy,效 率最高。

要启用中间压缩,需要设定 hive.exec.compress.intermediate 为true,同时指定压缩方式hive.intermediate.compression.codec 为 org.apache.hadoop.io.compress.SnappyCodec 。另外,参数 hive.intermediate.compression.type 可以选择对块(BLOCK)还是记录(RECORD)

压缩,BLOCK的压缩率比较高。

输出压缩的配置基本相同,打开 hive.exec.compress.output 即可。

- JVM重用

在MR job中,默认是每执行一个task就启动一个JVM。如果task非常小而碎,那么JVM启动和关闭的耗时就会很长。可以通过调节参数 mapred.job.reuse.jvm.num.tasks 来重用。例如将这个参数设成5, 那么就代表同一个MR job中顺序执行的5个task可以重复使用一个JVM,减少启动和关闭的开销。但它对不同MR job中的task无效。

9、并行执行与本地模式

并行执行

Hive中互相没有依赖关系的job间是可以并行执行的,最典型的就是多个子查询union all。在集群资

源相对充足的情况下,可以开启并行执行,即将参数 设为true。另外

hive.exec.parallel

hive.exec.parallel.thread.number 可以设定并行执行的线程数,默认为8,一般都够用。

本地模式

Hive也可以不将任务提交到集群进行运算,而是直接在一台节点上处理。因为消除了提交到集群的overhead,所以比较适合数据量很小,且逻辑不复杂的任务。

设置 hive.exec.mode.local.auto 为true可以开启本地模式。但任务的输入数据总量必须小于hive.exec.mode.local.auto.inputbytes.max (默认值128MB),且mapper数必须小于hive.exec.mode.local.auto.tasks.max (默认值4),reducer数必须为0或1,才会真正用本地模式执行。

10、严格模式

所谓严格模式,就是强制不允许用户执行3种有风险的HiveQL语句,一旦执行会直接失败。这3种语句 是:

查询分区表时不限定分区列的语句; 两表join产生了笛卡尔积的语句;

用order by来排序但没有指定limit的语句。

要开启严格模式,需要将参数 hive.mapred.mode 设为strict。

11、采用合适的存储格式

在HiveQL的create table语句中,可以使用 stored as … 指定表的存储格式。Hive表支持的存储格式有TextFile、SequenceFile、RCFile、Avro、ORC、Parquet等。

存储格式一般需要根据业务进行选择,在我们的实操中,绝大多数表都采用TextFile与Parquet两种存储 格式之一。

TextFile是最简单的存储格式,它是纯文本记录,也是Hive的默认格式。虽然它的磁盘开销比较大,查询 效率也低,但它更多地是作为跳板来使用。RCFile、ORC、Parquet等格式的表都不能由文件直接导入数 据,必须由TextFile来做中转。

Parquet和ORC都是Apache旗下的开源列式存储格式。列式存储比起传统的行式存储更适合批量OLAP查 询,并且也支持更好的压缩和编码。我们选择Parquet的原因主要是它支持Impala查询引擎,并且我们对update、delete和事务性操作需求很低。

Hive里metastore是干嘛的

问过的一些公司:兴业数金(2021.09) 参考答案:

1、Metadata概念

元数据包含用Hive创建的database、table等的元信息。元数据存储在关系型数据库中。如Derby、MySQL 等。

2、Metastore作用

客户端连接metastore服务,metastore再去连接MySQL数据库来存取元数据。有了metastore服务,就可 以有多个客户端同时连接,而且这些客户端不需要知道MySQL数据库的用户名和密码,只需要连接metastore 服务即可。

3、Hive的元数据存储(Metastore三种配置方式)

由于元数据不断地修改、更新,所以Hive元数据不适合存储在HDFS中,一般存在RDBMS中。

- 内嵌模式(Embedded)

hive服务和metastore服务运行在同一个进程中,derby服务也运行在该进程中.内嵌模式使用的是内嵌的Derby数据库来存储元数据,也不需要额外起Metastore服务。

这个是默认的,配置简单,但是一次只能一个客户端连接,适用于用来实验,不适用于生产环境。 - 本地模式(Local):

本地安装mysql 替代derby存储元数据不再使用内嵌的Derby作为元数据的存储介质,而是使用其他数据库比如MySQL来存储元数据。hive服务和metastore服务运行在同一个进程中,mysql是单独的进程,可 以同一台机器,也可以在远程机器上。

这种方式是一个多用户的模式,运行多个用户client连接到一个数据库中。这种方式一般作为公司内部 同时使用Hive。每一个用户必须要有对MySQL的访问权利,即每一个客户端使用者需要知道MySQL的用 户名和密码才行。 - 远程模式(Remote): 远程安装mysql 替代derby存储元数据

Hive服务和metastore在不同的进程内,可能是不同的机器,该模式需要将hive.metastore.local设置为false,将hive.metastore.uris设置为metastore服务器URL,远程元存储需要单独起metastore服务,然后每 个客户端都在配置文件里配置连接到该metastore服务。将metadata作为一个单独的服务进行启动。各种 客户端通过beeline来连接,连接之前无需知道数据库的密码。

仅连接远程的mysql并不能称之为“远程模式”,是否远程指的是metastore和hive服务是否在同一进程内.

HiveServer2是什么?

问过的一些公司:兴业数金(2021.09) 参考答案:

HiveServer2(HS2)是一个服务端接口,使远程客户端可以执行对Hive的查询并返回结果。目前基于Thrih RPC的实现是HiveServer的改进版本,并支持多客户端并发和身份验证.

HiveServer的核心是基于Thrih,Thrih负责hive的查询服务,Thtih是构建跨平台的rpc框架,主要由四层 组成:server,Transport,Protocol和处理器

server

HiveServer在TCP模式下使用ThreadPoolServer,在HTTP下使用jetty server server主要为每个tpc连接分配一个工作线程

Transport

如果客户端与服务器之间需要代码(安全原因),则需要http模式,通过hive配置属性

hive.server2.transport.mode指定Thrih服务的传输模式

Protocol

协议主要负责序列化和反序列化处理器

处理请求的应用程序框架,实现了编译和执行hive查询的逻辑,负责准备各种执行引擎的物理执行 计划

Hive表字段换类型怎么办

问过的一些公司:贝壳找房(2021.11) 参考答案:

1、使用alter table change column命令直接修改

2、如果表中已经有数据的话,通过上面的语句进行修改后会导致数据无法展示。 可以通过下面的方式操作

- 先将要改字段结构的表名 修改为一个临时表

1 alter table 表1 rename to 表2; 2

- 在创建一个和原来(表1)一模一样的表3

- 将修改表名之后的数据插入到新建的表

1 insert into 表3 select * from 表2; 2

parquet文件优势

问过的一些公司: 参考答案:

1、更高的压缩比

列存使得更容易对每个列使用高效的压缩和编码,降低磁盘空间。(网上的case是不压缩、gzip、

snappy分别能达到11/27/19的压缩比)

2、更小的IO操作

使用映射下推和谓词下推,只读取需要的列,跳过不满足条件的列,能够减少不必要的数据扫描,带来 性能的提升并在表字段比较多的时候更加明显。

978

978

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?