第二章 感知机

感知机也是作为神经网络(深度学习)的起源的算法。因此,学习感知机的构造也就是学习通向神经网络和深度学习的一种重要思想。

首先,感知机是什么?

感知机接收多个输入信号,输出一个信号。

上图是一个接收两个输入信号的感知机的例子。x1、x2是输入信号,y是输出信号,w1、w2是权重(w是weight的首字母)。图中的⚪称为“神经元”或者“节点”。输入信号被送往神经元时,会被分别乘以固定的权重(w1x1、w2x2)。神经元会计算传送过来的信号的总和,只有当这个总和超过了某个界限值时,才会输出1。这也称为“神经元被激活”。这里将这个界限值称为阈值,用符号θ表示。

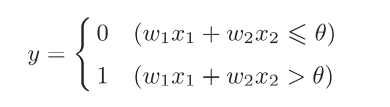

把上述内容用数学式来表示:

可知,权重越大,对应该权重的信号的重要性就越高。

接下来了解简单逻辑电路,考虑用感知机来解决简单的问题。

1、与门;与门仅在两个输入均为1时输出1,其他时候则输出0。

2、与非门;

与非门的真值表

或门的真值表

使用权重和偏置实现与门、非门和或门:

def AND(x1, x2):

x = np.array([x1, x2])

w = np.array([0.5, 0.5])

b = -0.7

tmp = np.sum(w*x) + b

if tmp <= 0:

return 0

else:

return 1

def NAND(x1, x2):

x = np.array([x1, x2])

w = np.array([-0.5, -0.5]) # 仅权重和偏置与AND不同!

b = 0.7

tmp = np.sum(w*x) + b

if tmp <= 0:

return 0

else:

return 1

def OR(x1, x2):

x = np.array([x1, x2])

w = np.array([0.5, 0.5]) # 仅权重和偏置与AND不同!

b = -0.2

tmp = np.sum(w*x) + b

if tmp <= 0:

return 0

else:

return 1

由于感知机的局限性,单层的感知机无法实现异或门,读者可以尝试一下。

异或门的真值表

感知机的局限性就在于它只能表示由一条直线分割的空间。

但感知机的绝妙之处在于它可以“叠加层”来实现比较复杂的逻辑。

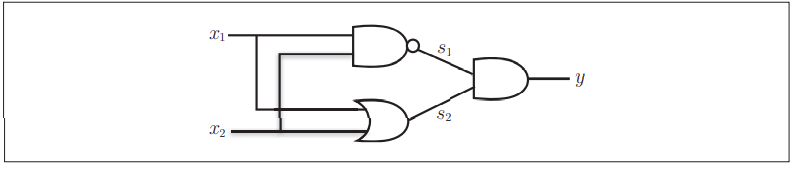

通过组合与门、与非门、或门实现异或门

用python实现异或门(使用之前定义的AND函数、NAND函数、OR函数):

def XOR(x1, x2):

s1 = NAND(x1, x2)

s2 = OR(x1, x2)

y = AND(s1, s2)

return y

异或门是一种多层结构的神经网络。叠加了多层的感知机也称为多层感知机(multi-layered perceptron)

上图2层感知机中,先在第0层和第1层的神经元之间进行信号的传送和接收,然后在第1层和第2层之间进行信号的传送和接收,具体如下所示。

1.第0层的两个神经元接收输入信号,并将信号发送至第1层的神经元。

2.第1层的神经元将信号发送至第2层的神经元,第2层的神经元输出y。

由上可知,通过叠加层(加深层),感知机能进行更加灵活的表示。

此外,有趣的是多层感知机甚至可以表示计算机哦!

多层感知机可以实现比之前见到的电路更复杂的电路。比如,进行加法运算的加法器也可以用感知机实现。此外,将二进制转换为十进制的编码器、满足某些条件就输出1的电路(用于等价检验的电路)等也可以用感知机表示。人们一般会认为计算机内部进行的处理非常复杂,而令人惊讶的是,实际上只需要通过与非门的组合,就能再现计算机进行的处理。。也就是说,如果通过组合与非门可以实现计算机的话,那么通过组合感知机也可以表示计算机(感知机的组合可以通过叠加了多层的单层感知机来表示)。

参考书籍:《深度学习入门(基于python的理论与实现)》

336

336

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?