一、前言

过拟合和过平滑是开发深度图卷积网络(GCNs)进行节点分类的两个主要障碍。特别是过拟合会削弱小数据集的泛化能力,而过平滑会随着网络深度的增加将输出表示与输入特征隔离开来,从而阻碍模型训练。本文提出了一种新的、灵活的DropEdge技术来缓解这两个问题,其核心是DropEdge随机从每个训练单元的输入图中删除一定数量的边,就像一个数据增强器和一个消息传递减速器。 此外,我们还从理论上证明了DropEdge既可以降低过平滑的收敛速度,也可以减轻过平滑所造成的信息损失。更重要的是,我们的DropEdge是一种通用技能,可以用许多其他骨干模型(例如GCN、ResGCN、GraphSAGE和JKNet)来增强性能。

二、加深GCN方法介绍

在每个训练单元,DropEdge技术随机剔除输入图的某一比率的边。形式上,随机使邻接矩阵A的Vp个非零元素为零,其中V为边总数,p为去边率。如果我们表示得到的邻接矩阵为

A

d

r

o

p

A_{drop}

Adrop,那么它与A的关系就变为:

A

d

r

o

p

A_{drop}

Adrop=

A

A

A -

A

′

A'

A′

其中,

A

′

A'

A′是从原始边

ξ

\xi

ξ随机扩展的大小为Vp的稀疏矩阵

跟随着Kipf&Welling的想法,我们对

A

d

r

o

p

A_{drop}

Adrop使用了再归一化的技巧,产生

A

^

d

r

o

p

\hat A_{drop}

A^drop.

1、防止过拟合

DropEdge产生图连接的各种扰动。因此,它对输入数据产生不同的随机变形,可以看作是一种图形的数据增强技术。为了解释为什么这是有效的,我们在这里提供一个直观的理解。GCNs的关键是对每个节点的邻居信息进行聚合,这可以理解为邻居特征的加权和(权重与边相关)。从

从邻居聚合的角度来看,DropEdge在GNN训练期间启用一个随机子集聚合,而不是完整的聚合。统计上,如果我们以概率p的方式丢弃边,DropEdge只会将邻居聚集的期望改变到乘数p。实际上,在权值归一化后,这个乘数会被移除,这在实践中是经常发生的。因此,DropEdge并不改变邻域聚合的期望,是GNN训练的一种无偏数据增强技术,类似于典型的图像增强技术(如旋转、裁剪和摆动),在训练cnn时能够阻止过拟合。

2、层级DropEdge

上述DropEdge公式是一次性的,所有层共享同一个扰动邻接矩阵。事实上,我们可以为每一个单独的层执行DropEdge。具体来说,通过每层独立计算方程我们获得一个 A ^ d r o p ( l ) \hat A^{(l)}_{drop} A^drop(l)。不同的层可以有不同的邻接矩阵 A ^ d r o p ( l ) \hat A^{(l)}_{drop} A^drop(l)。这样的分层版本带来了更多的原始数据的随机性和变形。

为简单起见,下面的推导假设所有的gcl共享相同的扰动邻接矩阵,我们将把关于分层DropEdge的讨论留到未来的探索中。

3、防止过平滑

定义1:子空间M={EC|C∈

R

M

×

C

R^{M×C}

RM×C,E∈

R

N

×

C

R^{N×C}

RN×C} 是

R

N

×

C

R^{N×C}

RN×C的M维子空间,M<=N ,C为通道数(特征维数),N为输入图的结点数

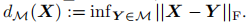

定义2:估计定义1的M是用来和H(p )隐层特征作距离计算的,给定一个

ϵ

\epsilon

ϵ和一个L,p>=L,计算它们的距离,距离<

ϵ

\epsilon

ϵ称为

ϵ

\epsilon

ϵ-平滑。

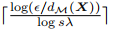

定义3:在定义2中对应最小距离的p,称为

ϵ

\epsilon

ϵ-平滑层。

定义4:比定义3更大的p称为relaxed-

ϵ

\epsilon

ϵ平滑层。定义如下:λ为

A

^

\hat A

A^的第二大特征值。

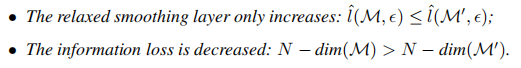

我们将证明采用DropEdge缓解 ϵ \epsilon ϵ-平滑问题在两个方面:

- 通过减少节点连接,证明了DropEdge可以减缓过平滑收敛;换句话说,如果使用DropEdge平滑层relaxed- ϵ \epsilon ϵ平滑的价值只会增加

- 原空间的维数与收敛子空间的维数之间的差距,即N−M测量信息丢失量;间隔越大,信息损失越严重。我们的推导表明,DropEdge能够增加收敛子空间的维数,从而减少信息丢失

我们总结了如下结论:

【带撇的为本文方法得到的】

第一行说明本文的方法在更大层达到relaxed-

ϵ

\epsilon

ϵ-平滑,平滑和过平滑挂钩,这似乎说明,本文的方法能更晚过平滑,即不易过平滑->较少过平滑的收敛速度(过平滑收敛意味着同一连通分量的节点表示十分相近没有区分度->这一点既可以通过相邻层同一节点表示相近(欧式距离接近)又可以通过同层的同一连通分量上的节点表示相近来说明)。

第二行,原始空间和收敛子空间的维度之差(例如 N−M)衡量了信息的损失量,这个差越大说明信息损失越严重。本文的方法信息损失更小,因为收敛子空间纬度大。

三、总结

我们提出了DropEdge,一种促进深度图卷积网络(GCNs)发展的新型高效技术。DropEdge通过随机剔除一定比例的边,在输入数据中加入更多的多样性,防止过拟合,减少图卷积中的消息传递,缓解过平滑。在Cora、Citeseer、Pubmed和Reddit上的大量实验已经证实,DropEdge可以普遍且持续地提升目前流行的GCNs的性能,如GCN、ResGCN、JKNet、IncepGCN和GraphSAGE。我们的研究将为深入探索深层GCNs提供一个新的平台,并具有更广阔的应用前景

针对图卷积网络(GCNs)中存在的过拟合与过平滑问题,本文提出了一种名为DropEdge的技术。该技术通过随机删除图中的边来增加数据多样性和减少信息损失,从而有效提高GCN在节点分类任务上的表现。

针对图卷积网络(GCNs)中存在的过拟合与过平滑问题,本文提出了一种名为DropEdge的技术。该技术通过随机删除图中的边来增加数据多样性和减少信息损失,从而有效提高GCN在节点分类任务上的表现。

598

598

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?