1.这个是什么意思

2.核函数

3.公式理解

4.L1和L2正则

L1和L2正则化是机器学习中常用的两种正则化技术,它们通过在损失函数中添加一个惩罚项来防止模型过拟合。这两种技术的主要区别在于惩罚项的形式。

L1正则化(Lasso正则化)

L1正则化通过向损失函数添加权重的绝对值的总和来工作

L1正则化的效果之一是它倾向于产生稀疏的权重矩阵,即模型中很多权重会变为0,这有助于特征选择,因为模型会忽略不那么重要的特征。

L2正则化(岭回归正则化)

L2正则化通过添加权重的平方的总和来工作

和L1正则化一样,( \lambda ) 控制了正则化的强度。不同的是,L2正则化倾向于分散权重值而不是让它们为0,因为对权重的惩罚与权重的大小成正比。

L2正则化对模型的权重添加了平方项惩罚,这使得模型权重不能太大,从而控制了模型的复杂度。

举例说明

假设我们正在训练一个线性回归模型来预测房价,模型的特征包括房屋的大小、位置、年龄等。

-

使用L1正则化:如果我们希望模型只集中于少数几个最重要的特征(例如,可能只有房屋的大小和位置真正影响房价),我们可以使用L1正则化。这会鼓励模型将其他不那么重要的特征的权重设为0,从而产生一个稀疏的模型,其中只有最关键的特征被选中。

-

使用L2正则化:如果我们认为所有特征都应该对预测有所贡献,但我们想要防止模型对数据中的噪声过于敏感,那么我们可以使用L2正则化。这会鼓励模型找到一个权重较小、更加分散的解决方案,降低了模型对单个数据点的敏感度,增强了模型的泛化能力。

在实际应用中,选择L1还是L2正则化通常基于问题的性质以及是否需要模型稀疏性。有时,也会结合使用L1和L2正则化,这在机器学习中被称为Elastic Net正则化。

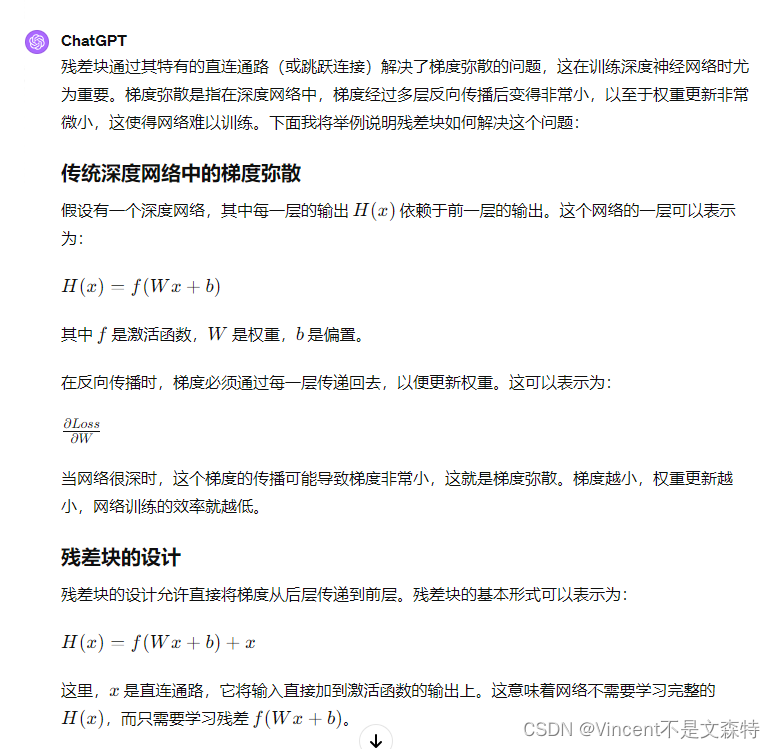

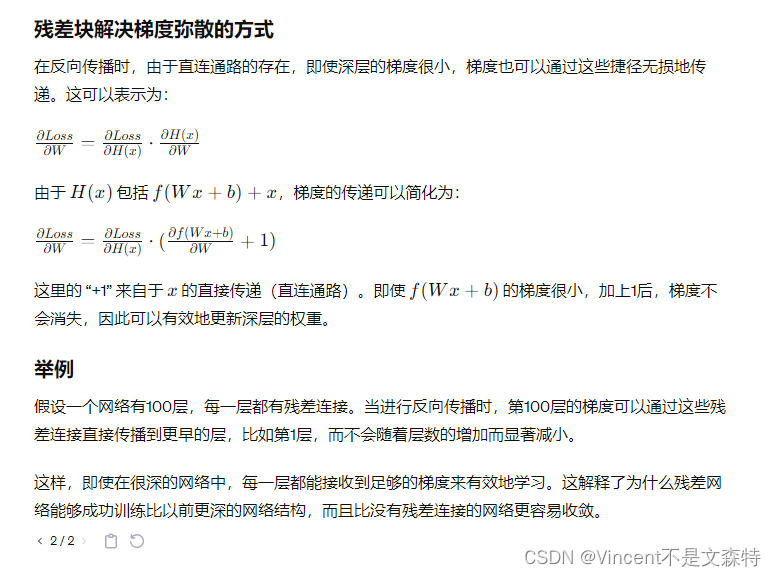

5.为什么残差块能解决梯度弥散的问题

关于梯度弥散:https://www.bilibili.com/video/BV1M3411j7LG/

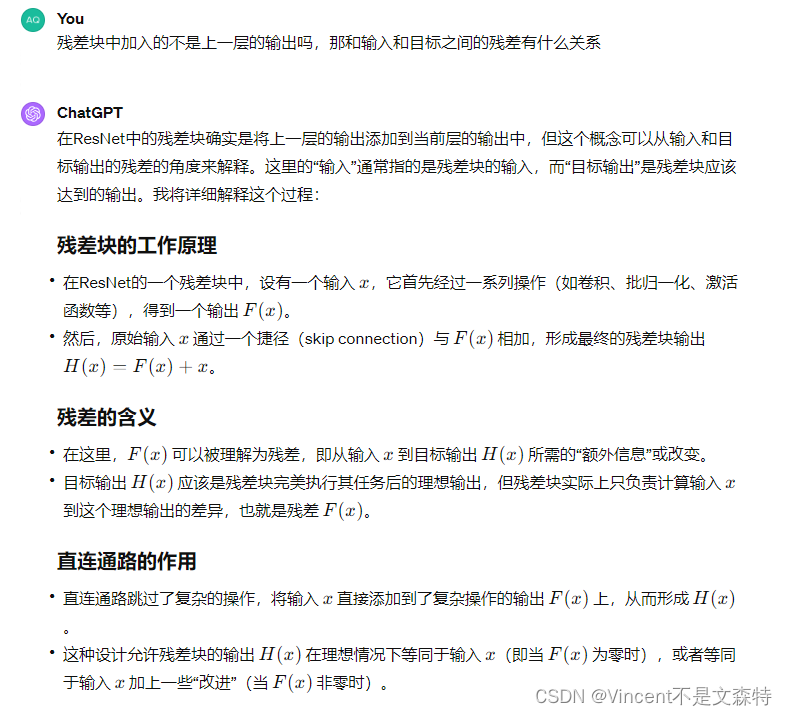

6.残差块的残差值

1562

1562

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?