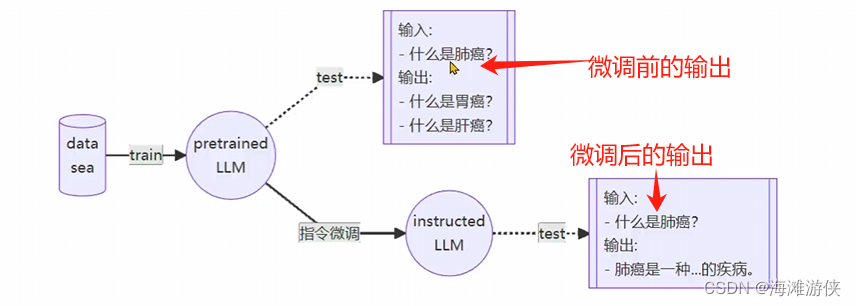

为什么要微调:

1. 模型不具备一些私人定制的知识

2。模型回答问题的套路你不满意。

对应衍生出来两种概念

-

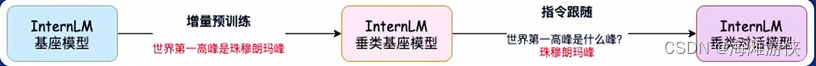

增量预训练微调:

- 使用场景:让基座模型学习到一些新知识,如某个垂类领域的常识

- 训练数据:文章、书籍、代码等等

-

指令跟随微调:

- 使用场景:让模型学会对话模板,根据人类指令进行对话

- 训练数据:高质量的对话、问答数据

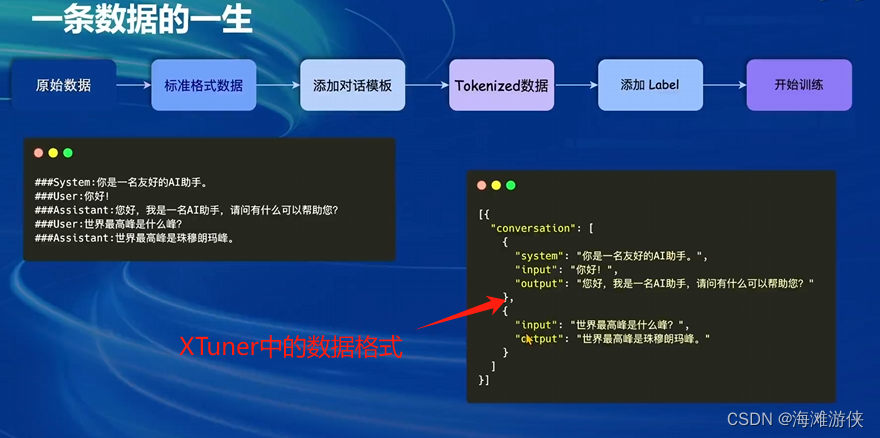

3. 数据的一生

LoRA和QLoRA

-

LoRA总结

之前的fine-tune的方法

-

Adapters

方法:在模型的每一层之间添加可训练的小规模的网络,冻结原始网络权重,以此来减少fine-tune所需要的参数量。

应用

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

197

197

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?