作者学便查询

在写多标签模型的时候,想输出每个类别的概率,因为不同类别会同时发生,所以不同于多标签分类使用softmax。

这次多标签中使用sigmoid用于生成概率。

对sigmoid的粗略理解

在使用线性分类器(感知器)时,因为感知器的输出一般为0和1,对概率缺少解释性并且阶跃函数的导数计算困难。

希望找到一个算法对概率有解释性,并且方便计算导数,因此引出了逻辑回归模型。

尽管叫做回归,但是确实用于分类,其回归是用于预测后验概率,再使用后验概率进行分类,所以逻辑回归模型是一个分类算法。

一般采用sigmoid函数和线性函数结合构建假设函数(简称逻辑回归函数)

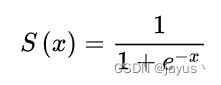

sigmoid函数

这个数学形式不是随意采用的,是通过贝叶斯决策论推导出来的,过程比较长(省略了。。),但是是具有对概率的解释性的,不仅仅是限制在0-1之间的数字,还是一个明确的概率(在某些假设中)。

Pytorch中的sigmoid

torch.nn.Sigmoid()

1257

1257

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?