神经网络的表示

逻辑回归

神经网络分为输入层,输出层和隐藏层

隐藏层中的节点真实数据我们是看不到的

输入层的激活值将数据传给隐藏层,隐藏层传递给输出层(使用上标【】来表示),双层的神经网络分层不包括输入层 隐藏层和输出层含有参数

对于双层的神经网络来说,每一层对应的a,z和w和b都用上标表示层数,下标表示的是每层第几个神经单元,而每个w矩阵都是由每层的w组合成的,每个层每个神经单元的w都是一个列向量,输出的z也是一个列向量

所需计算的单隐层神经网络就需要以下的四个公式

对于多个样本的线性预测的计算(logistics模型)

下面的公式都是通过对多个样本的推导从而更加容易的理解起来

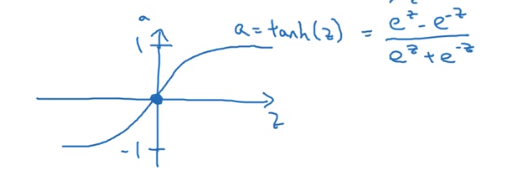

激活函数

使用tanh可以使得数据中心化,更接近0 这个函数是sigmoid函数平移得到的

二元分类的时候用sigmoid函数当作激活函数,其他的时候很少用,下面是tanh函数

不同层的激活函数可以不一样

总结激活函数

sigmoid用于二分类输出层,几乎用不到

relu更好用,大部分时候都用

带泄露的relu=max(0.01z,z)

向量化

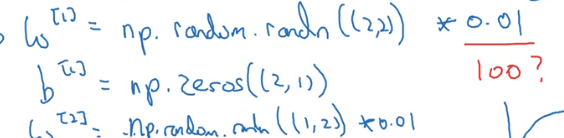

随机初始向量方法

7850

7850

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?