注意:30系列显卡只支持CUDA11.0及以上版本加速,因此本文CUDA选择v11.5

软件包搭配:win11 + RTX3060 + CUDA=11.5 + CuDnn=8.3.2 + python=3.10.14 + pytorch=1.12.1

0. CUDA及CuDNN安装省略

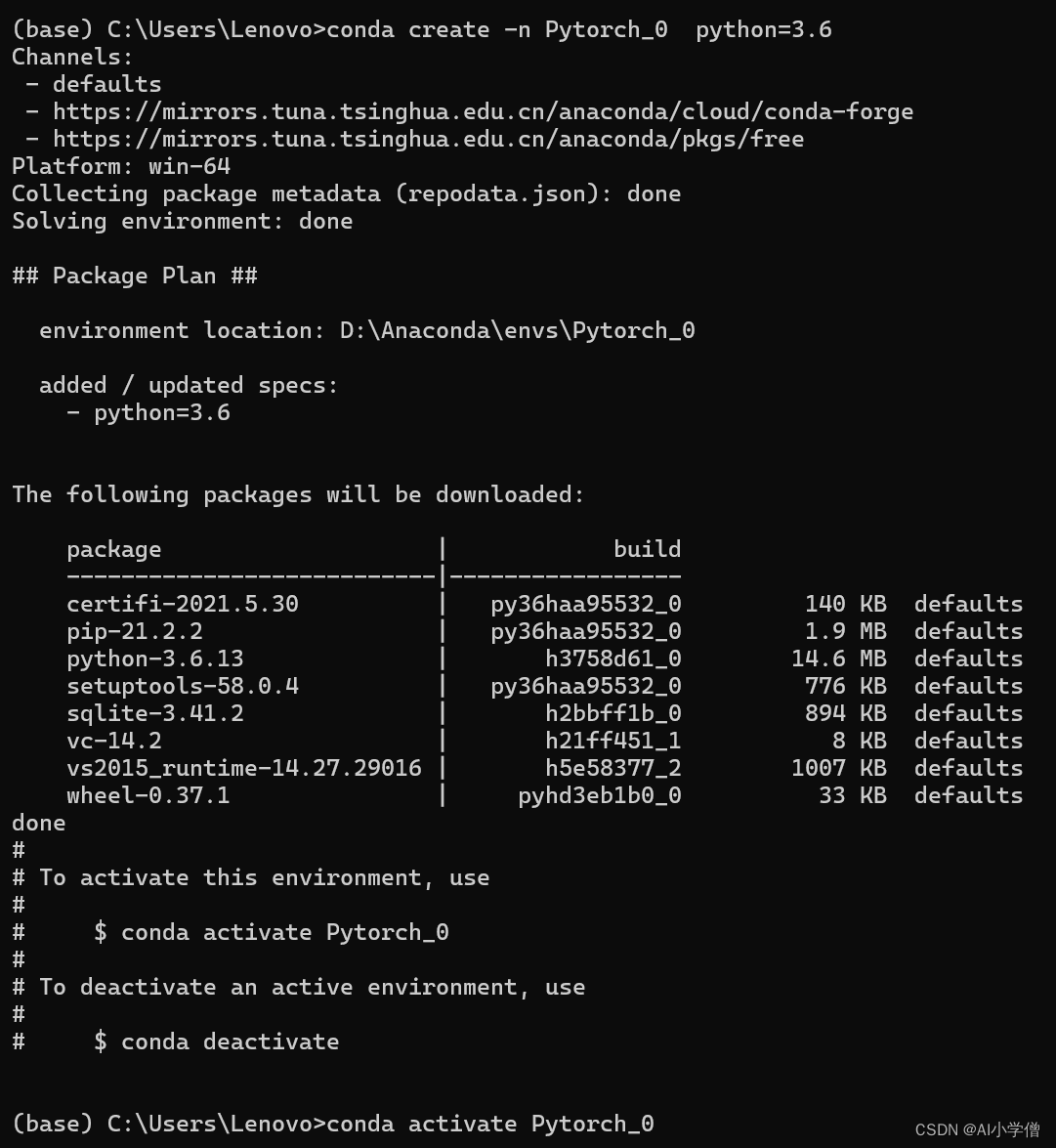

1. 先创建一个环境

conda create -n Pytorch_0 python=3.6创建成功,如下:

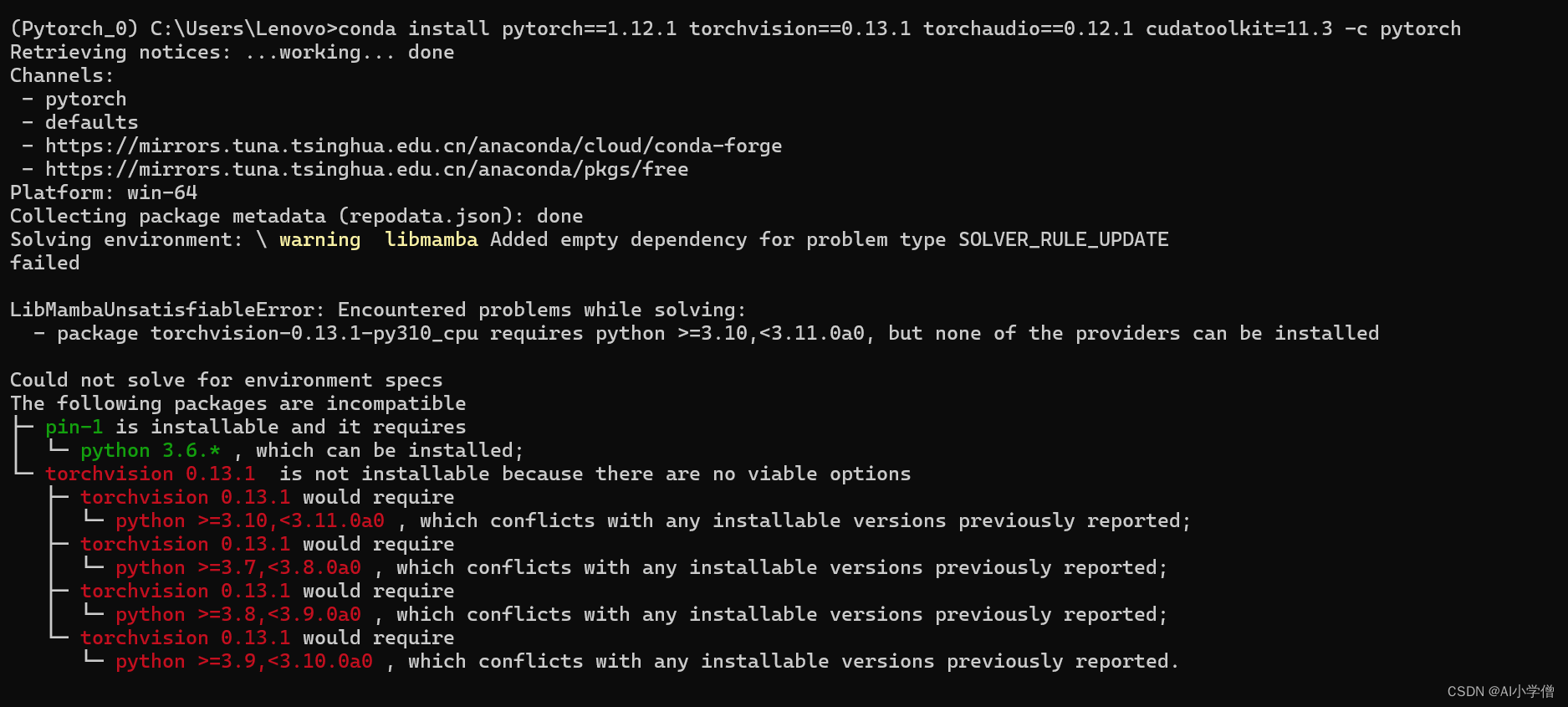

2. 安装对应版本的Pytorch,代码:

conda install pytorch==1.12.1 torchvision==0.13.1 torchaudio==0.12.1 cudatoolkit=11.3 -c pytorch结果显示,Python版本不合适(本版本的Pytorch,需要python=3.10-3.11版本之间)

重新安装其他版本的python

本文详细描述了如何在Windows11系统上安装CUDA11.5、cuDNN8.3.2以及PyTorch1.12.1,解决Python版本不匹配的问题,并通过性能测试验证了GPU加速效果。

本文详细描述了如何在Windows11系统上安装CUDA11.5、cuDNN8.3.2以及PyTorch1.12.1,解决Python版本不匹配的问题,并通过性能测试验证了GPU加速效果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1826

1826

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?