在这个时代,我们习惯于拥有高清、色彩丰富的照片,然而,那些古老的黑白色老照片由于年代的久远,往往会出现模糊、破损等现象。

那么今天要给大家介绍的是,用Stable Diffusion来修复老照片。

前段时间ControlNet的除了上线了“IP-Adapter”模型以外还增加另一个叫“Recolor”的模型,它的作用就是给图片重新上色。通过“Recolor”,我们能够让那些古老的黑白色老照片重现生机,展现出它们原本应有的色彩和细节。

1 插件以及模型下载

本文需要用到的插件、脚本以及模型如下:

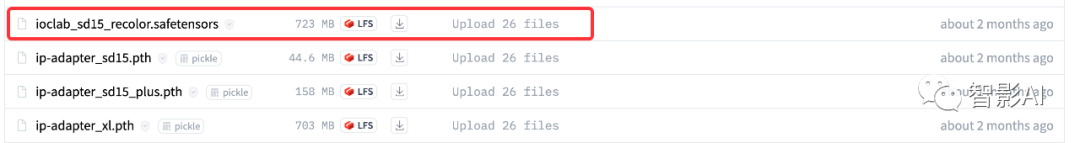

- 在使用“Recolor”之前,需要将自己的ControlNet更新到最新版本并且需要下载相关模型:

模型下载链接:https://huggingface.co/lllyasviel/sd_control_collection/tree/main

(网络不太稳定的小伙伴文末会提供相关模型)

- 放大脚本“StableSR“安装。(可下可不下)

“StableSR”可以在“扩展”-“可下载”-搜索关键词“StableSR”直接安装。(网络不太稳定的小伙伴文末会提供安装包)

*脚本Github链接:*https://github.com/pkuliyi2015/sd-webui-stablesr

使用“StableSR”脚本需要下载三个模型:

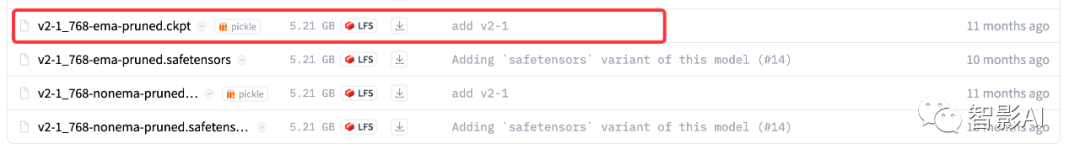

2.1. “StabilityAI”的官方大模型,使用“StableSR”脚本必须要用的模型。(5.21GB)

(模型放入“sd-webui\models\Stable-diffusion”文件夹中)

模型链接:https://huggingface.co/stabilityai/stable-diffusion-2-1/tree/main

(网络不太稳定的小伙伴文末会提供模型下载)

2.2. 需要用到的“VAE”模型。(745MB)

(模型放入“sd-webui\models\VAE”文件夹中)

模型链接:https://drive.google.com/file/d/1ARtDMia3_CbwNsGxxGcZ5UP75W4PeIEI/view

(网络不太稳定的小伙伴文末会提供模型下载)

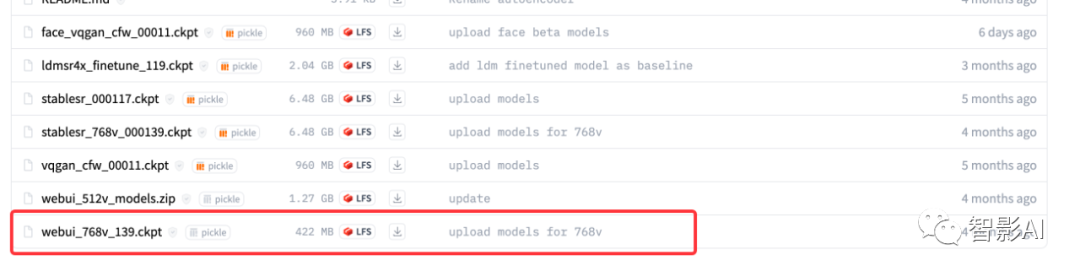

2.3. “StableSR”脚本模型。(400MB)

(模型放入:“sd-webui\extensions\sd-webui-stablesr\models”文件夹中)

模型链接:https://huggingface.co/Iceclear/StableSR/blob/main/webui_768v_139.ckpt

(网络不太稳定的小伙伴文末会提供模型下载)

- “Multidiffusion”插件安装。(可下可不下)

同样可通过“扩展”-“可下载”-搜索关键词“Tiled diffusion”直接安装。(网络不太稳定的小伙伴文末会提供安装包)

2 照片修复

-

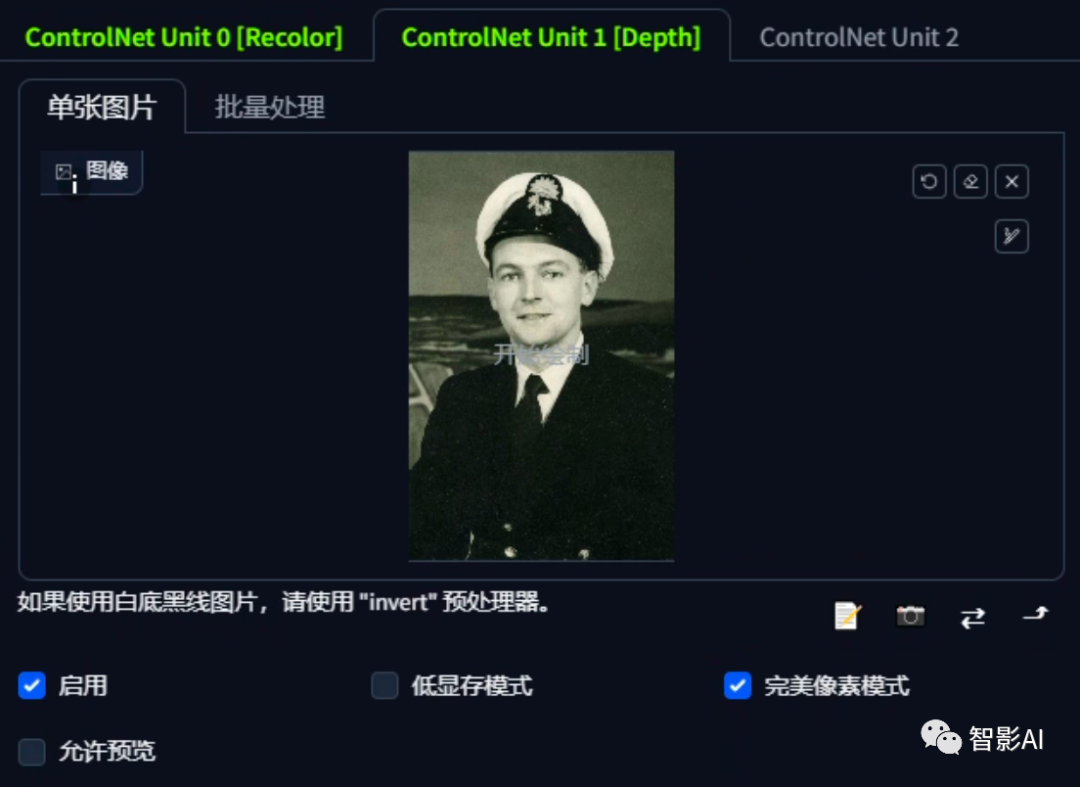

首先打开“Stable Diffusion”,在“ControlNet Unit 0”上传一张黑白老照片,然后“启用”ControlNet并且勾选“完美像素模式”。

-

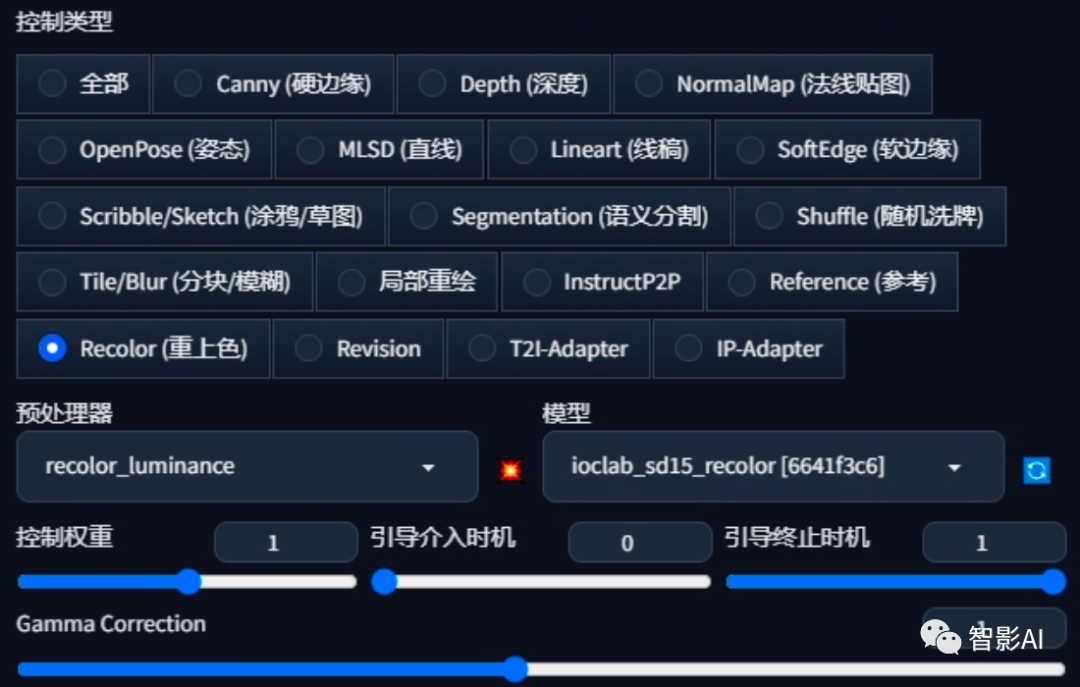

控制类型选择“Recolor”,预处理器选择“recolor_luminance”,然后模型会默认选上。

-

点击“ControlNet Unit 1”再把刚刚那张黑白照片上传上去,然后“启用”ControlNet并且勾选“完美像素模式”。

-

控制类型选择“Depth”,预处理器选择“depth_zoe”,然后模型会自动选上。

-

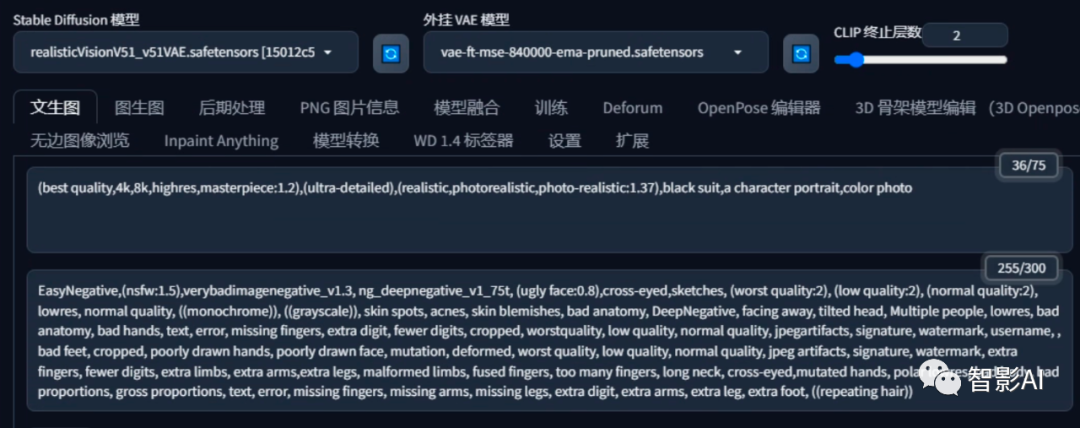

设置好ControlNet之后,选择一个人物写实模型,然后在正向提示词里面可以写一些关于照片里面的内容,比如黑色西装、黑色头发、白色帽子等等,然后反向提示词放个通用的就可以,其实不写也行。

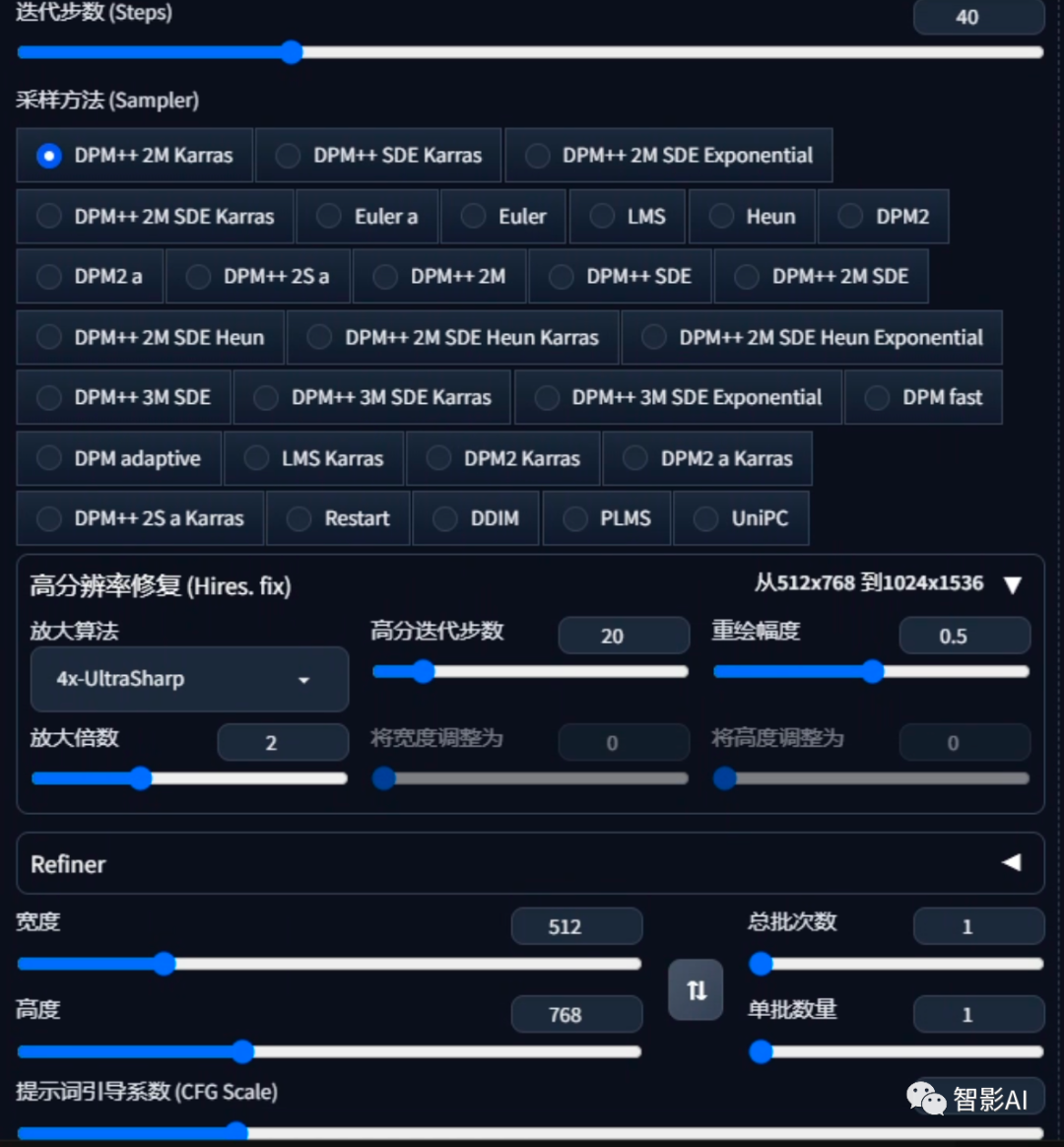

6. 设置生成参数,生成参数可以根据自己的需求设置,尺寸这里建议设为跟照片同样的比例。

- 设置完以上参数之后,点击“生成”即可。

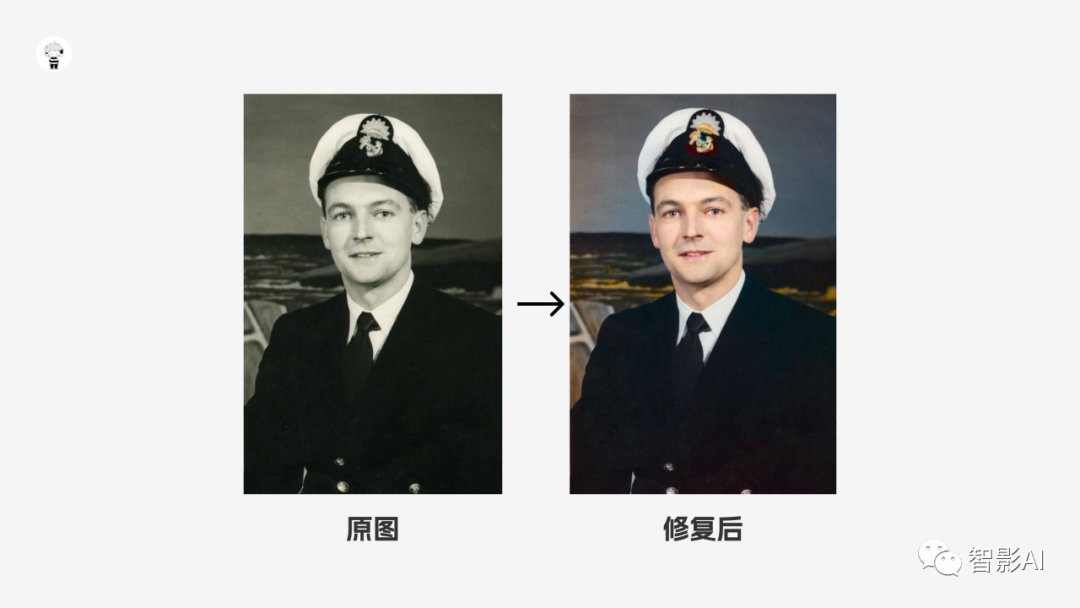

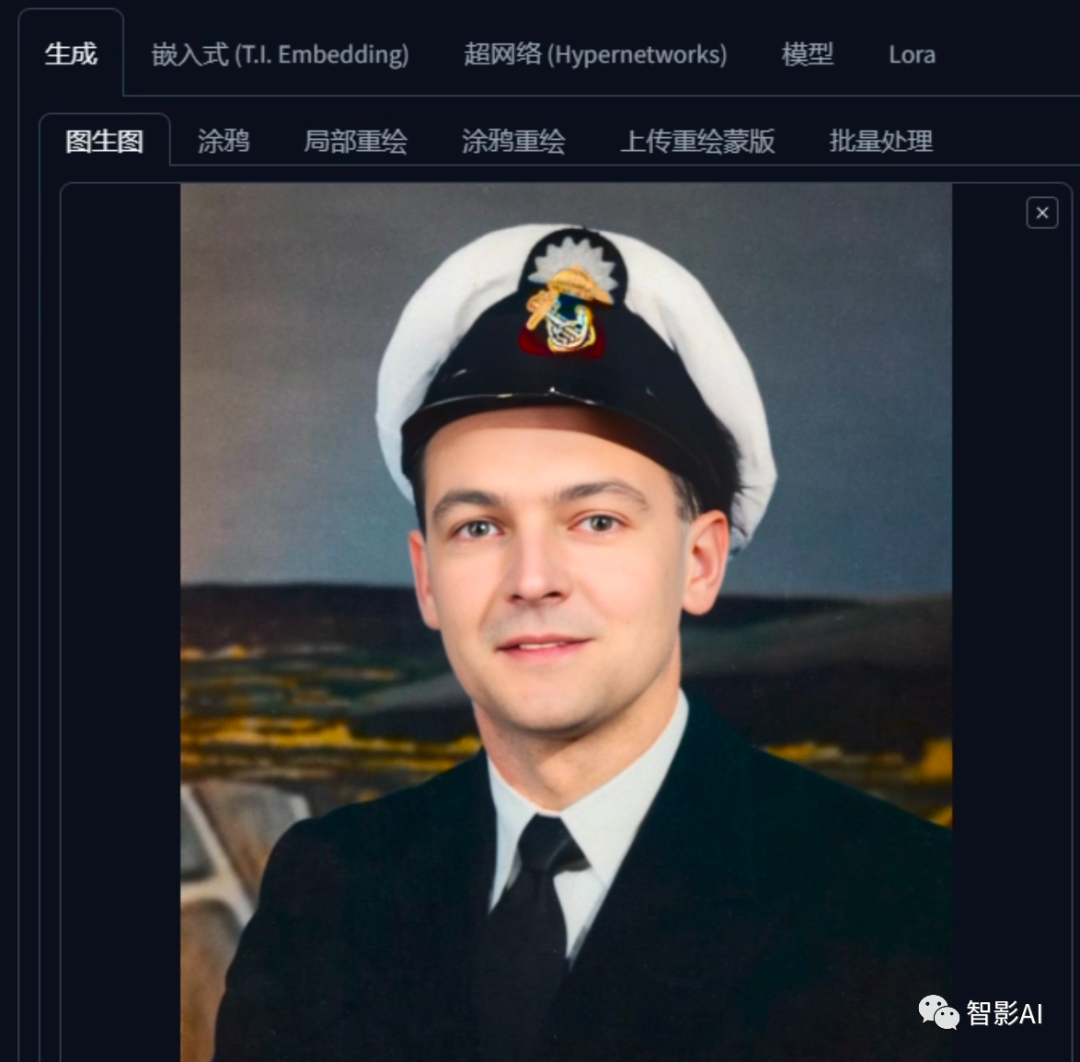

我们可以看到从原来的黑白照片,变成了彩色照片,但是我们发现照片还是会有一些模糊。不过没事,可以尝试以下方法:

3 细节优化

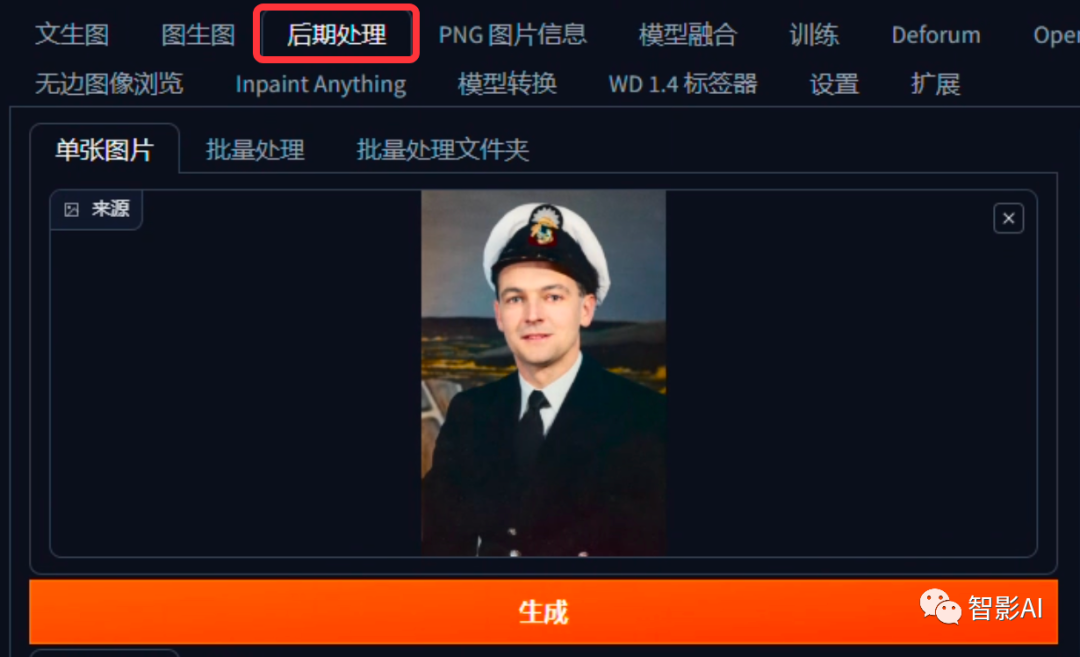

- 点击“后期处理”上传刚刚生成的彩色照片。

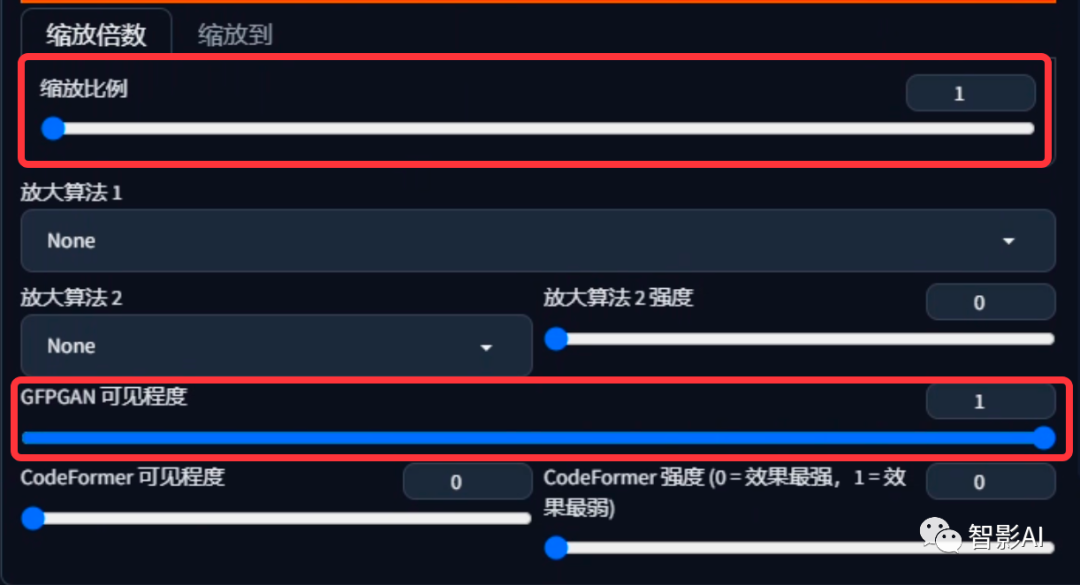

- 将“缩放比例”调为“1”,然后将“GFPGAN 可见程度”调为“1”。

- 设置完以上参数之后,点击“生成”即可。

(如果觉得这样就OK了,那到这里就结束了,想让画面更清晰的,可以接着往下看)

我们可以看到脸部变清晰了,但是其他的地方还是会有一些模糊,不过没事,接下来我们可以使用**“StablSR**”脚本和“Multidiffusion”插件来让整张照片都变得更高清。

(下面的部分需要安装“StablSR”脚本和“Multidiffusion”插件和下载“StablSR”脚本的模型)

- 将刚刚的图片发送到“图生图”。

- 选择“v2-1_768-ema-pruned.ckpt”大模型和“vqgan_cfw_00011_vae_only.ckpt”VAE模型。(正向提示词和反向提示词可以不用写)

- 设置生成参数,跟文生图参数保持一致就行。

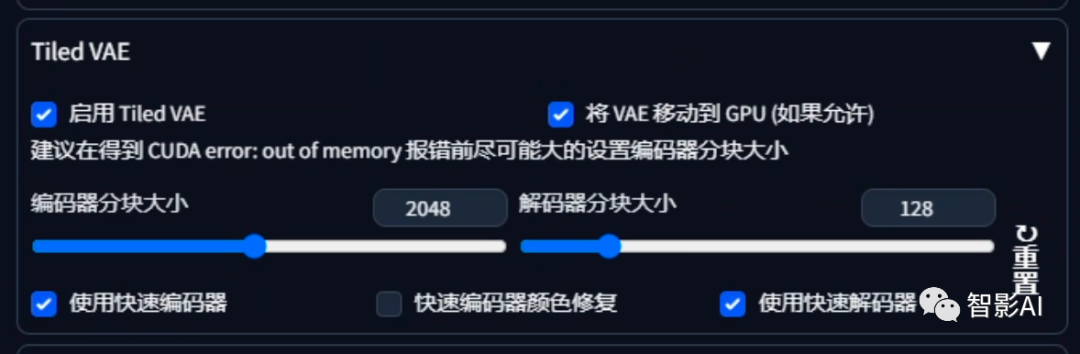

- 启用“Tiled Diffusion”以及“Tiled VAE”,将“放大倍数”改为“1”,然后勾选“启用噪声反转”,其他的参数保持默认即可。

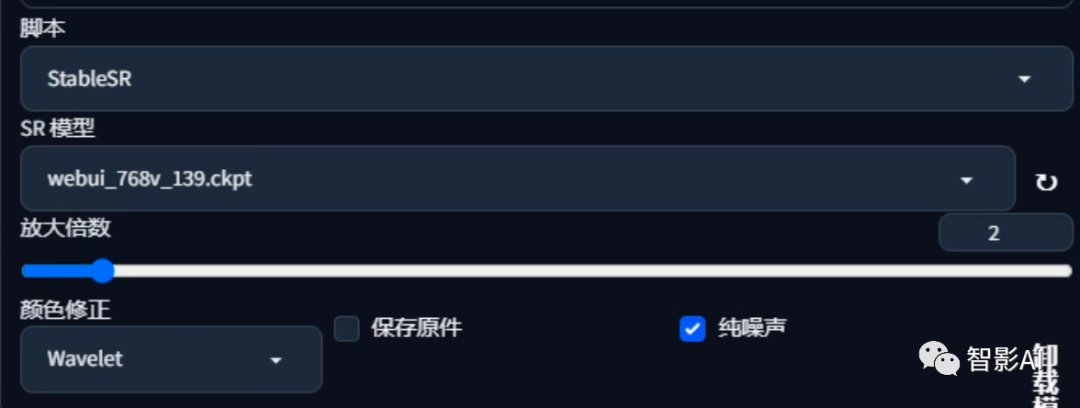

- 选择“StableSR”脚本,在“SR模型”选择“webui_768v_139.ckpt”模型,然后“放大倍数”为“2”,勾选“纯噪声”。

- 设置好以上参数之后,点击“生成”即可。

我们可以看到经过放大之后,照片变得更清晰更高清了。

4 最后

以上是对修复黑白老照片的方法介绍,随着AI技术不断的进步,将那些因时间流逝而变得模糊、破损的老照片恢复成清晰、彩色的状态以不在是一件很难的事情了。

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

对于0基础小白入门:

如果你是零基础小白,想快速入门AI绘画是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以找到适合自己的学习方案

包括:stable diffusion安装包、stable diffusion0基础入门全套PDF,视频学习教程。带你从零基础系统性的学好AI绘画!

需要的可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1.stable diffusion安装包 (全套教程文末领取哈)

随着技术的迭代,目前 Stable Diffusion 已经能够生成非常艺术化的图片了,完全有赶超人类的架势,已经有不少工作被这类服务替代,比如制作一个 logo 图片,画一张虚拟老婆照片,画质堪比相机。

最新 Stable Diffusion 除了有win多个版本,就算说底端的显卡也能玩了哦!此外还带来了Mac版本,仅支持macOS 12.3或更高版本。

2.stable diffusion视频合集

我们在学习的时候,往往书籍源码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,一步步带你入坑stable diffusion,科学有趣才能更方便的学习下去。

3.stable diffusion模型下载

stable diffusion往往一开始使用时图片等无法达到理想的生成效果,这时则需要通过使用大量训练数据,调整模型的超参数(如学习率、训练轮数、模型大小等),可以使得模型更好地适应数据集,并生成更加真实、准确、高质量的图像。

4.stable diffusion提示词

提示词是构建由文本到图像模型解释和理解的单词的过程。可以把它理解为你告诉 AI 模型要画什么而需要说的语言,整个SD学习过程中都离不开这本提示词手册。

5.AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

这份完整版的学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

810

810

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?