这个链接https://csdnimg.cn/feed/20180330/49f4cd810ad4606e3c45ed9edb16a8b8.jpg就是这个图片资源的定位符,将这个链接输入浏览器中就会显示出这张图片,所以说这张图片也对应一个URL。

不过知道这么回事就好,我们通常所说的传入URL指的就是把网页的链接传进去。上面代码中

r = requests.get('https://www.csdn.net/')

就是在将URL传入请求函数。

2.网页请求

说到网页请求,就有必要讲一下我们平常浏览网页时,信息交互的模式大概是什么样的。我们平常用浏览器浏览网页的时候,鼠标点了一个链接,比如你现在点击这里,其实浏览器帮你向这个网页发送了请求(request),维护网页的服务器(可以理解成云端的一台电脑,在维护这CSDN上的各个网页)收到了这个请求,判定这个请求是有效的,于是返回了一些响应信息(response)到浏览器,浏览器将这些信息进行渲染(可以理解成组合编译展示),就是你看到的网页的样子了。

而现在我们要用代码来模拟这一过程。上面的requests.get就是让代码帮你向这个网页发送了这个请求,如果请求被判定为有效,网页的服务器也会把信息传送给你,传送回来的这些信息就被赋值到变量r之中。所以这个变量r里就包含有我们想要的信息了,也包括那些我们想要提取的标题。

我们可以print(r.text)看一下里面有什么东西

我们再看一下网页的源代码(如何看懂这个源码,以及这个源码怎么查看下一节HTML会详细讲到)

源代码和r.text其实是一模一样的东西。r.text其实就是一个字符串,字符串中有我们刚刚抓取到的所有标题,我们只要通过字符串匹配方法(比如正则表达式)将他们提取出来就可以了。这样说是不是感觉爬虫非常简单呢?只要这样傻瓜操作

r = requests.get('https://www.csdn.net/')

再直接从r.text字符串中提取信息即可。其实爬虫就是这么简单。

但是解析是怎么回事呢,为什么刚刚不直接用正则而要用bs4呢?因为方便,但是正则也是完全可以的,只是相对麻烦一些、需要写更多的代码而已。

3.网页解析

网页解析其实就从网页服务器返回给我们的信息中提取我们想要数据的过程。其实使用正则表达式提取我们要的标题的过程也可以称为网页解析。

因为当前绝大多数网页源代码都是用HTML语言写的,而HTML语言时非常有规律性的,比如我们要的所有文章标题都具有相同结构,也就是说它周围的字符串都是非常类似的,这样我们才能批量获取。所以就有大佬专门封装了如何从HTML代码中提取特定文本的库,也就是我们平时说的网页解析库,如bs4 lxml pyquery等,其实把他们当成处理字符串的就可以了。

为了更清楚地了解如何对网页进行解析,我们需要先粗略掌握HTML代码的结构。

HTML介绍

引用维基百科中的一段话来介绍HTML

超文本标记语言(英语:HyperText Markup Language,简称:HTML)是一种用于创建网页的标准标记语言。HTML是一种基础技术,常与CSS、JavaScript一起被众多网站用于设计令人赏心悦目的网页、网页应用程序以及移动应用程序的用户界面[1]。网页浏览器可以读取HTML文件,并将其渲染成可视化网页。

为了让读者对HTML有更清楚的认识,我们来写一点简单的HTML代码。用文本编辑器(记事本也可以)创建一个名字为a.html的文件,在里面写下如下代码

<!DOCTYPE html>

<html>

<head>

<title>爬虫基本原理</title>

</head>

<body>

<h1>HTML介绍</h1>

<p>第一段</p>

<p>第二段</p>

</body>

</html>

保存,然后你双击这个文件,就会自动用浏览器打开,然后你就能看到下面这个样子的页面

你如果按照我的操作来做的话,你已经创建了一个简单的网页,现在你看到的所有网页都是这样设计的,只是比你的复杂一点而已,不信你去看看刚才截图下来的网页源代码图片。

接下来,我们来看一下HTML语言的特点。最重要的一点是,文本都是被标签(h1标签 p标签)夹在中间的,而这些标签都是特定的,有专门用途的。比如<h1>就表示一级标题,包在里面的文本自然会被放大显示;而<p>标签则表示段落。

再看上面的源代码截图,head meta script title div li每一个都是标签,层层嵌套。我们完全不需要知道总共有哪些种标签,也不需要知道这些标签都是用来干什么的,我们只要找到我们要的信息包含在什么标签里就行了。比如使用正则表达式就直接用<p>(.*?)</p>就可以把里面的内容提取出来了。

但是事实好像没有那么简单,看上面的截图标签怎么是这样的<nav id="nav" class="clearfix">?其实这是一个<nav>标签,后面的id class是这个标签的属性。

为什么要给标签设置属性呢?我们先考虑这样一个问题:我们看到的网页千差万别,文字的颜色字体等都不一样,这是怎么设置的呢?答案是使用css样式。

css语句类似这样

h1 {

color: white;

text-align: center;

}

p {

font-family: verdana;

font-size: 20px;

}

即设置对应标签的颜色、字体、大小、居中等。而当有的段落使用这个字体,有的段落使用那个字体怎么办呢?css这样设置

p.test1 {

font-size: 20px;

}

p.test2 {

font-size: 15px;

}

在HTML代码中则这样写

<p class="test1">20px大小的字</p>

<p class="test2">15px大小的字</p>

所以不同属性就是为了区分相同标签用的,这相当于给标签进行了分类,在统一设计样式上更方便,同时对于我们根据属性定位我们想要内容的位置其实也是更方便了。这里要说明一下,class id这两个属性比较特殊,用的也最多,所以各自弄了一个快捷键来表示,class用.,id用#。

做爬虫不需要了解刚刚编写的css代码内容放在哪里之类的问题,也不需要了解css代码设置了什么,我们只会和HTML打交道,所以只要理解HTML中属性的作用就可以了。

如果想要更进一步了解HTML和CSS,可以到w3school网站学习。

现在你就已经具备了解析网页需要的全部HTML知识了。我们一般就是根据标签名配合属性值来定位我们想要资源的位置的,其他的都不用管。这时,我们再来看爬虫的解析代码

解析代码介绍

把前面的代码再粘贴一遍如下

import requests *# 导入网页请求库*

from bs4 import BeautifulSoup *# 导入网页解析库*

*# 传入URL*

r = requests.get('https://www.csdn.net/')

*# 解析URL*

soup = BeautifulSoup(r.text, 'html.parser')

content_list = soup.find_all('div', attrs = {'class': 'title'})

for content in content_list:

print(content.h2.a.text)

解释一下上面代码的过程

- 第一步,把

r.text这个网页源代码字符串传到BeautifulSoup函数中(第二个参数固定用法先不用管),得到的soup对象,可以理解成这一步是为了让这个字符串可以用一些更简单的方法,比如它可以调用find_all方法,寻找class属性是title的div标签,这样的标签有非常多,返回了一个list。 - 第二步,对这个list进行循环,每一个元素内部寻找h2标签里的a标签,提取a标签中的文本,即我们要的标题。

可以看到上面的代码非常简洁,思路清晰,读者可以自己想一想如果要用正则表达式如何匹配这些标签,会发现代码繁琐很多,虽然它也有更快的优势。

那么我们是怎么知道要寻找什么样属性的div标签,为什么要找h2 a标签而不是其他的呢?这就要去分析网页的源代码了。而这个过程也非常简单。

chrome检查工具介绍

我们现在用谷歌浏览器打开CSDN这个网站,找一个空白的位置右键-查看网页源代码,这时就会打开一个新的页面这个页面就是这个网站的HTML源代码了,我们可以通过这个页面来看我们要的信息在哪里,但是感觉非常不方便,因为有太多无用的信息做干扰,我们无法快速掌控网页的结构。所以我们可以用另一种方式查看源代码。

用谷歌浏览器打开CSDN这个网站,找一个空白的位置右键-检查,就会弹出一个框,如下图所示

(如果没有看到这个界面,注意要切换到Element中)

这个页面最大的好处是通过折叠来让人更快探索出网页的结构。

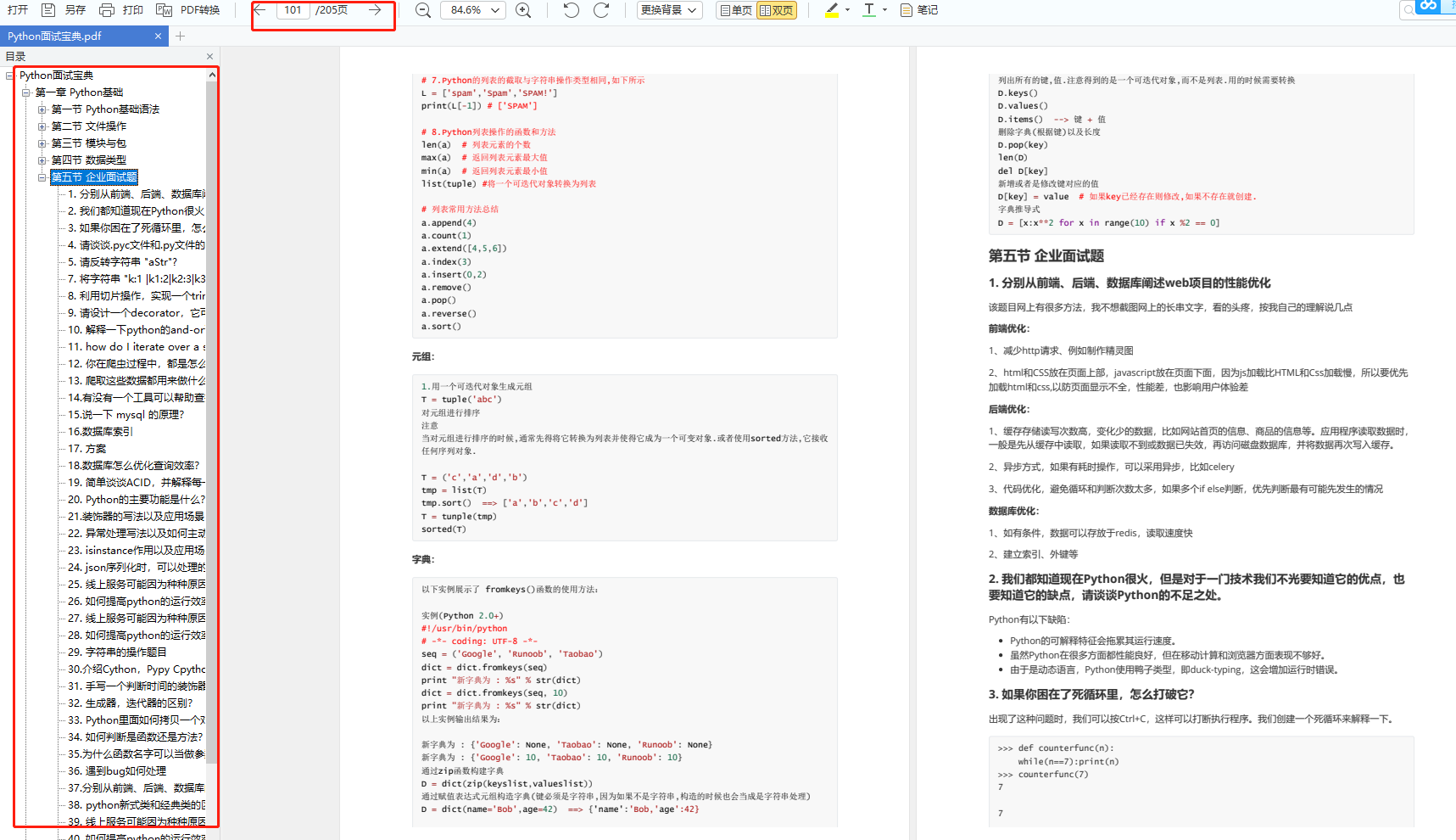

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

五、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?