好了,分析完毕,接下来代码撸起。

3.敲代码

什么都不管,立即来个get请求

import requests

from bs4 import BeautifulSoup

url_start = 'http://maoyan.com/board/4'

response = requests.get(url_start)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'lxml')

print(response.text)

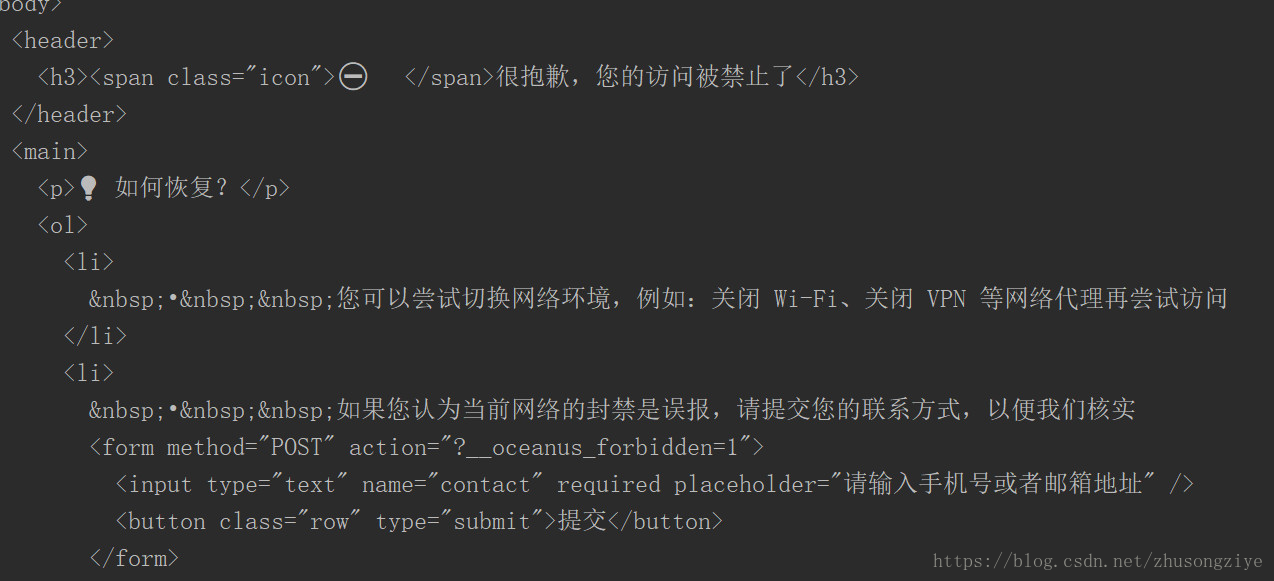

输出结果:

惊不惊喜,意不意外?如果你经常玩爬虫的,这个就见怪不怪了,我们被反爬了。我们试下加个请求头试试。

url_start = 'http://maoyan.com/board/4'

headers = {'User-Agent':'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/64.0.3282.140 Safari/537.36'}

response = requests.get(url_start, headers=headers)

这样就可以正常返回了,因为一般的网站都会在请求头上加个反爬的,所以遇到了反爬也不要着急,加个请求头试试?

接下来用BeautifulSoupL来获取内容

imgs = soup.select('dd .board-img') # 这是获取图片链接

titles = soup.select('dd .board-item-main .name') # 这是获取电影名字

starses = soup.select('dd .board-item-main .movie-item-info .star') # 这是获取电影主演

times = soup.select('dd .board-item-main .movie-item-info .releasetime') # 这是获取电影上映时间

scores = soup.select('dd .board-item-main .score-num') # 这是获取评分

这里每个获取的语句都包含了每个不同电影的信息,这样就不能和正则那样一次把每个电影的信息都在同一个字符里面了。就比如我获取的图片,一个语句获取的是这个页面的所有电影图片的链接,我们存储的时候就要分别取出来了。这里我用到的是for循环0到9把相同的坐标的信息存进同一个字典里面。

films = [] # 存储一个页面的所有电影信息

for x in range(0, 10):

# 这个是获取属性的链接

img = imgs[x]['data-src']

# 下面的都是获取标签的内容并去掉两端空格

title = titles[x].get\_text().strip()

stars = starses[x].get\_text().strip()[3:] # 使用切片是去掉主演二字

time = times[x].get\_text().strip()[5:] # 使用切片是去掉上映时间二字

score = scores[x].get\_text().strip()

film = {'title': title, 'img': img, 'stars': stars, 'time': time, 'score': score}

films.append(film)

接下来就是获取每一页的链接

pages = soup.select('.list-pager li a') # 可以看到下一页的链接在最后一个a标签

page = pages[len(pages)-1]['href']

后面的就简单了,就是利用循环把所有页面的内容都去取出来就可以了,代码就不贴出来了。

最后

Python崛起并且风靡,因为优点多、应用领域广、被大牛们认可。学习 Python 门槛很低,但它的晋级路线很多,通过它你能进入机器学习、数据挖掘、大数据,CS等更加高级的领域。Python可以做网络应用,可以做科学计算,数据分析,可以做网络爬虫,可以做机器学习、自然语言处理、可以写游戏、可以做桌面应用…Python可以做的很多,你需要学好基础,再选择明确的方向。这里给大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

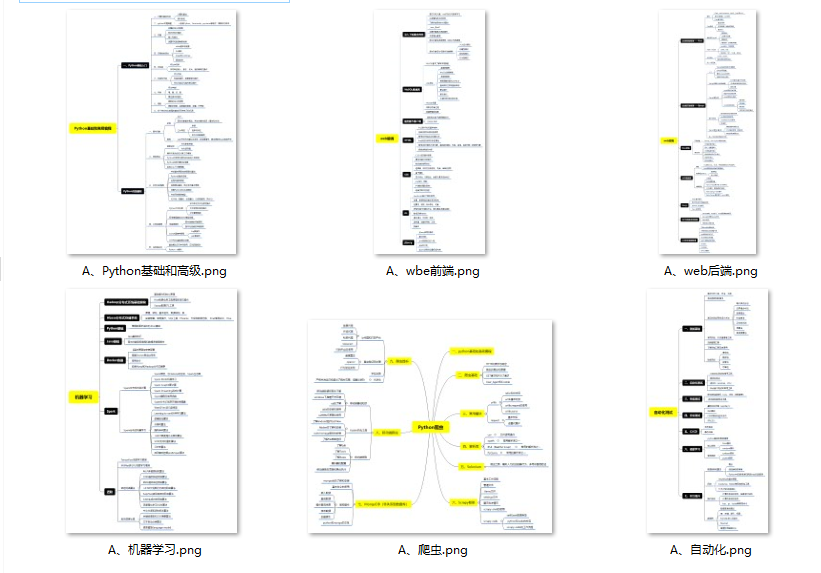

👉Python所有方向的学习路线👈

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉Python必备开发工具👈

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

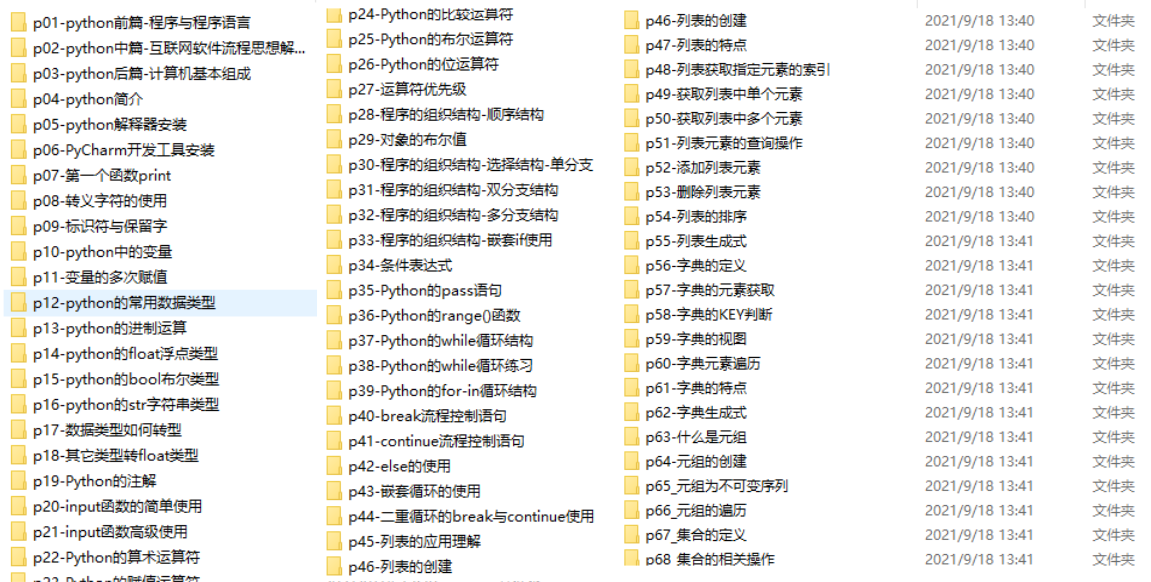

👉Python全套学习视频👈

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

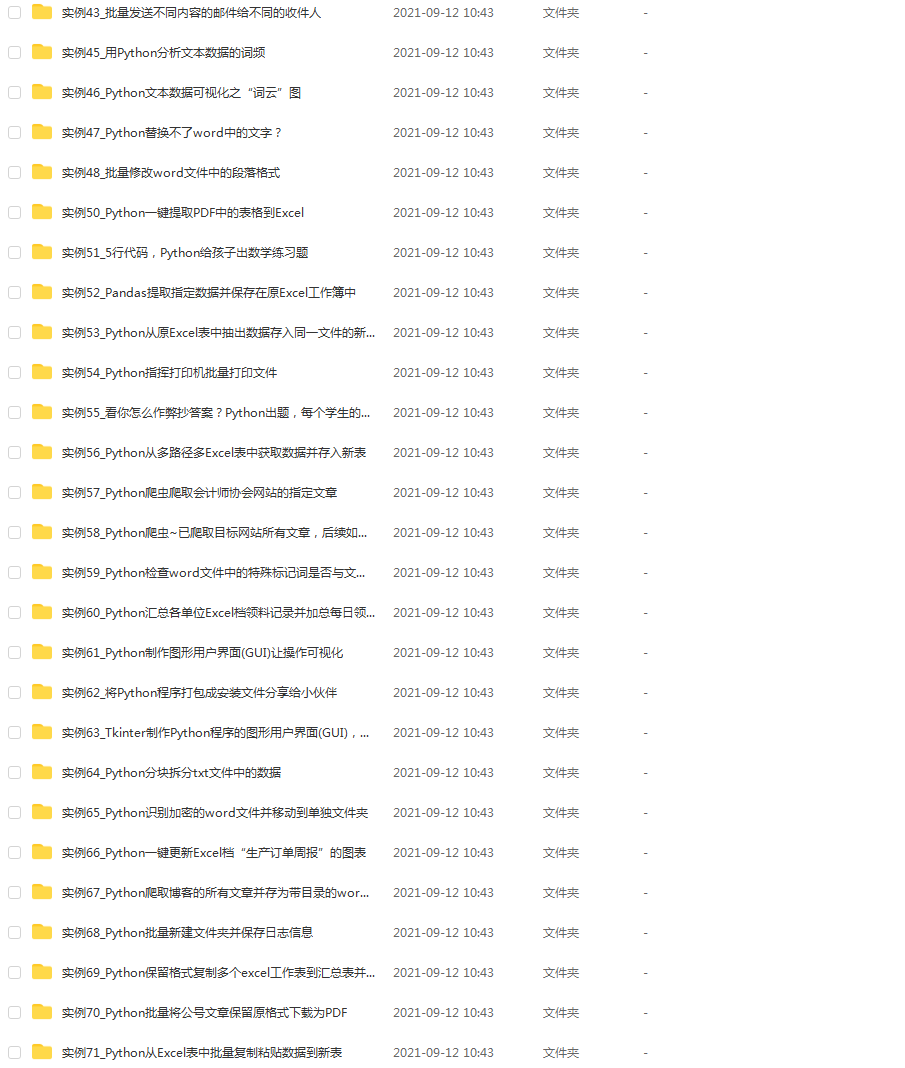

👉实战案例👈

学python就与学数学一样,是不能只看书不做题的,直接看步骤和答案会让人误以为自己全都掌握了,但是碰到生题的时候还是会一筹莫展。

因此在学习python的过程中一定要记得多动手写代码,教程只需要看一两遍即可。

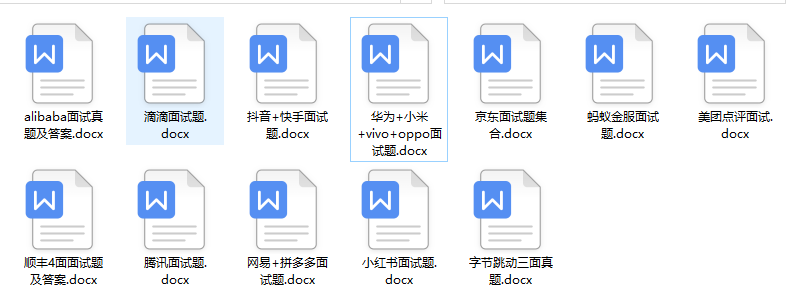

👉大厂面试真题👈

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

559

559

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?