先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Python全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Python知识点,真正体系化!

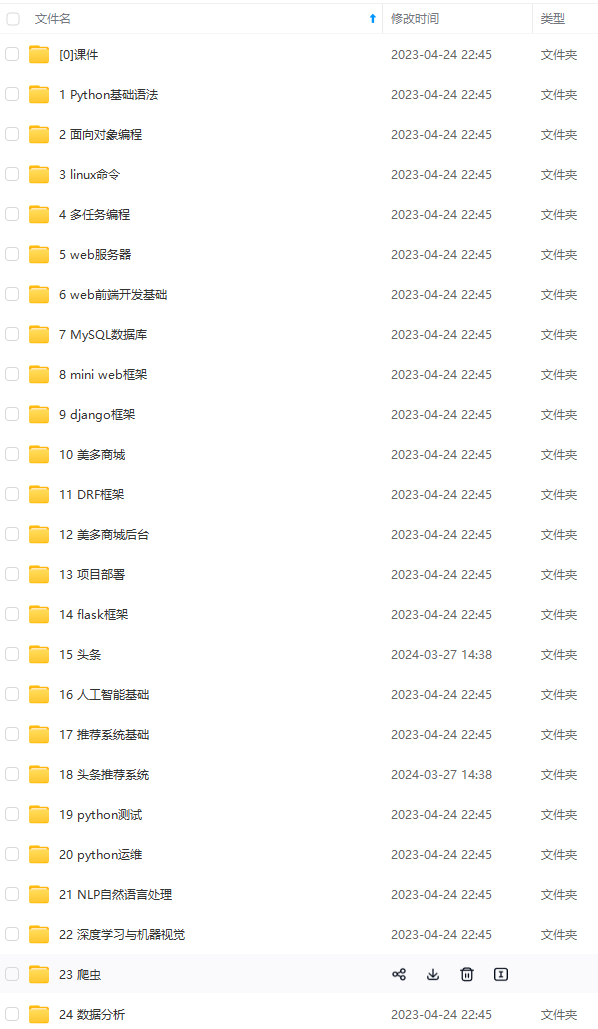

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024c (备注Python)

正文

==================================================================

数据集和单机版的一样也是采用威斯康星州临床科学中心开源的乳腺癌肿瘤数据集

from sklearn.datasets import load_breast_cancer

为了模拟横向联邦建模的场景,我们首先在本地将乳腺癌数据集切分为特征相同的横向联邦形式,当前的breast数据集有569条样本,我们将前面的469条作为训练样本,后面的100条作为评估测试样本。

从469条训练样本中,选取前200条作为公司A的本地数据,保存为breast_1_train.csv,将剩余的269条数据作为公司B的本地数据,保存为breast_2_train.csv。

测试数据集可以不需要切分,两个参与方使用相同的一份测试数据即可,文件命名为breast_eval.csv。

splitDataset.py

from sklearn.datasets import load_breast_cancer

import pandas as pd

breast_dataset = load_breast_cancer()

breast = pd.DataFrame(breast_dataset.data, columns=breast_dataset.feature_names)

breast = (breast-breast.mean())/(breast.std())

col_names = breast.columns.values.tolist()

columns = {}

for idx, n in enumerate(col_names):

columns[n] = “x%d”%idx

breast = breast.rename(columns=columns)

breast[‘y’] = breast_dataset.target

breast[‘idx’] = range(breast.shape[0])

idx = breast[‘idx’]

breast.drop(labels=[‘idx’], axis=1, inplace = True)

breast.insert(0, ‘idx’, idx)

breast = breast.sample(frac=1)

train = breast.iloc[:469]

eval = breast.iloc[469:]

breast_1_train = train.iloc[:200]

breast_1_train.to_csv(‘breast_1_train.csv’, index=False, header=True)

breast_2_train = train.iloc[200:]

breast_2_train.to_csv(‘breast_2_train.csv’, index=False, header=True)

eval.to_csv(‘breast_eval.csv’, index=False, header=True)

注:这一部分的逻辑和单机版的保持一致,我没有做更改。

===================================================================

在集群的fate01上的/data/projects/fate目录下新建chapter05文件夹(单机版叫这个名字,我也懒得换了),进入chapter05文件夹然后新建data文件夹,然后将数据集放到该目录下的data目录中。

参与的节点重复上面的操作,每个节点放置一份数据。

完成数据转换,需要一个配置文件和一个启动程序,我演示第一个节点的操作。

编写训练集的配置文件

upload_train.json

{

“file”: “chapter05/data/breast_1_train.csv”, //训练集的路径,我们这次试用fate_flow_client.py上传数据,默认的home路径是/data/projects/fate,所以我们需要把剩下的路径补充完整

“head”: 1,

“partition”: 1,//是否要分区,小数据不用分区

“work_mode”: 1,//0是单机,1是集群,我们要注意

“table_name”: “homo_breast_1_train”,

“namespace”: “homo_host_breast_train”//后面这两个字段一个是数据集的名字和命名空间,这个在后面的配置中要用到。

}

编写验证集的配置文件

upload_eval.json

{

“file”: “chapter05/data/breast_eval.csv”, //训练集的路径,我们这次试用fate_flow_client.py上传数据,默认的home路径是/data/projects/fate,所以我们需要把剩下的路径补充完整

“head”: 1,

“partition”: 1,//是否要分区,小数据不用分区

“work_mode”: 1,//0是单机,1是集群,我们要注意

“table_name”: “homo_breast_eval”,

“namespace”: “homo_host_breast_eval”//后面这两个字段一个是数据集的名字和命名空间,这个在后面的配置中要用到。

}

上面的配置每个节点都配置一份,切分数据集时,训练集切了两份,验证集只有一份,所以验证集配置成一样的,训练我在fate01和fate03上使用的breast_1_train.csv,在fate02上用breast_2_train.csv,大家根据自己的情况修改配置文件即可。

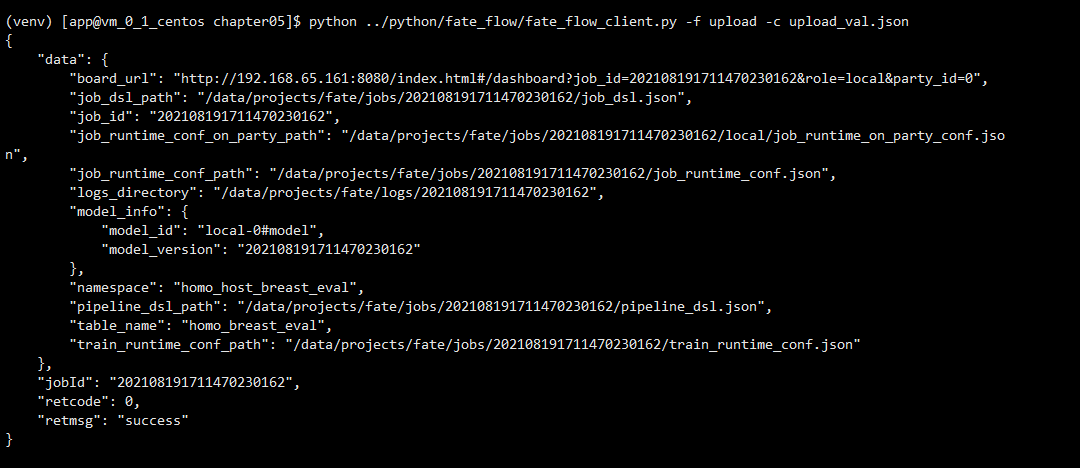

下面执行上传数据的操作,有两种方式上传数据,一种是用fate_flow_client.py上传数据,一种使用flow命令上传数据,我在使用flow上传数据时遇到一些问题,所以先演示如何使用fate_flow_client.py上传数据。具体的详细使用可以查阅官方的文档。

官方文档:上传数据指南 — FATE documentation

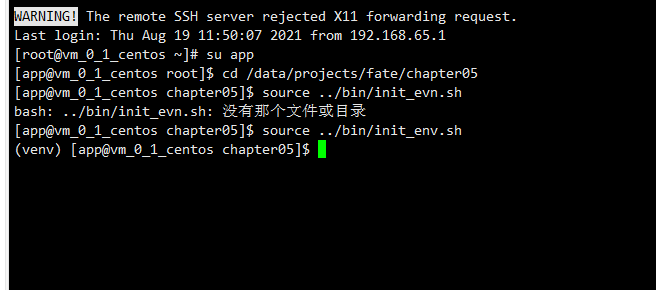

启动虚拟环境,并进入chapter05下面,如图:

然后执行:

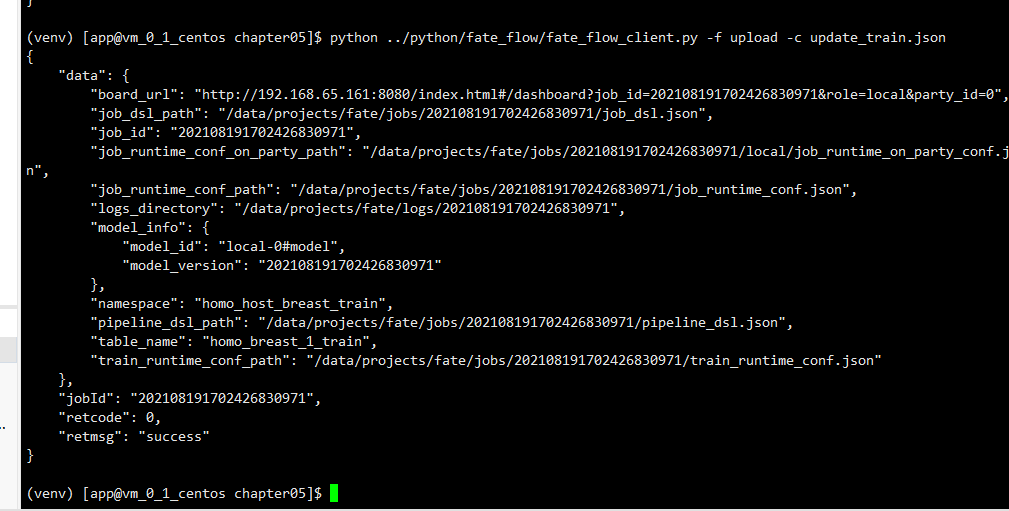

python …/fate_flow/python/fate_flow_client.py -f upload -c upload_train.json

-f :函数名称

-c :配置文件

将验证集也上传上去:

fate02和fate03重复上面的步骤,把训练集和测试传上去。

到这里数据集已经上传,接着就可以开始做训练了。

=================================================================

为了让任务模型的构建更加灵活,目前 FATE 使用了一套自定的领域特定语言 (DSL) 来描述任务。在 DSL 中,各种模块(例如数据读写 data_io,特征工程 feature-engineering, 回归 regression,分类 classification)可以通向一个有向无环图 (DAG) 组织起来。通过各种方式,用户可以根据自身的需要,灵活地组合各种算法模块。

除此之外,每个模块都有不同的参数需要配置,不同的 party 对于同一个模块的参数也可能有所区别。为了简化这种情况,对于每一个模块,FATE 会将所有 party 的不同参数保存到同一个运行配置文件(Submit Runtime Conf)中,并且所有的 party 都将共用这个配置文件。这个指南将会告诉你如何创建一个 DSL 配置文件。

官方的文档:DSL 配置和运行配置 V1 — FATE documentation

所以我们需要写一个DSL配置文件和Config文件。

1)DSL文件配置

文件名字:test_homolr_train_job_dsl.json

{

“components” : {

“dataio_0”: {

“module”: “DataIO”,

“input”: {

“data”: {

“data”: [

“args.train_data”

]

}

},

“output”: {

“data”: [“train”],

“model”: [“dataio”]

}

},

“dataio_1”: {

“module”: “DataIO”,

“input”: {

“data”: {

“data”: [

“args.eval_data”

]

},

“model”: [“dataio_0.dataio”]

},

“output”: {

“data”: [“eval_data”]

}

},

“feature_scale_0”: {

“module”: “FeatureScale”,

“input”: {

“data”: {

“data”: [

“dataio_0.train”

]

}

},

“output”: {

“data”: [“train”],

“model”: [“feature_scale”]

}

},

“feature_scale_1”: {

“module”: “FeatureScale”,

“input”: {

“data”: {

“data”: [

“dataio_1.eval_data”

]

}

},

“output”: {

“data”: [“eval_data”],

“model”: [“feature_scale”]

}

},

“homo_lr_0”: {

“module”: “HomoLR”,

“input”: {

“data”: {

“train_data”: [

“feature_scale_0.train”

]

}

},

“output”: {

“data”: [

“train”

],

“model”: [“homolr”]

}

},

“homo_lr_1”: {

“module”: “HomoLR”,

“input”: {

“data”: {

“eval_data”: [

“feature_scale_1.eval_data”

]

},

“model”: [

“homo_lr_0.homolr”

]

},

“output”: {

“data”: [

“eval_data”

],

“model”: [“homolr”]

}

},

“evaluation_0”: {

“module”: “Evaluation”,

“input”: {

“data”: {

“data”: [

“homo_lr_0.train”

]

}

}

},

“evaluation_1”: {

“module”: “Evaluation”,

“input”: {

“data”: {

“data”: [

“homo_lr_1.eval_data”

]

}

}

}

}

}

我在DSL里面配置了训练集组件和验证集组件,这个组件的配置在单机版的横向联邦中提到过。

2)Config配置文件

如果你也是看准了Python,想自学Python,在这里为大家准备了丰厚的免费学习大礼包,带大家一起学习,给大家剖析Python兼职、就业行情前景的这些事儿。

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

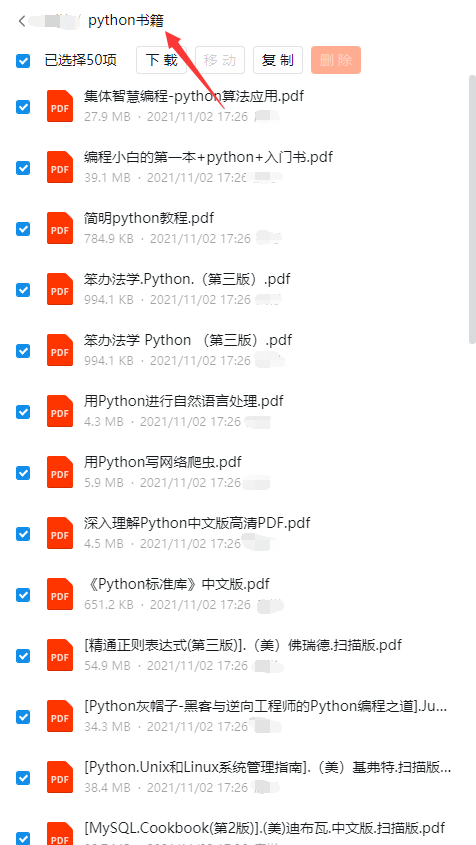

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

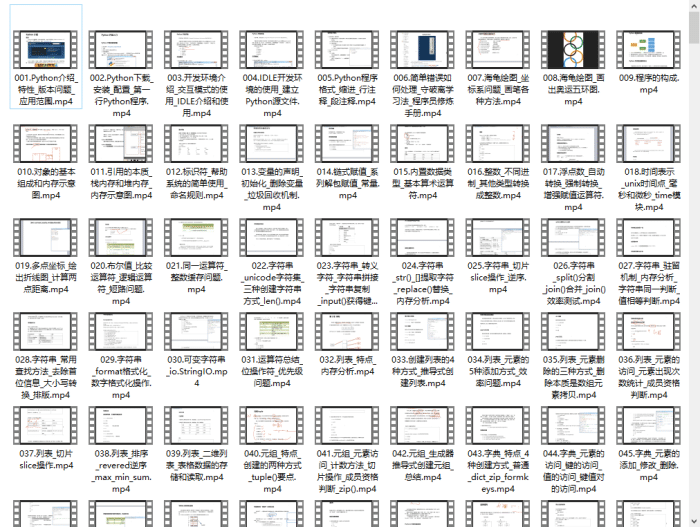

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

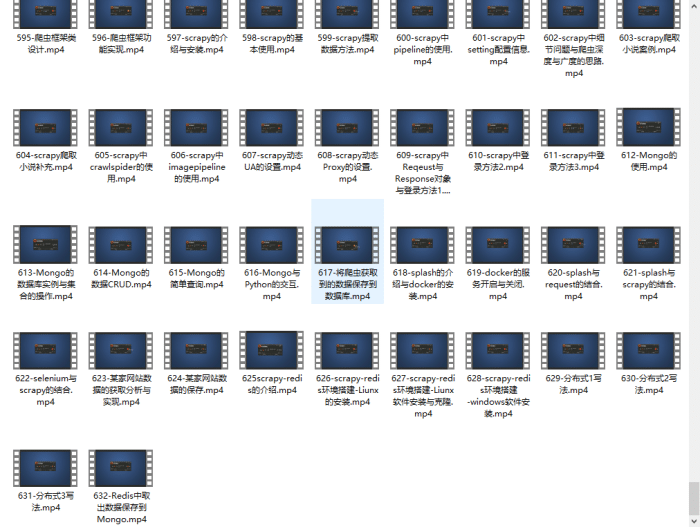

四、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

五、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

成为一个Python程序员专家或许需要花费数年时间,但是打下坚实的基础只要几周就可以,如果你按照我提供的学习路线以及资料有意识地去实践,你就有很大可能成功!

最后祝你好运!!!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

五、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

成为一个Python程序员专家或许需要花费数年时间,但是打下坚实的基础只要几周就可以,如果你按照我提供的学习路线以及资料有意识地去实践,你就有很大可能成功!

最后祝你好运!!!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)

[外链图片转存中…(img-x44WJlHu-1713665407309)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1022

1022

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?