做了那么多年开发,自学了很多门编程语言,我很明白学习资源对于学一门新语言的重要性,这些年也收藏了不少的Python干货,对我来说这些东西确实已经用不到了,但对于准备自学Python的人来说,或许它就是一个宝藏,可以给你省去很多的时间和精力。

别在网上瞎学了,我最近也做了一些资源的更新,只要你是我的粉丝,这期福利你都可拿走。

我先来介绍一下这些东西怎么用,文末抱走。

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

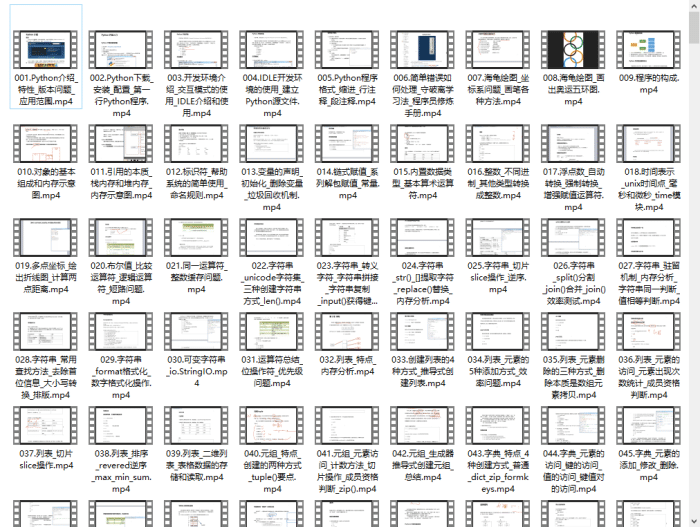

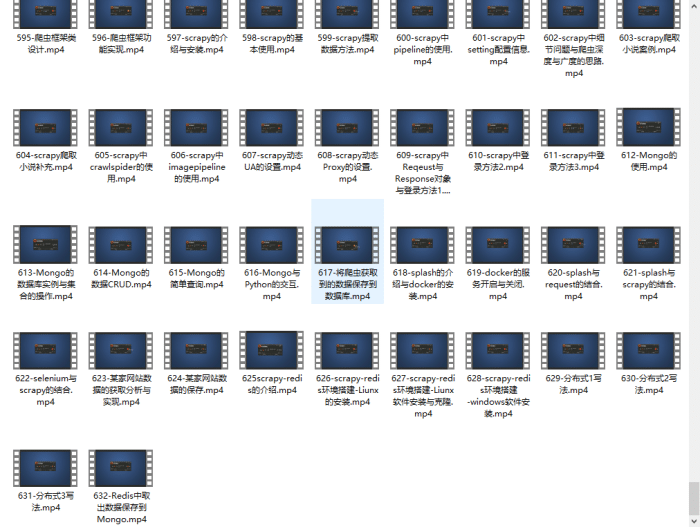

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

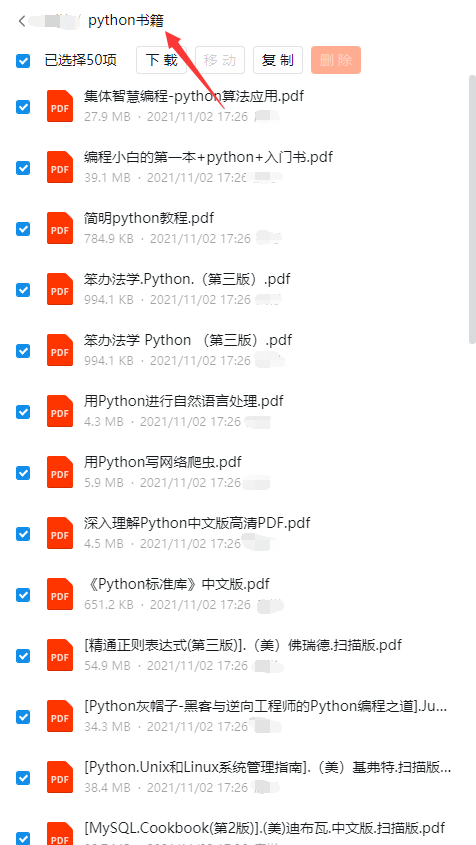

(4)200多本电子书

这些年我也收藏了很多电子书,大概200多本,有时候带实体书不方便的话,我就会去打开电子书看看,书籍可不一定比视频教程差,尤其是权威的技术书籍。

基本上主流的和经典的都有,这里我就不放图了,版权问题,个人看看是没有问题的。

(5)Python知识点汇总

知识点汇总有点像学习路线,但与学习路线不同的点就在于,知识点汇总更为细致,里面包含了对具体知识点的简单说明,而我们的学习路线则更为抽象和简单,只是为了方便大家只是某个领域你应该学习哪些技术栈。

(6)其他资料

还有其他的一些东西,比如说我自己出的Python入门图文类教程,没有电脑的时候用手机也可以学习知识,学会了理论之后再去敲代码实践验证,还有Python中文版的库资料、MySQL和HTML标签大全等等,这些都是可以送给粉丝们的东西。

这些都不是什么非常值钱的东西,但对于没有资源或者资源不是很好的学习者来说确实很不错,你要是用得到的话都可以直接抱走,关注过我的人都知道,这些都是可以拿到的。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

- 第二步:发送请求,获取响应

- 第三步:获取第一页中39个详情页地址

- 第四步:获取39个详情页信息

- 第五步:存入SqlServer数据库

- 第六步:实现主页翻页(1-91页)

1. 设置翻页

我们先手动翻页,1-3页:

http://www.mp.cc/search/1?category=25

http://www.mp.cc/search/2?category=25

http://www.mp.cc/search/3?category=25

可以看出来,网址只有中间一个数据在逐步递增,所以就可以构造主页地址,代码如下:

for i in range(1,92):

# 1.构造主页地址

url = self.baseurl % i

这里做了字符串拼接,baseurl在 __init__(self)中:

self.baseurl = "http://www.mp.cc/search/%s?category=25" #通过%s传数字进入

2. 获取代理ip

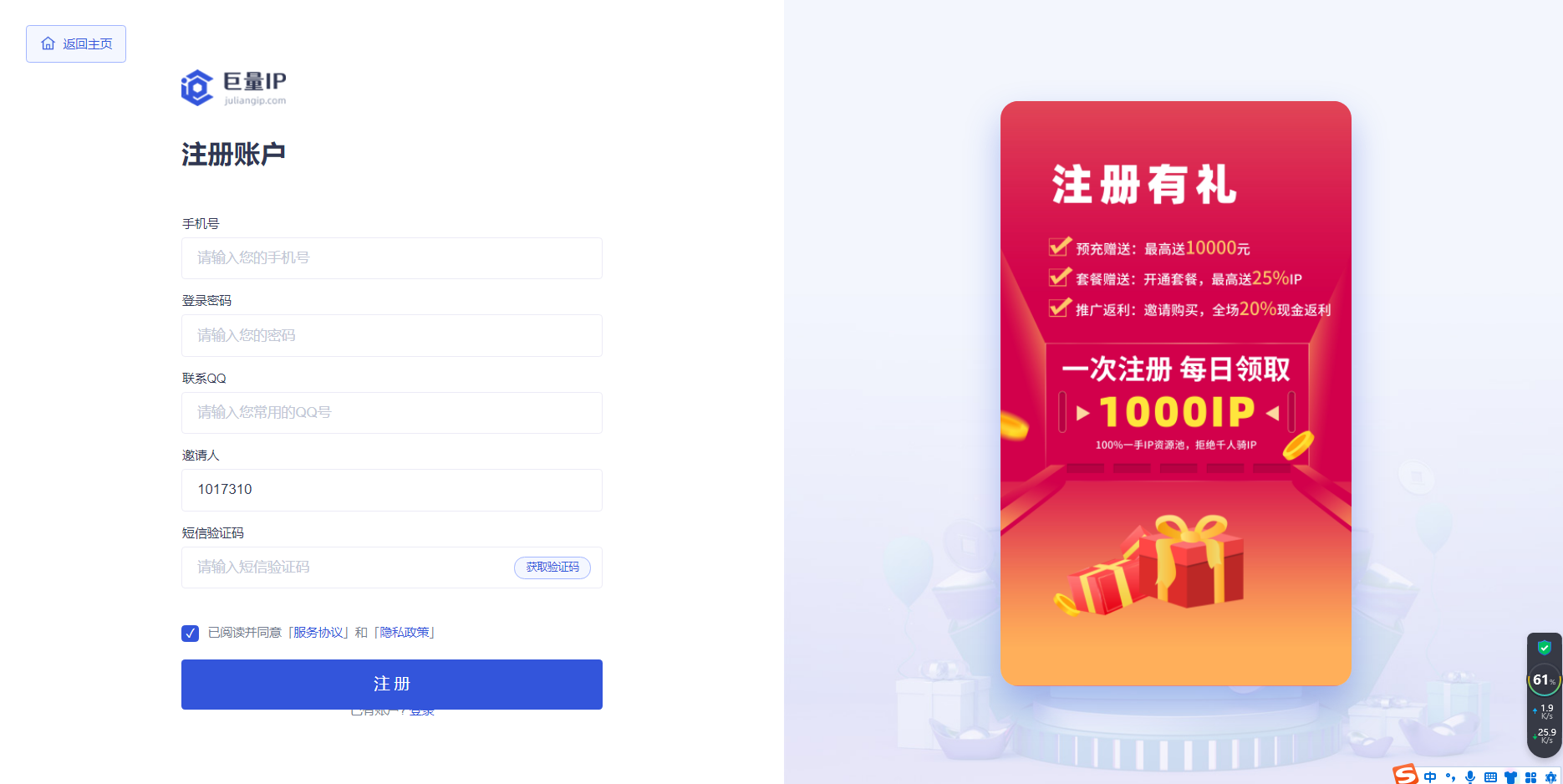

1、打开巨量IP官网:巨量IP官网

2、输入账号信息进行注册:

3、这里需要进行实名认证,如果不会的可以看:个人注册实名教程:

4、进入会员中心,点击领取今日免费IP:

5、详细步骤看官方的教程文档:巨量HTTP—免费代理ip套餐领取教程,领取后如下图:

6、点击产品管理》动态代理(包时),可以看到我们刚才领取到的免费IP信息:

7、将自己电脑的IP添加为白名单能获取代理IP,点击授权信息:

8、依次点击修改授权》快速添加》确定

9、添加完成后,点击生成提取链接:

10、设置每次提取的数量,点击生成链接,并复制链接:

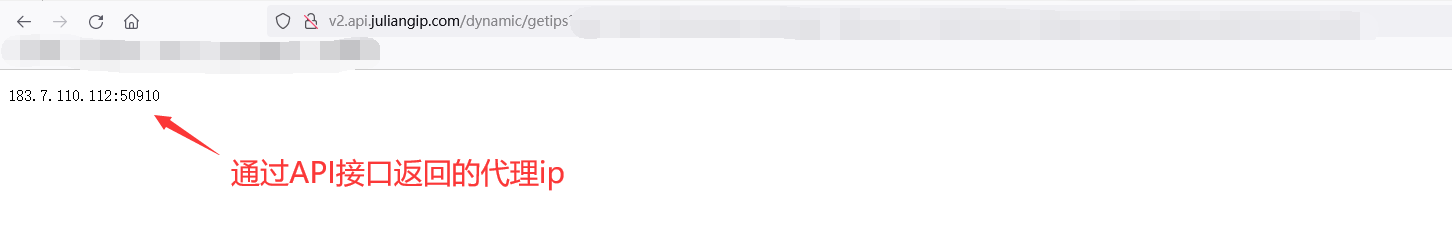

11、将复制链接,复制到地址栏就可以看到我们获取到的代理IP了:

12、通过爬虫去获取API接口的里面的代理IP(注意:下面代理URL,换成自己的API链接):

import requests

import time

import random

def get\_ip():

url = "这里放你自己的API链接"

while 1:

try:

r = requests.get(url, timeout=10)

except:

continue

ip = r.text.strip()

if '请求过于频繁' in ip:

print('IP请求频繁')

time.sleep(1)

continue

break

proxies = {

'https': '%s' % ip

}

return proxies

if __name__ == '\_\_main\_\_':

proxies = get_ip()

print(proxies)

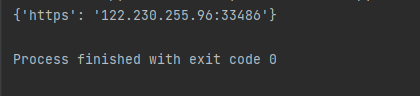

运行结果,可以看到返回了接口中的代理IP:

3. 发送请求

发送请求,获取响应,代码如下:

def \_\_init\_\_(self) :

self.baseurl = "http://www.mp.cc/search/%s?category=25"

self.headers = {"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36"}

# 发送请求,获取相应

def parse\_url(self,url):

# 获取代理ip

proxies = get_ip()

# 使用代理ip和请求头

response = requests.get(url,headers=self.headers,proxies=proxies)

return response.content.decode() #返回网页代码,我们就在这里面提取数据

这会就有小伙伴不明白了,你headers什么意思啊?

- 防止服务器把我们认出来是爬虫,所以模拟浏览器头部信息,向服务器发送消息

- 这个 “装” 肯定必须是要装的!!!

4. 获取详情页地址

获取第一页中39个详情页地址,代码如下:

def get\_content\_list(self,html_str):

html = etree.HTML(html_str)

div_list = html.xpath("//div[@class='item\_wrapper']") # 根据div分组

item = {}

# 获取网页(只有半截,如:/brand/detail/36003501)

for div in div_list:

item["href"]= div.xpath("//a[@class='img-container']/@href")

# 拼接网页

for i in range(39):

item["href"][i] = 'http://www.mp.cc%s' % item["href"][i]

#遍历字典存入列表

for value in item.values():

content_list = value

print(content_list)

return content_list

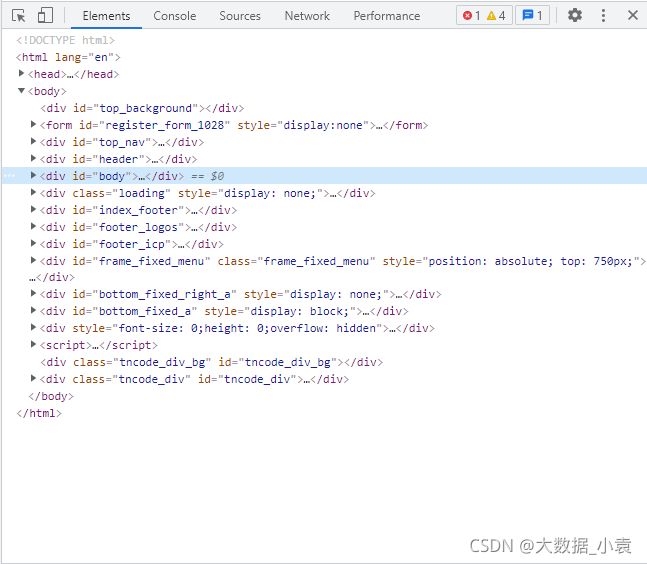

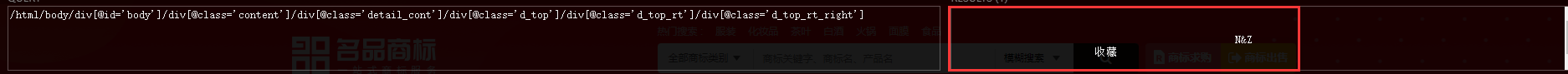

1)我们先把获取到的主页代码转换为Elements对象,就和网页中的一样,如下图: html = etree.HTML(html_str)

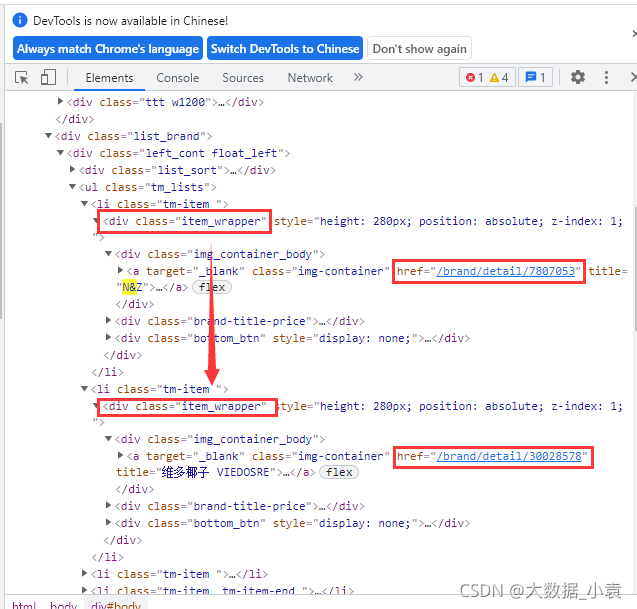

2)写Xpath根据div分组:div_list = html.xpath("//div[@class='item_wrapper']")

如图可以看出每个商标的详情地址都在<div class="item_wrapper">中

3)提取地址

item = {}

for div in div_list:

item["href"]= div.xpath("//a[@class='img-container']/@href")

# 拼接网页

for i in range(39):

item["href"][i] = 'http://www.mp.cc%s' % item["href"][i]

#遍历字典存入列表

for value in item.values():

content_list = value

4)效果如下:

['http://www.mp.cc/brand/detail/36449901', 'http://www.mp.cc/brand/detail/26298802', 'http://www.mp.cc/brand/detail/22048146', 'http://www.mp.cc/brand/detail/4159836', 'http://www.mp.cc/brand/detail/9603914', 'http://www.mp.cc/brand/detail/4156243', 'http://www.mp.cc/brand/detail/36575014', 'http://www.mp.cc/brand/detail/39965756', 'http://www.mp.cc/brand/detail/36594259', 'http://www.mp.cc/brand/detail/37941094', 'http://www.mp.cc/brand/detail/38162960', 'http://www.mp.cc/brand/detail/38500643', 'http://www.mp.cc/brand/detail/38025192', 'http://www.mp.cc/brand/detail/37755982', 'http://www.mp.cc/brand/detail/37153272', 'http://www.mp.cc/brand/detail/35335841', 'http://www.mp.cc/brand/detail/36003501', 'http://www.mp.cc/brand/detail/27794101', 'http://www.mp.cc/brand/detail/26400645', 'http://www.mp.cc/brand/detail/25687631', 'http://www.mp.cc/brand/detail/25592319',

'http://www.mp.cc/brand/detail/25593974', 'http://www.mp.cc/brand/detail/24397124', 'http://www.mp.cc/brand/detail/23793395', 'http://www.mp.cc/brand/detail/38517219', 'http://www.mp.cc/brand/detail/36921312', 'http://www.mp.cc/brand/detail/6545326\_6545324', 'http://www.mp.cc/brand/detail/8281719', 'http://www.mp.cc/brand/detail/4040639', 'http://www.mp.cc/brand/detail/42819737', 'http://www.mp.cc/brand/detail/40922772', 'http://www.mp.cc/brand/detail/41085317', 'http://www.mp.cc/brand/detail/40122971', 'http://www.mp.cc/brand/detail/39200273', 'http://www.mp.cc/brand/detail/38870472', 'http://www.mp.cc/brand/detail/38037836', 'http://www.mp.cc/brand/detail/37387087', 'http://www.mp.cc/brand/detail/36656221', 'http://www.mp.cc/brand/detail/25858042']

因为我们获取的详情页地址只有半截,所以在做一个拼接!

可能这里有小伙伴要问了为什么你要先存入字典再存列表呢???

可以自己试试如果直接存列表,所有的地址全部都挤在一起了,没法拼接!!!

5. 提取详情信息

分别进行39个详情页,并获取信息,代码如下:

# 获取39个详情页信息

def get\_information(self,content_list):

information = []

for i in range(len(content_list)):

details_url = content_list[i]

html_str = self.parse_url(details_url)

html = etree.HTML(html_str)

div_list = html.xpath("//div[@class='d\_top']") # 根据div分组

item = []

for div in div_list:

title = div.xpath("///div[@class='d\_top\_rt\_right']/text()")

price = div.xpath("//div[@class='text price2box']/span[2]/text()")

number = div.xpath("//div[@class='text'][1]/text()")

category = div.xpath("//div[@class='text'][2]/span[@class='cate']/text()")

term = div.xpath("//div[@class='text'][3]/text()")

groups = div.xpath("//div[@class='text'][4]/text()")

Range = div.xpath("//div[@class='text'][5]/text()")

img = div.xpath("//img[@class='img\_logo']/@src")

title = ' '.join(title).replace('\n', '').replace('\r', '').replace(' ','')

price = ' '.join(price)

number = ' '.join(number).replace('\n', '').replace('\r', '').replace(' ','')

category = ' '.join(category)

term = ' '.join(term).replace('\n', '').replace('\r', '').replace(' ','')

groups = ' '.join(groups).replace('\n', '').replace('\r', '').replace(' ','')

Range = ' '.join(Range).replace('\n', '').replace('\r', '').replace(' ','')

img = ' '.join(img)

item.append(title)

item.append(price)

item.append(number)

item.append(category)

item.append(term)

item.append(groups)

item.append(Range)

item.append(img)

item = tuple(item)

information.append(item)

#print(information)

return information

1)根据content_list长度遍历(分别获取详情页地址),并调用parse_url方法获取网页源码

for i in range(len(content_list)):

details_url = content_list[i]

html_str = self.parse_url(details_url)

2)根据div分组并获取数据

html = etree.HTML(html_str)

div_list = html.xpath("//div[@class='d\_top']") # 根据div分组

item = []

for div in div_list:

title = div.xpath("///div[@class='d\_top\_rt\_right']/text()")

price = div.xpath("//div[@class='text price2box']/span[2]/text()")

number = div.xpath("//div[@class='text'][1]/text()")

category = div.xpath("//div[@class='text'][2]/span[@class='cate']/text()")

term = div.xpath("//div[@class='text'][3]/text()")

groups = div.xpath("//div[@class='text'][4]/text()")

Range = div.xpath("//div[@class='text'][5]/text()")

img = div.xpath("//img[@class='img\_logo']/@src")

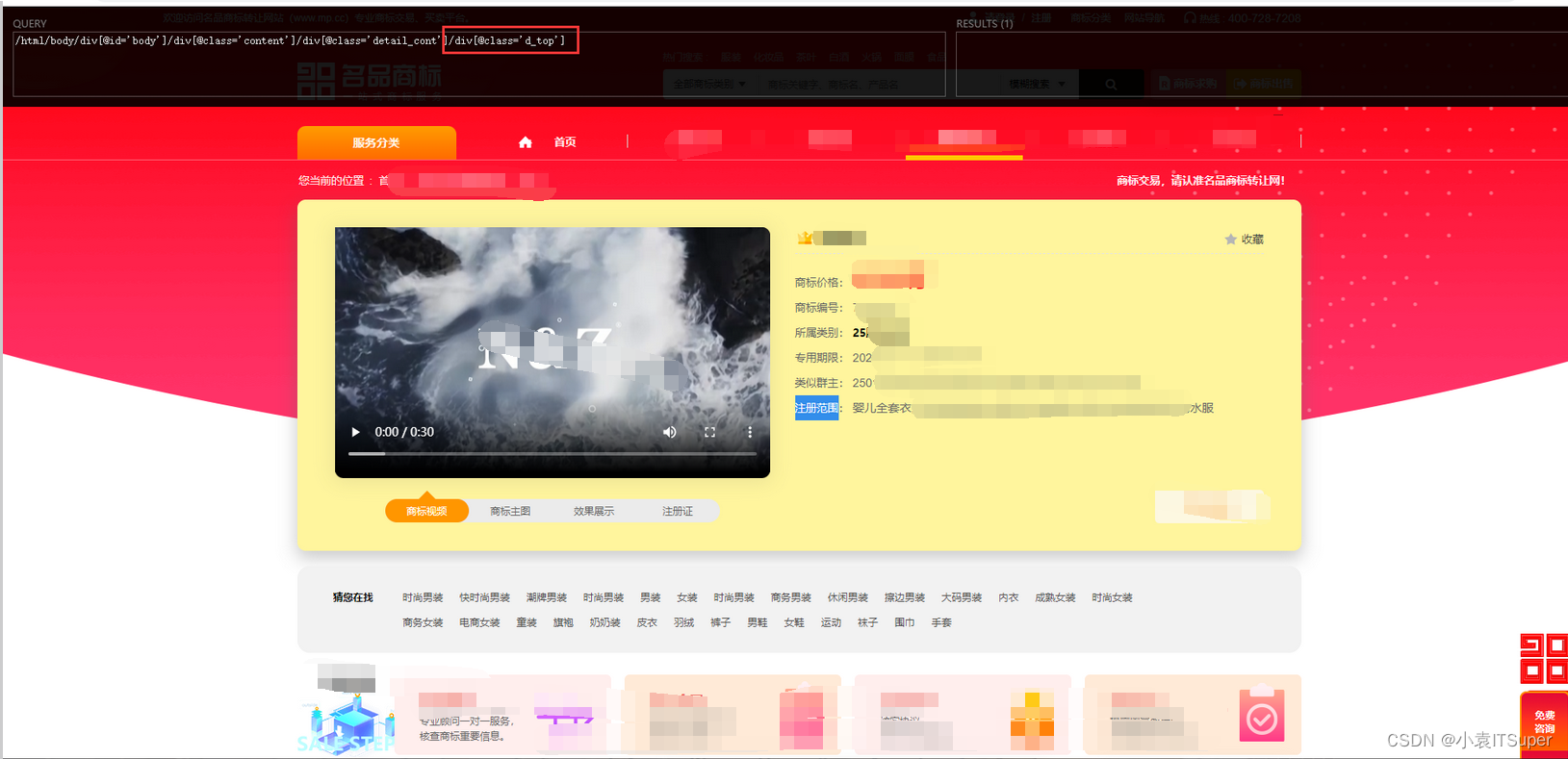

- 好了又要小伙伴要问了XPath怎么写?,这里我用的是XPath Helper工具,就是下图那个黑框可以帮我们写Xpath定位元素,有需要的我可以写个安装使用教程

4)因为个别数据有空格换行符所以要先去掉,如图:

title = ' '.join(title).replace('\n', '').replace('\r', '').replace(' ','')

price = ' '.join(price)

number = ' '.join(number).replace('\n', '').replace('\r', '').replace(' ','')

category = ' '.join(category)

term = ' '.join(term).replace('\n', '').replace('\r', '').replace(' ','')

groups = ' '.join(groups).replace('\n', '').replace('\r', '').replace(' ','')

Range = ' '.join(Range).replace('\n', '').replace('\r', '').replace(' ','')

img = ' '.join(img)

6. 存入数据库

把数据存入数据库,需要注意的是服务器名,账户,密码,数据库名和SQL语句中的表名!

def insert\_sqlserver(self, information):

# 连接本地数据库服务,创建游标对象

db = pymssql.connect('.', 'sa', 'yuan427', 'test') #服务器名,账户,密码,数据库名

if db:

print("连接成功!")

cursor= db.cursor()

try:

# 插入sql语句

sql = "insert into test6 (title,price,number,category,term,groups,Range,img) values (%s,%s,%s,%s,%s,%s,%s,%s)"

# 执行插入操作

cursor.executemany(sql,information)

db.commit()

print('成功载入......' )

except Exception as e:

db.rollback()

print(str(e))

# 关闭游标,断开数据库

cursor.close()

db.close()

7. 循环实现翻页

循环以上五步,按页数实现翻页

# 实现主要逻辑

def run(self):

# 6.实现主页翻页(1,92)

for i in range(1,92):

# 1.构造主页地址

url = self.baseurl % i

x = 0

while x<1:

# 2.发送请求,获取相应

html_str = self.parse_url(url)

# 3.获取第一页中39个详情页地址

content_list= self.get_content_list(html_str)

# 4.获取39个详情页信息

information = self.get_information(content_list)

# 5.入库

self.insert_sqlserver(information)

x += 1

8. 启动

if __name__ == "\_\_main\_\_":

trademarkSpider = TrademarkSpider()

trademarkSpider.run()

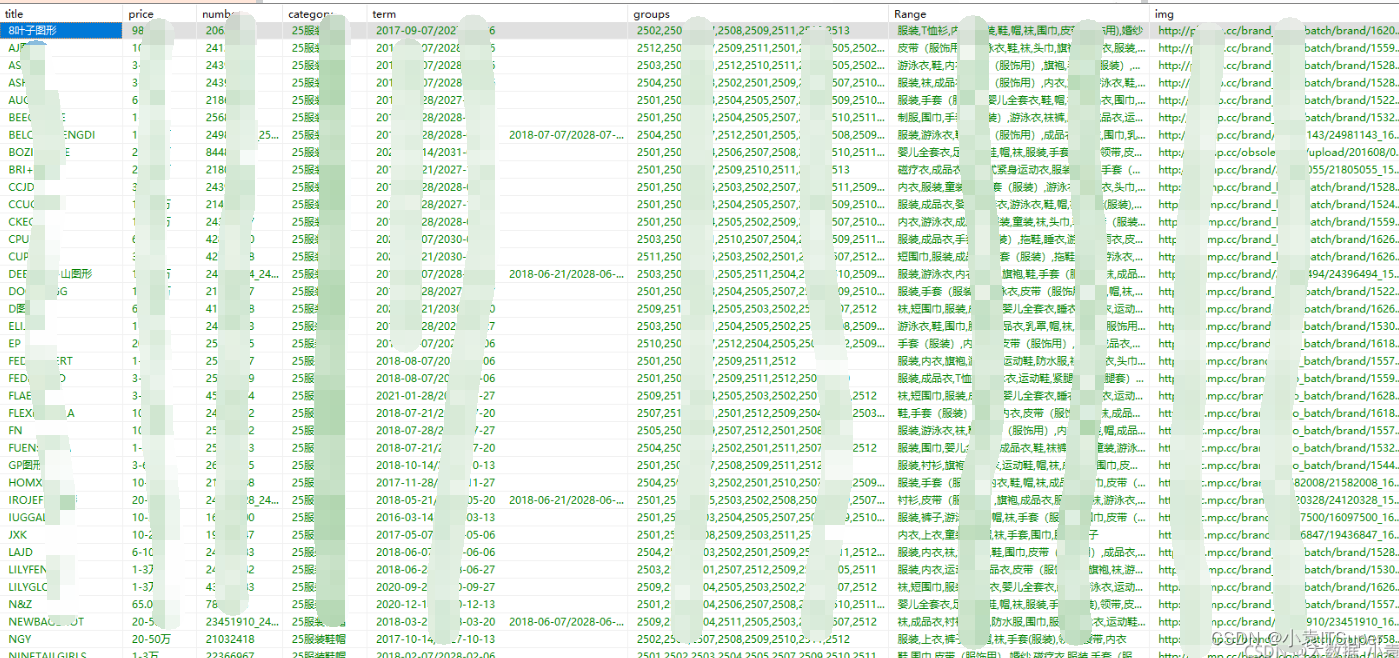

打开数据库看看是不是我们想要的结果:

O了O了!!!

这也是我第一次写爬虫实战,有讲的不对的地方,希望各位大佬指正!!!,如果有不明白的地方评论区留言回复!兄弟们来个点赞有空就更新爬虫实战!!!

如果你也是看准了Python,想自学Python,在这里为大家准备了丰厚的免费学习大礼包,带大家一起学习,给大家剖析Python兼职、就业行情前景的这些事儿。

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

四、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

五、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

成为一个Python程序员专家或许需要花费数年时间,但是打下坚实的基础只要几周就可以,如果你按照我提供的学习路线以及资料有意识地去实践,你就有很大可能成功!

最后祝你好运!!!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

6484

6484

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?