一、MapReduce编程实例——词频统计实现

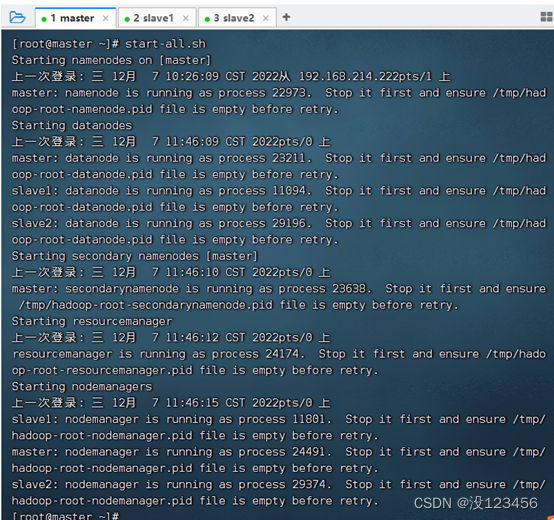

启动hadoop服务

1、准备数据文件

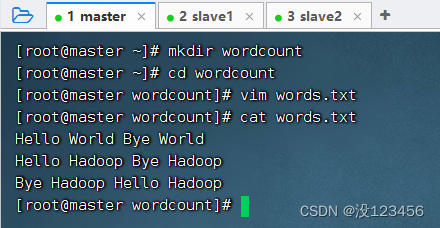

(1)在虚拟机上创建文本文件

创建wordcount目录,在里面创建words.txt文件

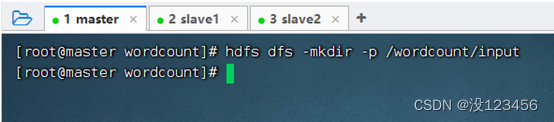

(2)上传文件到HDFS指定目录

创建/wordcount/input目录,执行命令:hdfs dfs -mkdir -p /wordcount/input

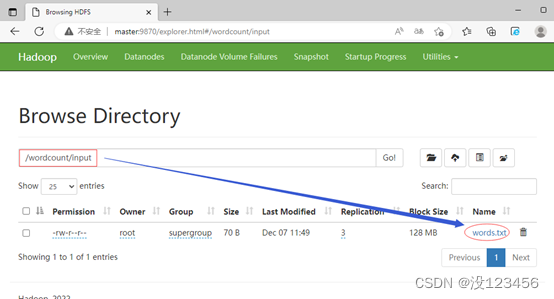

将文本文件words.txt,上传到HDFS的/wordcount/input目录

在Hadoop WebUI界面上查看上传的文件

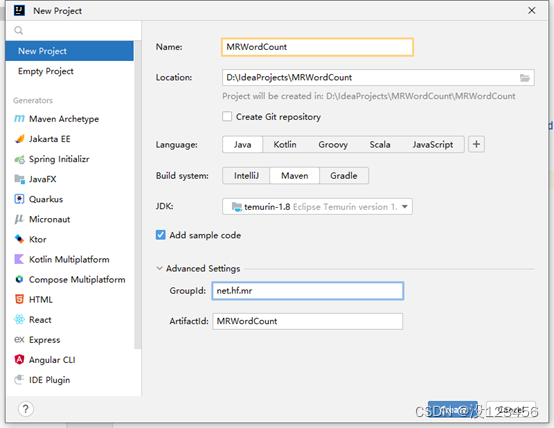

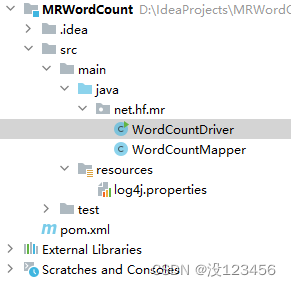

2、创建Maven项目

创建Maven项目 - MRWordCount

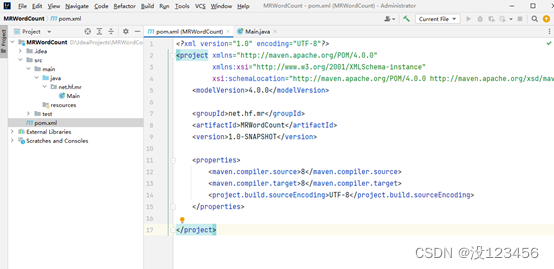

3、添加相关依赖

在pom.xml文件里添加hadoop和junit依赖

<dependencies>

<!--hadoop客户端-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>3.3.4</version>

</dependency>

<!--单元测试框架-->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.13.2</version>

</dependency>

</dependencies>

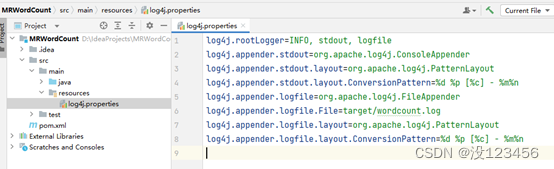

4、创建日志属性文件

在resources目录里创建log4j.properties文件

log4j.rootLogger=INFO, stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/wordcount.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

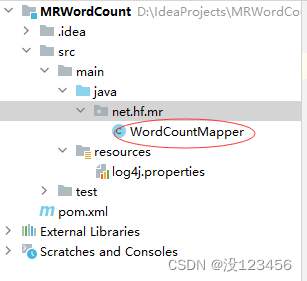

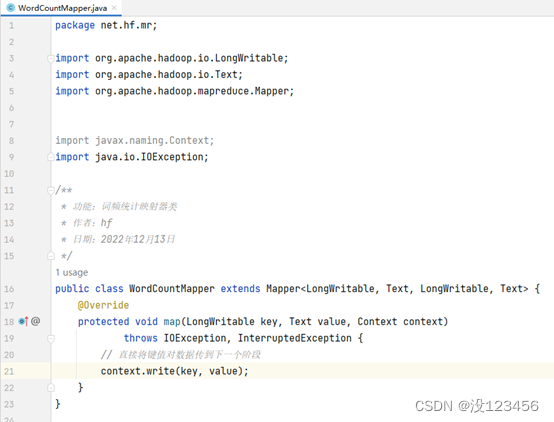

5、创建词频统计映射器类

创建net.hf.mr包,在包里创建WordCountMapper类

package net.hw.mr;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

/**

* 功能:词频统计映射器类

* 作者:hf

* 日期:2022年12月13日

*/

public class WordCountMapper extends Mapper<LongWritable, Text, LongWritable, Text> {

@Override

protected void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

// 直接将键值对数据传到下一个阶段

context.write(key, value);

}

}

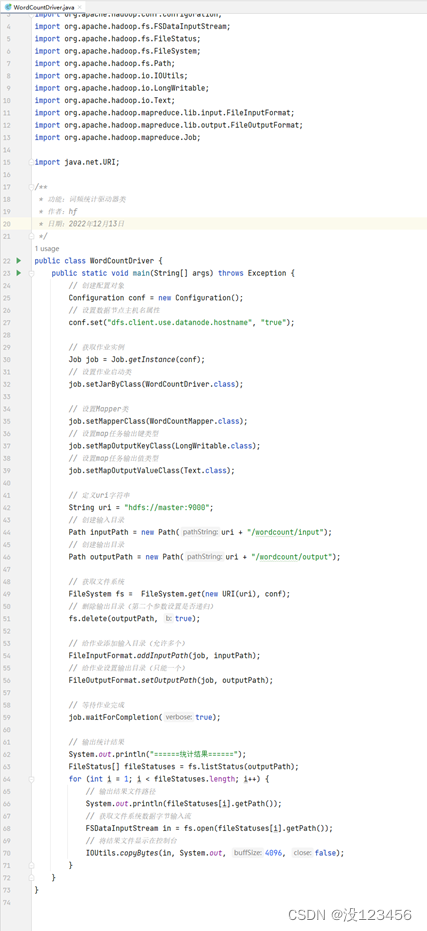

6、创建词频统计驱动器类

在net.hf.mr包里创建WordCountDriver类

package net.hw.mr;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.net.URI;

/**

* 功能:词频统计驱动器类

* 作者:hf

* 日期:2022年12月13日

*/

public class WordCountDriver {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 获取作业实例

Job job = Job.getInstance(conf);

// 设置作业启动类

job.setJarByClass(WordCountDriver.class);

// 设置Mapper类

job.setMapperClass(WordCountMapper.class);

// 设置map任务输出键类型

job.setMapOutputKeyClass(LongWritable.class);

// 设置map任务输出值类型

job.setMapOutputValueClass(Text.class);

// 定义uri字符串

String uri = "hdfs://master:9000";

// 创建输入目录

Path inputPath = new Path(uri + "/wordcount/input");

// 创建输出目录

Path outputPath = new Path(uri + "/wordcount/output");

// 获取文件系统

FileSystem fs = FileSystem.get(new URI(uri), conf

本文详细介绍了使用Hadoop MapReduce实现词频统计的过程,包括创建Maven项目,配置相关依赖,编写映射器、归并器和驱动器类,以及在虚拟机上运行和查看结果。通过修改代码,实现对单词计数的优化,并讨论了多个Reduce任务的合并及不同单词数的统计方法。

本文详细介绍了使用Hadoop MapReduce实现词频统计的过程,包括创建Maven项目,配置相关依赖,编写映射器、归并器和驱动器类,以及在虚拟机上运行和查看结果。通过修改代码,实现对单词计数的优化,并讨论了多个Reduce任务的合并及不同单词数的统计方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1378

1378

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?