文章目录

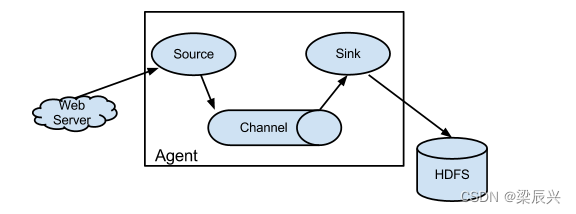

Shell定时采集数据到HDFS

服务器每天会产生大量日志数据,并且日志文件可能存在于每个应用程序指定的data目录中,在不使用其它工具的情况下,将服务器中的日志文件规范地存放在HDFS中。通过编写简单的Shell脚本,用于每天自动采集服务器上的日志文件,并将海量的日志上传至HDFS中。

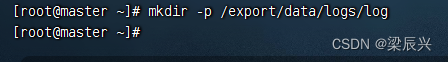

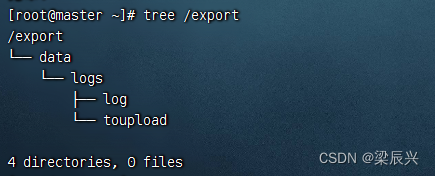

创建日志文件存放的目录/export/data/logs/log,执行命令:mkdir -p /export/data/logs/log

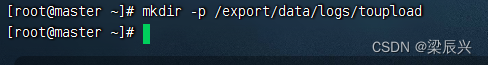

创建待上传文件存放的目录/export/data/logs/toupload,执行命令:mkdir -p /export/data/logs/toupload

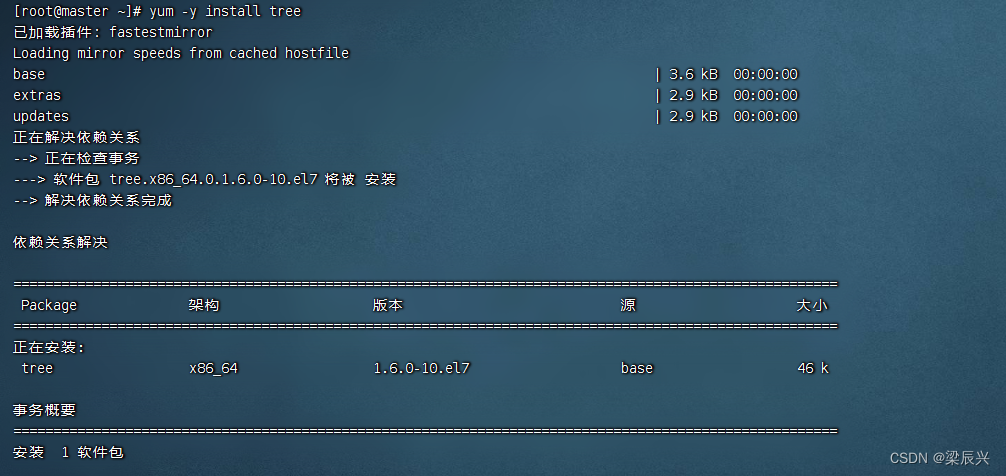

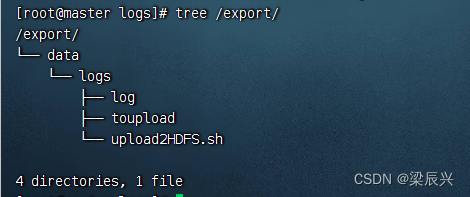

查看创建的目录树结构,需要使用tree工具,如果没有安装需要安装,输入命令:yum -y install tree

查看创建的目录树结构,输入命令:tree /export

一,编程思路与步骤

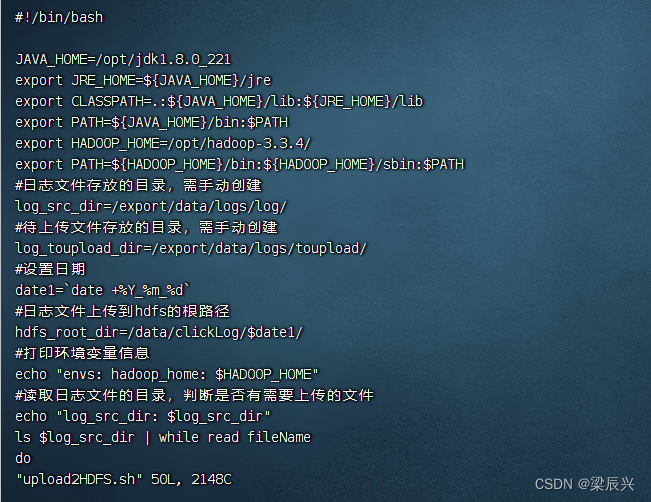

(1)配置环境变量

首先在/export/data/logs目录下(如果目录不存在,则需要提前创建)使用vim命令创建upload2HDFS.sh脚本文件,在编写Shell脚本时,需要设置Java环境变量和Hadoop环境变量,这样做是用来提高系统的可靠性,保障运行程序的机器在没有配置环境变量的情况下依然能够运行脚本。

(2)准备日志存放目录和待上传文件

为了让开发者便于控制上传文件的流程,可以在脚本中设置一个日志存放目录和待上传文件目录,若上传过程中发生错误只需要查看该目录就能知道文件的上传进度。

(3)设置日志文件上传的路径

设置上传的HDFS目标路径,命名格式以时间结尾,并且输出打印信息。

(4)实现文件上传

上传文件的过程就是遍历文件目录的过程,将文件首先移动到待上传目录,再从待上传目录中上传到HDFS中。若是在每天12点凌晨执行一次,我们可以使用Linux Crontab表达式执行定时任务。

二,编写脚本,实现功能

进入/export/data/logs目录,输入命令: cd /export/data/logs/

输入命令:vi upload2HDFS.sh

#!/bin/bash

JAVA_HOME=/opt/jdk1.8.0_221

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

export HADOOP_HOME=/opt/hadoop-3.3.4/

export PATH=${HADOOP_HOME}/bin:${HADOOP_HOME}/sbin:$PATH

#日志文件存放的目录,需手动创建

log_src_dir=/export/data/logs/log/

#待上传文件存放的目录,需手动创建

log_toupload_dir=/export/data/logs/toupload/

#设置日期

date1=`date +%Y_%m_%d`

#日志文件上传到hdfs的根路径

hdfs_root_dir=/data/clickLog/$date1/

#打印环境变量信息

echo "envs: hadoop_home: $HADOOP_HOME"

#读取日志文件的目录,判断是否有需要上传的文件

echo "log_src_dir: $log_src_dir"

ls $log_src_dir | while read fileName

do

if [[ "$fileName" == access.log.* ]]; then

date=`date +%Y_%m_%d_%H_%M_%S`

#将文件移动到待上传目录并重命名

echo "moving $log_src_dir$fileName to $log_toupload_dir"lzy_click_log_$fileName"$date"

mv $log_src_dir$fileName $log_toupload_dir"lzy_click_log_$fileName"$date

#将待上传的文件path写入一个列表文件willDoing,

echo $log_toupload_dir"lzy_click_log_$fileName"$date >> $log_toupload_dir"willDoing."$date

fi

done

#找到列表文件willDoing

ls $log_toupload_dir | grep will | grep -v "_COPY_" | grep -v "_DONE_" | while read line

do

#打印信息

echo "toupload is in file: $line"

#将待上传文件列表willDoing改名为willDoing_COPY_

mv $log_toupload_dir$line $log_toupload_dir$line"_COPY_"

#读列表文件willDoing_COPY_的内容(一个一个的待上传文件名)

#此处的line 就是列表中的一个待上传文件的path

cat $log_toupload_dir$line"_COPY_" | while read line

do

#打印信息

echo "puting...$line to hdfs path...$hdfs_root_dir"

hdfs dfs -mkdir -p $hdfs_root_dir

hdfs dfs -put $line $hdfs_root_dir

done

mv $log_toupload_dir$line"_COPY_" $log_toupload_dir$line"_DONE_"

done

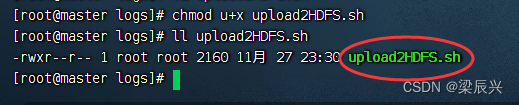

编辑权限,输入命令:chmod u+x upload2HDFS.sh

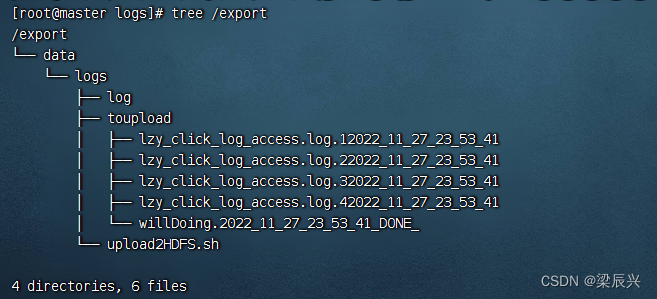

查看/export目录树结构,输入命令:tree /export

三,运行脚本,查看结果

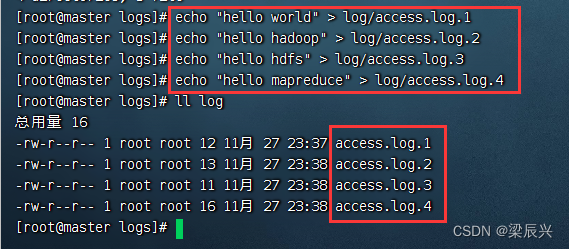

为了模拟生产环境,在日志存放目录/export/data/logs/log/中,手动创建日志文件,access.log表示正在源源不断的产生日志的文件,access.log.1、access.log.2等表示已经滚动完毕的日志文件,即为待上传日志文件。

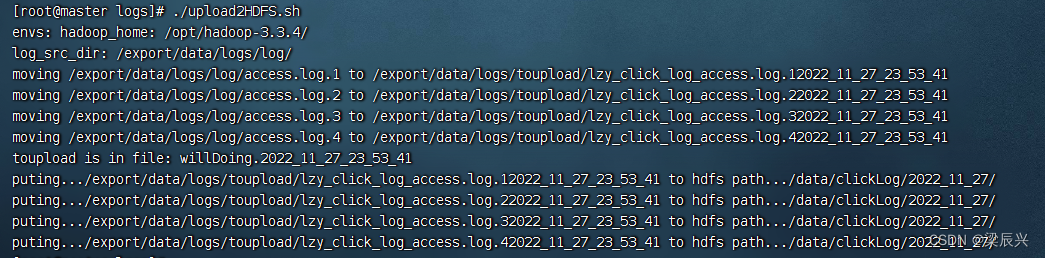

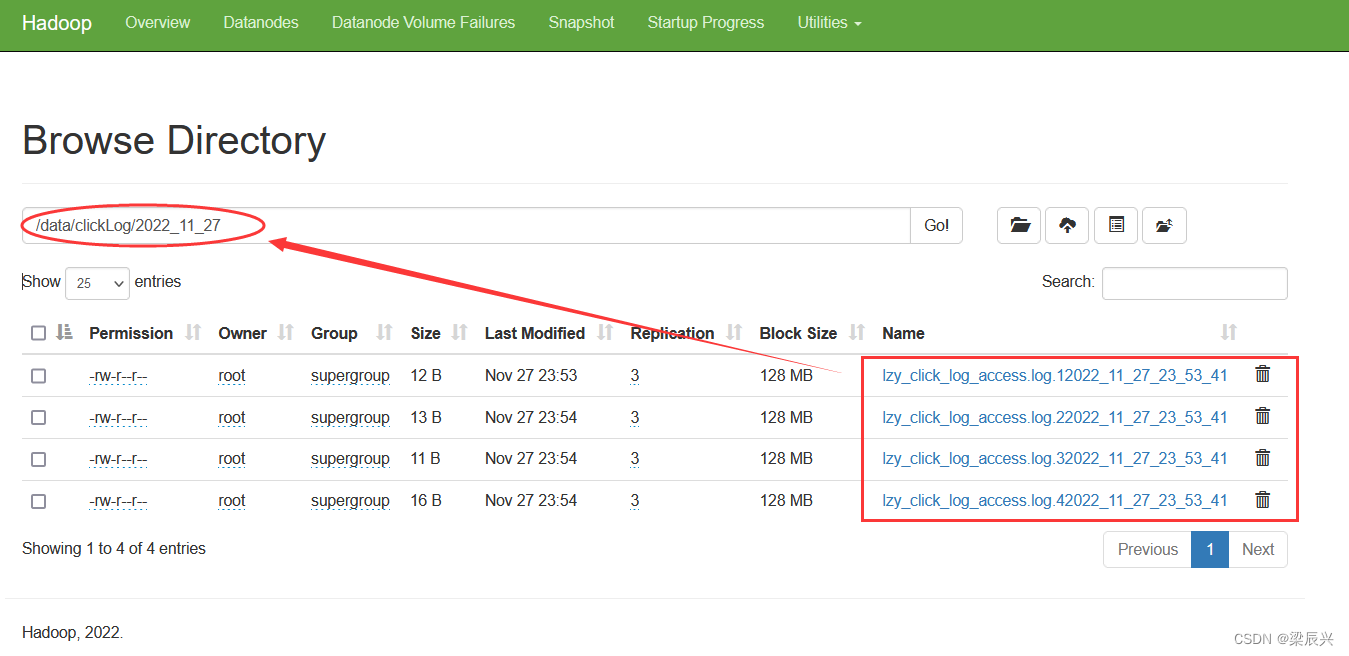

在upload2HDFS.sh文件路径下运行脚本,先将日志存放目录log中的日志文件移到待上传toupload目录下,并根据业务需求重命名;然后脚本执行“hdfs dfs -put”上传命令,将待上传目录下的所有日志文件上传至HDFS;最后通过HDFS WebUI界面可看到需要采集的日志文件已按照日期分类,上传至HDFS中。

创建四个日志文件(必须以access.log.打头),输入下面的命令:

echo "hello world" > log/access.log.1

echo "hello hadoop" > log/access.log.2

echo "hello hdfs" > log/access.log.3

echo "hello mapreduce" > log/access.log.4

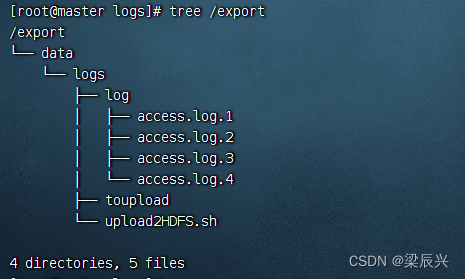

查看/export目录树结构,输入命令:tree /export

输入命令:./upload2HDFS.sh

查看/export目录树结构,输入命令:tree /export

打开HDFS集群WebUI查看上传的日志文件

695

695

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?