继2月底推出新一代快思考模型混元Turbo S后,3月21日深夜, 腾讯宣布推出自研深度思考模型混元T1正式版, 并同步在腾讯云官网上线。

3月初,腾讯发布了混元Turbo S,有网友问:

安排——

其实,腾讯在2月就已经通过腾讯元宝开放了T1-preview模型。腾讯推出自研深度思考模型混元T1正式版,并在腾讯混元和腾讯云官网开放体验,即将在腾讯元宝灰度上线。

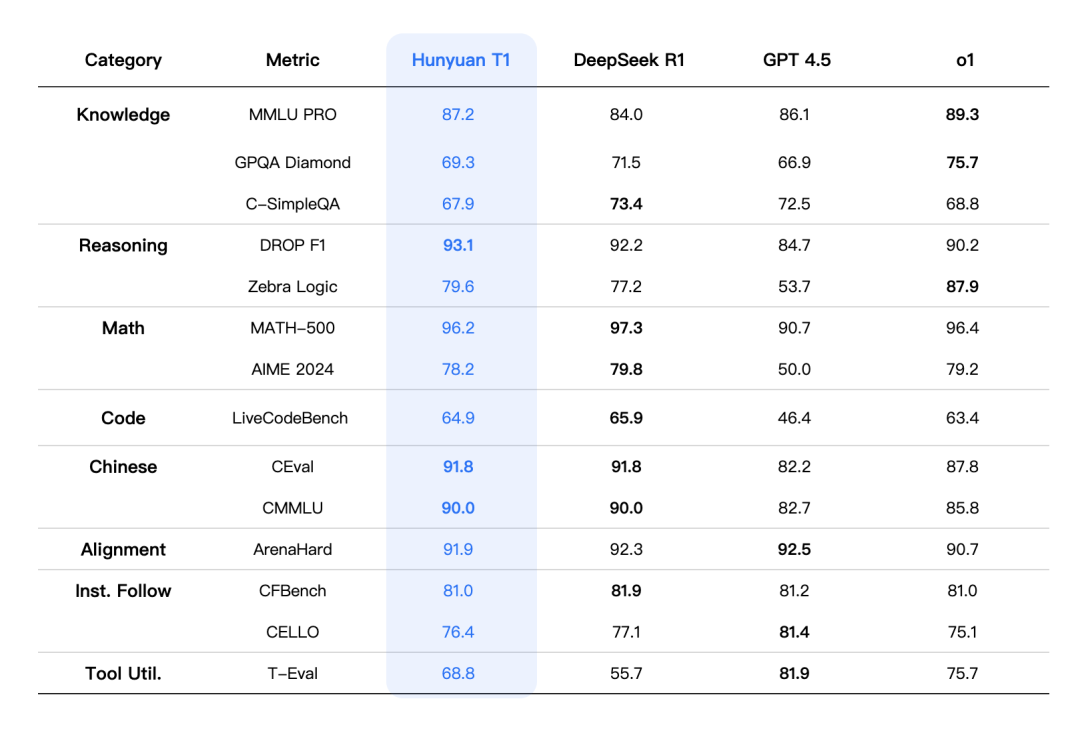

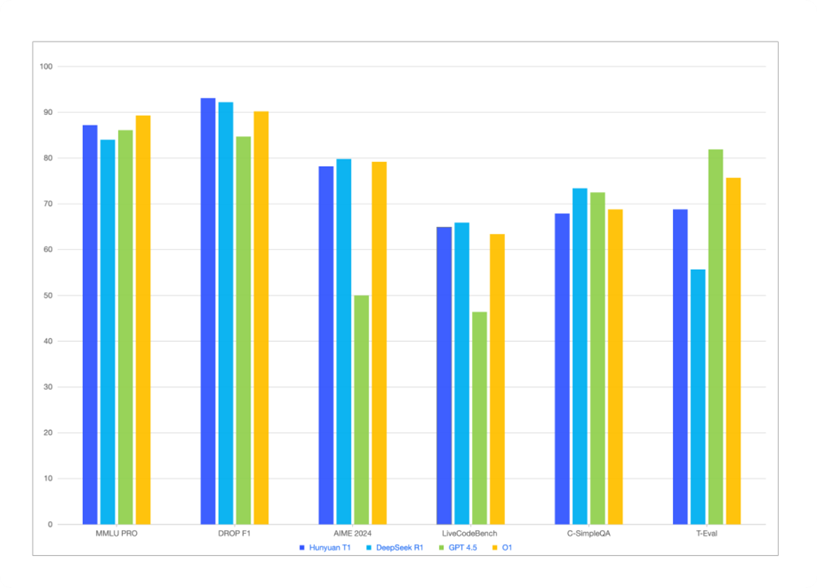

效果如何?先直接看测试表现:

在MMLU-pro、CEval、AIME、Zebra Logic等中英文知识及竞赛级数学、逻辑推理的公开基准测试中,混元T1正式版的成绩达到业界领先水平。

注:表格中,其它模型的评测指标来自官方评测结果,官方评测结果中没有的部分来自混元内部评测平台结果。

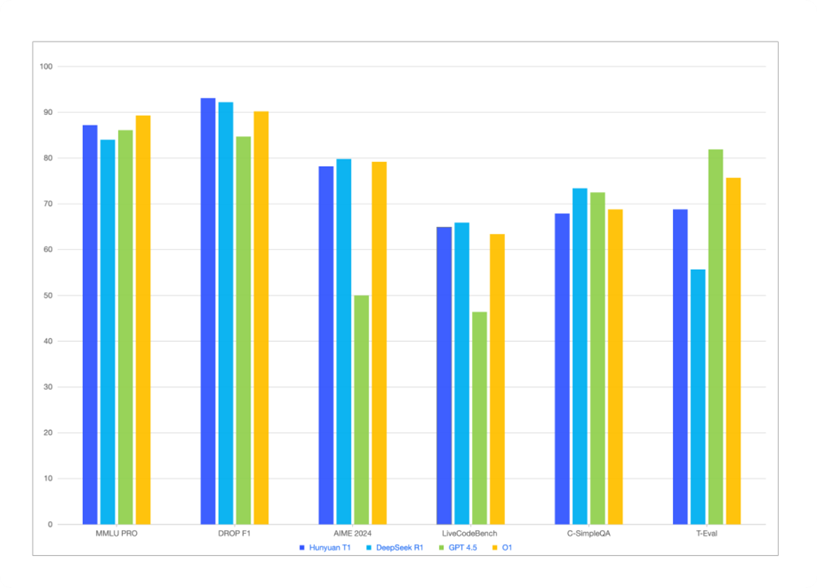

值得一提的是,腾讯混元T1正式版采用Hybrid-Mamba-Transformer融合架构,工业界首次将混合Mamba架构无损应用于超大型推理模型。该架构针对长序列处理专项优化,实现首字秒出、吐字速度最快80tokens/s,并有效解决长文推理中的上下文丢失问题。定价方面,混元T1输入价格低至每百万tokens1元,输出价格为4元,创行业新低。通过强化学习与数学、逻辑推理专项训练,混元T1在多项基准测试中达到业界领先水平,技术普惠与成本优势双轨并行。

![]()

腾讯发布自研混元T1正式版

腾讯混元T1正式版如期发布。

之所以称之为“如期发布”,是因为前不久腾讯混元自研的快思考模型混元Turbo S正式发布时,腾讯就曾表示,正式版的腾讯混元T1模型API也将很快上线,对外提供接入服务。

据知情人士介绍,腾讯混元T1正式版以混元Turbo S为基座打造,亮点在于其是能够秒回、吐字快、擅长超长文处理的强推理模型,性能保持业界领先。

“混元T1正式版沿用了混元Turbo S的创新架构,采用Hybrid-Mamba-Transformer融合模式。这是工业界首次将混合Mamba架构无损应用于超大型推理模型。”上述知情人士说,这一架构显著降低了训练和推理成本,让混元T1实现首字秒出,吐字速度达到最快80 tokens/s。

混元T1在超长文本推理领域也展现出独特优势,能够有效解决长文推理中常见的上下文丢失和长距离信息依赖问题。同时,混合Mamba架构针对长序列处理进行了专项优化,提升了解码速度。

通过大规模强化学习,并结合数学、逻辑推理、科学和代码等理科难题的专项优化,混元T1正式版进一步提升了推理能力。与此前已上线腾讯元宝的混元T1-preview模型相比,综合效果明显提升。

腾讯方面提供的数据显示,在体现推理模型基础能力的常见Benchmark上,以及在中英文知识及竞赛级数学、逻辑推理的公开基准测试中,混元T1的成绩也达到业界领先推理模型的水平。此外,T1还在多项对齐任务、指令跟随任务和工具利用任务中展现出了非常强的适应性。

值得一提的是,目前,混元T1已在腾讯云官网上线。定价方面,输入价格为每百万tokens 1元,输出价格为每百万tokens 4元。

![]()

腾讯混元大模型持续快速迭代

今年以来,腾讯混元大模型持续快速迭代,AI似乎已成为腾讯内部最大的驱动力。

其推出了深度思考模型T1 Preview和快思考模型Turbo S,并已广泛应用于腾讯元宝、ima、腾讯文档、微信读书、搜狗输入法、QQ浏览器等多款内部产品。腾讯混元积极拥抱开源,其开源模型全面覆盖文本、图像、视频和3D生成等多个模态。

业内认为,这一战略选择的背后,一方面基于腾讯长期以来坚持技术普惠的理念,另一方面也得益于腾讯在用户与产业多端的场景与生态优势,为AI技术的落地提供了广阔空间。

在日前公布的2024年财报中,腾讯年研发投入707亿元创下纪录。对于业务侧,AI技术对微信新芽业务的提振效应,推动了腾讯营销服务板块的快速增长。其2024年第四季度在AI领域的资本开支超390亿元,2025年将持续加码,AI战略已进入重投入期。

腾讯董事会主席兼首席执行官马化腾表示,“受益于AI赋能的广告平台升级、视频号用户参与度提升以及长青游戏的增长,我们2024年第4季取得双位数的收入增长,并持续提升运营效率。数月前,我们重组了AI团队以聚焦于快速的产品创新及深度的模型研发,增加了AI相关的资本开支,并加大了我们对原生AI产品的研发和营销力度。”他表示。

![]()

巨头竞逐AI

我国AIGC应用或已进入加速期

随着2025年我国进入科技突破大年,各大互联网巨头持续加大AI领域的投入。

近期,字节跳动豆包大模型团队官宣开源一项针对MoE(混合专家模型)架构的关键优化技术,可将大模型训练效率提升1.7倍,成本节省40%。

据悉,该技术叫COMET,已实际应用于字节的万卡集群训练,累计帮助节省了数百万 GPU 小时训练算力。

阿里巴巴近日宣布推出AI旗舰应用——新夸克,将“深度思考”能力融入AI搜索。据介绍,用户在“AI超级框”中输入指令后,夸克智能中枢可以自动识别意图,规划梳理后调动各种不同模型和智能体(Agent)模块,帮助用户完成任务。

百度日前连发两款免费新模型,分别是文心大模型4.5和文心大模型X1。据百度相关负责人介绍,文心大模型4.5在多模态理解能力方面显著提升。文心大模型X1为深度思考模型,在性能上对标DeepSeek-R1,具备“长思维链”,擅长中文知识问答、文学创作、逻辑推理等,而且大幅降低推理成本。

值得关注的是,国产大模型开源步伐持续加速。阿里巴巴在基础模型和原生应用方面持续发力,近期相继发布了Qwen2.5-VL、Qwen2.5-Max、通义万相2.1、千问QWQ-32B等性能领先的开源模型。百度方面则表示,将在6月30日正式将文心大模型开源,并在今年下半年发布文心大模型5.0。

业内分析认为,在技术创新与商业应用的双轮驱动下,AI有望在互联网等数字原生领域率先形成规模化落地。

华富人工智能ETF基金经理郜哲表示,结合腾讯财报和近期互联网巨头竞逐AI的情况来看,我国AIGC应用或已进入加速期。随着AI在各行业深入渗透,有望诞生更多AI创新模式与高质量产品,进一步推动人工智能产业链向更加现实、业绩可落地的方向发展。

(来源:中国基金报)

上新!腾讯混元推出深度思考模型T1正式版

3月初,腾讯发布了混元Turbo S,有网友问:

安排——

其实,腾讯在2月就已经通过腾讯元宝开放了T1-preview模型。今天,腾讯推出自研深度思考模型混元T1正式版,并在腾讯混元和腾讯云官网开放体验,即将在腾讯元宝灰度上线。

效果如何?先直接看测试表现:

在MMLU-pro、CEval、AIME、Zebra Logic等中英文知识及竞赛级数学、逻辑推理的公开基准测试中,混元T1正式版的成绩达到业界领先水平。

注:表格中,其它模型的评测指标来自官方评测结果,官方评测结果中没有的部分来自混元内部评测平台结果

混元T1正式版基于混元Turbo S打造,继承「秒回、吐字快」的优秀基因,还擅长处理超长文本。同时,相较于T1-preview版本的「初出江湖」,混元T1正式版的推理能力更上一层楼——

得益于大规模强化学习,以及数学、逻辑、科学、代码这些理科专项训练,混元T1正式版在解决复杂问题时,如同学霸一样头脑清晰、思维缜密。

目前,混元T1正式版已在腾讯「上岗」(腾讯混元和腾讯云官网皆可申请体验),云上API输入价格为1元/百万tokens ,输出价格为4元/百万tokens 。

//沿用Turbo S创新架构,计算成本大幅降低

以前的大模型,在处理长文本推理时,总是「算力吃紧」,计算复杂度高、内存占用大,导致训练和推理成本一路飙升。

混元T1正式版沿用了Turbo S的创新架构,全球首创将Hybrid-Mamba-Transformer融合模式无损应用到超大规模推理模型中,让大模型在处理复杂任务时不再气喘吁吁,而是又快又省,轻松跑完全程,从而让企业和开发者以更低的投入即可实现高效的AI部署。

//长文本信息捕捉,文风简洁、幻觉低

过去,AI在处理长文本时,总像个「马虎的学生」,前面交代过的任务,后面转头就忘了;甚至还经常自己「脑补」一些不存在的情节,产生令人头疼的「幻觉」。

腾讯混元T1正式版通过架构优化,专门强化了长文本捕捉和逻辑推理能力,就像换了个精明干练的助手,不仅记忆力强、逻辑严谨,还能用简洁的语言精准回应,不再东拉西扯、凭空想象。

现在,不论是写长篇论文、分析技术文档,还是处理复杂推理任务,混元T1正式版都能保持内容逻辑清晰、文字干净利落,同时幻觉率极低,真正做到说人话、办实事。

//长序列专项优化,解码速度提升2倍

过去,大模型的「深度思考」让很多用户又爱又恨,特别是长文本生成时,AI 可能「想半天」才输出,甚至在关键时刻卡顿,影响使用体验。

混元T1正式版针对长序列处理进行了专项优化,采用更高效的计算方式——简单来说,如同为AI配备一个「索引目录」,不用遍历文本信息,而是快速精准定位,更高效地提取记忆和上下文信息。

通过这样的方式,腾讯混元T1正式版在相近的激活参数量下,大幅降低了资源消耗,让解码速度直接提升2倍,实现了首字几乎秒出、吐字速度高达60-80 token/s。

目前,混元T1正式版已在腾讯云和腾讯混元官网上线,企业客户和开发者可通过:

-

腾讯混元T1需求登记表单登记申请API调用 ;

-

腾讯混元官网,直接上手体验;

从 Turbo S 到T1-Preview,再到T1 正式版,腾讯混元大模型正在快速进化,并已广泛应用于腾讯元宝、ima、腾讯文档、微信读书、搜狗输入法、QQ 浏览器等业务场景,让 AI 真正融入日常工作和创作。

现在,混元 T1正式版已经准备就绪,即刻体验试用吧!

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?