🚩 前言

🚩 活动地址:CSDN21天学习挑战赛

🚀 博主主页:清风莫追

保持输入,保持输出!(引用我某朋友的一句话)

1. 问题描述

在模型训练过程中突然发现,模型的准确率在测试集上居然比在训练集上还要高。但是我们知道,我们训练模型的方式就是在训练集上最小化损失。因此,模型在训练集上有着更好的表现,才应该是正常的现象。

那么,是什么导致了在测试集上准确率更高的现象呢?

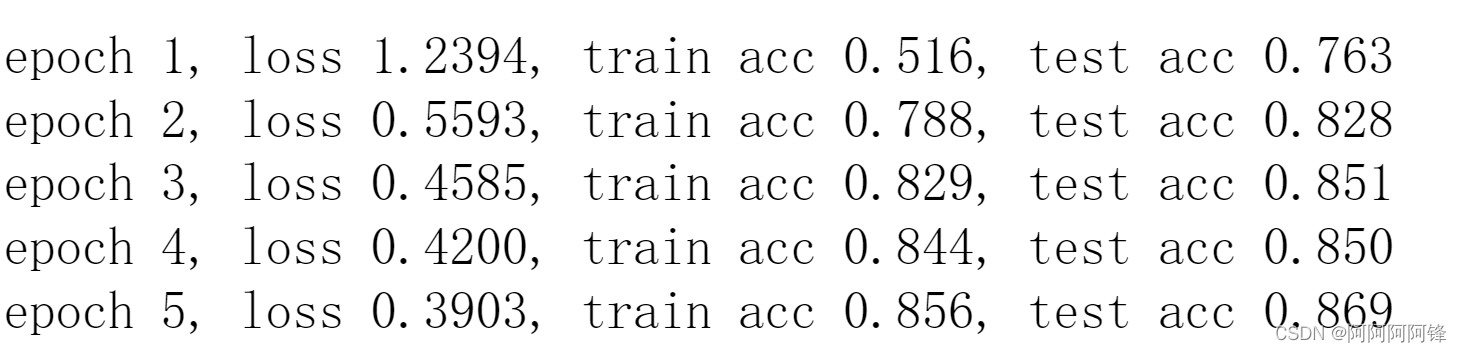

模型训练结果:

2. 解决问题

2. 1. 欠拟合

后来我咨询了某大佬,她说:“多训练几次看看,前几次一直在欠拟合”,我顿时感觉,好建议!

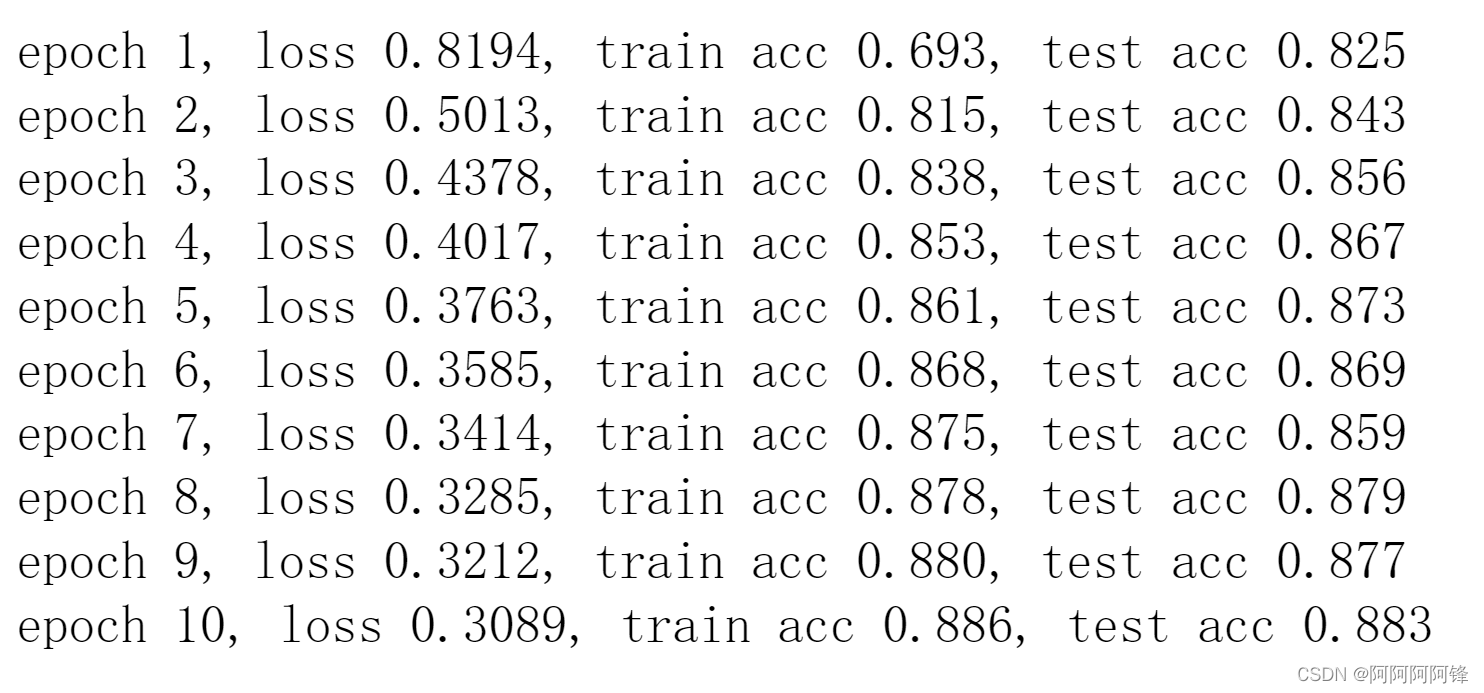

增加训练周期数:

果然!随着训练周期的增加,模型准确率慢慢地回归了正轨。在训练集上的准确率又超过了测试集上的。

2. 2. 小批量统计的滞后性

但我依然有所疑惑,为什么在训练周期较少的欠拟合状态下,会出现模型在测试集上准确率更高的情况呢?它们之间有什么关系?

有一篇博文给出的部分解释,我觉得很合理,比较符合我遇到的情况:

训练集的准确率是每个batch之后产生的,而验证集的准确率一般是一个epoch后产生的,验证时的模型是训练一个个batch之后的,有一个滞后性,可以说就是用训练得差不多的模型用来验证,当然准确率要高一点。

也就是说,问题的出现和个人具体统计训练集准确率的方式有关。如果是在每个训练周期结束后再统计训练集上的模型准确率,而不是在每个小批量结束就统计,那就不会出现这样的问题。

当然,光说是不行的,得实践。我检查了之前的模型代码,发现我训练集上的准确率确实是每个小批量结束后就统计的。那不妨试试训练集的准确率也在每个周期结束后再进行统计。

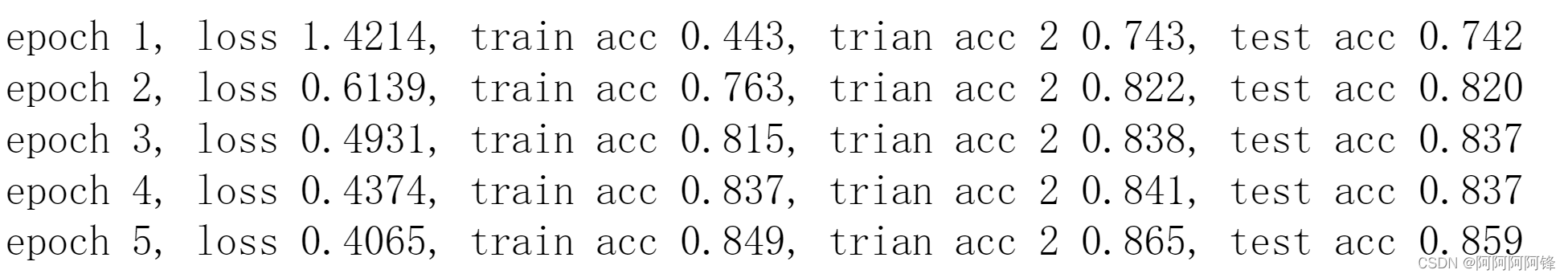

每个训练周期后再统计训练集上的准确率( train acc 2):

容易发现,即使在欠拟合的状态下,如果训练集和测试集准确率的统计方式相同,模型还是会在训练集上的准确率更高。

参考文献:

神经网络与深度学习—验证集(测试集)准确率高于训练集准确率的原因

小结

遇到问题,看一看别人的想法,可能会让自己瞬间茅塞顿开。一个人钻牛角尖不可取。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?