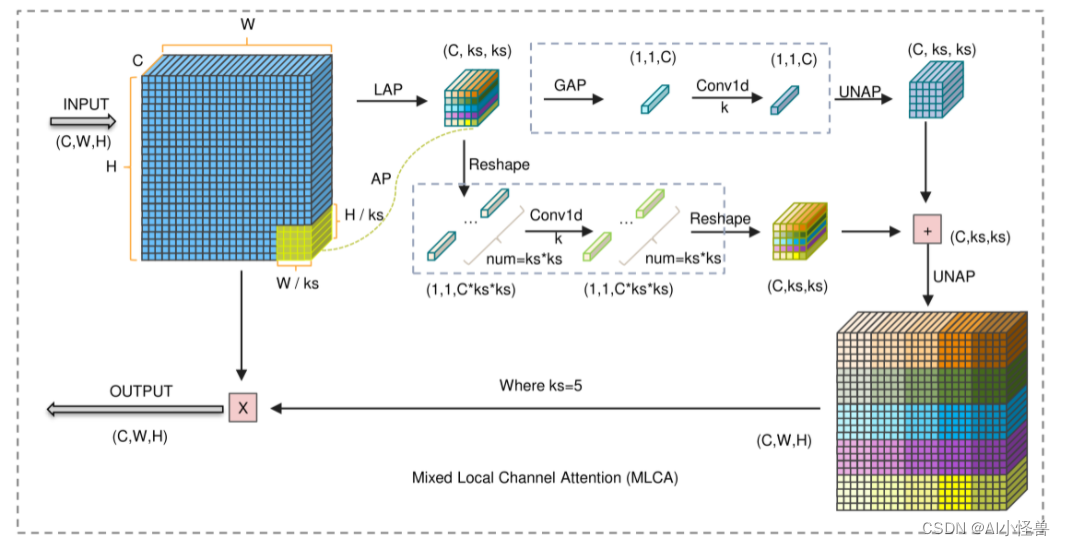

💡💡💡本文属于原创独家改进:一种轻量级的 Mixed Local Channel Attention (MLCA) 模块,该模块考虑通道信息和空间信息,并结合局部信息和全局信息以提高网络的表达效果

💡💡💡在 Pascal VOC 和 SMID 数据集上,MLCA 相对于其他注意力技术更好地平衡了模型表示效果、性能和复杂度。与 PASCAL VOC 数据集上的 Squeeze-and-Excitation(SE) 注意力机制和 SIMD 数据集上的 Coordinate Attention(CA) 方法相比,mAP 分别提高了 1.0% 和 1.5%。

💡💡💡如何使用:1)作为注意力直接使用;

推荐指数:五星

《YOLOv9魔术师专栏》将从以下各个方向进行创新:

【原创自研模块】【多组合点优化】【注意力机制】【卷积魔改】【block&多尺度融合结合】【损失&IOU优化】【上下采样

订阅专栏 解锁全文

订阅专栏 解锁全文

435

435

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?