1.什么是机器翻译?

机器翻译(Machine Translation, MT)是利用计算机技术自动将一种自然语言的文本或语言转换为另一种自然语言的过程。其目标是实现在不需要人类干预的情况下,将一段文本从一种语言翻译成另一种语言,并尽可能保留原文的意思和信息。

主要特点和方法:

自动化翻译:机器翻译系统不需要人类直接进行翻译,而是依赖计算机程序和算法进行处理和决策。

语言间转换:机器翻译系统通常涉及两种或多种自然语言之间的转换,例如从英语到法语、从中文到西班牙语等。

翻译模型:机器翻译系统基于不同的模型和方法,如基于规则的方法、统计机器翻译(Statistical Machine Translation, SMT)和最近的神经机器翻译(Neural Machine Translation, NMT)

2.实验目的:

使用机器翻译为例来介绍编码器—解码器和注意力机制的应用

3.实验数据预处理

定义特殊符号:“<pad>”(padding)符号用来添加在较短序列后,直到每个序列等长,“<bos>”和“<eos>”符号分别表示序列的开始和结束。

!tar -xf d2lzh_pytorch.tarimport collections

import os

import io

import math

import torch

from torch import nn

import torch.nn.functional as F

import torchtext.vocab as Vocab

import torch.utils.data as Data

import sys

# sys.path.append("..")

import d2lzh_pytorch as d2l

PAD, BOS, EOS = '<pad>', '<bos>', '<eos>'

os.environ["CUDA_VISIBLE_DEVICES"] = "0"

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

print(torch.__version__, device)定义两个辅助函数,对后面读取的数据进行预处理

# 将一个序列中所有的词记录在all_tokens中以便之后构造词典,然后在该序列后面添加PAD直到序列

# 长度变为max_seq_len,然后将序列保存在all_seqs中

def process_one_seq(seq_tokens, all_tokens, all_seqs, max_seq_len):

# 将当前序列的词加入到总词列表中

all_tokens.extend(seq_tokens)

# 在当前序列末尾添加结束符EOS,并用PAD填充至最大序列长度

seq_tokens += [EOS] + [PAD] * (max_seq_len - len(seq_tokens) - 1)

# 将处理后的序列添加到总序列列表中

all_seqs.append(seq_tokens)

# 使用所有的词来构造词典。并将所有序列中的词变换为词索引后构造Tensor

def build_data(all_tokens, all_seqs):

vocab = Vocab.Vocab(collections.Counter(all_tokens),

specials=[PAD, BOS, EOS])

indices = [[vocab.stoi[w] for w in seq] for seq in all_seqs]

return vocab, torch.tensor(indices)这里使用一个很小的法语—英语数据集。在这个数据集里,每一行是一对法语句子和它对应的英语句子,中间使用'\t'隔开。在读取数据时,我们在句末附上“<eos>”符号,并可能通过添加“<pad>”符号使每个序列的长度均为max_seq_len。我们为法语词和英语词分别创建词典。法语词的索引和英语词的索引相互独立。

def read_data(max_seq_len):

# in和out分别是input和output的缩写

in_tokens, out_tokens, in_seqs, out_seqs = [], [], [], []

with io.open('fr-en-small.txt') as f:

lines = f.readlines()

for line in lines:

# 拆分输入和输出序列

in_seq, out_seq = line.rstrip().split('\t')

# 将输入和输出序列分割为词汇列表

in_seq_tokens, out_seq_tokens = in_seq.split(' '), out_seq.split(' ')

if max(len(in_seq_tokens), len(out_seq_tokens)) > max_seq_len - 1:

continue # 如果加上EOS后长于max_seq_len,则忽略掉此样本

# 处理输入序列,并记录词汇和处理后的序列

process_one_seq(in_seq_tokens, in_tokens, in_seqs, max_seq_len)

# 处理输出序列,并记录词汇和处理后的序列

process_one_seq(out_seq_tokens, out_tokens, out_seqs, max_seq_len)

# 使用所有的输入词汇构建输入词典和序列Tensor数据

in_vocab, in_data = build_data(in_tokens, in_seqs)

# 使用所有的输出词汇构建输出词典和序列Tensor数据

out_vocab, out_data = build_data(out_tokens, out_seqs)

# 返回输入词典、输出词典和Tensor数据集

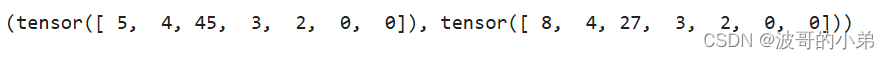

return in_vocab, out_vocab, Data.TensorDataset(in_data, out_data)将序列的最大长度设成7,然后查看读取到的第一个样本。该样本分别包含法语词索引序列和英语词索引序列

max_seq_len = 7

in_vocab, out_vocab, dataset = read_data(max_seq_len)

dataset[0]实验结果:

5. 注意力机制

4.1 什么是注意力机制?

4.1.1定义:

注意力机制(Attention Mechanism)是一种在神经网络中用来增强模型对输入数据中相关部分的关注度的技术;

4.1.2主要特点和工作原理:

注意力机制允许模型在处理每个输入时动态地分配不同的注意力权重,以便将更多的注意力集中在与当前任务相关的输入部分上;

4.2代码实现

定义的函数𝑎𝑎:将输入连结后通过含单隐藏层的多层感知机变换

def attention_model(input_size, attention_size):

model = nn.Sequential(nn.Linear(input_size, attention_size, bias=False),

nn.Tanh(),

nn.Linear(attention_size, 1, bias=False))

return model注意力机制返回当前时间步的背景变量,形状为(批量大小, 隐藏单元个数)

def attention_forward(model, enc_states, dec_state):

"""

enc_states: (时间步数, 批量大小, 隐藏单元个数)

dec_state: (批量大小, 隐藏单元个数)

"""

# 将解码器隐藏状态广播到和编码器隐藏状态形状相同后进行连结

dec_states = dec_state.unsqueeze(dim=0).expand_as(enc_states)

enc_and_dec_states = torch.cat((enc_states, dec_states), dim=2)

e = model(enc_and_dec_states) # 形状为(时间步数, 批量大小, 1)

alpha = F.softmax(e, dim=0) # 在时间步维度做softmax运算

return (alpha * enc_states).sum(dim=0) # 返回背景变量4.3 示例

下面的例子中,编码器的时间步数为10,批量大小为4,编码器和解码器的隐藏单元个数均为8。注意力机制返回一个小批量的背景向量,每个背景向量的长度等于编码器的隐藏单元个数

seq_len, batch_size, num_hiddens = 10, 4, 8

model = attention_model(2*num_hiddens, 10)

enc_states = torch.zeros((seq_len, batch_size, num_hiddens))

dec_state = torch.zeros((batch_size, num_hiddens))

attention_forward(model, enc_states, dec_state).shape输出结果:

![]()

5.注意力机制的编码器

将输入语言的词索引通过词嵌入层得到词的表征,然后输入到一个多层门控循环单元中

class Encoder(nn.Module):

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers,

drop_prob=0, **kwargs):

super(Encoder, self).__init__(**kwargs)

# 初始化词嵌入层和GRU层

self.embedding = nn.Embedding(vocab_size, embed_size)

self.rnn = nn.GRU(embed_size, num_hiddens, num_layers, dropout=drop_prob)

def forward(self, inputs, state):

# 输入形状是(批量大小, 时间步数)。将输出互换样本维和时间步维

embedding = self.embedding(inputs.long()).permute(1, 0, 2) # (seq_len, batch, input_size)

# 将转置后的嵌入序列传入GRU层,并返回GRU的输出和新的状态

return self.rnn(embedding, state)

def begin_state(self):

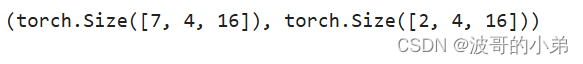

return None建一个批量大小为4、时间步数为7的小批量序列输入。设门控循环单元的隐藏层个数为2,隐藏单元个数为16

encoder = Encoder(vocab_size=10, embed_size=8, num_hiddens=16, num_layers=2)

output, state = encoder(torch.zeros((4, 7)), encoder.begin_state())

output.shape, state.shape # GRU的state是h, 而LSTM的是一个元组(h, c)实验结果:

6.含注意力机制的解码器

我们直接将编码器在最终时间步的隐藏状态作为解码器的初始隐藏状态,由于解码器的输入来自输出语言的词索引,我们将输入通过词嵌入层得到表征,然后和背景向量在特征维连结。

class Decoder(nn.Module):

def __init__(self, vocab_size, embed_size, num_hiddens, num_layers,

attention_size, drop_prob=0):

super(Decoder, self).__init__()

self.embedding = nn.Embedding(vocab_size, embed_size)

self.attention = attention_model(2*num_hiddens, attention_size)

# GRU的输入包含attention输出的c和实际输入, 所以尺寸是 num_hiddens+embed_size

self.rnn = nn.GRU(num_hiddens + embed_size, num_hiddens,

num_layers, dropout=drop_prob)

self.out = nn.Linear(num_hiddens, vocab_size)

def forward(self, cur_input, state, enc_states):

"""

cur_input shape: (batch, )

state shape: (num_layers, batch, num_hiddens)

"""

# 使用注意力机制计算背景向量

c = attention_forward(self.attention, enc_states, state[-1])

# 将嵌入后的输入和背景向量在特征维连结, (批量大小, num_hiddens+embed_size)

input_and_c = torch.cat((self.embedding(cur_input), c), dim=1)

# 为输入和背景向量的连结增加时间步维,时间步个数为1

output, state = self.rnn(input_and_c.unsqueeze(0), state)

# 移除时间步维,输出形状为(批量大小, 输出词典大小)

output = self.out(output).squeeze(dim=0)

return output, state

def begin_state(self, enc_state):

# 直接将编码器最终时间步的隐藏状态作为解码器的初始隐藏状态

return enc_state将连结后的结果与上一时间步的隐藏状态通过门控循环单元计算出当前时间步的输出与隐藏状态,将输出通过全连接层变换为有关各个输出词的预测,形状为(批量大小, 输出词典大小)。

554

554

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?