1.准备Linux环境

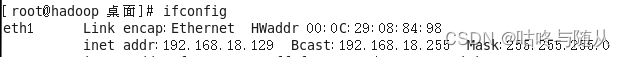

1.1 开启网络,ifconfig指令查看ip

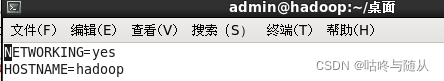

1.2 修改主机名为自己名字(hadoop)

vim /etc/sysconfig/network

NETWORKING=yes

HOSTNAME=hadoop

1.3修改主机名和IP的映射关系

vim /etc/hosts

192.168.182.128 hadoop

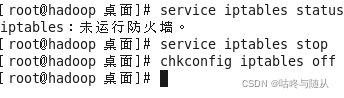

1.4关闭防火墙

#查看防火墙状态

service iptables status

#关闭防火墙

service iptables stop

#关闭防火墙开机启动

chkconfig iptables off

1.5重启Linux

reboot

安装自己的JDK前,删除openJDK:

查看java安装版本:java -version

查看java安装包:rpm -qa|grep java

删除java安装包:rpm -e --nodeps 包名

2.安装JDK

2.1 filezilla上传jdk到/opt

2.2 解压jdk

cd /opt

tar -zxvf jdk-7u76-linux-x64.tar.gz

2.3 将java添加到环境变量中

vim /etc/profile

#在文件最后添加

export JAVA_HOME=/opt/jdk1.7.0_76

export PATH=

P

A

T

H

:

PATH:

PATH:JAVA_HOME/bin

#刷新配置

source /etc/profile

#查看java的版本

java -version

3.安装Hadoop

3.1 filezilla上传hadoop安装包,配置文档(hadoop2.2.0伪分布式搭建.txt)

3.2解压hadoop安装包

#解压

tar -zxvf hadoop-2.2.0.tar.gz

3.3修改配置文件(5个) 路径:/opt/hadoop-2.2.0/etc/hadoop

第一个:hadoop-env.sh

#在27行修改

export JAVA_HOME=/opt/jdk1.7.0_76

第二个:core-site.xml

第三个:hdfs-site.xml

第四个:mapred-site.xml.template 需要重命名: mv mapred-site.xml.template mapred-site.xml

ation>

第五个:yarn-site.xml

3.4将hadoop添加到环境变量

vim /etc/profile

export JAVA_HOME=/opt/jdk1.7.0_55

export HADOOP_HOME=/opt/hadoop-2.2.0

export PATH=

P

A

T

H

:

PATH:

PATH:JAVA_HOME/bin:

H

A

D

O

O

P

_

H

O

M

E

/

b

i

n

:

HADOOP\_HOME/bin:

HADOOP_HOME/bin:HADOOP_HOME/sbin

source /etc/profile

3.5格式化HDFS(namenode)第一次使用时要格式化

hadoop namenode -format

3.6启动hadoop

先启动HDFS

start-dfs.sh

再启动YARN

start-yarn.sh

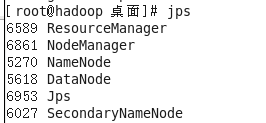

3.7验证是否启动成功

使用jps命令验证

27408 NameNode

28218 Jps

27643 SecondaryNameNode

28066 NodeManager

27803 ResourceManager

27512 DataNode

http://localhost:50070 (HDFS管理界面)

http://localhost:8088 (MR管理界面)

1009

1009

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?