一:Apriori算法思想

首先找出所有的频集,这些项集出现的频繁性至少和预定义的最小支持度一样。

然后由频集产生强关联规则,这些规则必须满足最小支持度和最小可信度。

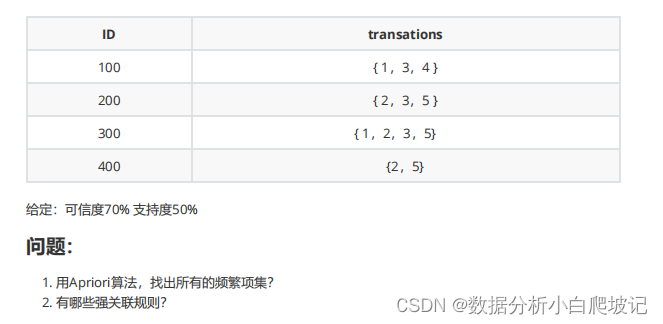

二:"上"例题

三:求所有频繁项集(核心是支持度=50%)

1,求(频繁)标准

=支持度*项数=4*0.5=2

所以现在知道出现次数为2的就是频繁项集

2,依次求项数为1,2,3的出现次数(>2即可)

3,现在求项数为1的出现次数

4,现在求项数为2的出现次数(基于3)

注意:{1,3}出现两次不一定就是按顺序的{1,3},谁在前谁在后符合即可

{1,2,3}也表示{1,3}出现一次

5,现在求项数为3的出现次数(基于4)

这样频繁项集就求完啦

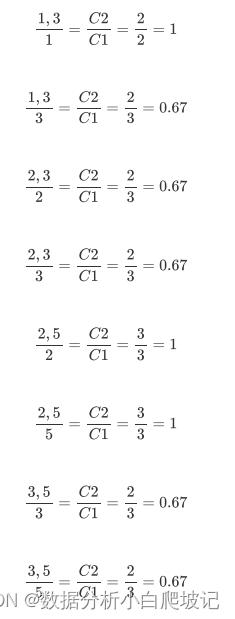

四,求强关联规则(核心是可信度是70%)

简单理解:就是求前面项数分别为1,2,3的频繁项集之间的关联要>70%

3项数 / 2项数:

注意:1,需要返回前面查看出现次数哦

2,比的时候需要是相关联的,像{2,3,5}不包含{1,3},就不用计算

2项数 / 1项数:

注意:比的时候也是需要相关联的,{1,3}包含1也包含3,所以才有下面前两个

现在上面大于0.7的就是满足条件的强关联啦

还想看更多,来啦!!!

本文详细介绍了Apriori算法的工作原理,包括如何找到所有满足最小支持度的频集,以及如何生成满足最小可信度的强关联规则。通过实例说明了求解频繁项集和强关联规则的具体步骤。

本文详细介绍了Apriori算法的工作原理,包括如何找到所有满足最小支持度的频集,以及如何生成满足最小可信度的强关联规则。通过实例说明了求解频繁项集和强关联规则的具体步骤。

2750

2750

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?