这里我想以自己作为scala,IDEA完全0基础的视角,一步步带领你们一起,围绕如何探索一个综合应用这个问题,绝对保姆级,通俗易懂可执行。

一:前期准备:

1:IDEA创建Maven项目

2:Maven项目可以正常打jar包,虚拟机上spark-submit可以正常运行jar包

3:确保IDEA创建的Maven工程可以正常连接HIVE,也能进行基本操作

二:题目+理解

理解:

1:连接到hive得ods库

2:对ods库里面得表进行数据清洗,抽取到hive得dwd库中

三:代码实现

--还很贴心的每一步的实现都写了一个输出语句,看输出就知道自己卡在了哪里

清洗1代码如下:

import org.apache.spark.SparkConf // 导入SparkConf类

import org.apache.spark.sql.{SparkSession, functions} // 导入SparkSession和functions类

import org.apache.spark.sql.functions._ // 导入Spark SQL函数库

import org.apache.spark.sql.expressions.Window // 导入Window类用于分组排序

object extract01 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local").setAppName("extract01")

conf.set("spark.sql.hive.thriftServer.async", "true") // 设置异步模式为true

conf.set("hive.exec.dynamic.partition.mode", "nonstrict") // 设置动态分区模式为nonstrict

val spark = SparkSession.builder().config(conf).enableHiveSupport().getOrCreate()

println("Hive Databases: ")

spark.sql("show databases").show(false)

// 获取最新的ods.user_info表数据

val ods = spark.table("ods.user_info").filter("etl_date = (select max(etl_date) from ods.user_info)")

println("最新的ods.user_info表数据如下:")

ods.show(50,truncate = false) // 打印输出ods数据

ods.createOrReplaceTempView("tmp") // 创建临时视图tmp

// 获取最新的dwd.dim_user_info表数据,并只保留id在ods中存在的记录

val dwd = spark.table("dwd.dim_user_info").filter("etl_date = (select max(etl_date) from dwd.dim_user_info) and id in (select id from tmp)")

println("最新的dwd.dim_user_info表数据如下:")

dwd.show(50) // 打印输出dwd数据

dwd.createOrReplaceTempView("dwd") // 创建临时视图dwd

// 添加dwd_insert_user、dwd_insert_time、dwd_modify_user、dwd_modify_time四个列,用于标记数据修改信息

val ods1 = ods

.withColumn("operate_time", when(col("operate_time").isNull, col("create_time")).otherwise(col("operate_time")))

.withColumn("dwd_insert_user", lit("user1"))

.withColumn("dwd_insert_time", current_timestamp())

.withColumn("dwd_modify_user", lit("user1"))

.withColumn("dwd_modify_time", current_timestamp())

// 将ods1和dwd中的数据合并,并根据create_time字段进行分组排序,选择每组中的第一条记录

val value = dwd.unionByName(ods1)

.withColumn("rn", row_number().over(Window.partitionBy(col("id")).orderBy(col("operate_time").desc)))

.filter("rn=1")

.drop("rn")

println("两最新表合并后的value如下:")

value.show(50) // 打印输出合并后的数据

// 使用左连接将合并后的数据和dwd中的数据进行匹配,将dwd中的dwd_modify_time字段赋值给合并后数据的dwd_modify_time字段

// 如果dwd中没有对应的记录,则dwd_modify_time字段取当前时间

val frame = value.join(dwd.selectExpr("id", "dwd_modify_time as time"), Seq("id"), "outer")

.withColumn("dwd_modify_time", when(col("time").isNotNull, date_format(current_timestamp(), "yyyy-MM-dd HH:mm:ss")).otherwise(col("dwd_modify_time")))

.drop("time")

.withColumn("create_time", to_timestamp(col("create_time"), "yyyy-MM-dd HH:mm:ss")) // 将字符串类型的 create_time 转换为时间戳类型

frame.show(50) // 打印输出转换后的数据

frame.createOrReplaceTempView("temp_table")

spark.sql("INSERT OVERWRITE TABLE dwd.dim_user_info PARTITION (etl_date) SELECT * FROM temp_table")

// 打印输出写入成功信息

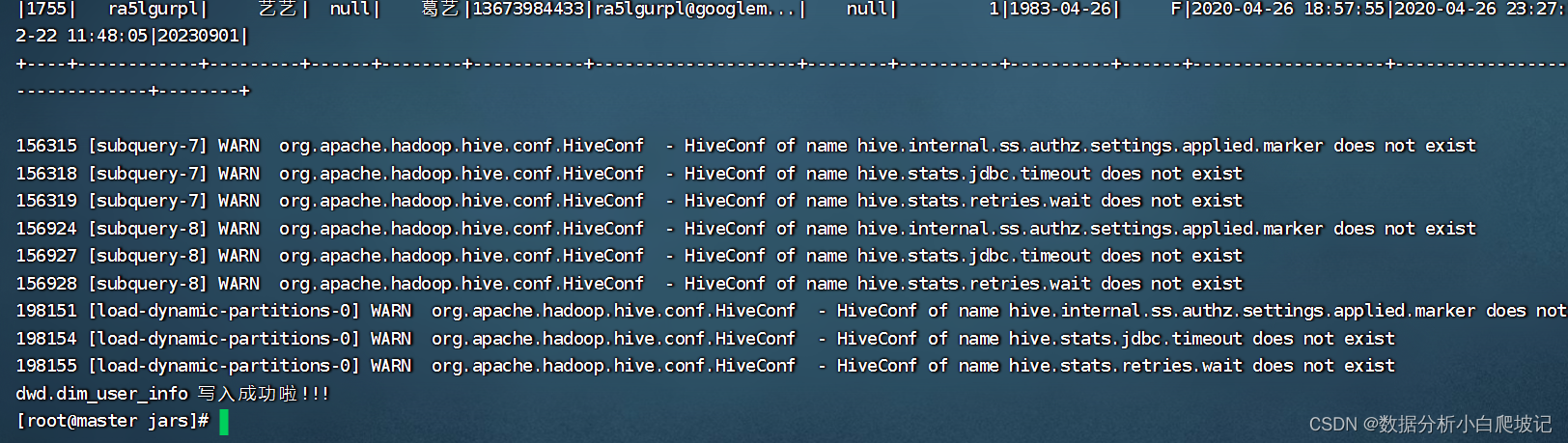

println("dwd.dim_user_info 写入成功啦!!!")

}

}清洗2代码如下:

import org.apache.spark.SparkConf // 导入SparkConf类

import org.apache.spark.sql.{SparkSession, functions} // 导入SparkSession和functions类

import org.apache.spark.sql.functions._ // 导入Spark SQL函数库

import org.apache.spark.sql.expressions.Window // 导入Window类用于分组排序

object extract02 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local").setAppName("extract02")

conf.set("spark.sql.hive.thriftServer.async", "true") // 设置异步模式为true

conf.set("hive.exec.dynamic.partition.mode", "nonstrict") // 设置动态分区模式为nonstrict

val spark = SparkSession.builder().config(conf).enableHiveSupport().getOrCreate()

println("Hive Databases: ")

spark.sql("show databases").show(50,false)

// 获取最新的ods.sku_info表数据

val ods = spark.table("ods.sku_info").filter("etl_date = (select max(etl_date) from ods.sku_info)")

println("最新的ods.sku_info表数据如下:")

ods.show(50,truncate = false) // 打印输出ods数据

ods.createOrReplaceTempView("tmp") // 创建临时视图tmp

// 获取最新的dwd.dim_sku_info表数据,并只保留id在ods中存在的记录

val dwd = spark.table("dwd.dim_sku_info").filter("etl_date = (select max(etl_date) from dwd.dim_sku_info) and id in (select id from tmp)")

println("最新的dwd.dim_sku_info表数据如下:")

dwd.show(50,false) // 打印输出dwd数据

dwd.createOrReplaceTempView("dwd") // 创建临时视图dwd

// 添加dwd_insert_user、dwd_insert_time、dwd_modify_user、dwd_modify_time四个列,用于标记数据修改信息

val ods1 = ods

.withColumn("dwd_insert_user", lit("user1"))

.withColumn("dwd_insert_time", current_timestamp())

.withColumn("dwd_modify_user", lit("user1"))

.withColumn("dwd_modify_time", current_timestamp())

// 将ods1和dwd中的数据合并,并根据create_time字段进行分组排序,选择每组中的第一条记录

val value = dwd.unionByName(ods1)

.withColumn("rn", row_number().over(Window.partitionBy(col("id")).orderBy(col("create_time").desc)))

.filter("rn=1")

.drop("rn")

println("两最新表合并后的value如下:")

value.show(50,false) // 打印输出合并后的数据

// 使用左连接将合并后的数据和dwd中的数据进行匹配,将dwd中的dwd_modify_time字段赋值给合并后数据的dwd_modify_time字段

// 如果dwd中没有对应的记录,则dwd_modify_time字段取当前时间

val frame = value.join(dwd.selectExpr("id", "dwd_modify_time as time"), Seq("id"), "outer")

.withColumn("dwd_modify_time", when(col("time").isNotNull, date_format(current_timestamp(), "yyyy-MM-dd HH:mm:ss")).otherwise(col("dwd_modify_time")))

.drop("time")

.withColumn("create_time", to_timestamp(col("create_time"), "yyyy-MM-dd HH:mm:ss")) // 将字符串类型的 create_time 转换为时间戳类型

frame.show(50,false) // 打印输出转换后的数据

frame.createOrReplaceTempView("temp_table")

spark.sql("INSERT OVERWRITE TABLE dwd.dim_sku_info PARTITION (etl_date) SELECT * FROM temp_table")

// 打印输出写入成功信息

println("dwd.dim_sku_info 写入成功啦!!!")

}

}

清洗3代码如下:

import org.apache.spark.SparkConf // 导入SparkConf类

import org.apache.spark.sql.{SparkSession, functions} // 导入SparkSession和functions类

import org.apache.spark.sql.functions._ // 导入Spark SQL函数库

import org.apache.spark.sql.expressions.Window // 导入Window类用于分组排序

object extract03 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local").setAppName("extract03")

conf.set("spark.sql.hive.thriftServer.async", "true") // 设置异步模式为true

conf.set("hive.exec.dynamic.partition.mode", "nonstrict") // 设置动态分区模式为nonstrict

val spark = SparkSession.builder().config(conf).enableHiveSupport().getOrCreate()

println("Hive Databases: ")

spark.sql("show databases").show(false)

// 获取最新的ods.base_province表数据

val ods = spark.table("ods.base_province").filter("etl_date = (select max(etl_date) from ods.base_province)")

println("最新的ods.base_province表数据如下:")

ods.show(50,truncate = false) // 打印输出ods数据

ods.createOrReplaceTempView("tmp") // 创建临时视图tmp

// 获取最新的dwd.dim_province表数据,并只保留id在ods中存在的记录

val dwd = spark.table("dwd.dim_province").filter("etl_date = (select max(etl_date) from dwd.dim_province) and id in (select id from tmp)")

println("最新的dwd.dim_province表数据如下:")

dwd.show(50,false) // 打印输出dwd数据

dwd.createOrReplaceTempView("dwd") // 创建临时视图dwd

// 添加dwd_insert_user、dwd_insert_time、dwd_modify_user、dwd_modify_time四个列,用于标记数据修改信息

val ods1 = ods

.withColumn("dwd_insert_user", lit("user1"))

.withColumn("dwd_insert_time", current_timestamp())

.withColumn("dwd_modify_user", lit("user1"))

.withColumn("dwd_modify_time", current_timestamp())

// 将ods1和dwd中的数据合并,并根据create_time字段进行分组排序,选择每组中的第一条记录

val value = dwd.unionByName(ods1)

.withColumn("rn", row_number().over(Window.partitionBy(col("id")).orderBy(col("create_time").desc)))

.filter("rn=1")

.drop("rn")

println("两最新表合并后的value如下:")

value.show(50,false) // 打印输出合并后的数据

// 使用左连接将合并后的数据和dwd中的数据进行匹配,将dwd中的dwd_modify_time字段赋值给合并后数据的dwd_modify_time字段

// 如果dwd中没有对应的记录,则dwd_modify_time字段取当前时间

val frame = value.join(dwd.selectExpr("id", "dwd_modify_time as time"), Seq("id"), "outer")

.withColumn("dwd_modify_time", when(col("time").isNotNull, date_format(current_timestamp(), "yyyy-MM-dd HH:mm:ss")).otherwise(col("dwd_modify_time")))

.drop("time")

.withColumn("create_time", to_timestamp(col("create_time"), "yyyy-MM-dd HH:mm:ss")) // 将字符串类型的 create_time 转换为时间戳类型

frame.show(50,false) // 打印输出转换后的数据

frame.createOrReplaceTempView("temp_table")

spark.sql("INSERT OVERWRITE TABLE dwd.dim_province PARTITION (etl_date) SELECT * FROM temp_table")

// 打印输出写入成功信息

println("dwd.dim_province 写入成功啦!!!")

}

}

清洗4代码如下:

import org.apache.spark.SparkConf // 导入SparkConf类

import org.apache.spark.sql.{SparkSession, functions} // 导入SparkSession和functions类

import org.apache.spark.sql.functions._ // 导入Spark SQL函数库

import org.apache.spark.sql.expressions.Window // 导入Window类用于分组排序

object extract04 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local").setAppName("extract04")

conf.set("spark.sql.hive.thriftServer.async", "true") // 设置异步模式为true

conf.set("hive.exec.dynamic.partition.mode", "nonstrict") // 设置动态分区模式为nonstrict

val spark = SparkSession.builder().config(conf).enableHiveSupport().getOrCreate()

println("Hive Databases: ")

spark.sql("show databases").show(false)

// 获取最新的ods.base_region表数据

val ods = spark.table("ods.base_region").filter("etl_date = (select max(etl_date) from ods.base_region)")

println("最新的ods.base_region表数据如下:")

ods.show(50,truncate = false) // 打印输出ods数据

ods.createOrReplaceTempView("tmp") // 创建临时视图tmp

// 获取最新的dwd.dim_region表数据,并只保留id在ods中存在的记录

val dwd = spark.table("dwd.dim_region").filter("etl_date = (select max(etl_date) from dwd.dim_region) and id in (select id from tmp)")

println("最新的dwd.dim_region表数据如下:")

dwd.show(50) // 打印输出dwd数据

dwd.createOrReplaceTempView("dwd") // 创建临时视图dwd

// 添加dwd_insert_user、dwd_insert_time、dwd_modify_user、dwd_modify_time四个列,用于标记数据修改信息

val ods1 = ods

.withColumn("dwd_insert_user", lit("user1"))

.withColumn("dwd_insert_time", current_timestamp())

.withColumn("dwd_modify_user", lit("user1"))

.withColumn("dwd_modify_time", current_timestamp())

// 将ods1和dwd中的数据合并,并根据create_time字段进行分组排序,选择每组中的第一条记录

val value = dwd.unionByName(ods1)

.withColumn("rn", row_number().over(Window.partitionBy(col("id")).orderBy(col("create_time").desc)))

.filter("rn=1")

.drop("rn")

println("两最新表合并后的value如下:")

value.show(50) // 打印输出合并后的数据

// 使用左连接将合并后的数据和dwd中的数据进行匹配,将dwd中的dwd_modify_time字段赋值给合并后数据的dwd_modify_time字段

// 如果dwd中没有对应的记录,则dwd_modify_time字段取当前时间

val frame = value.join(dwd.selectExpr("id", "dwd_modify_time as time"), Seq("id"), "outer")

.withColumn("dwd_modify_time", when(col("time").isNotNull, date_format(current_timestamp(), "yyyy-MM-dd HH:mm:ss")).otherwise(col("dwd_modify_time")))

.drop("time")

.withColumn("create_time", to_timestamp(col("create_time"), "yyyy-MM-dd HH:mm:ss")) // 将字符串类型的 create_time 转换为时间戳类型

frame.show(50) // 打印输出转换后的数据

frame.createOrReplaceTempView("temp_table")

spark.sql("INSERT OVERWRITE TABLE dwd.dim_region PARTITION (etl_date) SELECT * FROM temp_table")

// 打印输出写入成功信息

println("dwd.dim_region 写入成功啦!!!")

}

}清洗5代码如下:

import org.apache.spark.SparkConf

import org.apache.spark.sql.{SparkSession, functions}

import org.apache.spark.sql.functions._

import org.apache.spark.sql.expressions.Window

import java.time.LocalDate

object extract05 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local").setAppName("extract05")

conf.set("spark.sql.hive.thriftServer.async", "true")

conf.set("hive.exec.dynamic.partition.mode", "nonstrict")

val spark = SparkSession.builder().config(conf).enableHiveSupport().getOrCreate()

println("Hive Databases:")

spark.sql("show databases").show(false)

// 获取昨天的日期

val yesterday = LocalDate.now.minusDays(1).toString.replace("-", "")

// 从ods库的order_info表中抽取昨天的数据

val ods = spark.table("ods.order_info").filter(s"etl_date = '$yesterday'")

println("昨天的ods.order_info表数据如下:")

ods.show(50, truncate = false)

// 修改字段类型和处理空值

val ods1 = ods

.withColumn("etl_date",lit(yesterday))

.withColumn("create_time", to_timestamp(col("create_time"), "yyyy-MM-dd"))

.withColumn("operate_time", when(col("operate_time").isNull, col("create_time")).otherwise(col("operate_time")))

.withColumn("dwd_insert_user", lit("user1"))

.withColumn("dwd_insert_time", current_timestamp())

.withColumn("dwd_modify_user", lit("user1"))

.withColumn("dwd_modify_time", current_timestamp())

// 将ods1表的数据插入到dwd库的动态分区表fact_order_info中

ods1.write.mode("append").partitionBy("etl_date").format("hive").saveAsTable("dwd.fact_order_info")

// 打印输出写入成功信息

println("dwd.fact_order_info 写入成功!")

}

}清洗6代码如下:

import org.apache.spark.SparkConf

import org.apache.spark.sql.{SparkSession, functions}

import org.apache.spark.sql.functions._

import org.apache.spark.sql.expressions.Window

import java.time.LocalDate

object extract06 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local").setAppName("extract06")

conf.set("spark.sql.hive.thriftServer.async", "true")

conf.set("hive.exec.dynamic.partition.mode", "nonstrict")

val spark = SparkSession.builder().config(conf).enableHiveSupport().getOrCreate()

println("Hive Databases:")

spark.sql("show databases").show(false)

// 获取昨天的日期

val yesterday = LocalDate.now.minusDays(1).toString.replace("-", "")

// 从ods库的order_detail表中抽取昨天的数据

val ods = spark.table("ods.order_detail").filter(s"etl_date = '$yesterday'")

println("昨天的ods.order_detail表数据如下:")

ods.show(50, truncate = false)

// 修改字段类型和处理空值

val ods1 = ods

.withColumn("etl_date",lit(yesterday))

.withColumn("create_time", to_timestamp(col("create_time"), "yyyy-MM-dd"))

.withColumn("dwd_insert_user", lit("user1"))

.withColumn("dwd_insert_time", current_timestamp())

.withColumn("dwd_modify_user", lit("user1"))

.withColumn("dwd_modify_time", current_timestamp())

// 将ods1表的数据插入到dwd库的动态分区表fact_order_detail中

ods1.write.mode("append").partitionBy("etl_date").format("hive").saveAsTable("dwd.fact_order_detail")

// 打印输出写入成功信息

println("dwd.fact_order_detail 写入成功!")

}

}(代码实现框架没有问题,可供参考,因为没有比赛数据,只是模拟数据,可能在数据处理部分存在些许逻辑小错误,若需直接使用,请根据自己实际需求稍加修改)

四:验证图片

(用更优质更全更新的资源学习,简直yyds啊!!!感兴趣看主页)

1744

1744

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?