Her看过吧?

现在!

ChatGPT版本的Her也来了!

北京时间5月14日凌晨,OpenAI 一场不到 30 分钟的发布会,正式发布了 GPT-4o,视频语音交互丝滑到吓人,还即将免费可用!

GPT-4o,其中的「o」代表「omni」(即全面、全能的意思),这个模型同时具备文本、图片、视频和语音方面的能力,甚至就是 GPT-5 的一个未完成版。

更重要的是,这个 GPT-4 级别的模型,将向所有用户开放,并且未来几周内先向 ChatGPT Plus 推送。

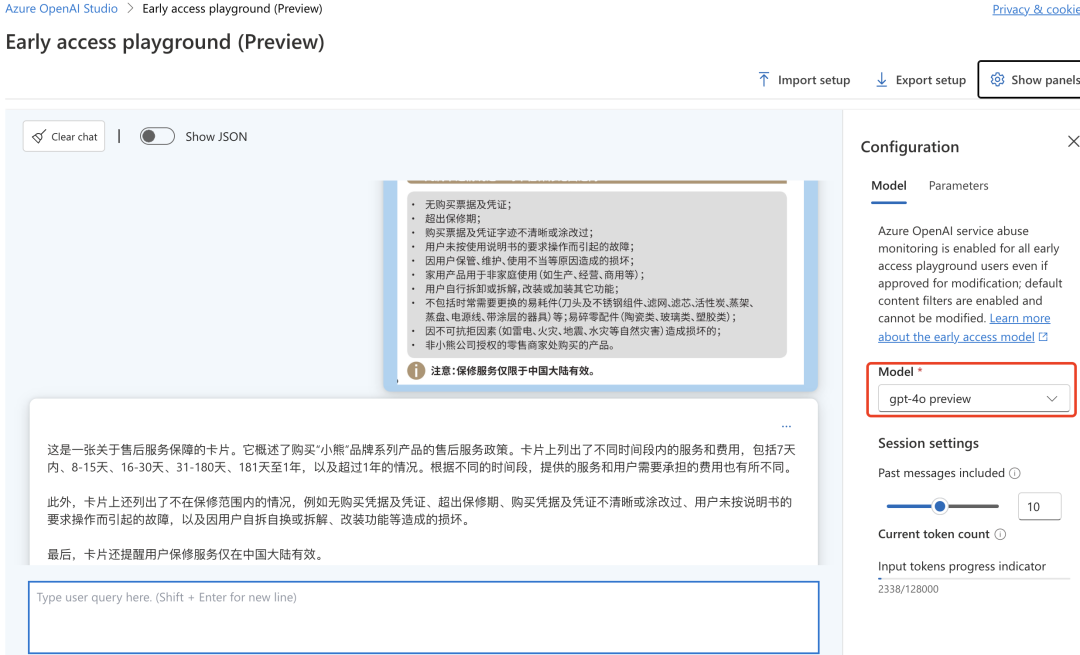

微软这边,也是在Azure OpenAl Studio上早早进行了跟进。

从今天开始,Azure OpenAI 服务客户可以在美国的两个地区通过Azure OpenAI Studio中的预览游乐场探索 GPT-4o 的广泛功能。

参考链接:

微软 Azure OpenAI 申请

太长不看版:

1.新的 GPT-4o 模型:打通任何文本、音频和图像的输入,相互之间可以直接生成,无需中间转换。

2.GPT-4o 语音延迟大幅降低,能在 232 毫秒内回应音频输入,平均为 320 毫秒,这与对话中人类的响应时间相似。

3.GPT-4o 向所有用户免费开放 。

(新语音模式几周内先对Plus用户开放)

4.GPT-4o API,比 GPT 4-Turbo 快 2 倍,价格便宜 50% 。

5.惊艳的实时语音助手演示:对话更像人、能实时翻译,识别表情,可以通过摄像头识别画面写代码分析图表 。

6.ChatGPT 新 UI,更简洁。

7.一个新的 ChatGPT 桌面应用程序,适用于 macOS,Windows 版本今年晚些时候推出。

GPT-4o免费可用,但这不是它最大的亮点

端到端训练,一个神经网络搞定语音文本图像。

正如奥特曼在发布会前所说,GPT-4o让人感觉像魔法一样。GPT-4o 的强大之处,在于它能接受任何文本、音频和图像的组合作为输入,并直接生成上述这几种媒介输出。

这意味着人机交互将更接近人与人的自然交流。

与旧版的对比:

旧版ChatGPT语音模式,由三个独立模型组成,语音转文本→GPT3.5/GPT-4→文本转语音。平均延迟为 2.8 秒(GPT-3.5)和 5.4 秒(GPT-4)。

GPT-4o则是跨文本、视觉和音频端到端训练的新模型,这意味着所有输入和输出都由同一个神经网络处理。GPT-4o 可以在 232 毫秒内回应音频输入,平均为 320 毫秒,接近于人类对话的反应时间。

而且旧版ChatGPT语音模式丢失了大量的信息,它无法直接感受音调、多个说话者或背景噪音,也无法输出笑声、唱歌声,或表达情感。这一切,在GPT-4o上则都能实现。

与现有模型相比,GPT-4o 在视觉和音频理解方面表现尤为出色。

-你在对话时可以随时打断

-可以根据场景生成多种音调,带有人类般的情绪和情感

-直接通过和 AI 视频通话让它在线解答各种问题

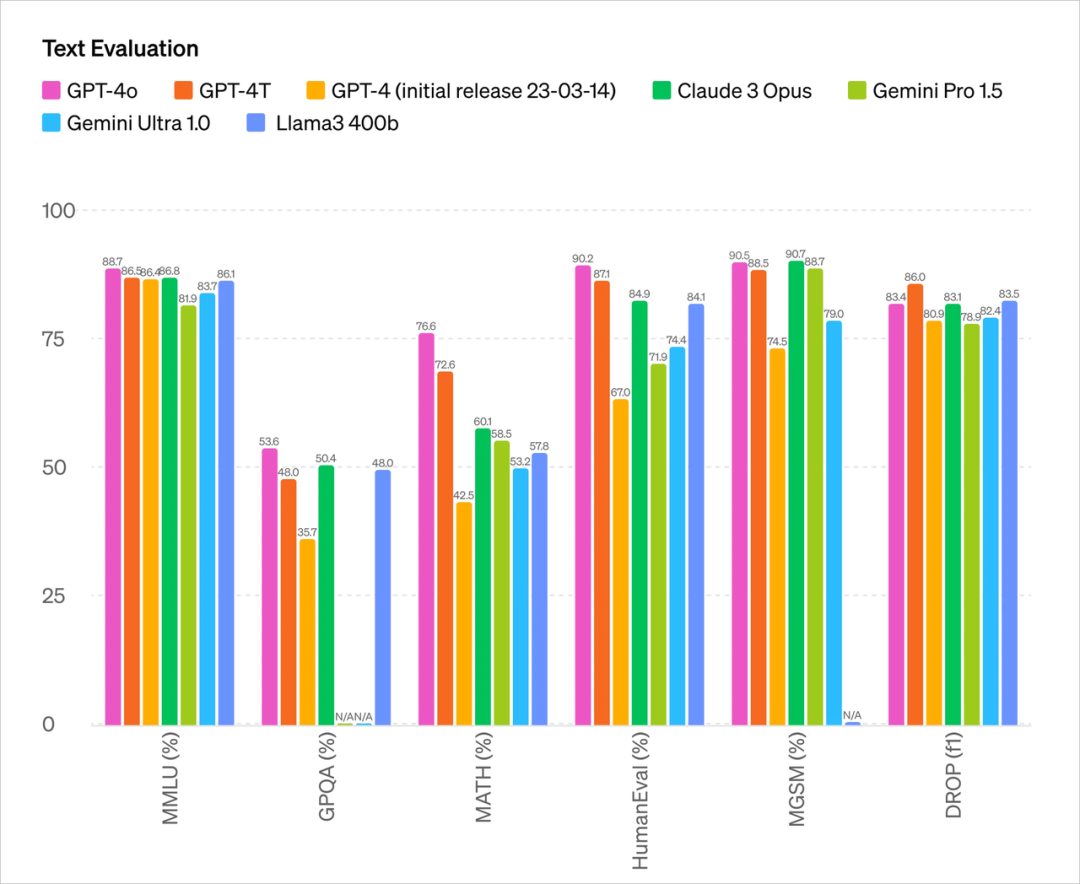

从测试参数来看,GPT-4o 主要能力上基本和目前最强 OpenAI 的 GPT-4 Turbo 处于一个水平。

它在英文和代码文本上与 GPT-4 Turbo 的性能相匹敌,在非英语语言文本上有显著改进,同时在 API 上更快速且价格便宜 50%。

而更令人惊喜的是,ChatGPT 免费用户就能使用 GPT-4o 可以体验以下功能:

-体验 GPT-4 级别的智能

-从模型和网络获取响应

-分析数据并创建图表

-聊一聊你拍的照片

-上传文件以获取摘要、写作或分析帮助

-使用 GPTs 和 GPT Store

-通过 Memory 构建更加有帮助的体验

话不多说,看看演示

睡觉搭子

以一个具体的生活场景为例,让 ChatGPT 讲一个关于机器人和爱的睡前故事,它几乎不用太多思考,张口就能说出一个带有情感和戏剧性的睡前故事。

甚至它还能以唱歌的形式来讲述故事,简直可以充当用户的睡眠搭子。

做题高手

又或者,在发布会现场,让其演示如何给线性方程 3X+1=4 的求解提供帮助,它能够一步步贴心地引导并给出正确答案。

当然,上述还是一些「小儿戏」,现场的编码难题才是真正的考验。不过,三下五除二的功夫,它都能轻松解决。

借助 ChatGPT 的「视觉」,它能够查看电脑屏幕上的一切,譬如与代码库交互并查看代码生成的图表,咦,不对劲?那我们以后的隐私岂不是也要被看得一清二楚了?

实时翻译

现场的观众也给 ChatGPT 提出了一些刁钻的问题。

从英语翻译到意大利语,从意大利语翻译到英语,无论怎么折腾该 AI 语音助手,它都游刃有余,看来没必要花大价钱去买翻译机了,在未来,指不定 ChatGPT 可能比你的实时翻译机还靠谱。

实时翻译(官网案例)

感知语言的情绪还只是第一步,ChatGPT 还能解读人类的的面部情绪。

在发布会现场,面对摄像头拍摄的人脸,ChatGPT 直接将其「误认为」桌子,正当大家伙以为要翻车时,原来是因为最先打开的前置摄像头瞄准了桌子。

不过,最后它还是准确描述出自拍面部的情绪,并且准确识别出脸上的「灿烂」的笑脸。

两个 GPT-4o 互动并唱歌(官网案例)

有趣的是,在发布会的尾声,发言人也不忘 Cue 了英伟达和其创始人老黄的「鼎力支持」,属实是懂人情世故的。

Azure OpenAI已上线GPT-4o预览模型 !

来源于微软官网

微软这边,也是在Azure OpenAl Studio上早早进行了跟进。

从今天开始,Azure OpenAI 服务客户可以在美国的两个地区通过Azure OpenAI Studio中的预览游乐场探索 GPT-4o 的广泛功能。

注意:

GPT-4o 早期访问游乐场目前仅适用于West US3和East US的资源,并且每个订阅每五分钟最多只能有 10 个请求。

即使批准修改,所有早期访问 Playground 用户仍会启用 Azure OpenAI 服务滥用监控;默认内容过滤器已启用且无法修改。

GPT-4o 是 Azure OpenAI 预览模型,目前不可用于部署/直接 API 访问预计5月21日正式上线。

此初始版本侧重于文本和视觉输入,以提供模型潜力的一瞥,为音频和视频等进一步功能铺平道路。

微软表示,GPT-4o 的推出为各个行业的企业带来了无数的可能性:

-增强的客户服务:通过集成不同的数据输入,GPT-4o 可实现更加动态和全面的客户支持交互。

-高级分析:利用 GPT-4o 处理和分析不同类型数据的能力,以增强决策并揭示更深入的见解。

-内容创新:利用 GPT-4o 的生成能力来创建引人入胜且多样化的内容格式,以满足广泛的消费者偏好。

↑实测,Azure OpenAI企业用户还在等什么,快去体验吧!

出于合规角度,建议国内企业可以选择微软的Azure OpenAI服务来使用接口。

通过微软openai官方合作伙伴获取服务,可以合规、稳定地提供企业用户使用ChatGPT的可能,满足国内发票需求,同时也能解决连接不稳定/响应速度慢/并发配额低等问题。

作为微软的合作伙伴,全云在线可为企业开通绿色申请通道!包括Meta Llama 3模型、企业版AZURE OPEN AI 最新版本GPT-4 Turbo、Dalle-3,只要企业有需求,全云在线都能协助快速开通!

286

286

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?