参考教程:手把手教你在本地部署DeepSeek R1,搭建web-ui ,建议收藏! - 久曲健 - 博客园

ollama下载地址:Ollama

PS:ollama是一个类似于模型管理工具,可以在上面下载各种开源模型,并对其进行管理

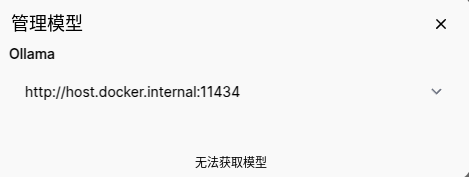

其中ollama运行在本机的11434端口,内部容器通过访问该端口获取模型列表.

本机环境:Ubuntu2404,Docker(snap安装)

报错界面:

这个其实说明你的docker并不能获取到localhost上的端口,使用如下指令对ollama进行启动

OLLAMA_HOST=0.0.0.0:11434 ollama serve

即可

可以通过docker logs查看一个日志,来发现此问题

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?