大数据导论

1.数据

大数据时代: 万物皆数据

数据概念: 人类的行为及产生的事件的一种记录称之为数据

数据价值: 对数据的内容进行深入分析,可以更好的帮助了解事和物在现实世界的运行规律

2.大数据诞生

大数据的诞生: 跟随着互联网的发展的,当全球互联网逐步建成(2000年左右),各大企业或政府单位拥有了海量的数据亟待处理。基于这个前提逐步诞生了以分布式的形式(即多台服务器集群)完成海量数据处理的处理方式,并逐步发展成现代大数据体系。

分布式: 多台服务器互相配合协同处理同一个事情

Apache Hadoop对大数据体系的意义: 第一款获得业界普遍认可的企业级开源分布式解决方案, 一定程度上催生出了众多的大数据体系技术栈,从Hadoop开源开始(2008年左右)大数据开始蓬勃发展

3.大数据概述

什么是大数据?

狭义上: 对海量数据进行处理的软件技术体系

广义上: 数字化、信息化时代的基础支撑,以数据为生活赋能

狭义和广义联系: 学习狭义上的大数据软件技术体系,在工作中为广义上的数字化、信息化时代,添砖加瓦

大数据解决了什么问题?

问题1: 海量数据的存储

问题2: 海量数据的计算

问题3: 海量数据的传输

大数据的核心工作?

存储: 利用各类大数据技术栈,妥善保存海量待处理数据

计算: 利用各类大数据技术栈,完成海量数据的价值挖掘

传输: 利用各类大数据技术栈,协助各个环节的数据传输

4.大数据特征

大数据特征简述: 5v(大多值快信)

大: 数据体量大

多: 种类来源多样化

值: 低价值密度

快: 速度快

信: 数据准确性

大数据的核心工作其实就是: 从海量的高增长、多类别、低信息密度的数据中挖掘出高质量的结果,为企业决策赋能

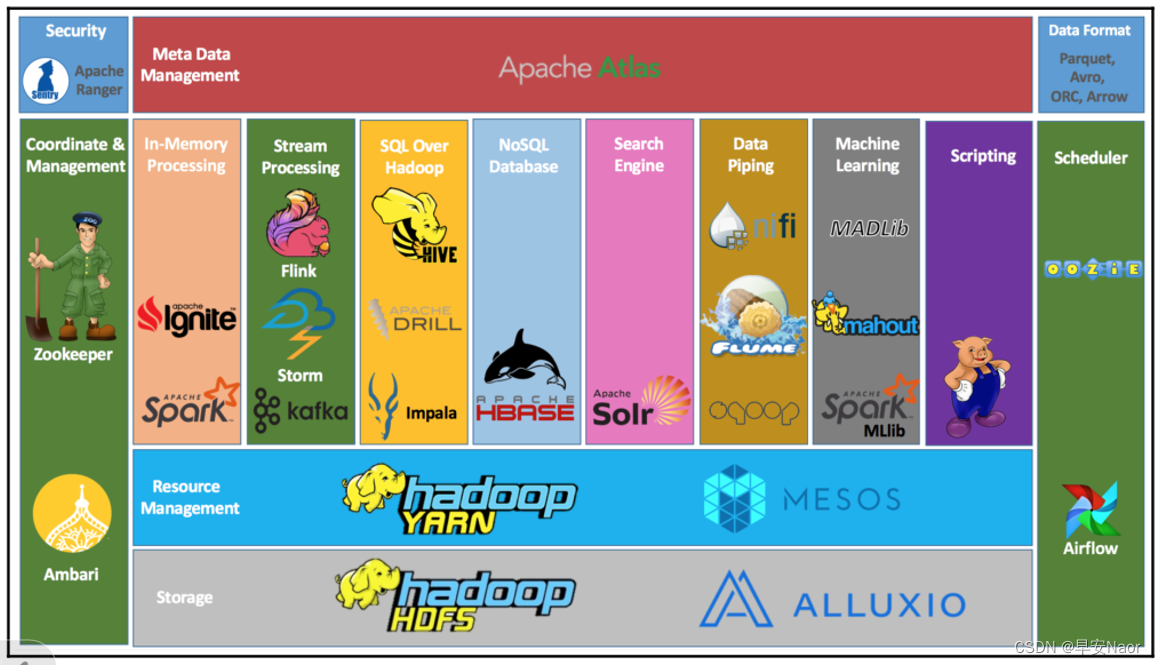

5.大数据技术栈

Apache软件基金会(Apache Software Foundation,简称 [ASF]是专门为运作一个开源软件项目的 Apache 的团体提供支持的非盈利性组织,这个开源软件的项目就是 Apache 项目。

存储

Apache Hadoop-HDFS: HDFS是Apache Hadoop Core项目的一部分,(Hadoop Distributed File System) Hadoop分布式文件存储系统

Apache Hbase: HBase是Apache的Hadoop项目的子项目

Apache Kudu: 是由Cloudera开源的存储引擎,贡献给Apache基金组织

计算

Apache Hadoop-MapReduce: MapReduce组件是最早一代的大数据分布式计算引擎对大数据的发展做出了卓越的贡献

Apache Hive: Hive是一款以SQL为要开发语言的分布式计算框架。HiveSQL其底层翻译成了Hadoop的MapReduce程序去执行

Apache Spark: Spark是目前全球范围内最火热的分布式内存计算引擎。是大数据体系中的明星计算产品

Apache Flink: Flink同样也是一款明星级的大数据分布式内存计算引擎。特别是在实时计算(流计算)领域占据了大多数的国内市场。

传输

Apache Sqoop: Sqoop是一款ETL工具,可以协助大数据体系(hdfs,hive)和关系型数据库(mysql)之间进行数据传输。

Apache Flume: Flume是一款流式数据采集工具,可以从非常多的数据源中完成数据采集传输的任务。

Apache Kafka: Kafka是一款分布式的消息系统,可以完成海量规模的数据传输工作。Apache Kafka在大数据领域也是明星产品

Apache Pulsar: Pulsar同样是一款分布式的消息系统。

6.Hadoop

Hadoop是开源的技术框架,提供分布式存储、计算、资源调度的解决方案

狭义上Hadoop: 包含HDFS,MapReduce,YARN三大组件的技术栈

广义上Hadoop: 整个Hadoop生态圈

Hadoop的创始人: Doug Cutting

Hadoop起源:于Apache Lucene子项目:Nutch ,Nutch的设计目标是构建一个大型的全网搜索引擎。

Hadoop启蒙: Google三篇著名的论文(也叫三驾马车)

《The Google file system》:谷歌分布式文件系统GFS

《MapReduce: Simplified Data Processing on Large Clusters》:谷歌分布式计算框架MapReduce

《Bigtable: A Distributed Storage System for Structured Data》:谷歌结构化数据存储系统

Hadoop的开源版本: Apache 开源社区版 (原生版本)

Hadoop的商业版本: Cloudera等商业公司自行二次封装的商业版

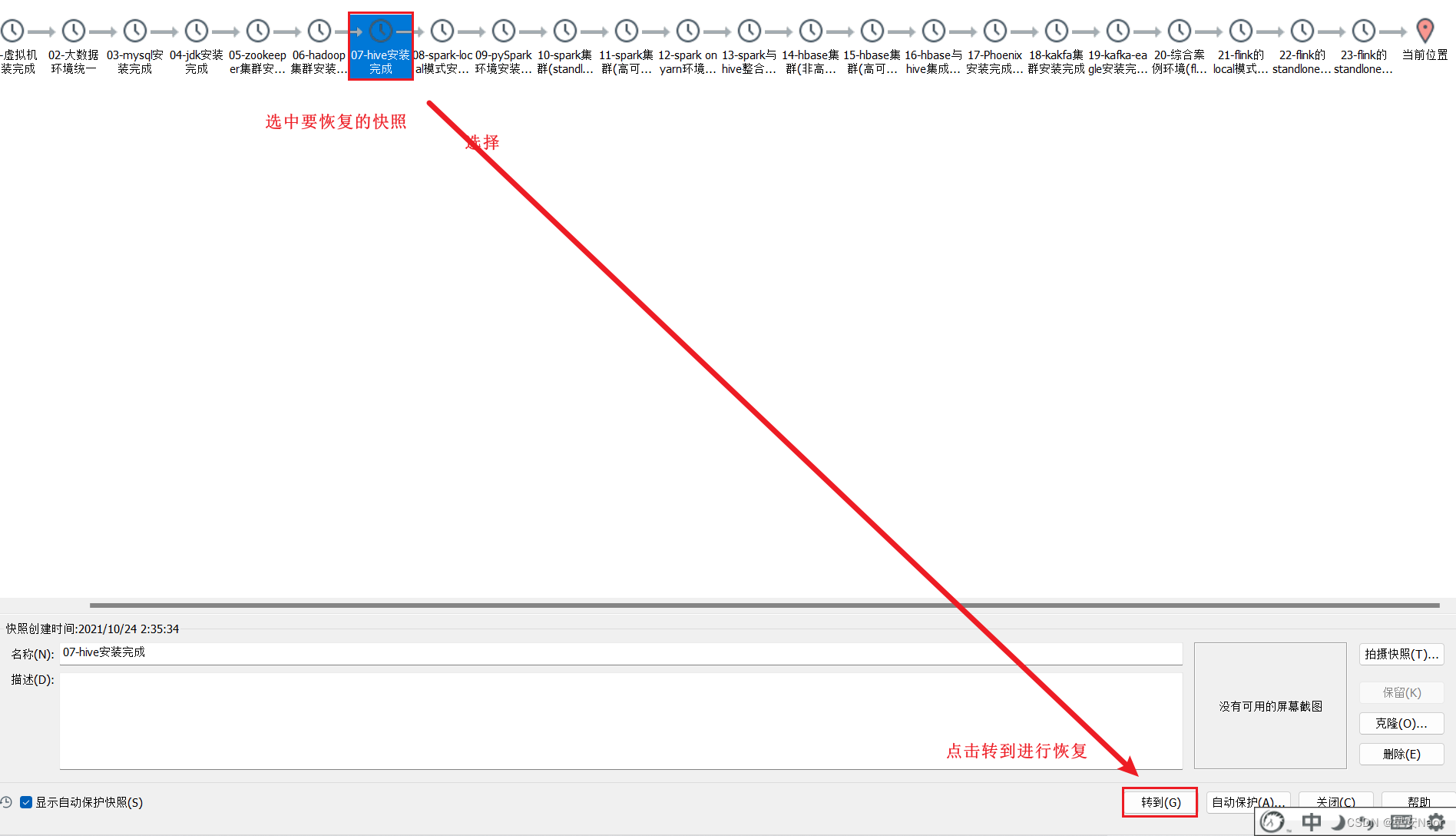

7.统一虚拟机环境

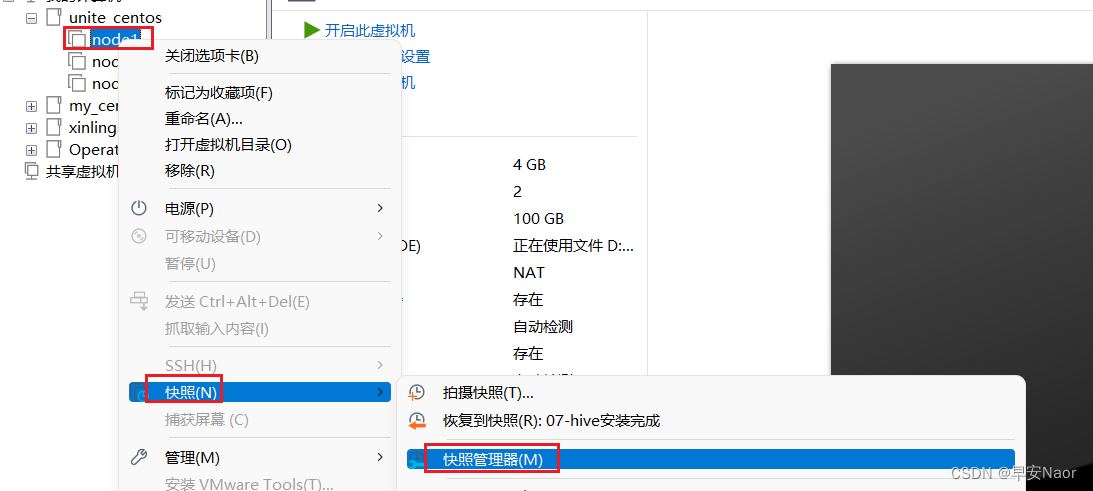

快照恢复

当前阶段只用到hadoop,hive环境,统一把虚拟机恢复到hive安装完成快照处

注意: 是三台机器都要恢复,下述只截图了一台

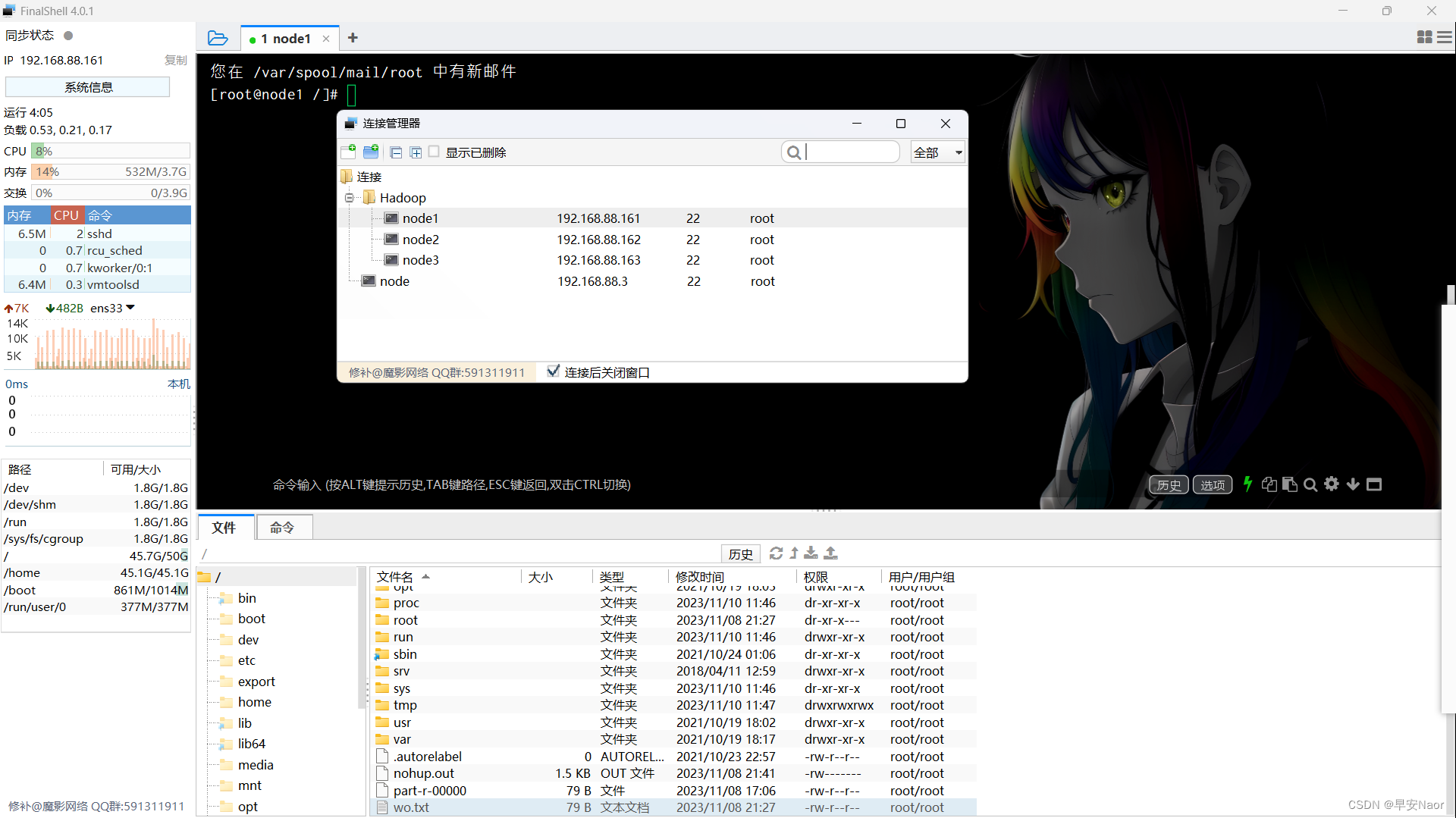

客户端连接

注意: 三台虚拟机ip地址是

192.168.88.161

192.168.88.162

192.168.88.163

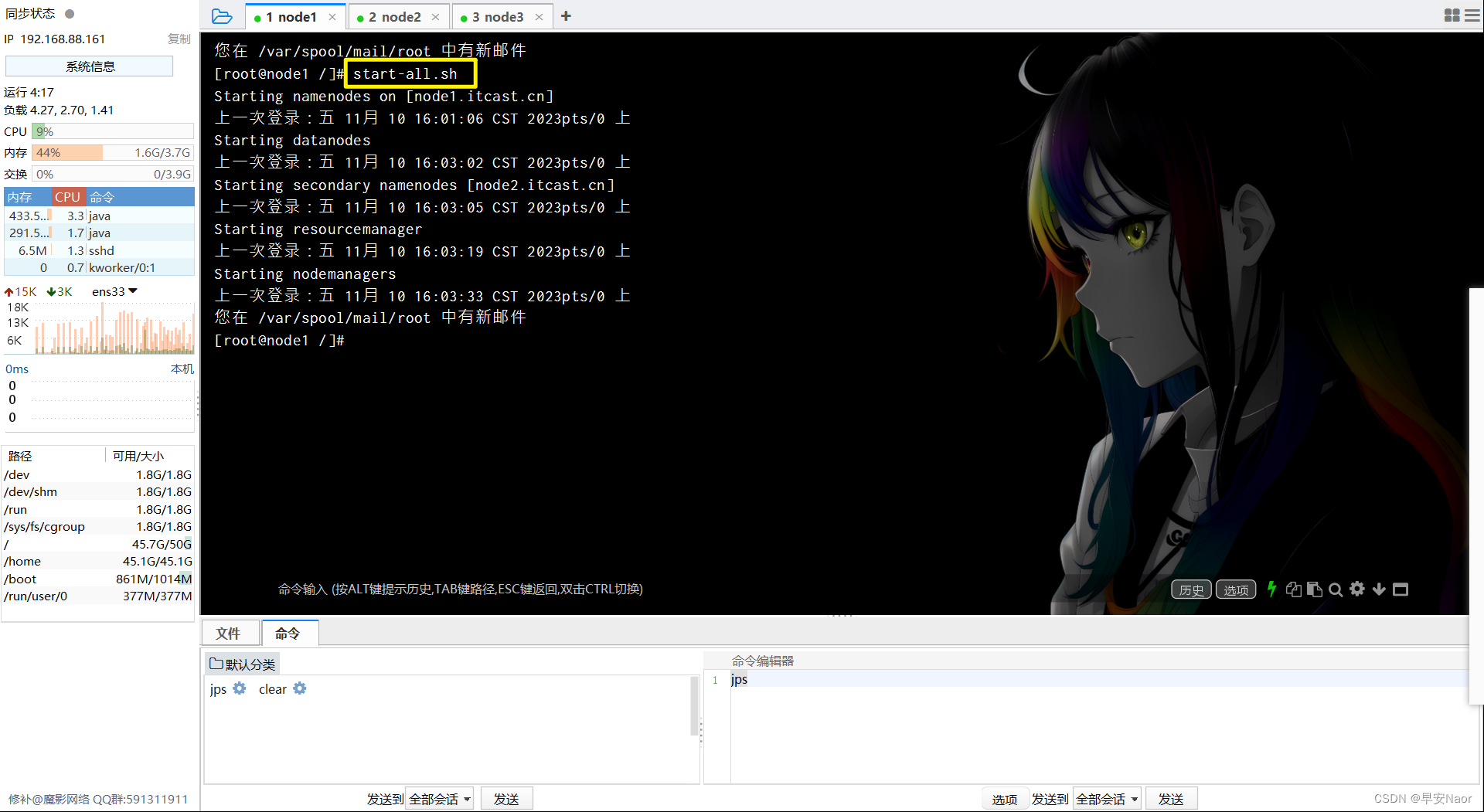

启动服务

启动hadoop集群

一键启动

注意: 在node1上启动

# 启动

[root@node1 ~]\# start-all.sh

# 了解下如何关闭

[root@node1 ~]\# stop-all.sh

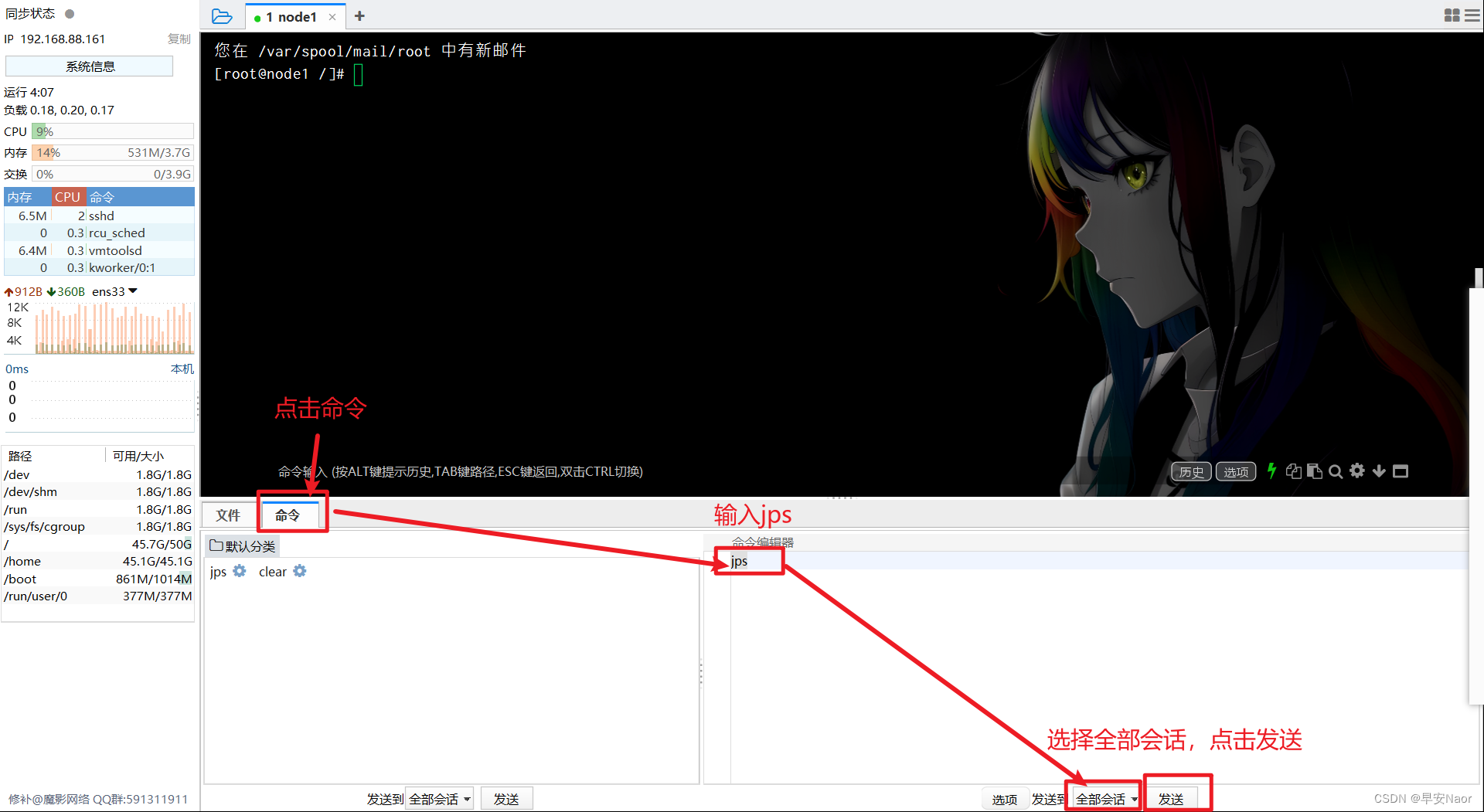

查看java进程

node1画面

另外两台虚拟机画面

node1

[root@node1 ~]\# jps

2850 NodeManager

2712 ResourceManager

2153 NameNode

3211 Jps

2284 DataNode

node2

[root@node2 ~]\# jps

2001 NodeManager

2123 Jps

1806 DataNode

1886 SecondaryNameNode

node3

[root@node3 ~]\# jps

1795 DataNode

1910 NodeManager

2030 Jps

启动历史服务

JobHistory用来记录已经完成的mapreduce运行日志,不是必须启动的

[root@node1 ~]\# mapred --daemon start historyserver

[root@node1 ~]\# jps

2850 NodeManager

2712 ResourceManager

2153 NameNode

3211 Jps

2284 DataNode

3385 JobHistoryServer

页面查看

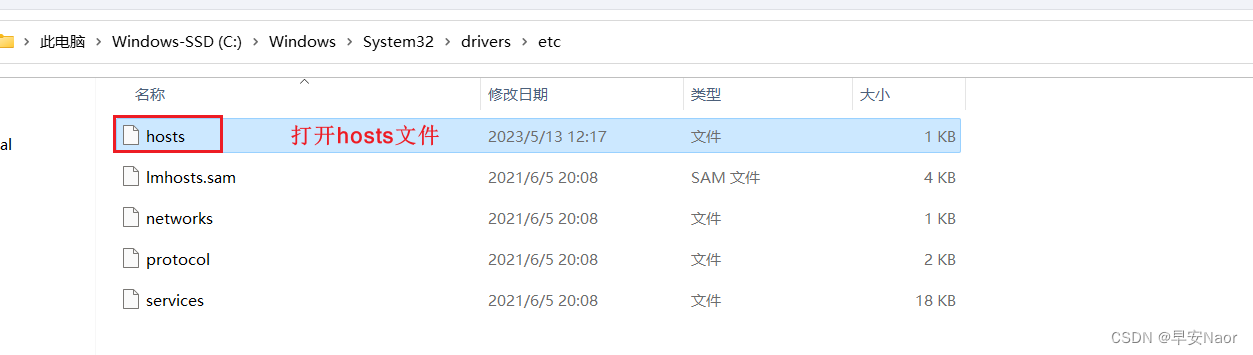

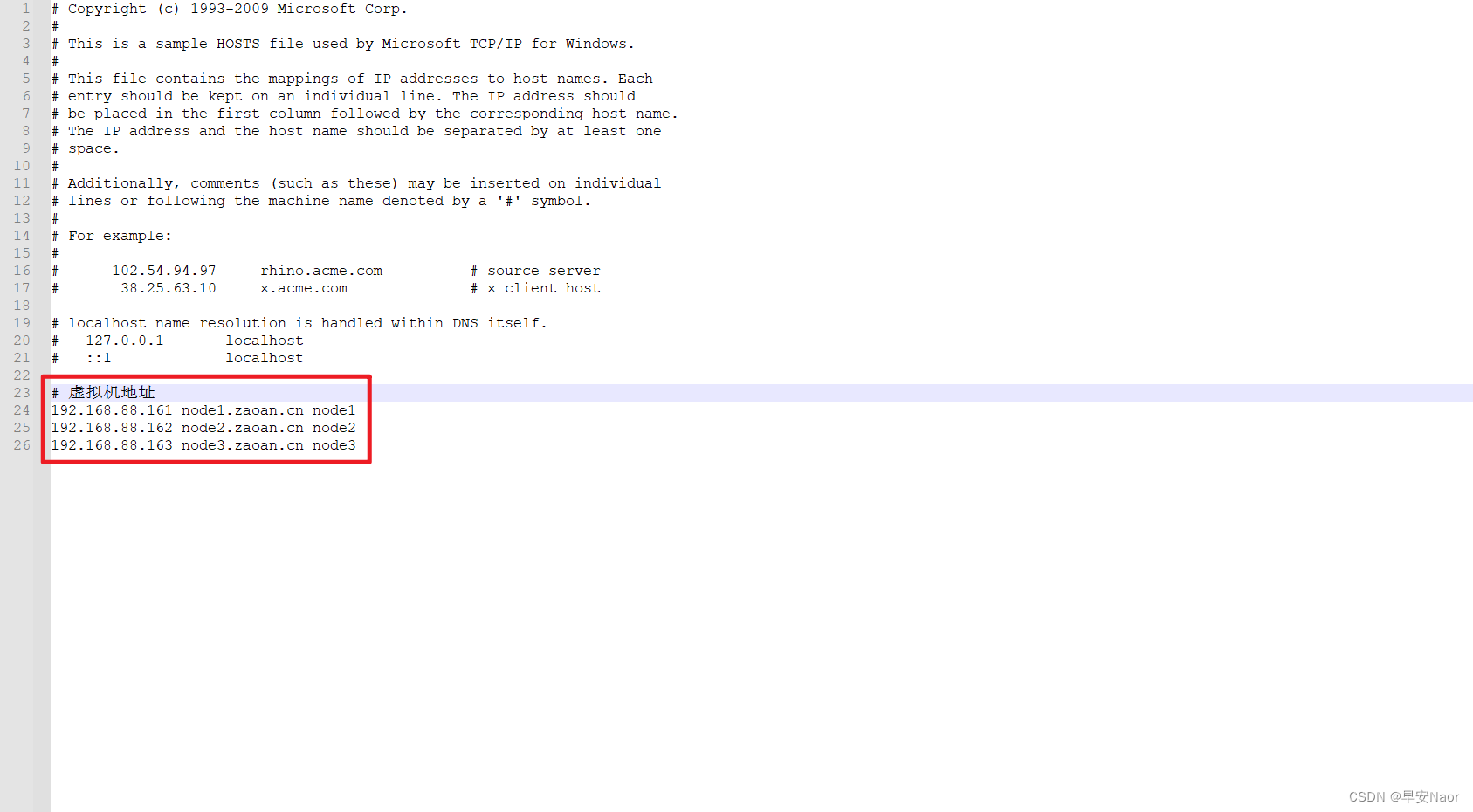

本地配置域名映射

在windows下,如果没有配置映射, 浏览器中不识别node1,node2,node3同时hdfs不能上传文件 。

如何解决? 可以进入 C:\Windows\System32\drivers\etc 目录打开hosts文件,设置域名映射

# 复制以下内容添加到hosts文件末尾

192.168.88.161 node1

192.168.88.162 node2

192.168.88.163 node3

中间的是我自己添加的另一个地址,一个url可以对应多个地址

注意: 如果电脑没有c盘修改权限,复制hosts文件到其他盘,修改完后,再替换回原来的

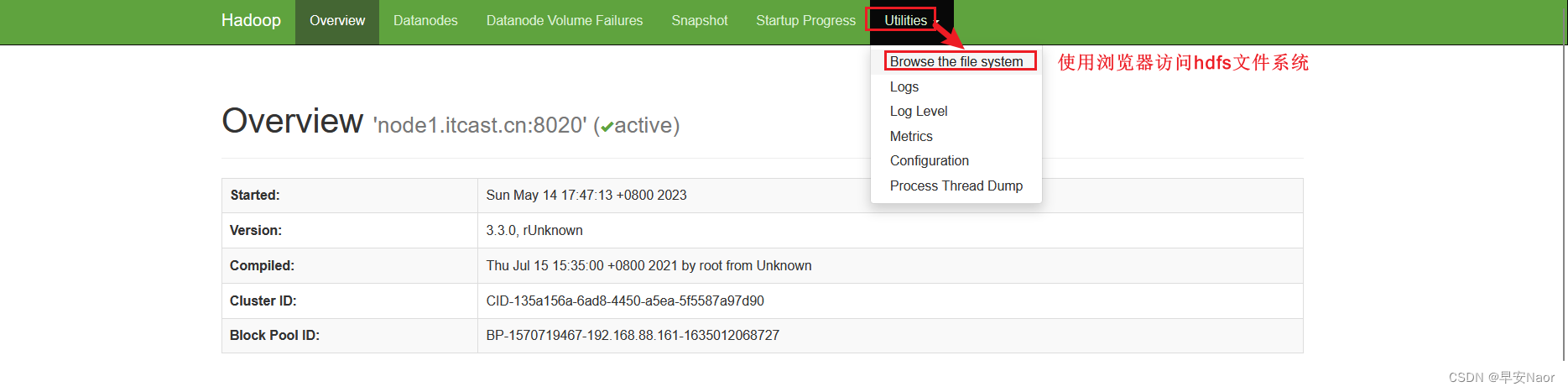

页面访问hadoop集群

URL: 统一资源定位符 也就是咱们常说的网址

访问hdfs文件系统的url: http://node1:9870

访问yarn资源调度的url: http://node1:8088

页面访问历史日志

访问历史mr计算日志: http://node1:19888

== 建议保存收藏对应网站==

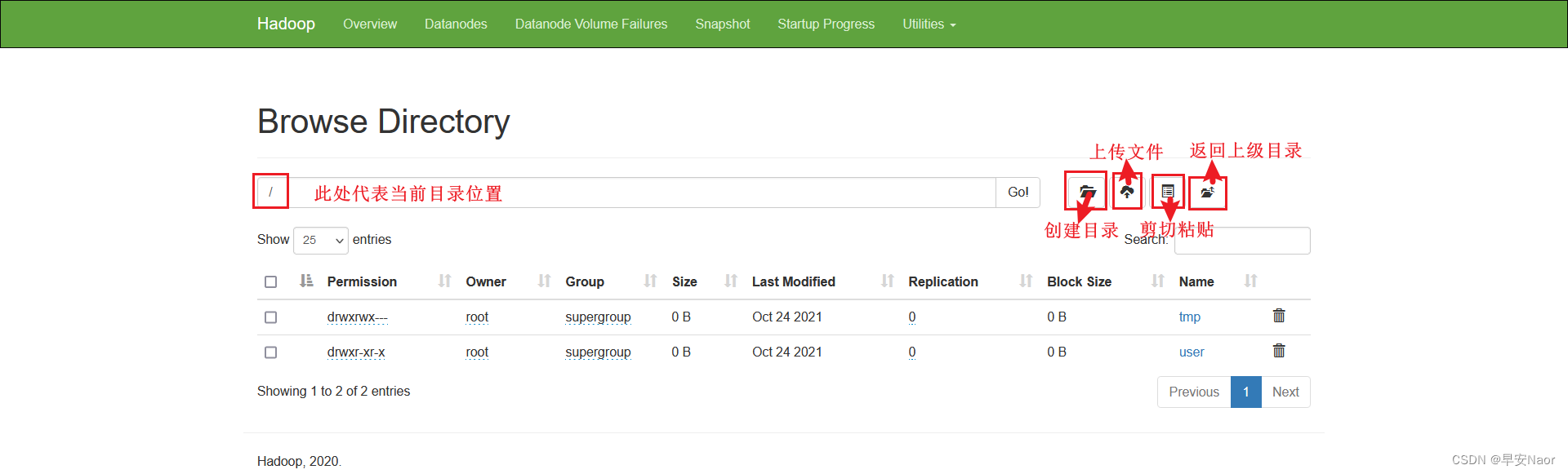

hdfs基本操作

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?