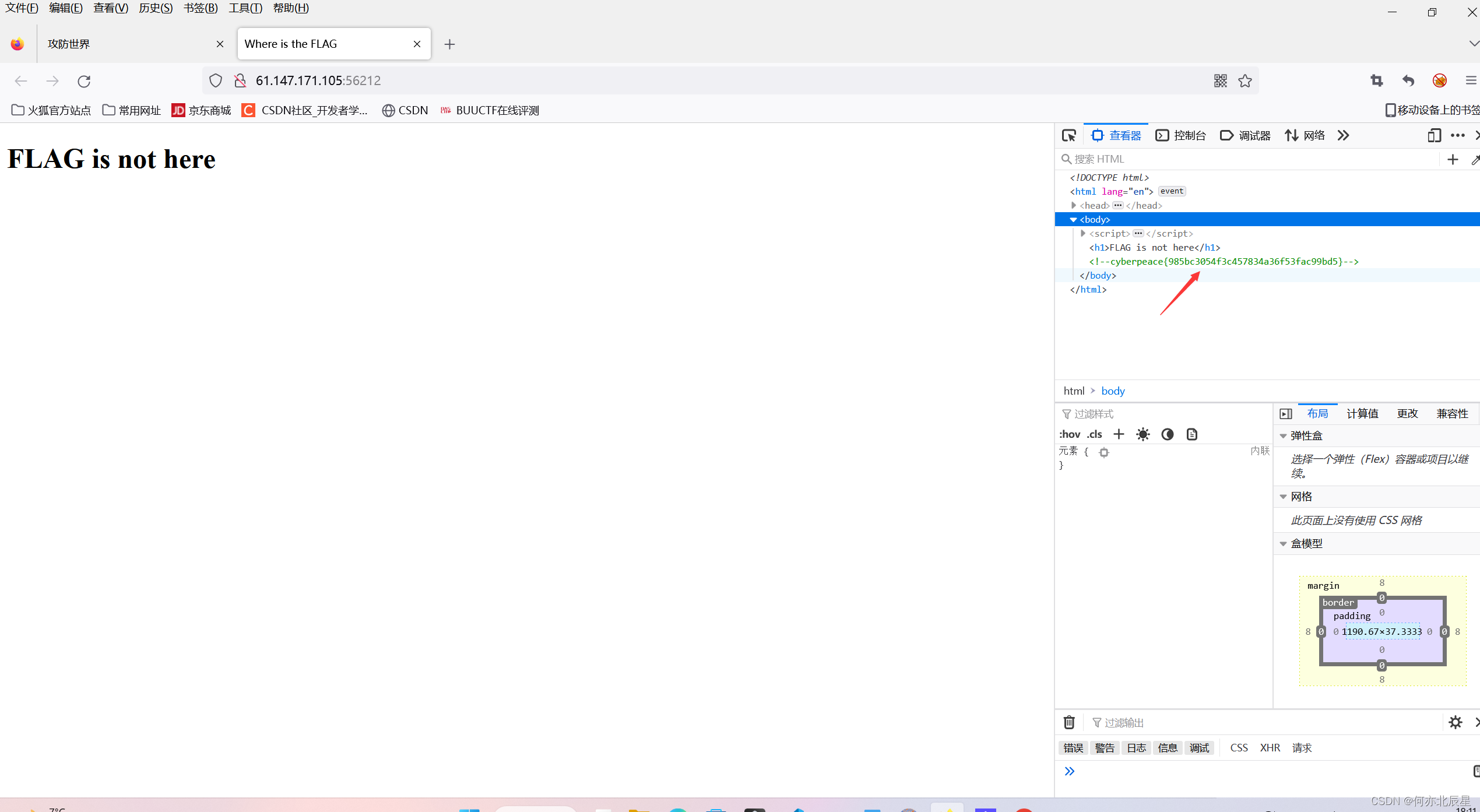

第一题说:右键用不了,肯定是无法查看页面源代码,直接F12查看flag或者抓包数据得到flag。

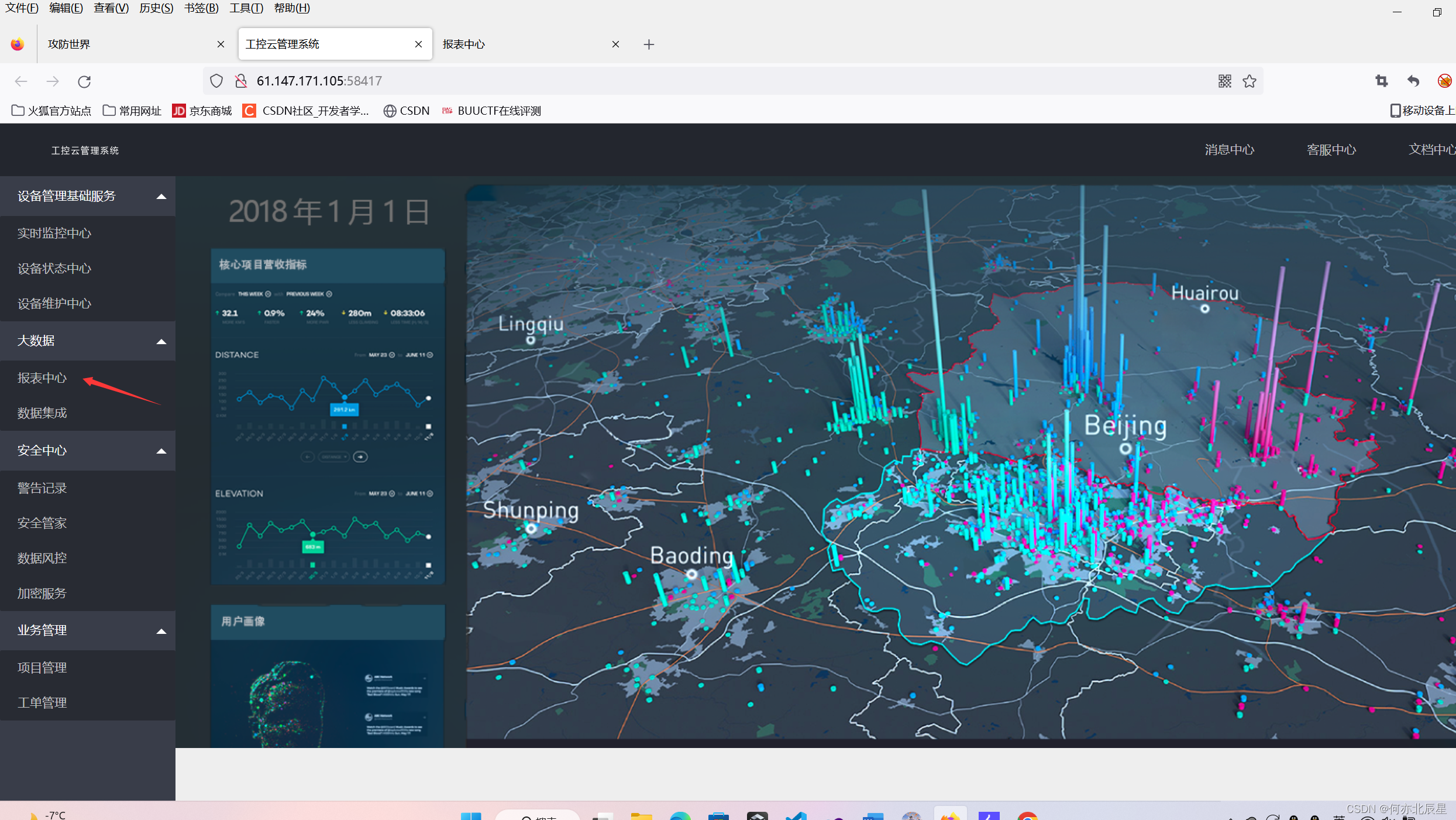

第二题:云平台报表中心收集了设备管理基础服务的数据,但是数据被删除了,只有一处留下了入侵者的痕迹

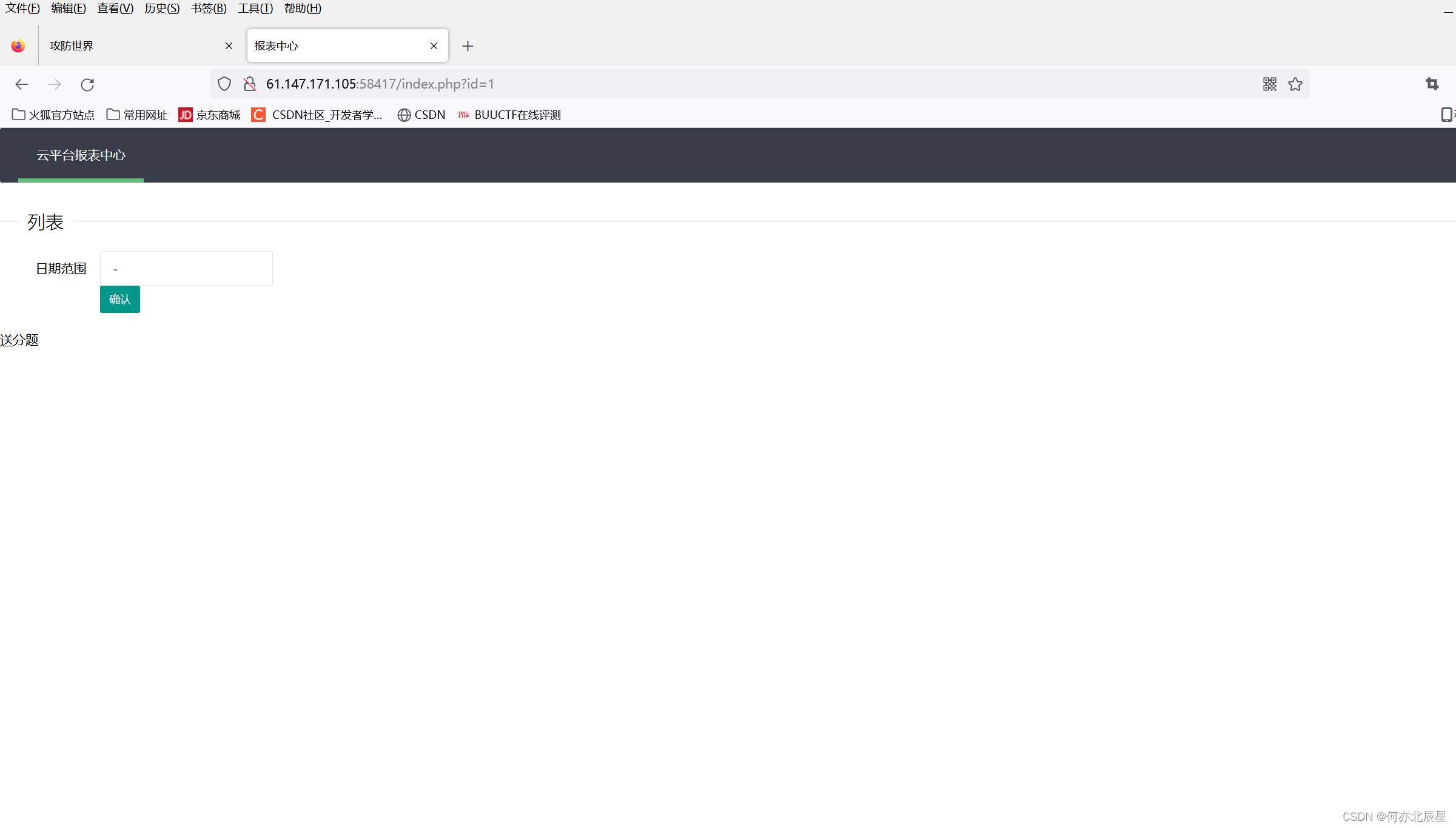

点进去链接,看了看只有报表中心可以打开

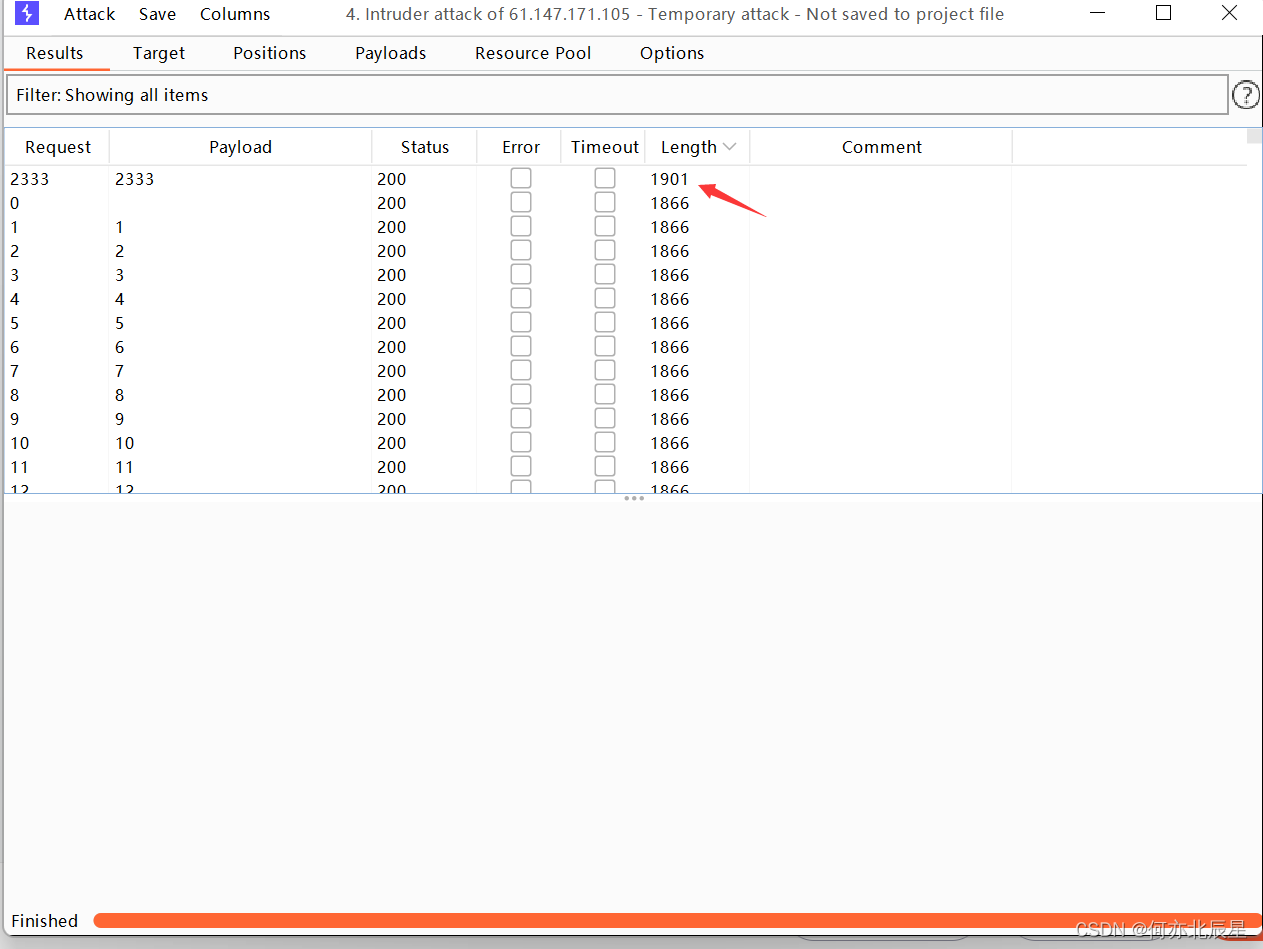

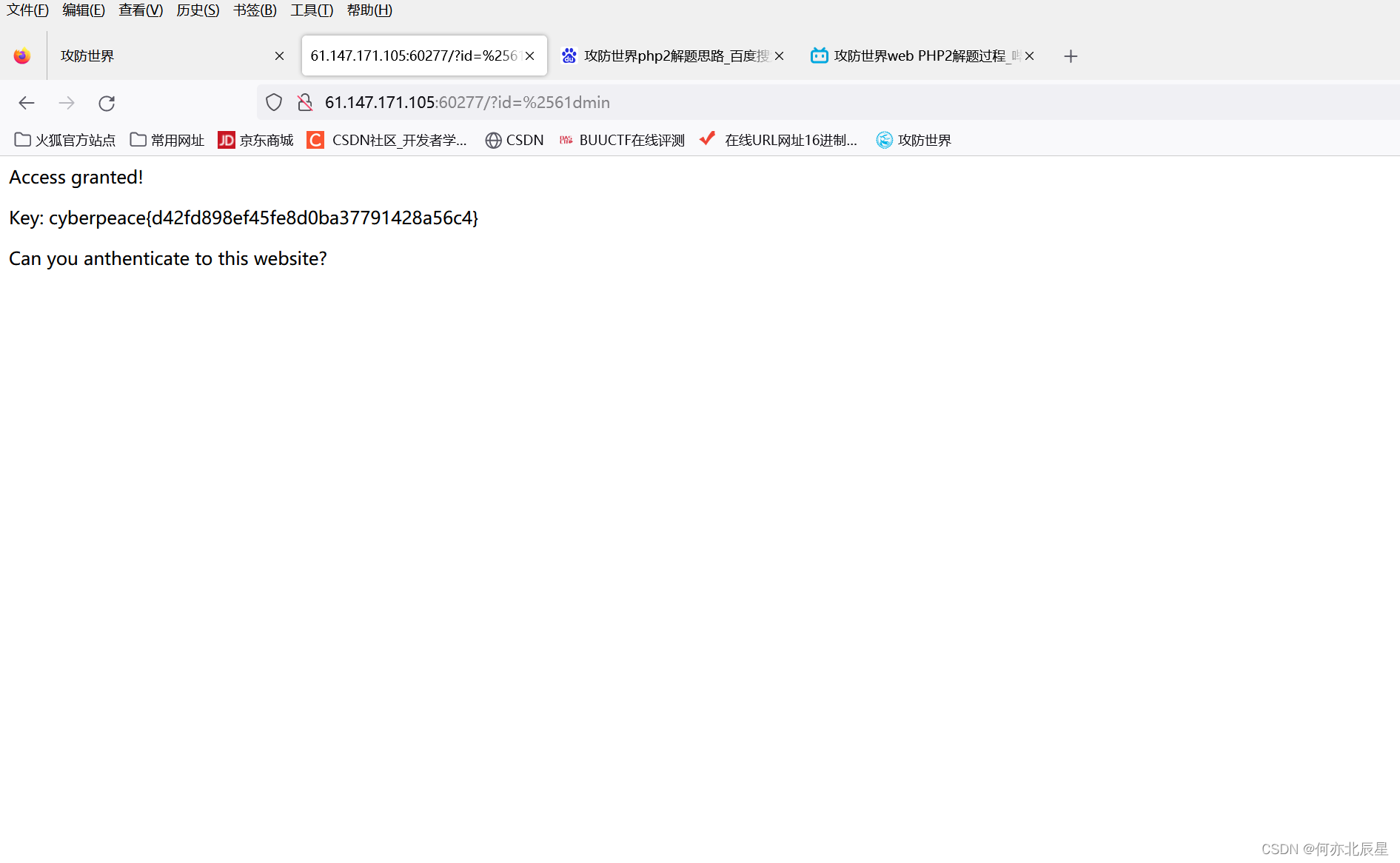

进入之后一脸懵,但说是送分题,试了试在上面url处可以修改id的值,于是尝试了爆破,破解出id的不一样的长度id:2333.

将上面id值改为2333,访问得到了flag。

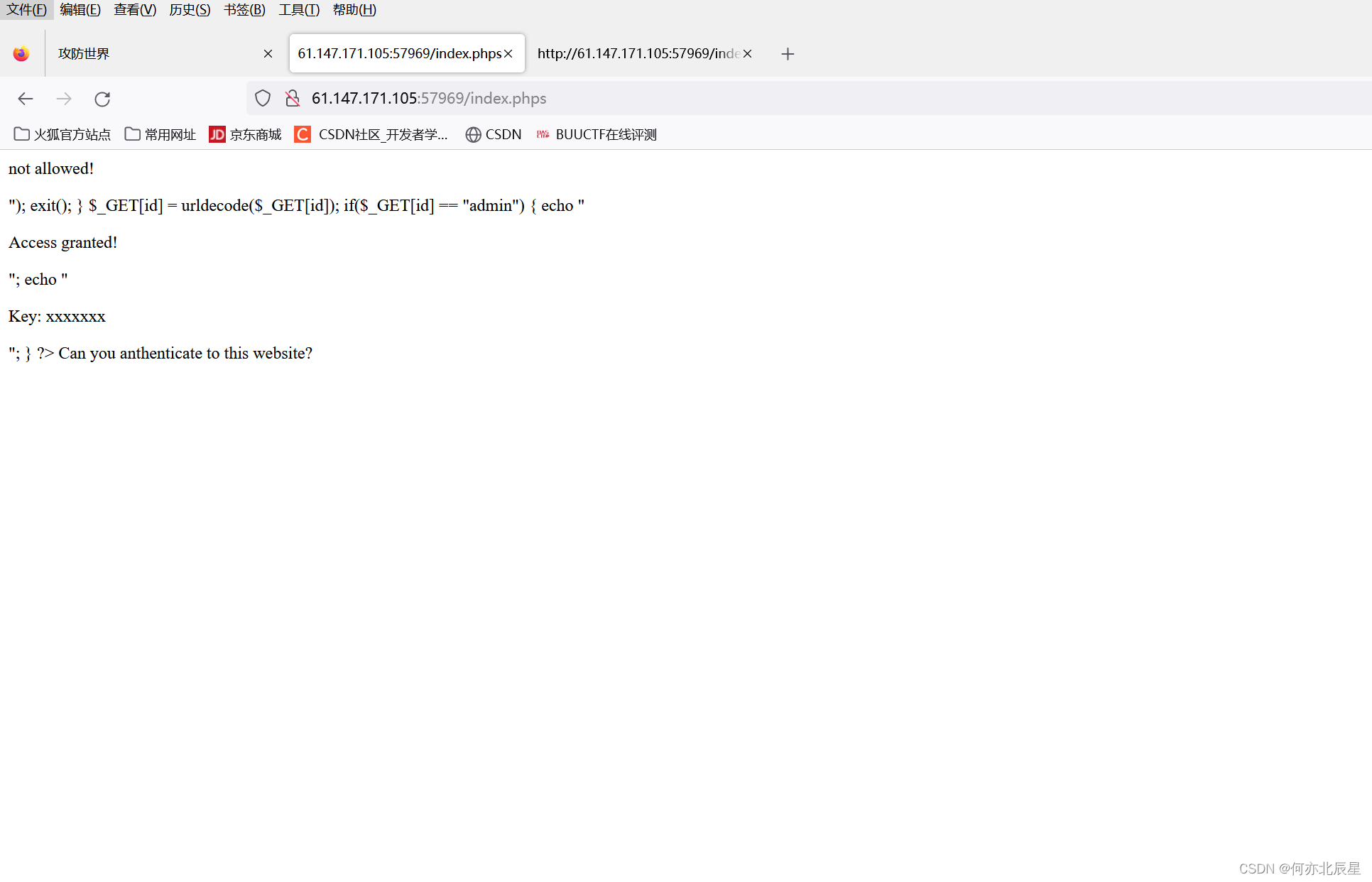

第三题:点击链接后一脸懵,但我看到题目提示肯定用php,于是我加了后缀index.php发现没啥变化,于是就不会了,看了一些大佬的提示,有的是扫目录或者是不断在php后面加后缀,于是得到了index.phps发现出现了一些代码,查看网页源代码进行审计。

毕竟还学过一段时间PHP,还是可以看懂,只是某些函数有点懵,这时百度查看解释即可

urlencode()函数原理就是首先把中文字符转换为十六进制,然后在每个字符前面加一个标识符%。 urldecode()函数与urlencode()函数原理相反,用于解码已编码的 URL 字符串,其原理就是把十六进制字符串转换为中文字符

该代码的意思时不能将id的值通过get传给admin,但必须让admin等于get传值,又由于传得值会经过url解码,(我又得知浏览器会对写入的东西进行一次url解码),因此必须传值的时候进行两次url编码才可以,即对admin进行两次url编码即可。

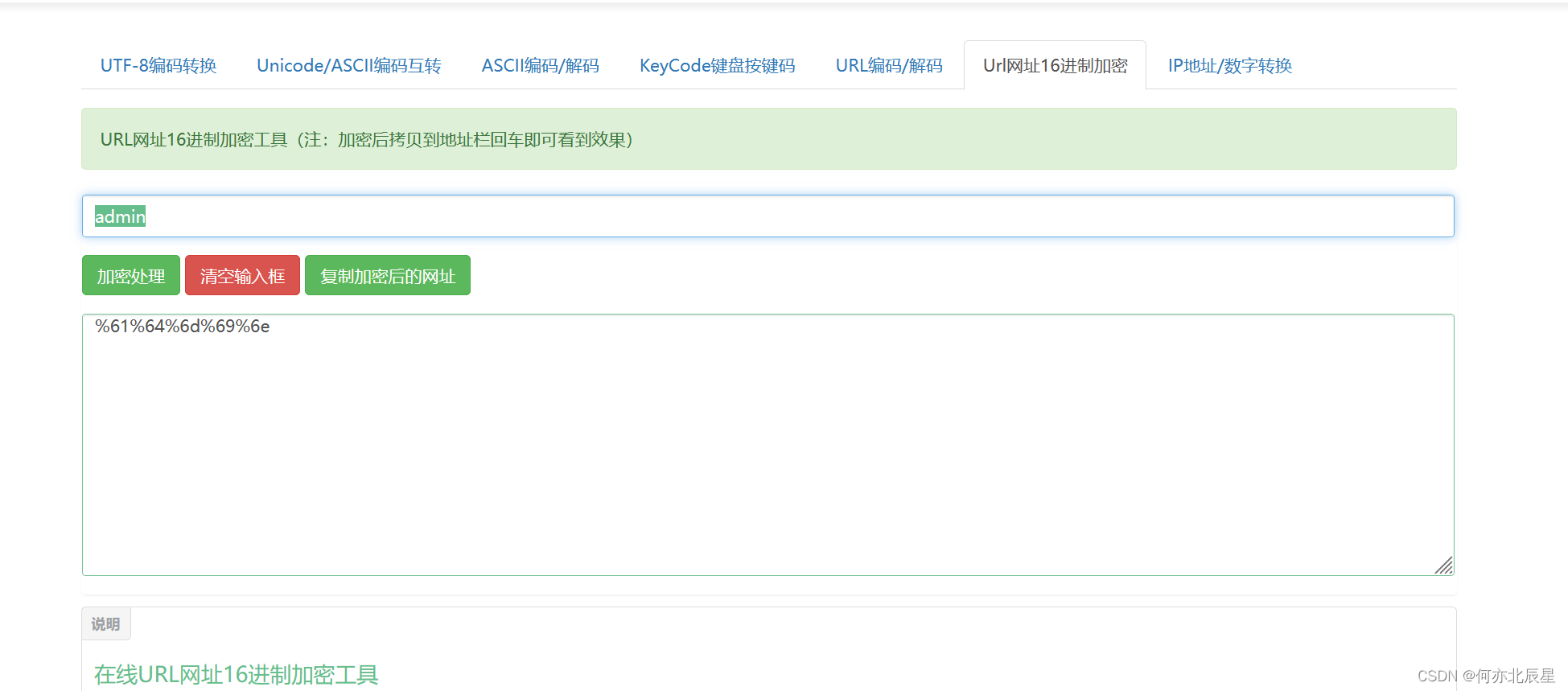

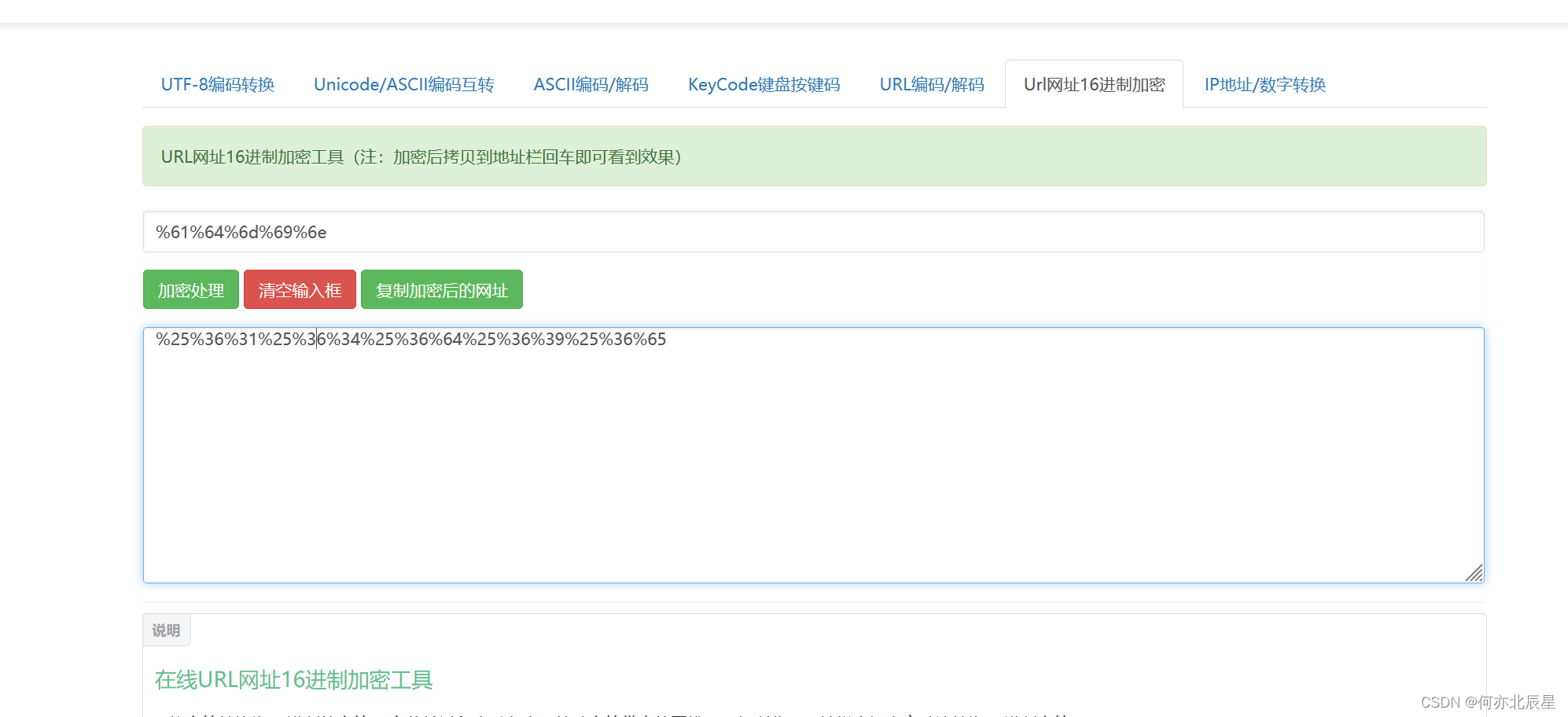

于是我在网上找到了在线编码工具进行了两次编码。

最终得到如图结果,将该结果输入到网址上:(得到flag)

补充:phps文件就是php的源代码文件,通常用于提供给用户(访问者)查看php代码,因为用户无法直接通过Web浏览器看到php文件的内容,

所以需要用phps文件代替。其实,只要不用php等已经在服> 务器中注册过的MIME类型为文件即可,但为了国际通用,所以才用了phps文件类型。

它的MIME类型为:text/html, application/x-httpd-php-source, application/x-httpd-php3-source。

第三题(挺开心的,这是自己独立解决的自认为的难题吧...):点开链接访问后,看到一连串英文,直接有道翻译。

意思为:在这个小小的训练挑战中,您将了解Robots_exclusion_standard。

robots.txt文件被网络爬虫用来检查他们是否被允许抓取和索引你的网站或只允许部分。

有时,这些文件揭示了目录结构,而不是保护内容不被抓取。

看到这里我仍然一脸懵,于是我就复制Robots_exclusion_standard去csdn上了解,初步了解了有关爬虫的知识,知道了robots.txt文件就是对爬虫的行为做出一定的限制,这种限制称为机器人排除标准。

在这个文件中会有一些基本格式:(用于说明哪些是爬虫不能访问的,即让其忽略特定的或者所有的文件目录)

- User-agent: *

- Disallow: /

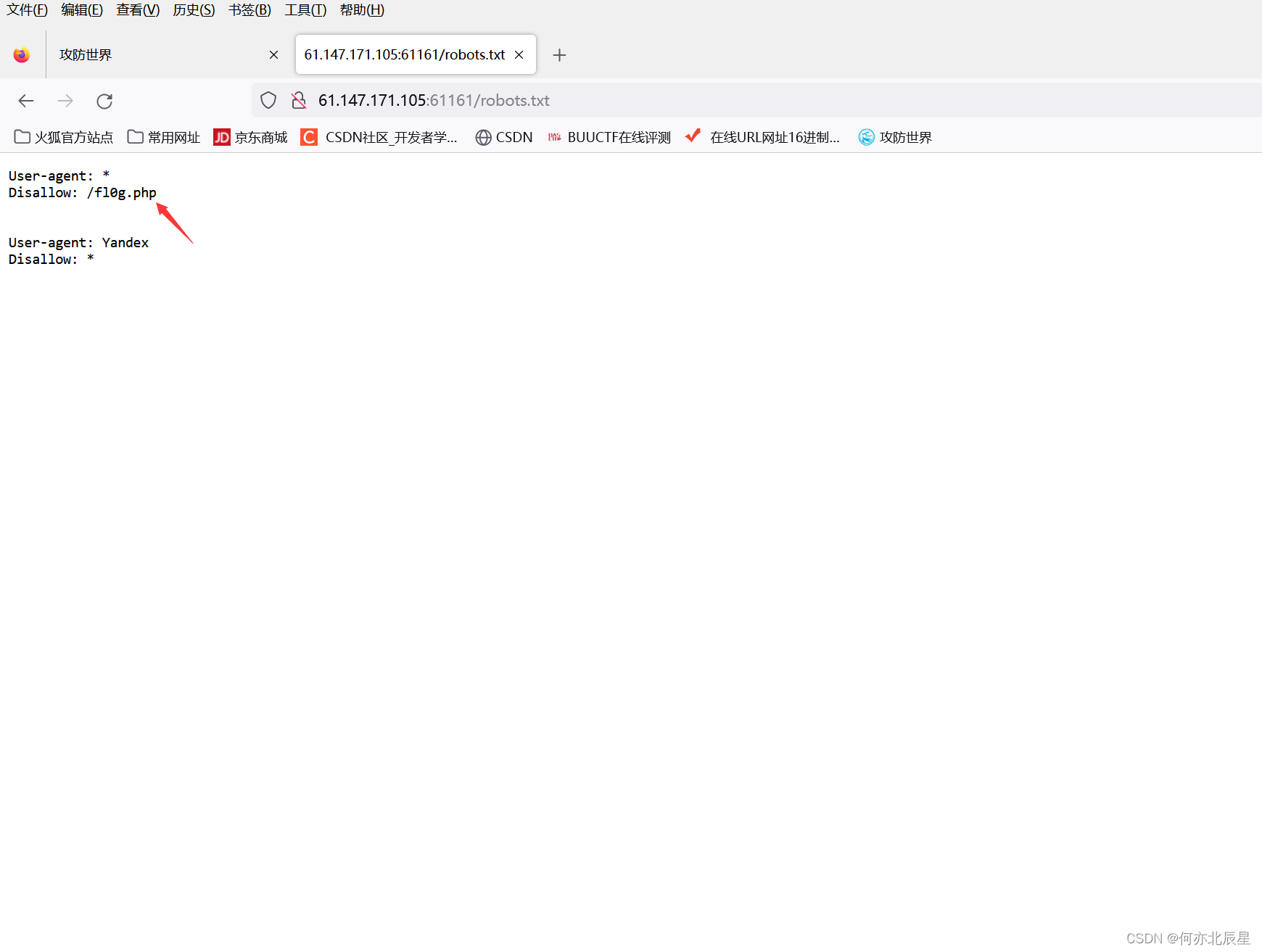

接下来我了解到在网站的基本地址后面加上robots.txt,就能看到各个网站的robots.txt 文件

即看到会让爬虫忽略的文件目录,于是我尝试输入robots.txt后缀,得到如图

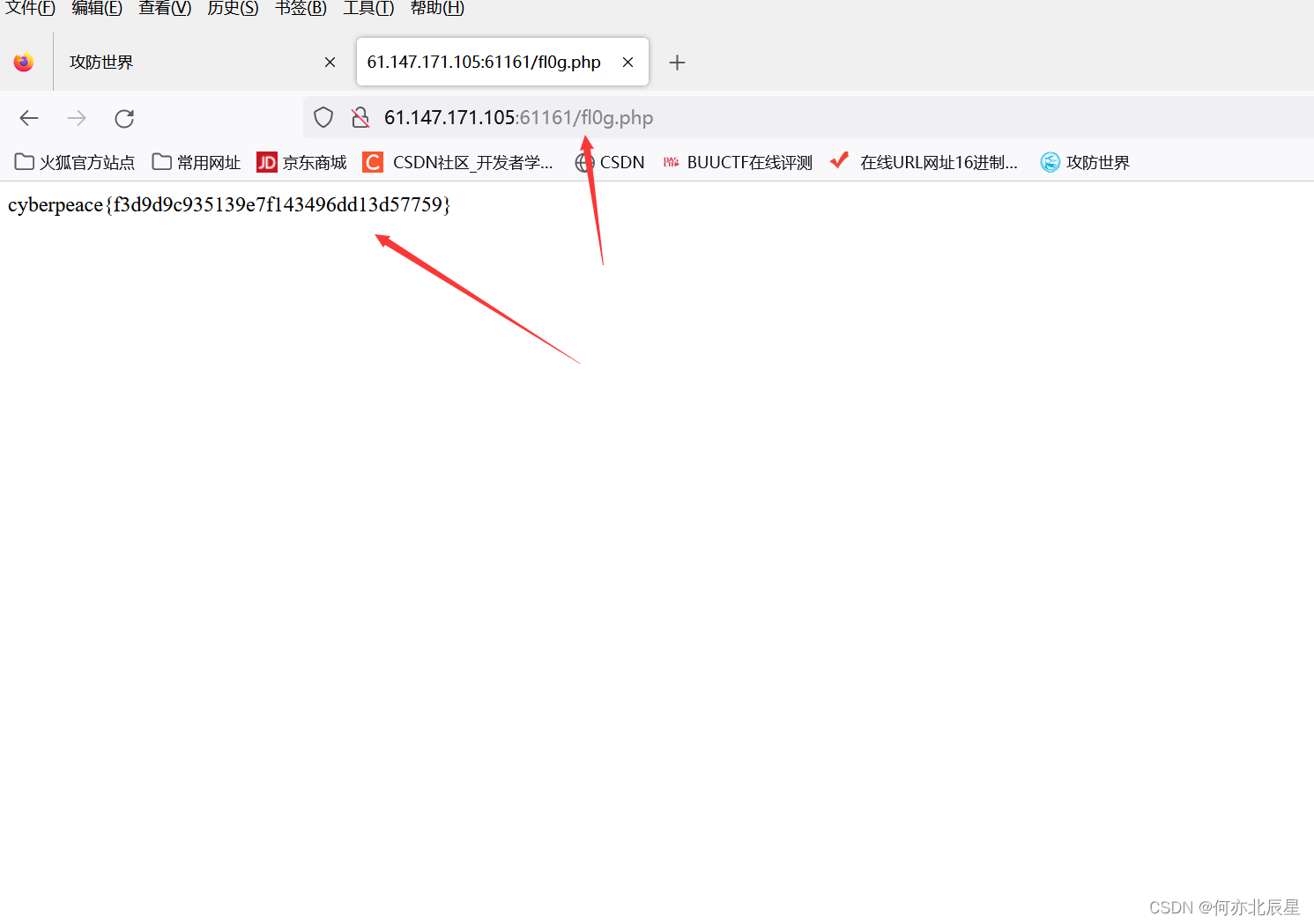

可以看到该文件中,不想让我们访问flog,那我们便可以在网址后面加上flog.php,然后我得到了flag

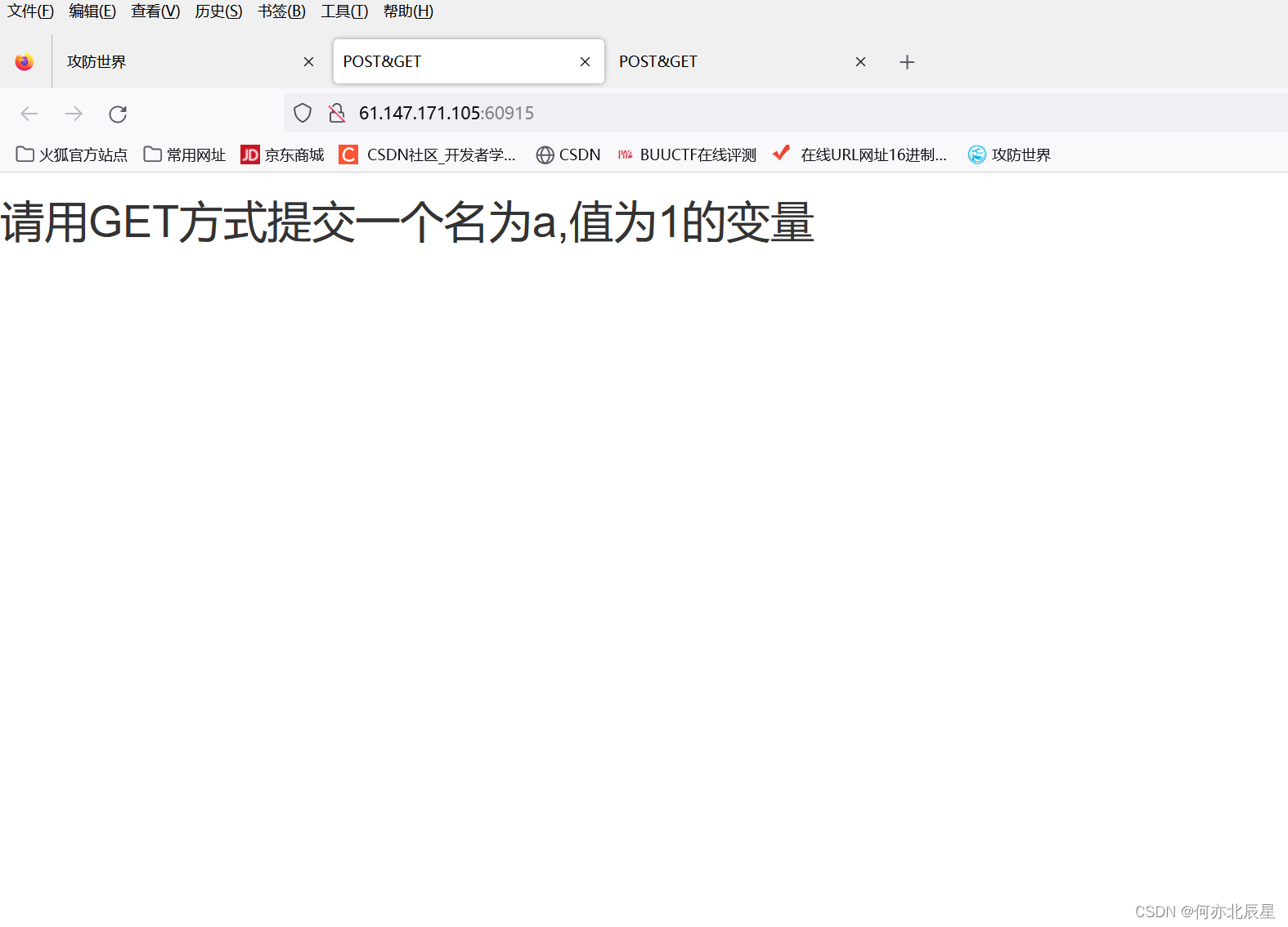

第五题:(可以说非常简单了)

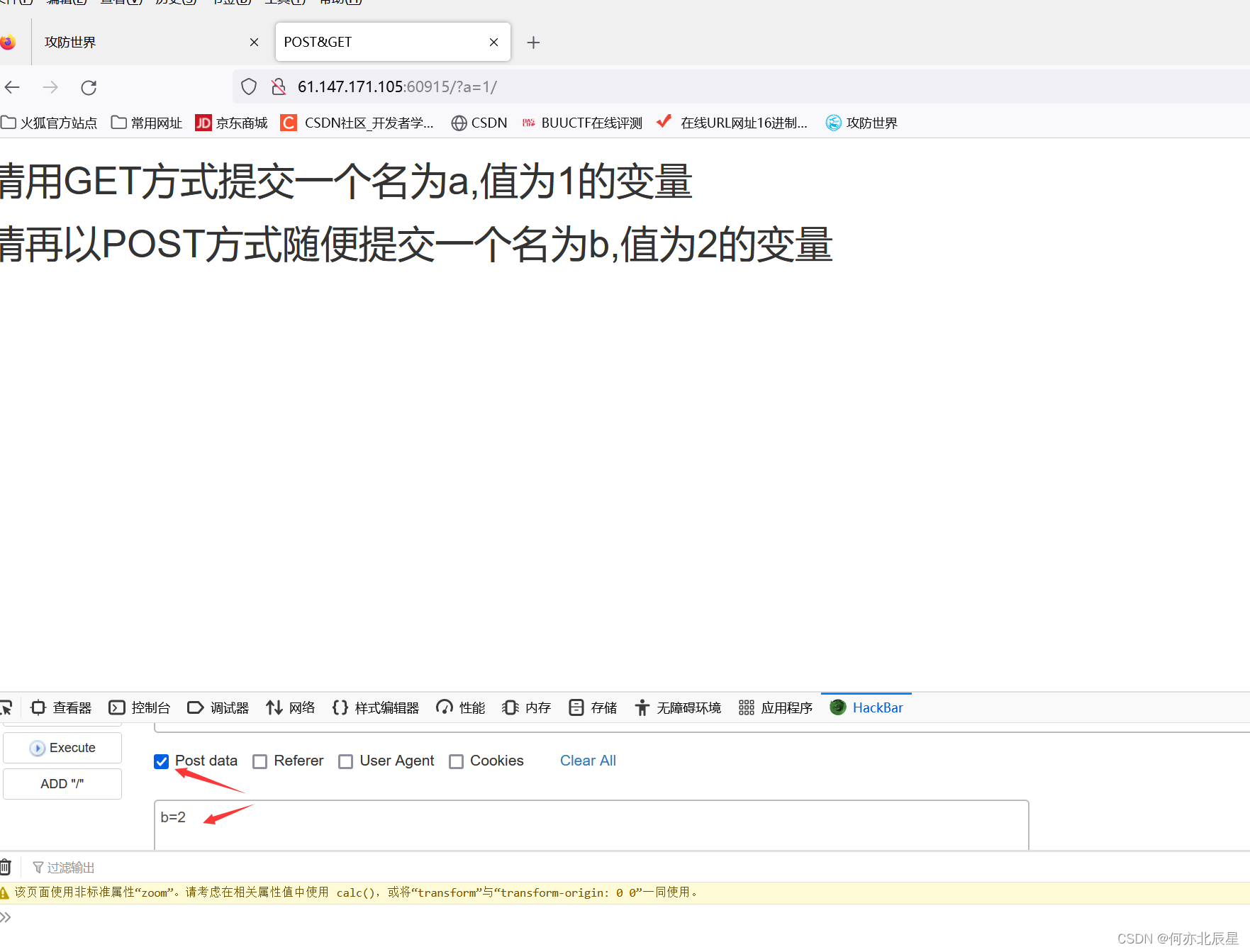

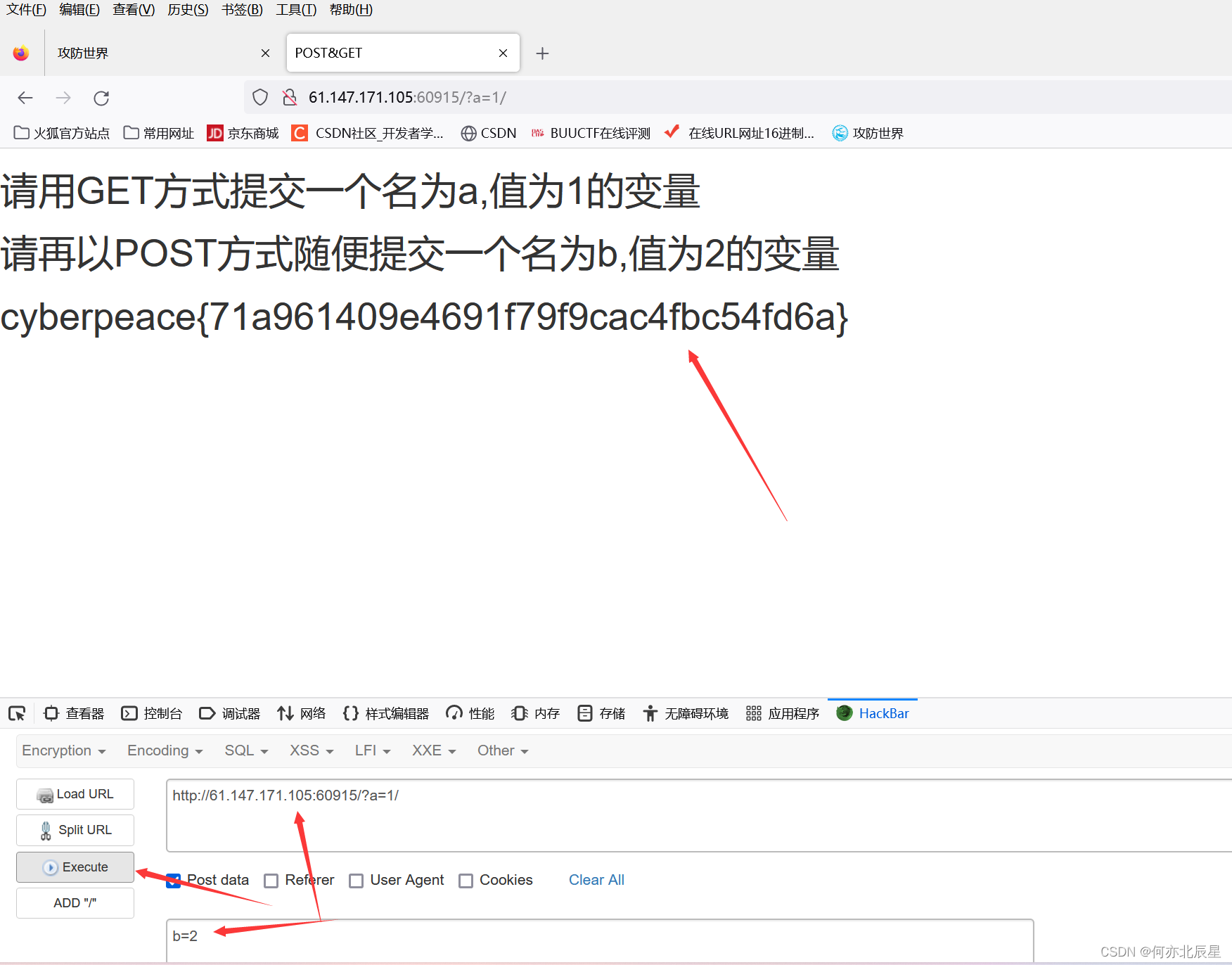

这提示的很明显,直接在上方按正确格式输入即可

这是页面又让你用post传值方式,直接F12,在hackber中的post数据输入,运行即可。

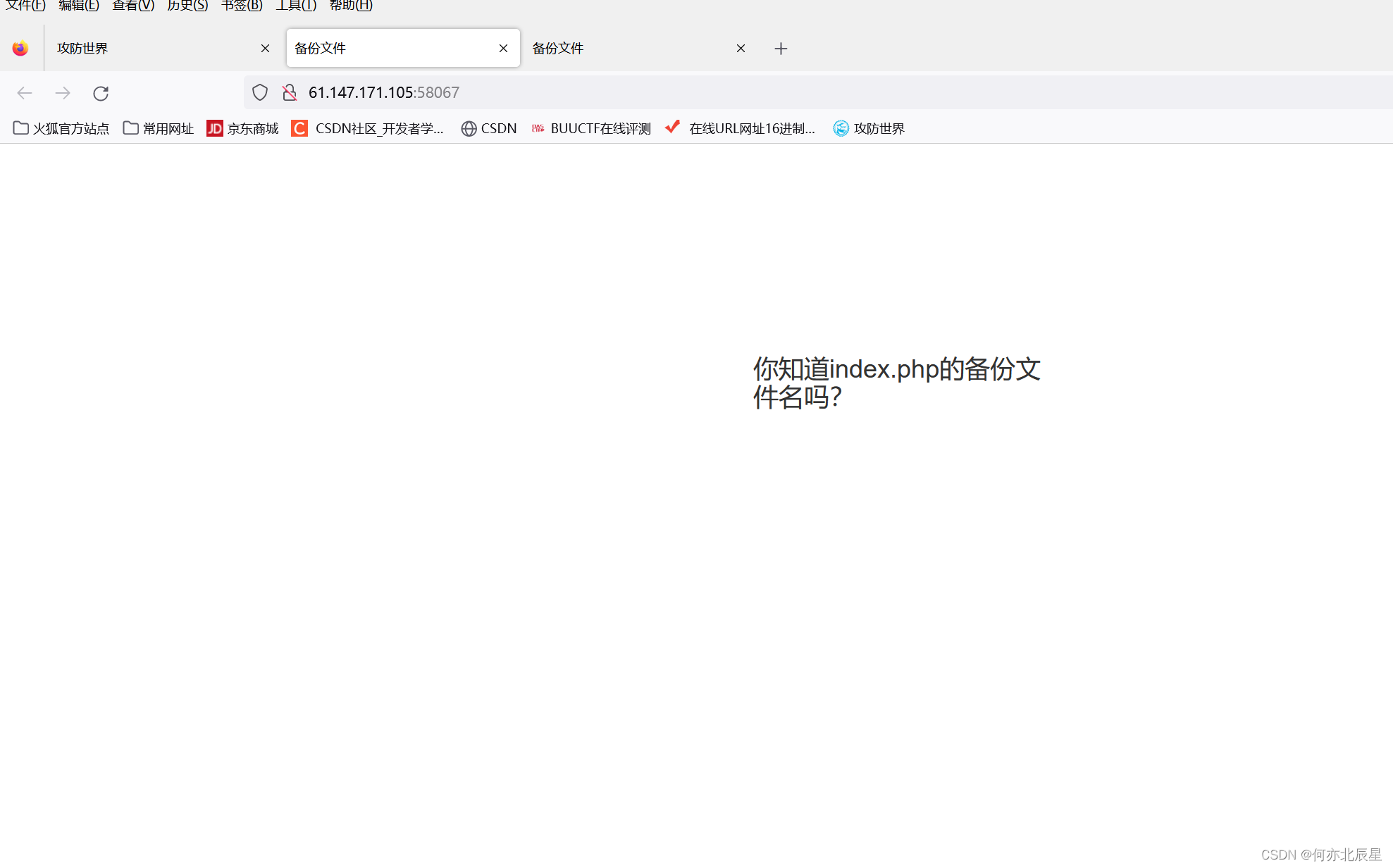

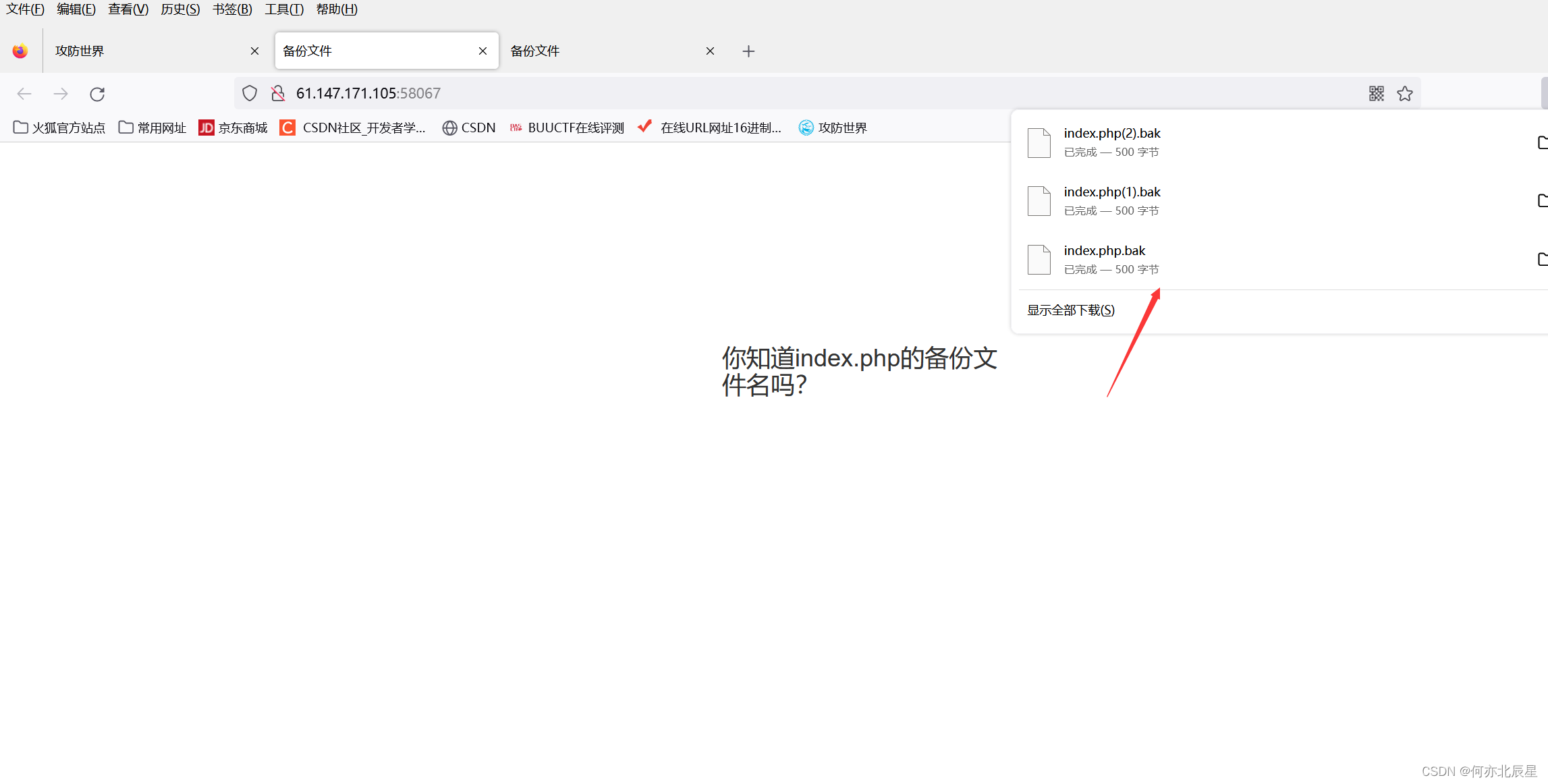

第六题:(同样简单)

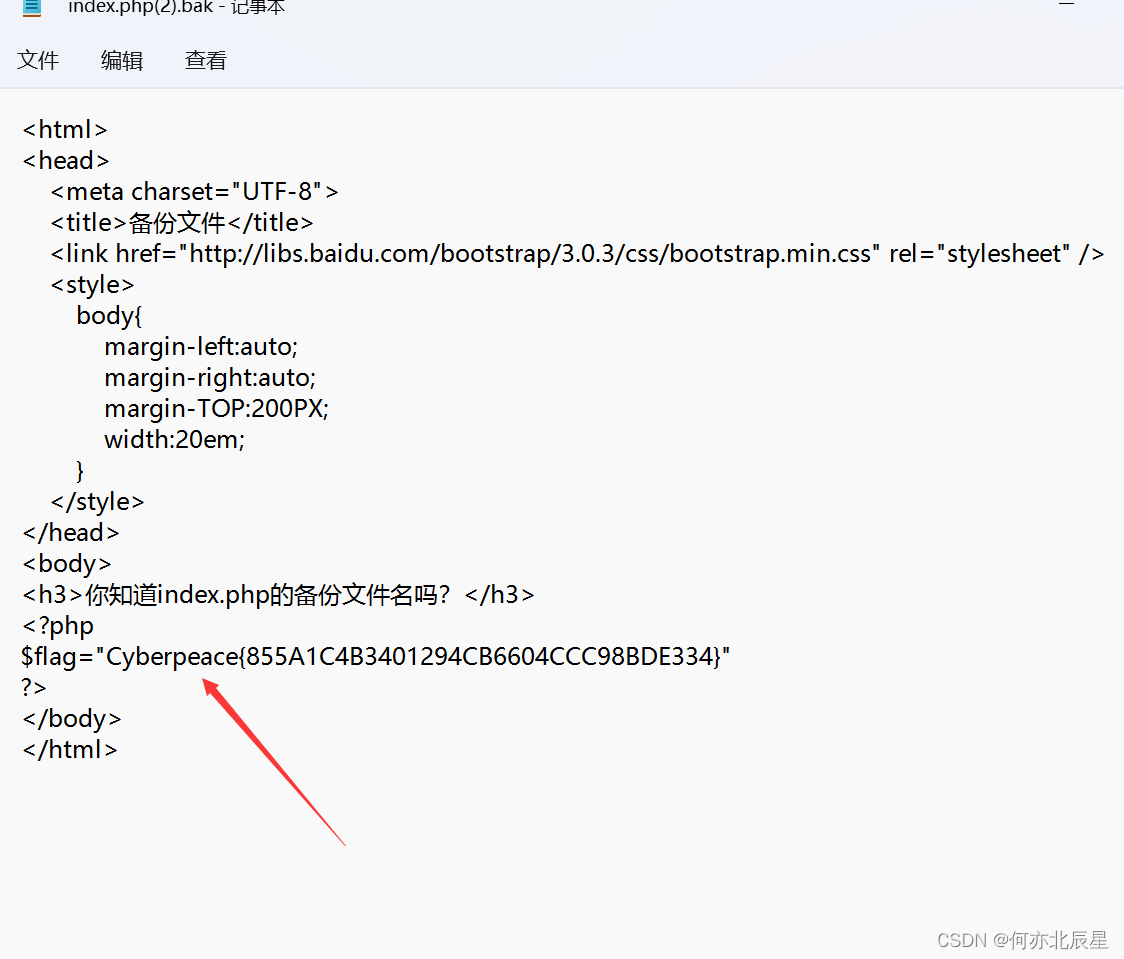

打开后发现如图问题,对于我这菜鸟来说肯定不知道,直接度娘搜索得知要添加bak后缀,于是我在上面网址后面输入改后缀,发现自动下载来个文件,直接以记事本形式打开,得到了flag。

常见备份文件后缀名为:常见的备份文件后缀名有:“.git” 、“.svn”、“ .swp”“.~”、“.bak”、“.bash_history”、“.bkf”

6181

6181

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?