一、摘要(有生成h5的文件代码)

1、restormer(图像重构) 模块提取浅层特征+双分支transformer-CNN特征提取器(Lite transformer 利用远程注意力来处理低频全局特征,invertible neural networks 块远程注意力来处理高频全局特征)

2、共享编码器不能区分模态特定特征,私有编码器忽略模态共享特征,CNN只提取相对视野较小的局部信息,无法提取全局信息。融合网络的前向传播会导致高频信息的丢失。因此,我们的目标是通过分别增加和减少低频和高频特征之间的相关性来促进模态特定和模态共享特征的提取。

3、vision transformer基于变换器的方法在计算上是昂贵的,这为考虑图像融合架构的效率-性能权衡而进一步改进留下了空间。结合CNN中局部上下文提取和计算效率的优势以及transformer中全局注意力和长距离以来建模的优势来完成MMIF任务。

4、解决丢失高频输入信息的挑战,采用了可逆神经网络的构建块,输入和输出特征的相互生成来防止信息丢失。

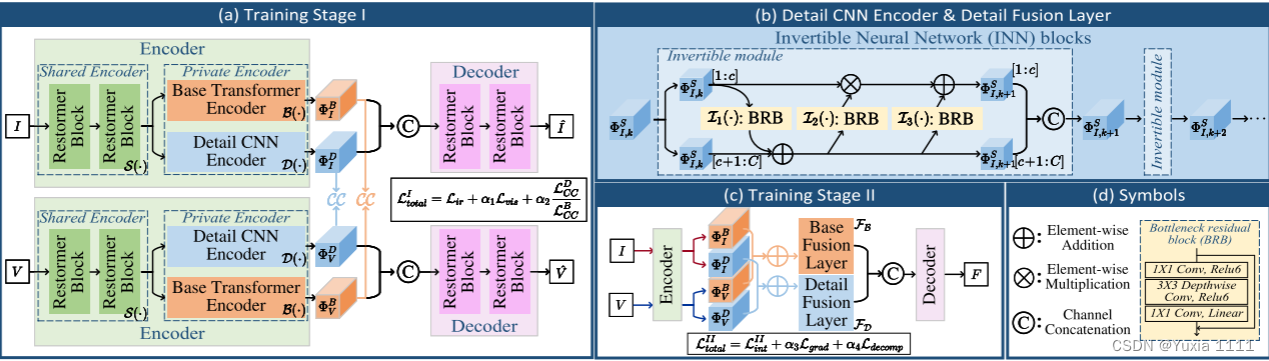

5、提出的网络:模态特定和模态共享的特征提取是由一个双分支编码器实现的

我们提出了一个双分支Transformer-CNN框架,用于提取和融合全局和局部特征,它更好地反映了不同的模态特定和模态共享特征。·我们改进了CNN和Transformer块,以便更好地适应MMIF任务。提出了一个相关性驱动的分解损失函数来执行模态共享/特定特征分解,这使得跨模态的基本特征相关,同时使不同模态中的详细高频特征去相关。

二、相关工作

四个主要类型:生成对抗网络、AE 、统一模型、算法展开。

method:低频长度范围特征表示为基本特征,高频局部特征表示为细节特征

1、网络结构:

shared encoder (选择Restormer块的原因是Restormer可以通过在特征维度上应用自注意力来从高分辨率输入图像中提取全局特征。因此,它可以提取跨模态浅层)

base transformer encoder(提取共享特征里的提取低频基本特征,我们使用了一个具有空间自注意的Transformer,考虑到平衡性能和计算效率,我们使用LT块作为BTE的基本单元)

detail CNN encoder(提取共享特征中的高频细节信息)

decoder:使用Restormer块作为解码器的基本单元.

2、使用两个阶段学习方案来训练我们的CDDFuse.端到端

8554

8554

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?