一:环境配置

1.python环境

python版本推荐3.10 - 3.11

transformers库版本推荐为4.36.2

torch推荐使用 2.0 及以上的版本,以获得最佳的推理性能

2.硬件环境

查看显卡配置:nvidia-smi

运行 Int4 版本的 ChatGLM3-6B的最低配置:

内存:>= 8GB

显存:>= 5GB(1060 6GB,2060 6GB)

二:下载 ChatGLM3-6B模型

1. 从 Hugging Face 官网下载模型。

使用这种方法,下载模型需要先安装Git LFS

git lfs install

git clone https://huggingface.co/THUDM/chatglm3-6b

如果访问不到Hugging Face的官网则可以使用镜像网站:

THUDM/chatglm3-6b · HF Mirror (hf-mirror.com)

2.从GitHub官网下载运行模型所需要的文件:

GitHub - THUDM/ChatGLM3: ChatGLM3 series: Open Bilingual Chat LLMs | 开源双语对话语言模型

三:运行ChatGLM3-6B模型

1.通过pycharm中命令行建立conda环境

conda create -n chatglm3-demo python=3.11

2.执行conda环境

conda activate chatglm3-demo

出现如下界面则成功:

![]()

3.下载模型所需要的依赖

pip install -r requirements.txt

4.本地运行模型:

1.加载本地模型文件,并量化

2.网页版界面启动

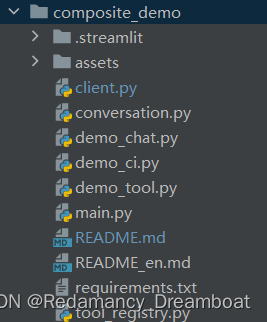

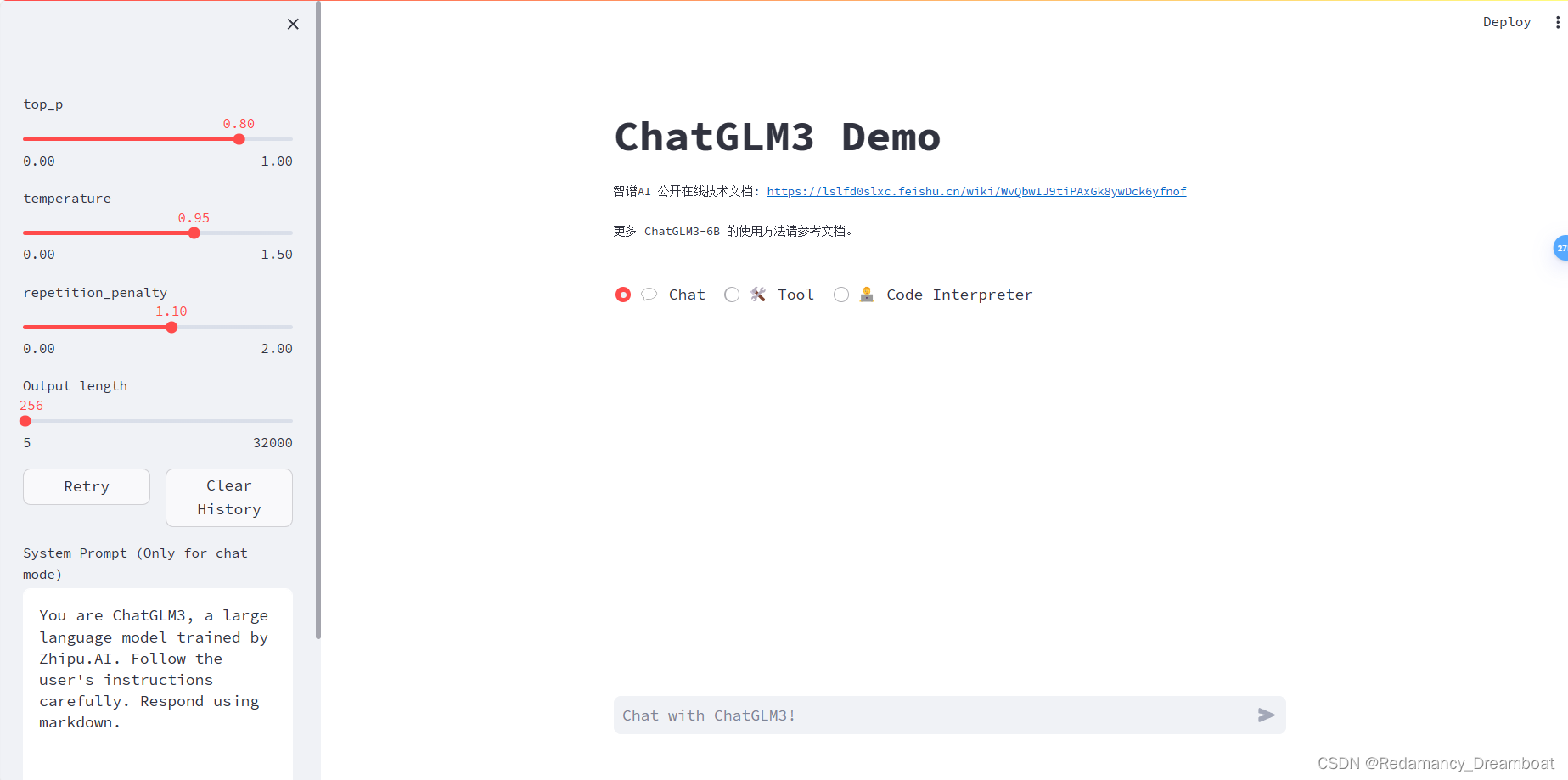

进入composite_demo模块,运行如下代码:streamlit run main.py

cd composite_demo #进入模块

streamlit run main.py # 启动网页版界面网页版界面:

3.命令行模式启动

进入basic_demo模块,在命令行运行cli_demo.py文件启动命令行模式的ChatGLM3-6B模型,输入如下命令启动:

cd basic_demo # 进入模块

python cli_demo.py # 运行py文件

命令行界面:

这样使用ubuntu在本地部署ChatGLM3-6B模型就部署好啦

本文详细指导如何配置Python环境(推荐3.10及以上,transformers4.36.2,Torch2.0+),检查硬件需求(至少8GB内存和5GB显存),包括从HuggingFace官网或镜像下载ChatGLM3-6B模型,通过PyCharm和命令行创建和激活conda环境,安装依赖,以及在网页版和命令行两种模式下运行模型。

本文详细指导如何配置Python环境(推荐3.10及以上,transformers4.36.2,Torch2.0+),检查硬件需求(至少8GB内存和5GB显存),包括从HuggingFace官网或镜像下载ChatGLM3-6B模型,通过PyCharm和命令行创建和激活conda环境,安装依赖,以及在网页版和命令行两种模式下运行模型。

6251

6251

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?