1 简介

图像融合 (Image Fusion)技术是一门多类学科的高新现代技术,它结合了图像处理、传感器技术、计算机科学和信号处理等学科,是可视化的数据融合中的重要技术分支。图像融合是通过将特定算法对两幅及以上的图像进行处理得到一幅图像的过程,这一过程不但可以获取多幅图像之间的互补性特征信息,避免了传统单一图像在光谱信息、空间分辨率、几何信息等多方面存在的差异性及局限性。因此图像融合技术可以更为精准、全面、可靠地获得对场景或目标信息的描述,增强了图像感知空间能力,提升了图像目标检测与识别准确性,促进了图像的进一步分析处理,将更加有利于机器视觉与人类视觉处理。

图像融合是为了将多源图像的互补重要信息进行提取、保留及合并得到一幅图像。

然而,对源图像的灰度像素值在空间域上进行简单的加权平均算法的融合无法取得满意的融合结果。这种简单的加权平均算法不仅不能很好地分析源图像的特征细节进行保留、提取及合并融合处理,而且会降低融合结果的对比度[14]。此外,物体在现实世界中具有不同空间范围尺度上表现出不同特征的特点。近处观察物体可以看到物体的纹理,组成等细小尺度微结果,而在远处观察物题能够看到物体的形状,轮廓等大尺度宏观特征。因此对目标的理解和识别需要在适当的尺度下进行。在机器视觉中,像素级的图像信息处理仅仅停留在数据处理层面。在视觉处理方面,现实中更需要多尺度上提取和处理图像特征。而不同目标在图像中的尺度不同,无法制定一个尺度下去处理图像,多尺度下分析处理图像更为符合现实情况。图像多尺度融合技术,同人类从轮廓到细节方式视觉感知认识事物的过程相一致,因此更容易取得效果良好的图像融合质量。该技术在图像融合领域一直作为研究重点。为了对源图像的信息在不同分辨率级别上进行深度分析,从而对不同级别分辨率的信息采用特定的算法进行保留和合并得到融合图像。多尺度分析方法如金字塔变换等方法的出现使得图像融合多尺度技术出现。多尺度分解技术是一种在不同分辨率和不同尺度上对图像进行分析的方法,该方法可以分解得到图像不同分辨率和不同尺度上的高频信息以及图像的低频信息。在图像处理与图像表示领域,多尺度分解技术存在重要优势。

1.图像多尺度分解技术符合客观世界中层级分辨率上描述物体的状态。

2.多尺度表示方法具有不同分辨率上处理图像空间特征的特点,这和与人类在不同

通道不同尺度上处理视觉信号的视觉特征系统相一致。

3.多尺度分解技术能够处理图像信号得到适合人类视觉对比度的信息,这符合人类

视觉对图像对比度敏感的特点.

20 世纪 90 年代,美国学者 Huang[39]首次在国际学术会议上提出基于经验模态分解的方法主要用于研究一维时间信号序列。一维 EMD作为一种时频局部化自适应性信号

多尺度分析分解工具,非稳态与非线性信号能够通过一维 EMD处理分解成为由高频到

低频的有限多个 IMF 。其中, IMF 函数的获取过程简称为筛选过程。在 2000 年初期,

Nunes[61] 提出了 BEMD , EMD 基于数学形态学采用径向基函数

(

Radial Basis Function RBF

,

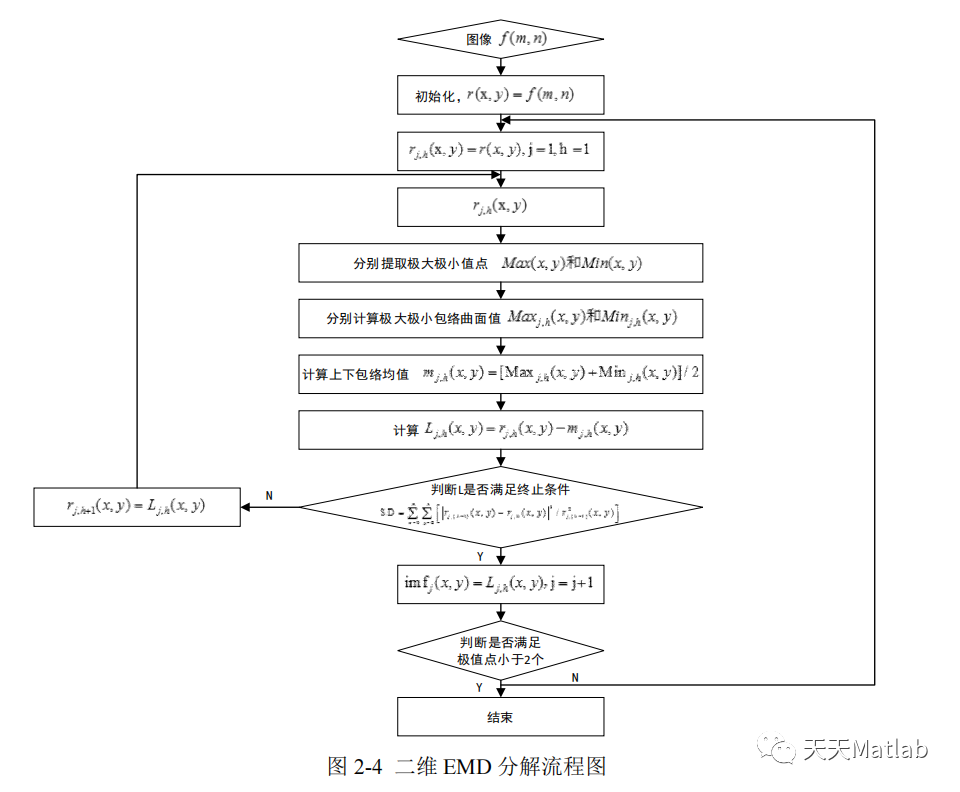

)和形态重建算子提出二维 EMD的筛分过程用于处理二维图像信号。这是一种真正的二维经验模态分解。通过二维 EMD将二维图像信号在不同尺度上自适应地分解为由高频分量(多个细节 IMF 分量)和低频分量(残量)组成之和,并对对图像纹理的独特性质进行了分析。不同的 IMF 代表原图像各个尺度中的细节信息,单个残余分量为图像的整体轮廓信息。二维 EMD的分解过程同一维 EMD类似,首先假设二维图像信号最少存在一个极小和极大值点,或信号整体完全没有极值点但通过对数据求取一阶及多阶运算求导后可得到一个极小值点和一个极大值点。图像信号通过二维EMD分解的简单流程图如下图所示。

2 部分代码

%The code to generate synthetic texture images in paperclc, close allf1 = 0.08f2 = 0.02n = 0:199;mask = mat2gray(normpdf(1:200, 100, 80));s1 = sin(2*pi*f1*n+rand()*pi) + sin(2*pi*f2*n+rand()*pi) + sin(2*pi*f3*n+rand()*pi);text1 = repmat(s1, 200, 1) + repmat(s1', 1, 200);text1 = mat2gray(text1);s2 = sin(2*pi*f2*n+rand()*pi) + sin(2*pi*f1*n+rand()*pi);text2 = repmat(s2, 200, 1) + repmat(s2', 1, 200);text2 = mat2gray(text2);%figure, imshow(text2)s3 = sin(2*pi*f1*n+rand()*pi) + sin(2*pi*f2*n+rand()*pi);text3 = repmat(s3, 200, 1) + repmat(s3', 1, 200);text3 = mat2gray(text3);mask = repmat(normpdf(1:200, 100, 80), 200, 1)+repmat(normpdf(1:200, 100, 80)', 1, 200);syn1 = mat2gray(text1);syn2 = mat2gray(text2+sqrt(0.006)*randn(200,200));syn3 = mat2gray(text3+sqrt(0.006)*randn(200,200));% final multi-channelfinal = zeros(200, 200, 3);final(:,:,1) = syn1;final(:,:,2) = syn2;final(:,:,3) = syn3;figuresubplot(2,3,1), imshow(syn1)subplot(2,3,2), imshow(syn2)subplot(2,3,3), imshow(syn3)save('texture_syn.mat', 'final')

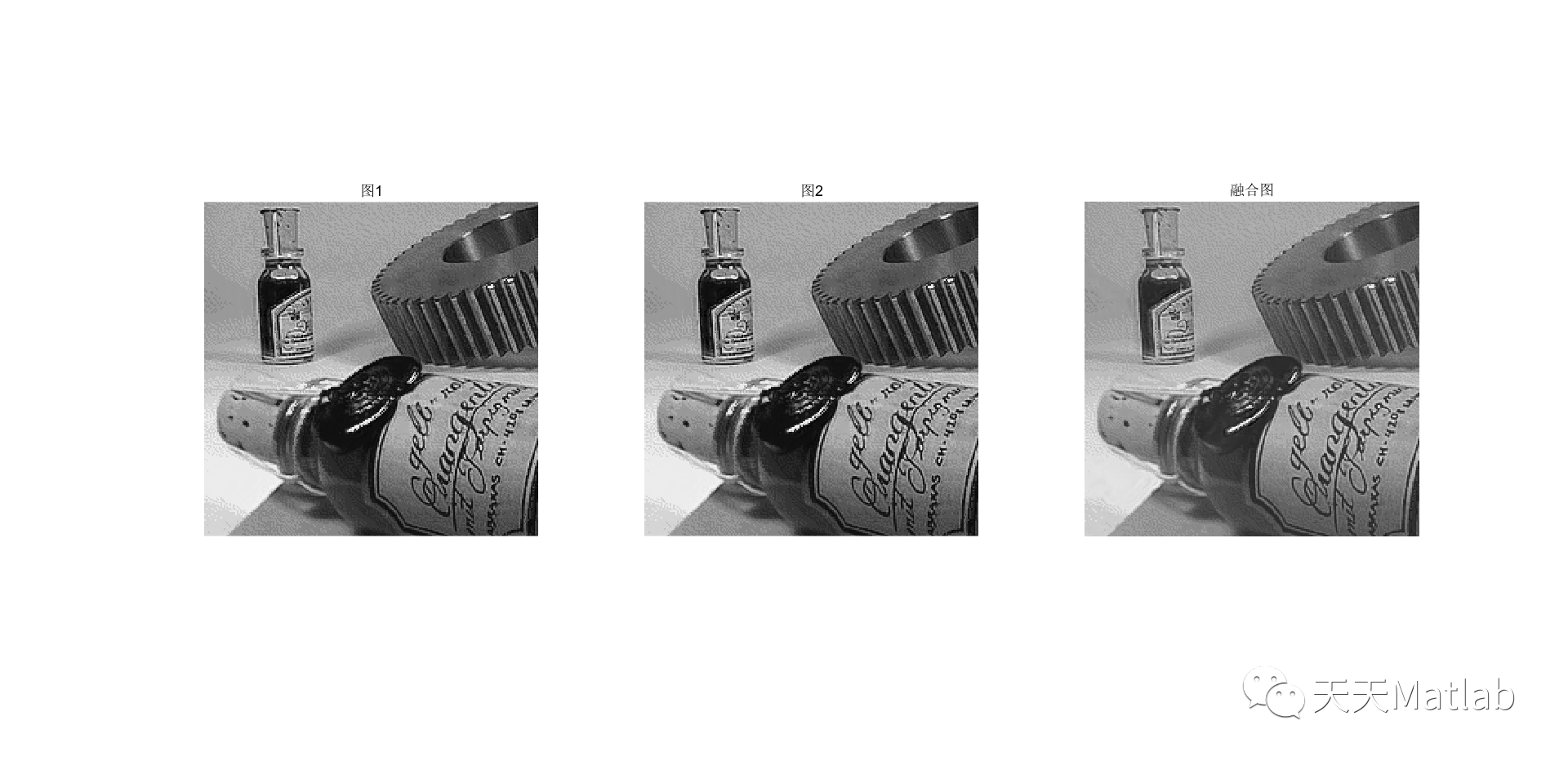

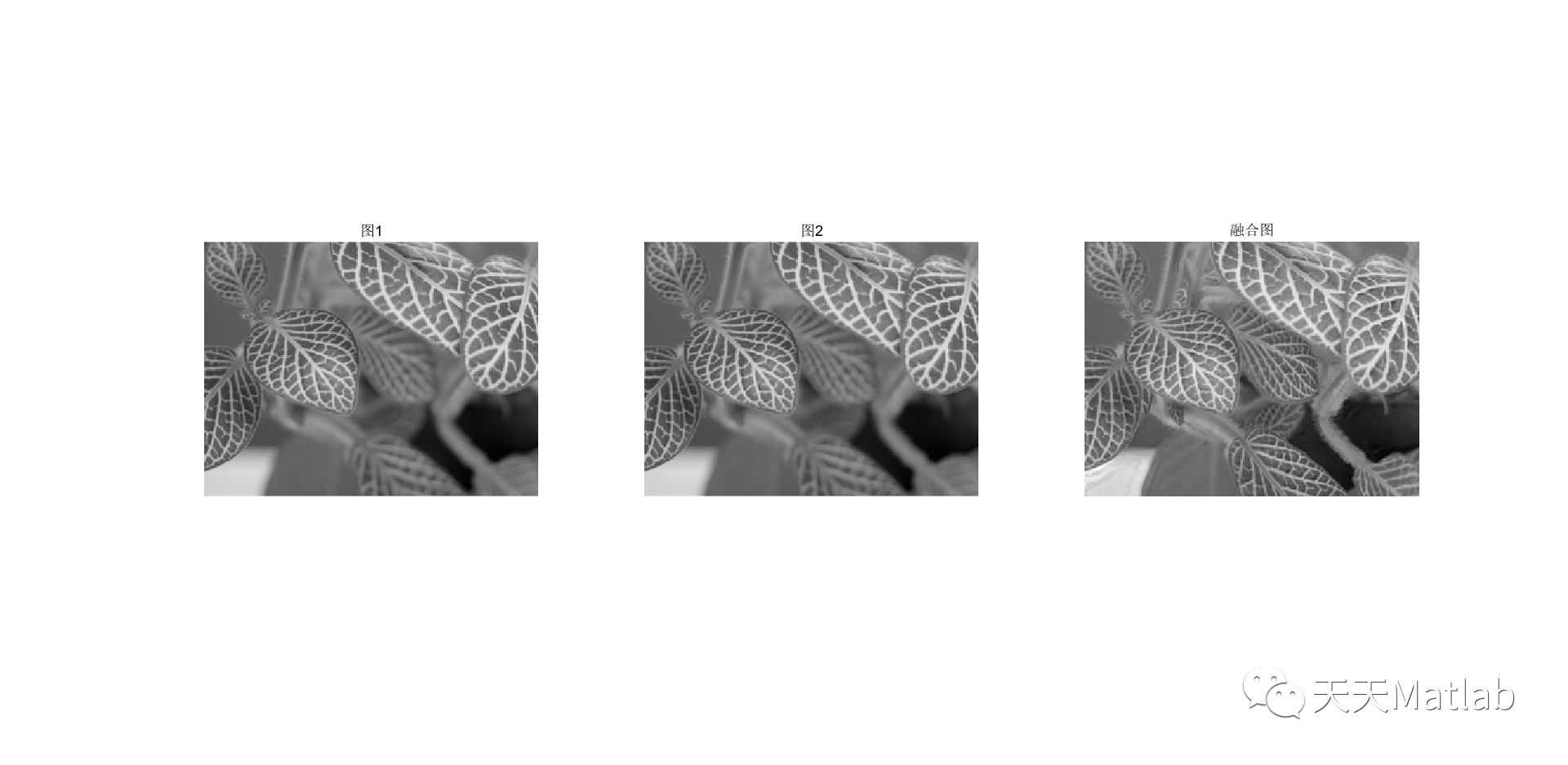

3 仿真结果

4 参考文献

[1] N. Rehman and D. P. Mandic,, "Multivariate empirical mode decomposition," Proc. R. Soc. A, vol.466, no. 2117, pp. 1291-1302, 2010.

[2] T. Tanaka and D. P. Mandic, “Complex empirical mode decomposition,” IEEE Signal Process. Lett., vol. 14, no. 2, pp. 101–104, Feb. 2007.

[3] G. Rilling, P. Flandrin, P. Gonalves, and J. M. Lilly, “Bivariate empirical mode decomposition,” IEEE Signal Process. Lett., vol. 14, no.12, pp. 936–939, Dec. 2007.

[4] N. Rehman and D. P. Mandic, “Empirical mode decomposition for trivariate signals,” IEEE Trans. Signal Process., vol. 58, no. 3, pp. 1059–1068, Mar. 2010.

[5] J. C. Nunes, S. Guyot, and E. Delechelle, “Texture analysis based on local analysis of the bidimensional empirical mode decomposition,” Mach. Vis. Appl., vol. 16, no. 3, pp. 177–188, May 2005.

博主简介:擅长智能优化算法、神经网络预测、信号处理、元胞自动机、图像处理、路径规划、无人机等多种领域的Matlab仿真,相关matlab代码问题可私信交流。

部分理论引用网络文献,若有侵权联系博主删除。

562

562

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?