本系列(Stanford Machine Learning) blog包括单变量线性回归、多变量线性回归、OctaveTutorial、LogisticRegression、Regularization、SVM和聚类等机器学习内容。内容来至Stanford Andrew的机器学习公开课的讲解(https://class.coursera.org/ml/class/index)。

第2讲--多变量线性回归

(一)multiple Features

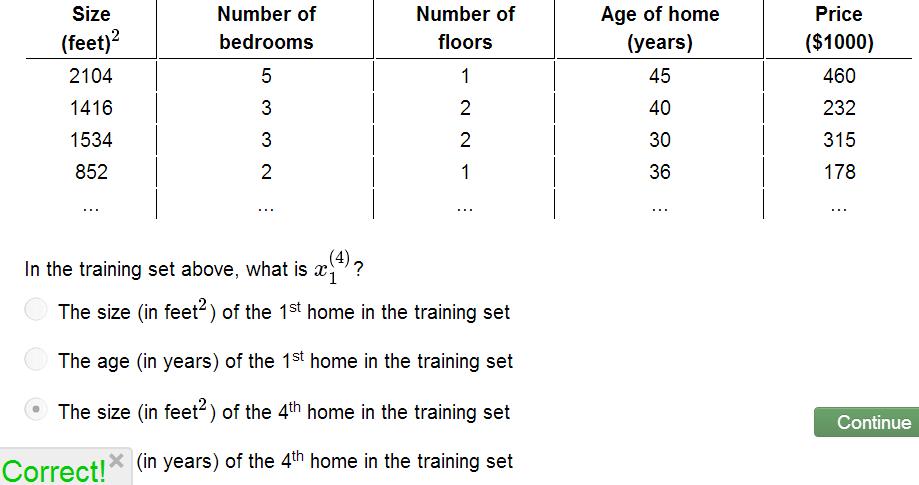

多变量假设函数:输入为多维特征量,输出由输入的多维决定.即 y = f(x1,x2,x3,...,xn)。比如房价有多个方面决定。

练习题

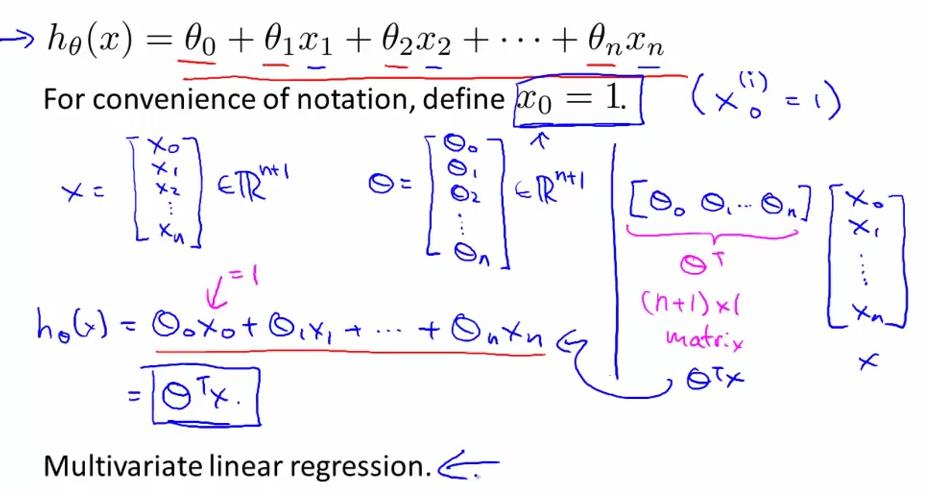

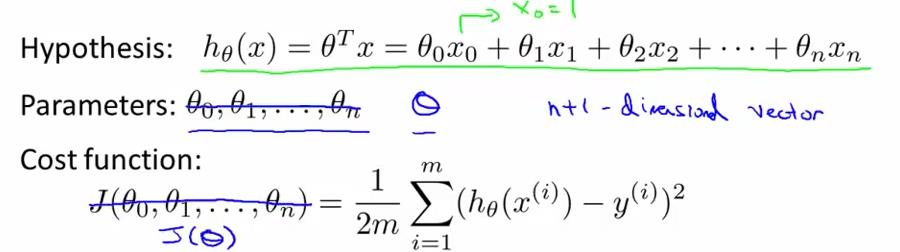

假设函数 h(x)= θ0+θ1x1+……+θnxn 即每个输入x有(n+1)维[x0……xn]

(二)Gradinet Descent for Multiple Variables

把θ0,θ1,...记做θ, θ是一个n+1维的向量

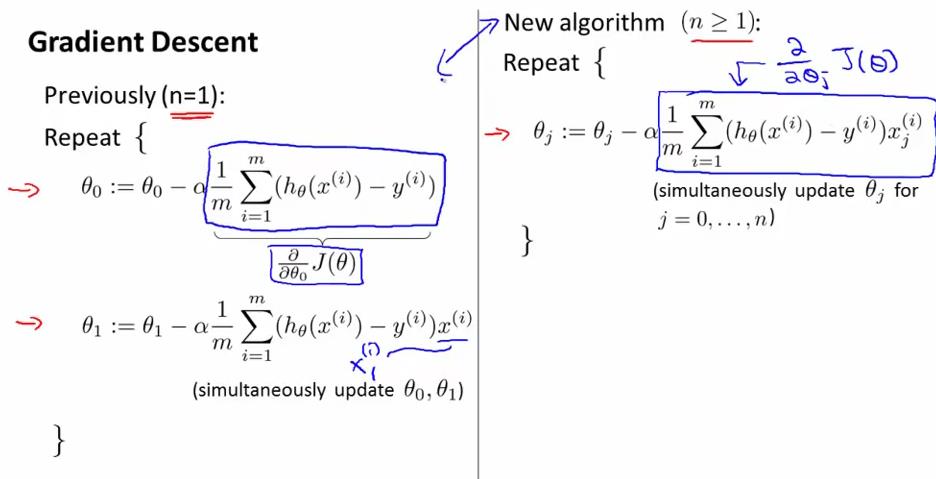

左边是单变量梯度递减学习方法,右边是多变量梯度递减学习方法

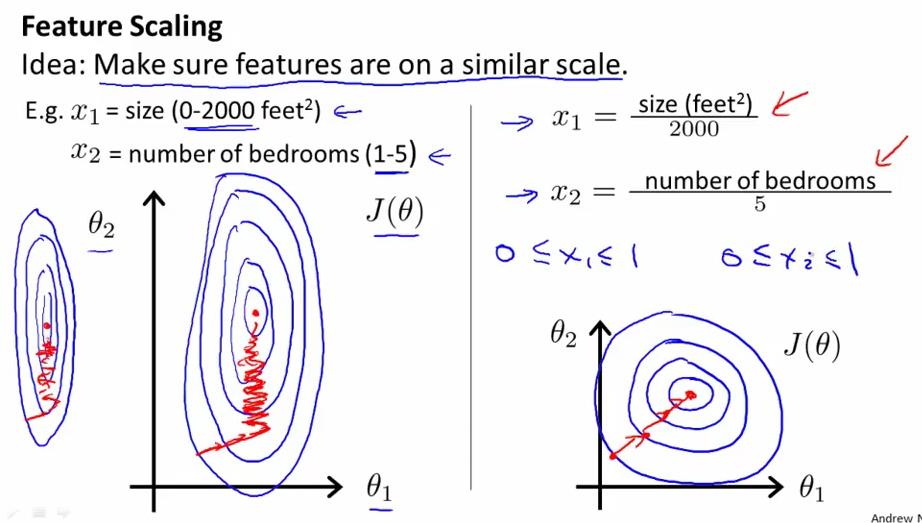

(三) Gradient Descent in Practice I :Feature scaling

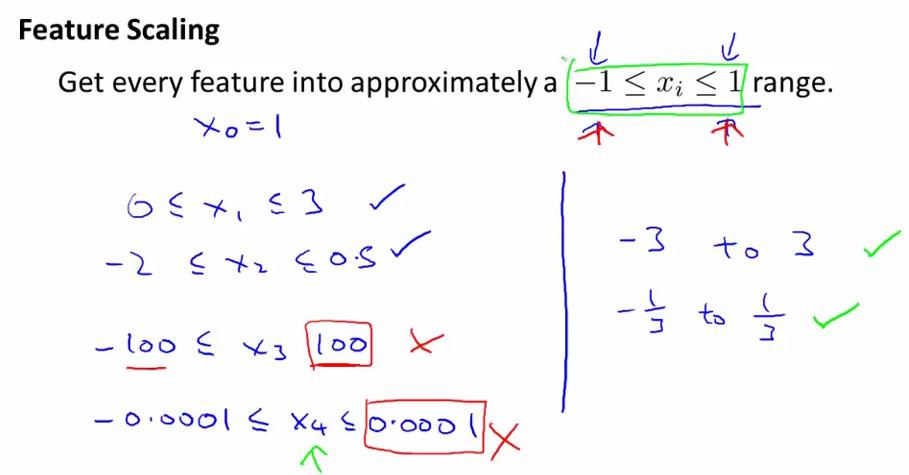

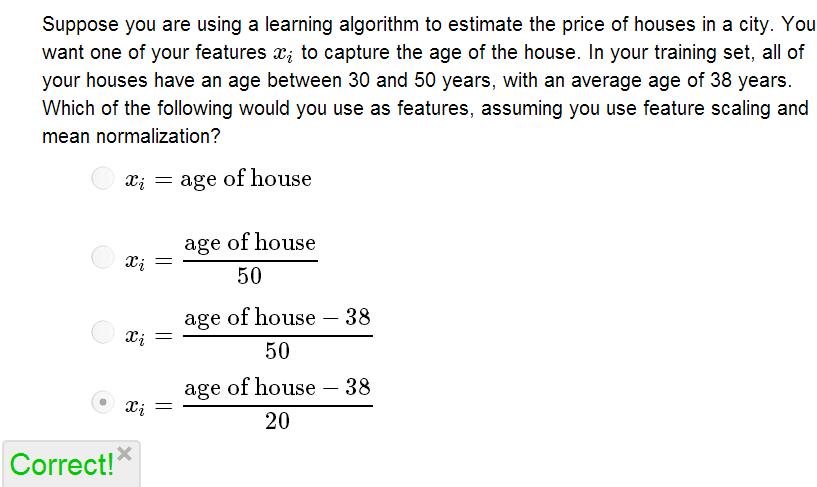

均值归一化操作特征值,将特征值归一化到[-1,1]区间, 归一化方法 (x1-u1)/s1 . u1表示平均值, s1表示标准差(最大值减去最小值也可)

练习题

233

233

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?