- 实验环境搭建

架构:

namenode1(master1)

namenode2(master2)

datanode(regionserver)

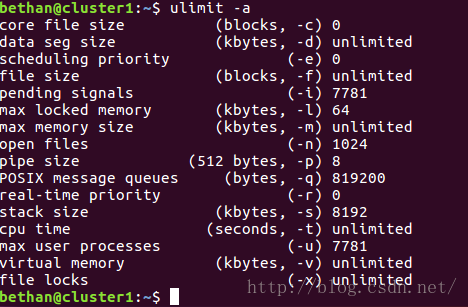

查看、修改Linux系统的最大文件打开数和最大进程数

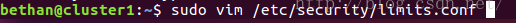

修改limits.conf文件

改为

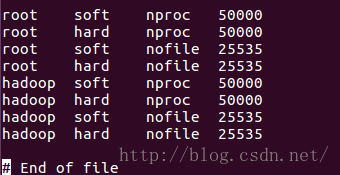

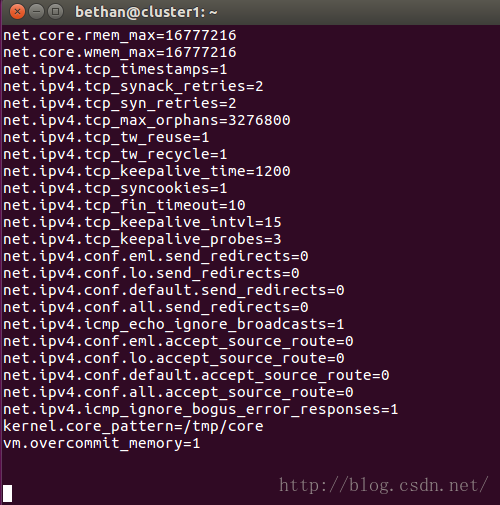

调整Linux内核参数

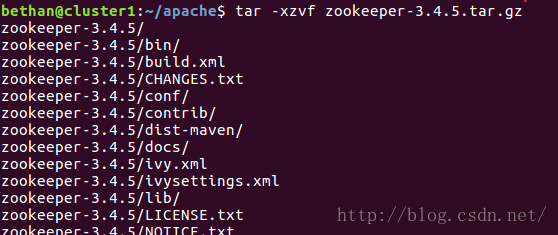

- 安装zookeeper3.4.5

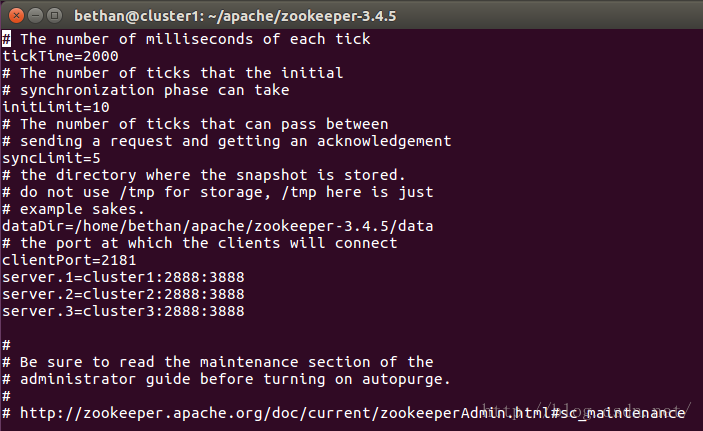

zk配置

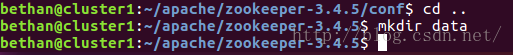

先创建data目录

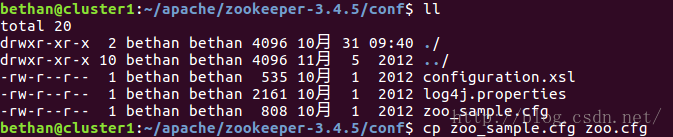

拷贝一份zoo.cfg出来

修改zoo.cfg里面的配置项

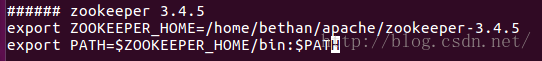

配置环境变量

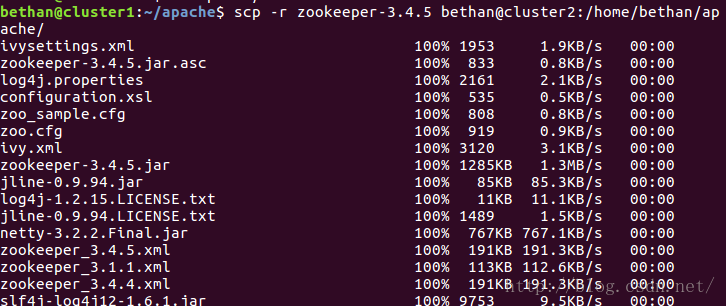

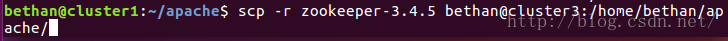

将zookeeper文件夹拷贝给另外两台机器

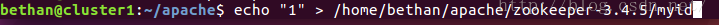

在本机上的zookeeper文件夹内写入id

- Hbase的安装、配置

安装hbase-0.98.1-hadoop2-bin.tar.gz软件包

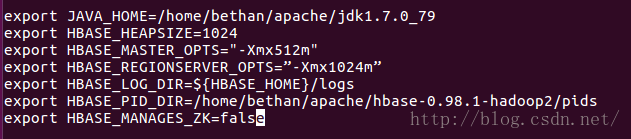

配置hbase-env.sh

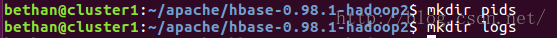

在hbase文件夹下创建pids,logs文件夹

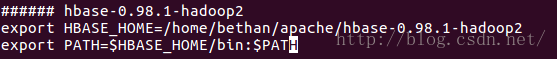

修改环境变量,添加

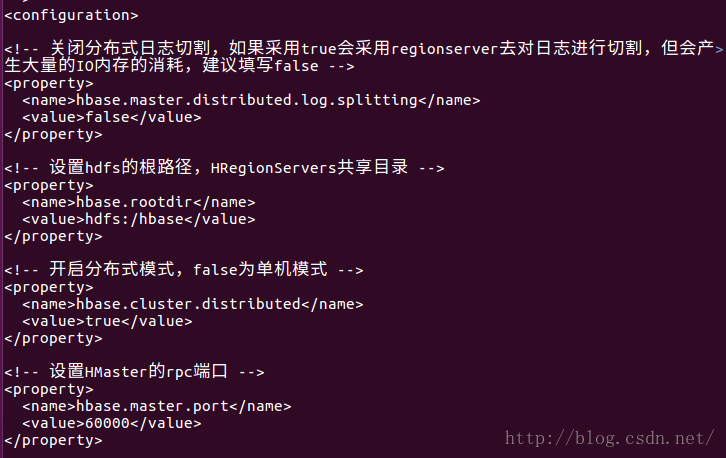

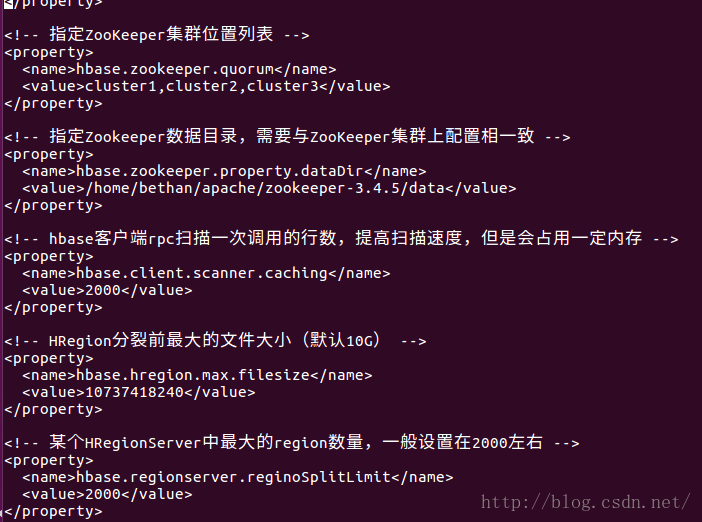

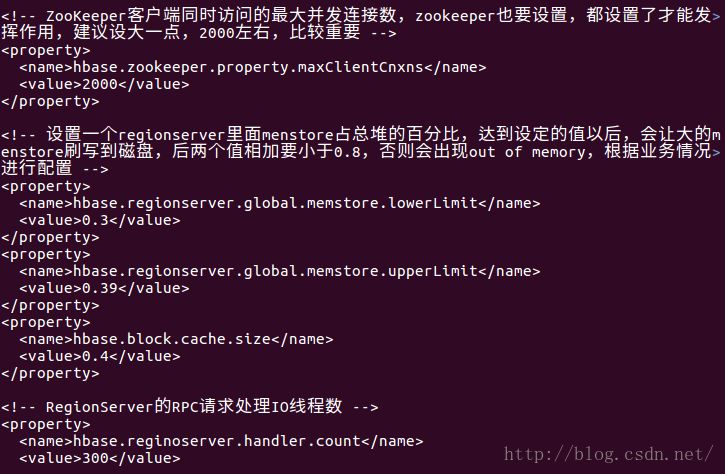

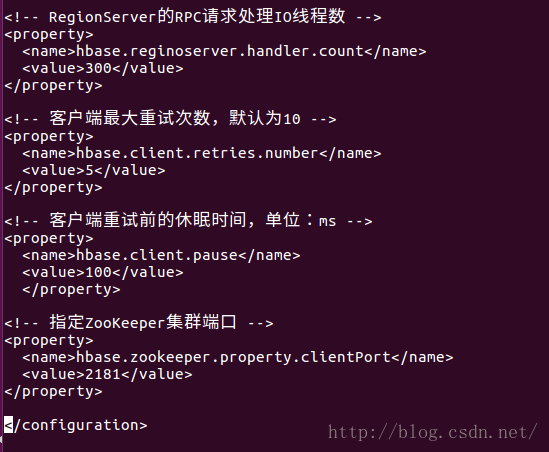

修改hbase-site.xml

添加regionserver节点主机名

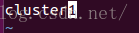

复制hdfs-site.xml到conf目录下

添加备用Hmaster节点主机名

vim backup-masters

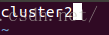

创建hbase的缓存文件目录

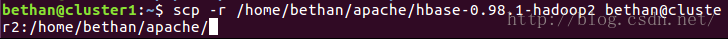

同步hbase工作目录到集群其它节点

在各节点上修改用户环境变量并使其生效

启动集群

- HDFS、HBase动态替换节点

Hadoop、HBase动态增加节点

1.增加Hadoop节点

新节点的IP配置,用户创建,核对时间,修改最大文件读取数、最大用户进程数和内核参数,SSH免密码登录配置等

配置hosts文件,添加主机名和IP地址,且同步到其它节点 修改hadoop的配置文件slaves,添加新节点的主机名

复制JDK和hadoop目录到新的节点(注意新节点的hadoop的data、pids等目录需要清除数据)

新节点hadoop权限的修改

修改新节点的环境变量

在新节点中通过命令Hdfs dfsadmin –setBalancerBandwidth设置字节数、带宽,通过命令start-balancer.sh -threshold 5均衡当前的HDFS块 (threshold是平衡阈值,默认是10%,值越小负载越均衡,但需要更长的时间去执行)

在新节点通过命令hadoop-daemon.sh start datanode和yarn-daemon.sh start nodemanager启动datanode和nodemanager进程

2.增加HBase节点

在HBase的配置文件regionserver中添加新节点的主机名

复制hbase目录到新的节点(注意新节点的data等目录也需要清除数据)

在新节点通过命令hbase-daemon.sh start regionserver启动HRegionServer

在新节点上通过hbase-daemon.sh start regionserver启动regionserver

进入hbase shell,通过命令balance_switch true进行region负载平衡

Hadoop、HBase动态删除节点

1.删除HBase节点

通过‘graceful_stop.sh 节点名’使得需要删除的节点的负载均衡停止使用

在HBase的配置文件regionserver中移除删除节点的主机名

2.删除Hadoop节点

在hadoop的配置文件hdfs-site.xml中添加配置:

<property>

<name>dfs.hosts.exclude</name>

<value>/home/hadoop/apache/hadoop-2.6.0/etc/hadoop/exclude</value>

</property>

在配置文件exclude中添加需要删除的节点主机名

通过命令hdfsafsadmin -refreshNodes执行节点刷新操作,重新加载配置

通过命令hadoop dfsadmin –report查看集群状态

8135

8135

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?